Agentische AI belooft systemen die niet alleen antwoorden genereren, maar ook daadwerkelijk bedrijfsacties uitvoeren. Het probleem? De meeste autonome agenten zijn afhankelijk van ongestructureerde data zoals e-mails, PDF’s en gescande documenten—informatie waar ze niet betrouwbaar mee kunnen werken. In dit artikel lees je waarom gestructureerde data de ontbrekende schakel is in agentische AI en hoe een toegewijde parsing-laag beloftevolle AI-agenten verandert in betrouwbare bedrijfssystemen.

Belangrijkste inzichten:

- Agentische AI verschuift AI van contentcreatie naar daadwerkelijke bedrijfsacties, waardoor een datafout grote gevolgen kan hebben.

- Autonome agenten hebben schone, gestructureerde en gevalideerde input nodig om veilig en schaalbaar te functioneren. Alleen LLM’s zijn hiervoor niet toereikend.

- Parseur levert de kritische parsing-laag die echte documenten omzet in betrouwbare, gestructureerde data, zodat agenten niet hoeven te gokken maar weloverwogen kunnen handelen.

De Overgang van “Praten” naar “Doen”

De ontwikkeling van AI gaat razendsnel. In 2023 en 2024 lag de nadruk vooral op generatieve AI: systemen die e-mails schreven, documenten samenvatten en met indrukwekkende vloeiendheid vragen konden beantwoorden. Deze tools veranderden de interactie tussen mens en software, maar bleven vooral op het converserende vlak.

Vanaf 2026 verandert het speelveld, want Gartner verwacht dat 40% van de bedrijfsapplicaties taakgerichte AI-agenten zal integreren. De nieuwe innovatiegolf heet agentische AI: systemen die niet alleen antwoorden, maar echt handelen. Waar generatieve AI een e-mail opstelt, verstuurt een AI-agent die e-mail nu zelf. Waar voorheen een voorstel werd gemaakt, voert de agent het volledige proces uit.

Dat klinkt veelbelovend. Volgens Kong INC is 90% van de bedrijven nu bezig met het implementeren van AI-agenten, waarvan 79% verwacht deze binnen drie jaar volledig uit te rollen. Stel je een AI voor die zelfstandig onderdelen van je supply chain managet, facturen verwerkt of je CRM-systeem automatisch bijwerkt zodra nieuwe gegevens binnenkomen. Geen dashboards, geen handmatige overdrachten, alleen resultaat telt.

Maar onder al dit enthousiasme schuilt een belangrijke waarschuwing. Terwijl de "hersenen" (grote taalmodellen als GPT-5 of Claude) steeds slimmer worden, is de "brandstof" waarop ze draaien meestal niet betrouwbaar. Volgens Rubrik is 80% van bedrijfskritische data ongestructureerd, denk aan e-mails, PDF’s, gescande documenten en ongestructureerde bijlagen. Als autonome agenten met deze rommelige data gaan werken, lopen fouten snel uit de hand.

Daarom stranden veel AI-initiatieven voordat ze echt starten. Niet omdat de AI niet kan redeneren, maar omdat er geen vertrouwen is in de data waarop gehandeld wordt.

Om agentische AI van indrukwekkend experiment naar betrouwbare bedrijfstechnologie te brengen, is een speciale laag nodig die zich richt op datakwaliteit: het omzetten van menselijke informatie naar schone, gestructureerde feiten voordat een autonome actie volgt.

Wat is agentische AI?

Agentische AI zijn systemen die zelfstandig doelen nastreven. In tegenstelling tot traditionele chatbots die wachten op een prompt en alleen reageren met tekst, zijn agentische systemen ontworpen om informatie te waarnemen, erover te redeneren en zonder continue menselijke input te handelen.

Concreet: een agent geeft niet alleen antwoord op de vraag “Wat moet ik nu doen?”, maar maakt die afweging zelf en voert de benodigde taak daadwerkelijk uit.

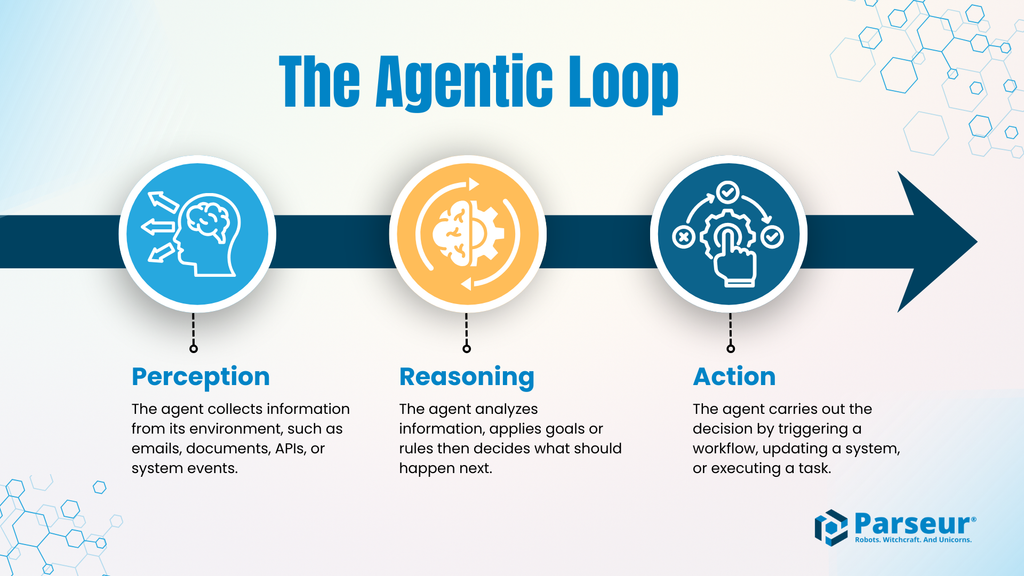

De Agentische Cirkel: Perceptie → Redeneren → Actie

De meeste agentische AI-systemen volgen een krachtige cyclus:

- Perceptie: De agent ontvangt input uit zijn omgeving, zoals e-mails, documenten, API-reacties of systeemnotificaties.

- Redeneren: Deze informatie wordt geïnterpreteerd, gekoppeld aan doelen of regels, waarna de agent een besluit neemt.

- Actie: De agent voert een taak uit, bijvoorbeeld een record bijwerken, workflow starten, betaling versturen of melding doen aan een ander systeem.

Deze loop blijft zichzelf herhalen, zodat de agent autonoom door kan werken zolang er nieuwe informatie is om op te handelen.

Waarom zijn de risico’s hoger?

Zodra AI-systemen echte acties gaan uitvoeren, krijgt elke fout serieuze consequenties. Een chatbot die een spelfout maakt is onschuldig, maar een autonome agent die een bedrag verkeerd leest, een klant verwisselt of handelt met halve informatie, kan flinke bedrijfsproblemen veroorzaken.

Praktijkvoorbeelden:

- Een verkeerd factuurbedrag betalen

- Verkeerde voorraad bestellen

- Het verkeerde klantrecord aanpassen

- Workflows triggeren op basis van onjuiste aannames

In agentische AI leidt elke fout tot directe, soms voelbare schade.

Generatieve AI vs. Agentische AI

| Aspect | Generatieve AI | Agentische AI |

|---|---|---|

| Hoofddoel | Genereert tekst, afbeeldingen of samenvattingen | Voert doelgerichte taken en workflows uit |

| Interactie | Reageert op menselijke input | Werkt grotendeels zelfstandig |

| Typische output | Concepten, uitleg, suggesties | Systeemupdates, transacties, geautomatiseerde handelingen |

| Besluitvorming | Gericht op samenhangende antwoorden | Gericht op keuze en uitvoering van acties |

| Fouttolerantie | Relatief hoog, fouten zijn zichtbaar en makkelijk te corrigeren | Zeer laag; fouten raken processen of financiën |

| Data-eisen | Kan werken met vage of incomplete input | Vereist precieze, gestructureerde en gevalideerde data |

| Risicoprofiel | Fouten zijn meestal cosmetisch of informatief | Fouten kunnen zakelijke en financiële impact hebben |

Het “grondwaarheids”-probleem

Agentische AI-systemen zijn gebouwd op logica, API’s en dataschema’s. Zij verwachten input in gestructureerde vorm—JSON, XML of vergelijkbaar—met benoemde velden, consistente formats en voorspelbare structuur. Bedrijfspraktijk is anders: essentiële info komt binnen als e-mail, PDF, spreadsheet, scan of een ander ongestructureerd formaat.

Dit verschil blokkeert echte autonomie.

Voordat een agent keuzes kan maken of kan acteren, is er “grondwaarheid” nodig: betrouwbare, machine-leesbare feiten. Zonder die basis moeten zelfs de slimste agenten gokken.

Waarom zijn LLM’s niet genoeg?

Het klinkt eenvoudig: laat een groot taalmodel (LLM) zelf documenten lezen en de benodigde data extraheren. Maar dit introduceert risico’s die toenemen bij opschaling.

Hallucinaties

LLM’s werken probabilistisch. Als informatie vaag, verweven of slecht opgemaakt is, gokken deze modellen. In een chat is dat nog aanvaardbaar, maar in een agentische workflow krijgt zo’n gok direct operationele gevolgen. Uit onderzoek blijkt dat hallucinaties toenemen wanneer LLM’s gestructureerde data uit rommelige documenten moeten halen, zeker bij langere of complexere input.

Kosten en vertraging

Volledige PDF’s, e-mailthreads of scans via LLM’s halen kost veel tokens, wat de kosten en de responstijd verhoogt. Voor grootschalige, real-time agentische processen is dit praktisch onhaalbaar.

Inconsistentie

Agentische workflows vereisen consistentie. Een agent heeft altijd dezelfde veldnamen, datatypes en structuur nodig, want de verwerking moet betrouwbaar zijn. Ruwe LLM-output verschilt vaak per document, zelfs al lijken die op elkaar. Zo’n klein verschil kan een hele workflow doen ontsporen.

Hoe fouten zich concretiseren

Werkt een agent op basis van onbetrouwbare data? Dan ontstaan er direct fouten:

Een facturatie-agent haalt een verkeerde leveranciersnaam uit een PDF en betaalt per ongeluk de verkeerde partij. Een inkoopagent vult een foute hoeveelheid in bij een bestelling, waardoor leveringen vertragen en voorraad ontbreekt. Of een contractagent mist een verlengingsclausule en hanteert onjuiste prijsvoorwaarden.

Dit zijn geen zeldzame situaties. In agentische systemen breidt een fout zich vaak snel uit, met domino-effect en automatische acties gebaseerd op verkeerde aannames. Uiteindelijk is handmatig ingrijpen nodig om het recht te trekken, en daalt het vertrouwen in automatisering.

Dat is het grondwaarheidsprobleem: agenten willen handelen, maar zonder betrouwbare, gestructureerde data opereren ze deels blind.

De Ontbrekende Laag: Intelligent Document Processing (IDP)

Dat agentische AI in de praktijk worstelt, ligt niet aan het redeneervermogen of de autonomie van agenten, maar aan het gebrek aan betrouwbare interpretatie van “echte” input. Hier komt Intelligent Document Processing (IDP) in beeld.

IDP vormt een dedicated parsing-laag tussen ongestructureerde, door mensen gemaakte documenten en autonome AI-agenten. In plaats van agenten of LLM’s direct ruwe input te laten verwerken, maakt deze laag van documenten eerst gestructureerde, betrouwbare data voordat er verder geautomatiseerd wordt.

In een agentische architectuur fungeert deze parsing-laag als betrouwbare basis. Zo weet een agent zeker dat hij handelt op feiten, niet op aannames.

Hoe werkt document parsing?

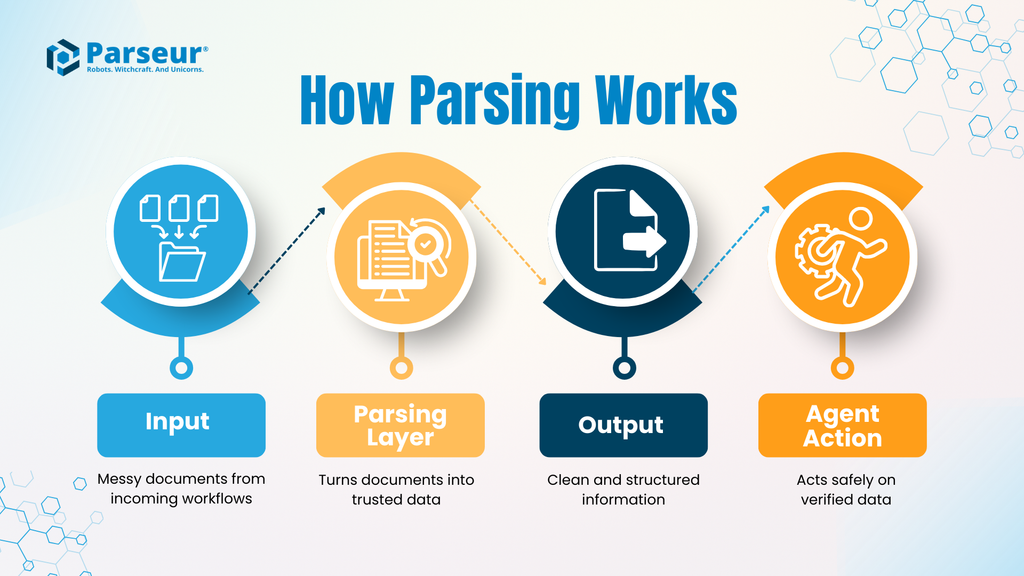

Een typische IDP-workflow:

- Input: Een reëel document zoals een factuur, vrachtbrief, contract of e-mail. Elk met een eigen, soms chaotische opmaak.

- Parsing-laag: Een IDP-tool haalt relevante data uit voorgedefinieerde velden, standaardiseert formats (zoals data, valuta, identificaties) en controleert de output op nauwkeurigheid en consistentie.

- Output: Schone, gestructureerde gegevens (bijvoorbeeld JSON) die voldoen aan een voorspelbaar schema.

- Agent-actie: De autonome agent ontvangt deze gestructureerde output en voert zijn taak uit, in de wetenschap dat de input accuraat en volledig is.

Door documentverwerking los te trekken van de agent zelf, verklein je het risico op fouten aanzienlijk. De agent hoeft geen documenten te lezen—hij werkt op gevalideerde input.

Waarom verbetert deze laag het risicoprofiel?

Zonder parsing-laag zijn agenten direct afhankelijk van de ambiguïteit van echte bedrijfsdocumenten. Elk verschil, elke inconsistentie is een potentieel foutpunt. Met IDP worden onduidelijkheden opgelost vóórdat automatisering plaatsvindt.

Dit is vooral relevant op schaal. Kijk bijvoorbeeld naar:

Volgens Parseur’s 2026-enquête meldt 88% van de bedrijven fouten in documentdata te ervaren. Een autonome agent die werkt met 88% kans op foutieve input is eerder een risico dan een vooruitgang.

IDP maakt agenten niet slimmer, maar wél veiliger. Het minimaliseert het risico op hallucinaties, maakt workflows robuuster en stelt bedrijven in staat om automatisering met vertrouwen op te schalen—zonder continu menselijk toezicht.

In agentische systemen draait alles om intelligentie, maar betrouwbaarheid maakt autonomie pas echt waardevol. De parsing-laag is de ontbrekende schakel die experimentele AI-agenten omzet in werkende operationele tools.

Echte voorbeelden: Waarom agenten Parseur nodig hebben

Agentische AI is pas van waarde in operationele bedrijfsworkflows. Daar draait succes niet om abstracte intelligentie, maar om het tijdig en accuraat verwerken van gestructureerde data. Twee scenario’s maken duidelijk waar de parsing-laag het verschil maakt.

Toepassing A: De autonome supply chain

Scenario:

Een logistieke partner meldt per e-mail een vertraging in verscheping. De e-mail bevat een nieuwe aankomstdatum, container-ID en bijgewerkte havenschema’s—vaak als vrije tekst of in een PDF-bijlage.

Zonder parsing-laag:

De agent probeert de juiste informatie direct uit de e-mail te halen. Door afwijkende opmaak of onverwachte locatie van velden raakt hij de kluts kwijt, mist een update of leest een fout veld uit. Het ERP blijft ongewijzigd, de planning onjuist, en de fabriek verwacht een levering die te laat is. Het probleem blijft lang onopgemerkt en leidt tot vertraging of zelfs productiestops.

Met Parseur:

De e-mail en bijlagen worden eerst door de parsing-laag gehaald. Parseur haalt automatisch container-ID, aangepaste aankomstdatum en locatie uit de documenten, en levert gestructureerde updates. De agent kan hiermee direct aan de slag, zet logistieke processen om en past het ERP moeiteloos aan. Problemen worden opgelost vóórdat ze operationele schade veroorzaken.

Toepassing B: De “zelfrijdende” crediteurenadministratie

Scenario:

Het doel is volledige automatisering van factuurafstemming: inkomende facturen automatisch matchen met bestellingen, valideren en goedkeuren—zonder handmatige tussenkomst.

De uitdaging:

Autonome crediteurenagenten kunnen dit proces aan, mits ieder veld (artikel, hoeveelheid, prijs, btw, totaalbedrag) correct wordt uitgelezen. Zelfs kleine fouten onderbreken het proces.

Zonder betrouwbare extractie:

De agent leest een verkeerd totaal of verwisselt productomschrijvingen. De PO-match faalt, facturen worden foutief afgewezen of (nog erger) goedgekeurd met verkeerde bedragen. Menselijk ingrijpen is alsnog vaak vereist, waardoor het vertrouwen in autonomie afneemt.

Met Parseur:

Facturen worden met hoge nauwkeurigheid uitgelezen. Artikelen zijn herkenbaar, formats gestandaardiseerd en totalen betrouwbaar voordat de agent ze verwerkt. Daardoor kan de agent zelfstandig facturen koppelen aan POs, betalingen accorderen en alleen bij echte uitzonderingen menselijke review vragen.

Waarom Human-in-the-Loop (HITL) het vangnet is

De grootste uitdaging van agentische AI is niet techniek, maar vertrouwen. Bedrijven zijn terecht voorzichtig met autonome systemen die invloed hebben op geld, operatie of klantcontact. De angst voor een losgeslagen agent die oordeelt op basis van slechte data is reëel—fouten verspreiden zich immers razendsnel via geïntegreerde systemen.

Daarom is human-in-the-loop (HITL) onmisbaar.

HITL vertraagt automatisering niet, maar maakt grootschalige automatisering wél haalbaar en veilig.

Hoe past HITL in een agentische architectuur?

In een goed ingericht systeem checkt een mens niet elke actie. Er wordt alleen bij onzekerheid ingegrepen. Parseur fungeert hierbij als checkpoint voordat data een agent bereiken.

Is een document duidelijk en sluit het aan bij ingestelde extractieregels? Dan stroomt de gestructureerde data direct naar de workflow van de agent. Is het document complex, ontbreken er velden, is de lay-out afwijkend of bevat het onverwachte waarden? Dan kan Parseur automatisch een menselijk review inschakelen. Na validatie gaat de workflow verder.

Kortom:

- Agenten verwerken taken met hoge zekerheid en voorspelbaarheid

- Mensen grijpen alleen in als context of interpretatie nodig is

Het resultaat: een schaalbare automatiseringsoplossing zonder verlies van nauwkeurigheid of controle.

Waarom geeft HITL vertrouwen in plaats van te remmen?

Sommige bedrijven denken dat menselijke controle een teken van mislukking is. In werkelijkheid zorgt HITL ervoor dat agentische AI veilig werkt in complexe, onvoorspelbare praktijksituaties.

Zonder HITL moet je kiezen tussen alles volledig automatiseren (met te veel risico) of alles handmatig controleren (waardoor automatisering zinloos wordt). HITL vormt de gulden middenweg: automatiseren met vangnetten.

Dit is cruciaal voor organisaties. Auditors, compliance-teams en directies willen weten:

- Wat gebeurt er met onduidelijke data?

- Wie valideert uitzonderingen?

- Hoe voorkom je escalatie van fouten?

Een parsing-laag met HITL levert die inzichten en controle.

De bottom line

Human-in-the-loop is geen achtervang, maar cruciaal fundament. Het stelt agentische AI in staat om veilig te schalen. Door ambiguïteit te ondervangen vóórdat agenten doorautomatiseren, verandert HITL agentische projecten van experiment naar betrouwbare infrastructuur.

De infrastructuur bouwen voor 2026

We staan aan de vooravond van het tijdperk van Digitale Collega’s: autonome agenten die niet alleen adviseren of ondersteunen, maar zelfstandig kritische bedrijfsprocessen uitvoeren. De voordelen zijn enorm: sneller werken, minder fouten, en medewerkers die zich kunnen richten op waardecreatie.

Maar er geldt één harde eis: agenten zijn zo betrouwbaar als de data waarop ze opereren. AI inzetten op basis van ongestructureerde, chaotische input betekent gegarandeerde operationele risico’s, cascade aan fouten en verlies van vertrouwen. Maak daarom je dataketens gestructureerd, accuraat en controleerbaar voordat je automatiseert.

Hier biedt Parseur uitkomst. Als de essentiële “machinekamer” van agentische AI zet Parseur e-mails, PDF’s en documenten om in nauwkeurige, machine-leesbare data. Met gestructureerde input, human-in-the-loop mogelijkheden en consistente output kunnen agenten met vertrouwen opereren—en groeit jouw AI-automatisering veilig met je organisatie mee.

Laatst bijgewerkt op