能动型AI的承诺,是让系统不仅仅生成响应,还能为企业实际执行任务。然而,大多数自治代理依赖的却是如邮件、PDF、扫描文档等非结构化数据,而这些数据天生缺乏稳定性的基础。本文将深入分析为何结构化数据是能动型AI的“缺失层”,以及专有解析层如何让代理真正变得可靠。

核心观点:

- 能动型AI将AI能力从内容生成推进至实际业务执行,数据质量变得至关重要,错误成本急剧上升。

- 自治代理只有在接收到干净、结构化且已验证的数据输入时,才能安全且大规模运转,仅依赖LLM远远不能满足企业需求。

- Parseur 为能动型AI提供关键解析层,将现实世界的文档转化为可靠的结构化数据,使自治代理能够基于可验证的数据自信执行,而非依赖概率性推断。

从“对话”迈向“行动”

近几年,AI实现了飞速进步。2023和2024年,焦点仍在生成式AI——能够写邮件、总结文档、准确答疑的系统。这些工具改变了人的交互方式,但其作用仍局限于对话表层。

到了2026年,Gartner 预测,40%的企业应用将集成任务型AI代理。 创新正在迈向下一阶段:能动型AI,不仅回应,还能承担具体行动。AI代理不仅可以自动生成邮件,更可以直接发送邮件;不仅建议“下一步”,还可以执行端到端的完整流程。

这一前景极具吸引力。Kong INC数据显示,90%的企业正积极部署AI代理,79%期望在三年内实现系统性落地。 AI自动管理供应链、自动处理发票、实时更新CRM,将成为常态,无需手动交接,只需等待结果。

但这些愿景背后有现实考验。尽管新一代大型语言模型(如GPT-5、Claude)大脑越来越强大,但驱动它们的数据,还存在很大的问题。Rubrik统计,80%的企业数据依然是非结构化的,如邮件、PDF、扫描件和混乱的业务附件。当代理必须对这些混乱数据做出决策时,风险和错误会被迅速放大。

正因如此,许多能动型AI项目还停留在实验室阶段。难题不在于推理,而在于能否信任数据输入。

若想让能动型AI从内部演示跨越到企业规模生产,就必须建立专注于数据可靠性的结构层,将人类可读的信息转化为结构化事实,为AI代理提供坚实的数据基础。

什么是能动型AI?

能动型AI是能够为达成目标自主感知、推理并执行任务的系统。与传统聊天机器人不同,它非仅回应对话,而是具备完整的感知—推理—行动闭环。

实际业务中,代理不只是回答“下一步该怎么做”,而是真正自动执行任务。

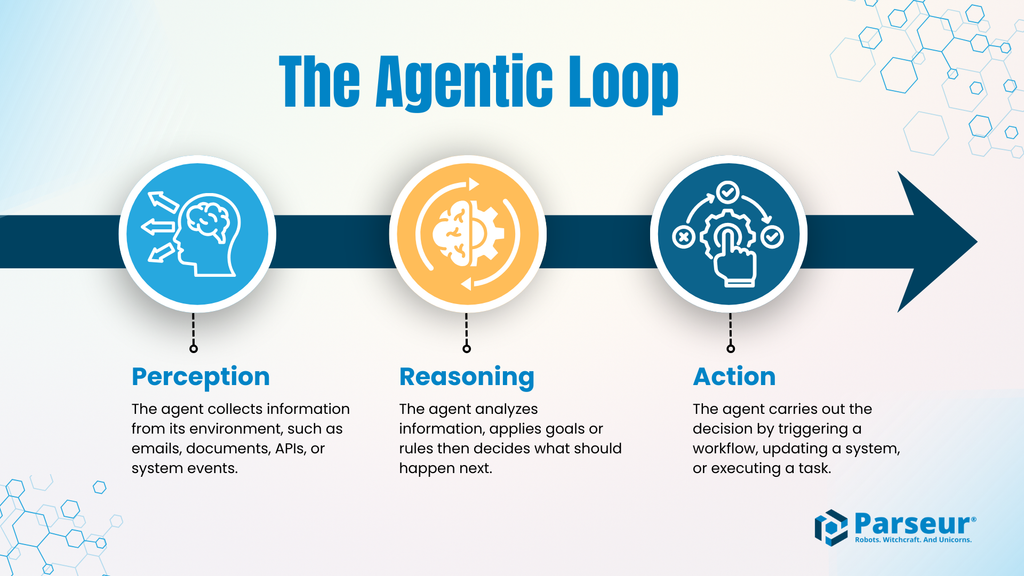

能动型环路:感知 → 推理 → 行动

大多数能动型AI以如下基本循环实时运作:

- 感知: 代理从业务环境中收集信息,比如邮件、文档、API响应或系统事件。

- 推理: 依据规则和业务目标,理解信息内容,做出判断,选择具体行动。

- 行动: 自动执行任务,比如更新系统记录、触发工作流、下发付款、推送通知等。

循环不断迭代,使代理能够几乎无需人工干预,实现持续的自动化。

为何错误风险激增?

AI从内容生成升级到自动执行时,错误带来的后果指数型增长。聊天机器人回答错问题,后果有限。但自治代理一旦读取错金额、识别错客户、处理不准确数据,就可能引发动真格的业务灾难。

常见的高风险表现包括:

- 支付了错误的发票或金额

- 下达了误单,导致库存混乱

- 维护了错误客户数据

- 基于错误数据自动触发流程

在能动型系统中,出错不仅仅是“体验问题”,而是直接造成业务失序与经济损失。

生成式AI VS. 能动型AI

| 维度 | 生成式AI | 能动型AI |

|---|---|---|

| 核心任务 | 生成内容(文本、图片、摘要等) | 完成业务任务及流程,实现具体目标 |

| 互动方式 | 响应输入,依赖人工操作 | 基本自主执行,极少人工介入 |

| 输出结果 | 文档、建议、摘要 | 具体操作、数据变更、业务活动 |

| 决策本质 | 专注内容连贯性 | 聚焦决策正确性和任务落地 |

| 错误容忍度 | 高(可人工纠正、风险有限) | 极低(错误可直接引发业务和财务风险) |

| 数据需求 | 可容忍模糊和不完整 | 必须高度结构化、准确、可溯源 |

| 风险类型 | 错误多为表象或信息级别 | 错误易扩散为企业级运营故障 |

“事实依据”陷阱

能动型AI必须在结构化的数据世界(如JSON、API、标准XML)中决策和行动,要求字段统一、格式清晰、结构可预测。现实流程中,却充斥着邮件、表格、PDF和附件等难以解析的文档。

输入类型错位,就是自治代理规模化落地的最大障碍。

在AI代理推理和执行前,需要清晰、可依赖的机器可读数据作为“事实依据”。缺失这一基础,再强大的决策逻辑也难以可靠运行。

为何仅用LLM远远不够?

很多人以为LLM“本身能读懂文档”,但一旦把原始文档理解全权交给LLM,自动化的复杂性和风险就会迅速放大。

幻觉问题

LLM是概率性模型,应对结构混乱、格式多变的信息时,容易“推测”缺失或不清楚的内容。在对话中尚可接受,到了自动操作领域,“推测”变成了操作。例如,从发票PDF、杂乱邮件提取业务要素时,幻觉频率明显上升,错误随之扩散。

成本和延时不确定性

让LLM处理整份PDF、长邮件、图片等,token用量显著增加,导致处理变慢、响应不可预测,对于对时效性和稳定性要求高的企业流程,是重大障碍。

结果不一致

业务自动化依赖数据一致性。直接用LLM解析文档,即使模板相同,字段名、顺序、类型输出也容易变化。这种微小差异足以让下游流程崩溃。

实际的风险表现

现实中,代理若依赖LLM提取的原始数据,错误很快溢出:发票金额加错、供应商混淆、数量字段填错、合同条款失真,都可能自动触发连锁操作,带来实际经济损失和信任危机 —— 不是特例,而是结构性高发。

这正是“事实依据”问题的根本:代理即便可以自动行动,但缺乏可信的结构化数据,执行力反而变成风险放大器。

缺失关键层:智能文档处理(IDP)

能动型AI的落地障碍根本不是推理或规划小问题,而是缺乏解释业务输入文档的可靠机制。这正是智能文档处理(IDP)承担的核心价值。

IDP引入专有解析层,将非结构化文档和自治代理之间的鸿沟填补起来。自治代理和LLM不再直接解读邮件PDF等原始输入,而是依赖稳定的解析层先行处理,转为结构化输出再传递给代理决策。

在能动型AI架构中,这一层如同保护阀,确保代理只基于可验证事实而非“猜想”执行任务。

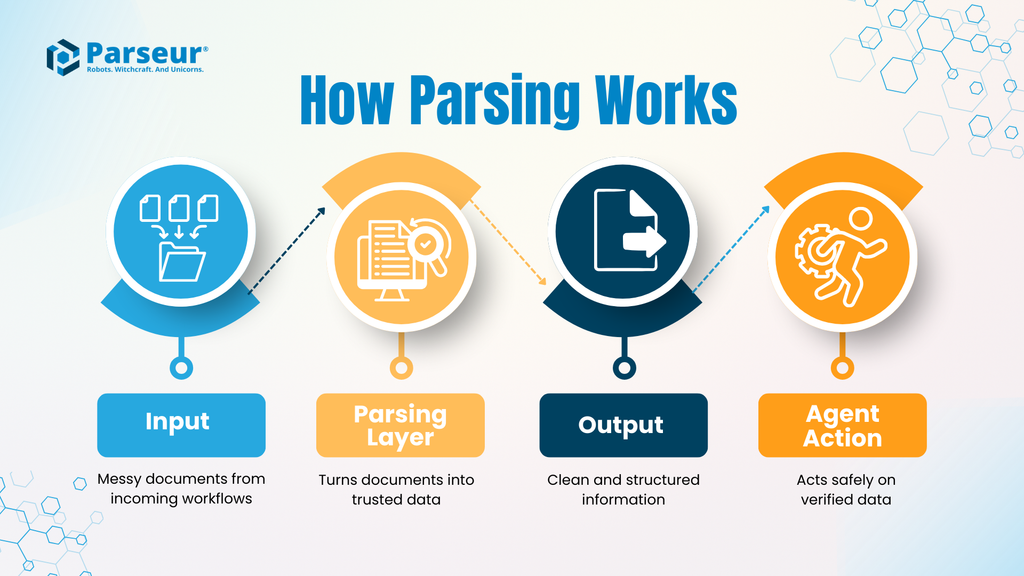

文档解析流程

典型IDP流程如下:

- 输入: 各类业务文档,如发票、提单、合同、邮件等,格式和结构高度动态。

- 解析层: IDP工具自动提取预定义字段,对日期、金额、标识符等标准化格式,并基于规则校验输出,只追求准确、一致,不做冗余“理解”。

- 输出: 干净的结构化数据(如JSON),字段命名稳定、业务schema标准。

- 代理操作: 自治代理将这些数据直接作为执行基础,大幅提升自动化可靠性。

通过将原始文档的“理解”与后续决策、行动分离,企业能够更透明、更安全地落地AI自动化,避免“一步错步步错”的风险。

为何解析层让风险可控?

无解析层时,所有输入全暴露给代理,任何文档异常带来流程风险。引入IDP,所有文档不确定性被前置“消化”,自动化流程变得安全、稳定、可大规模扩展。

举个真实例子:

Parseur 2026年报告显示,88%的企业报告因文档数据错误引起自动化失误。自治代理若错误率达88%,非但不是资产,反而成了隐患。

IDP不是让AI“更聪明”,而是让AI更加“安全”。它大幅降低LLM的幻觉,并为高风险流程带来流程合规和可追踪性,让企业真正信任自动化成果。

在能动型AI架构中,“智能”是吸引眼球的标签,而真正决定是否能规模化落地的,是数据可靠性。解析层正是使能动型AI从试验品变为企业主力装备的关键基础。

真实业务场景:为何Parseur必不可少

能动型AI只有嵌入具体业务流程才有价值。只有能稳定获取结构化、准确数据,自动化才能真正可用。下面两个业务场景,直观展现了解析层对自动化成败的直接影响。

案例A:自治供应链管理

业务场景:

运输公司用邮件通知物流延误,关键信息(如新到港时间、箱号、港口)分散在杂乱文本或附件PDF中,格式经常变化。

无解析层风险:

代理直接扫描邮件文本,根据过去数据尝试提取日期或箱号。遇到格式新变动,数据易提取出错或遗漏,下游ERP数据未被及时更新,导致生产调度出错,供应链成本飙升,问题曝光时已来不及补救。

有Parseur解析层:

所有邮件附件先通过Parseur解析,自动识别并准确结构化提取箱号、新到港日期等关键信息。ERP自动获得最新状态,生产计划据此及时调整。本可引发停工的风险事件,通过自动化流程及时规避,企业实现无缝衔接。

案例B:“无人驾驶”应付账款流程

业务场景:

企业希望自动审核发票,与采购订单自动比对,无需人工介入。

挑战本质:

AP代理可靠运转的前提,是所有明细、数量、单价、税额、总额等字段都能精确提取。哪怕一项混乱或缺失,也会导致PO匹配逻辑失败,甚至造成错误付款。

提取失败时:

代理识别错行明细或混淆产品信息,导致对账失败甚至误付款,需要大量人工纠正,流程自动化失效。

有Parseur时:

发票内容由Parseur高精度解析,明细字段格式始终如一,金额无误后再传递给AP代理。流程异常触发人工确认,但常规任务已实现自动化,大幅减少人工干预。

为什么“人在环”(HITL)是自动化安全底线

能动型AI大规模应用的最大难题不是“技术可行性”,而是决策的信任感。企业担忧自治系统直接影响资金、运营或客户体验,“失控”风险不容小觑,尤其数据出错风险极易层层传递。

这时,“人在环”机制(Human-in-the-loop,HITL)就至关重要。

HITL绝不是“落后自动化”,而是保障高质量自动化可持续运行的关键机制。

HITL在能动型架构中的作用

科学的HITL设计下,并非需要人工审批所有环节,而是只有疑问或异常时才介入。Parseur作为数据把关入口,在信息流向自治代理前即做安全阀。

- 若文档清晰规范、符合标准提取模板,结构化数据自动流入AI代理,实现全自动处理;

- 若文档存在不确定性,如缺失字段、异常值、格式混乱,Parseur自动标记,需人工审核增补后再推流。

这形成了稳定的容错边界:

- 可控、规则明确任务全部自动化

- 唯有高复杂性场景需人工兜底

最终实现了自动化的高置信度和良好扩展性。

HITL不是“减速器”,是“信任加速器”

常见误解是:“引入人在环意味着自动化失败”。实际恰恰相反,有了HITL,能动型AI才能安全、安心地在最复杂的业务环境落地。

没有HITL,企业只能选择要么冒极高风险“全自动”,要么保守地“人工监督”,难以兼得效率与安全;HITL让流程既可自动化,又可控。

对于企业,合规、风险和业务负责人都关心:

- 非标数据怎么办?

- 异常审批归谁?

- 自动化链路如何止损?

有了解析层+HITL,这些问题都迎刃而解。

结语:HITL是能动型AI规模化的保障

“人在环”决不是权宜之计,而是能动型AI真正大规模服务企业的安全底线。用HITL在行动前就有效隔离异常、捕捉歧义,能让AI代理彻底从演示品变为企业级基础设施。

展望2026:打造智能数据基础设施

我们正步入数字同事时代——AI代理不仅能建议,还能自动落地关键业务操作。其价值在于降本提效、减轻人力、提升决策品质。

前提只有一个:代理的可靠性高度依赖其数据源。 若AI基于杂乱、非结构化数据自主运作,只会放大风险、加剧错误、削弱信任。因此,企业必须构建完善数据管道,确保输入结构合理、清晰可控。

Parseur正是保障这一闭环的核心角色。作为能动型AI架构的“动力室”,Parseur将邮件、PDF等各类业务文档精准转化为标准、机器可读的数据。结构化输入、HITL审查和高一致性输出,赋能自治代理放心执行,将AI愿景转化为安全可扩展的现实运营。[call_to_action:zh-CN]

最后更新于