A IA agente representa sistemas que, além de gerar respostas, realizam ações concretas para impulsionar resultados de negócios. O desafio é que a maior parte dos agentes autônomos depende de dados não estruturados, como e-mails, PDFs e documentos digitalizados, que não conseguem interpretar de forma confiável. Este artigo analisa por que dados estruturados são a camada fundamental ausente na IA agente e como a introdução de uma etapa dedicada de parsing transforma agentes em sistemas realmente confiáveis.

Principais Conclusões:

- A IA agente desloca o foco da IA generativa de produção de texto para execução de ações diretas no negócio, elevando significativamente o impacto dos erros derivados de dados inconsistentes.

- Agentes autônomos requerem dados limpos, estruturados e validados para operar de forma segura em larga escala. Os modelos de linguagem sozinhos não dão conta desse desafio.

- O Parseur fornece a camada essencial de parsing, convertendo documentos do dia a dia em dados estruturados e confiáveis, o que permite que os agentes ajam com confiança em seus processos.

Da Conversa à Ação

Nos últimos anos, a IA avançou rapidamente. Em 2023 e 2024, a atenção esteve voltada, principalmente, à IA generativa: sistemas capazes de criar e-mails, resumir textos e responder perguntas de maneira natural. Essas soluções mudaram a interação com softwares, mas, na prática, tinham seus limites restritos à “conversa”.

Agora, em 2026, o cenário mudou, com Gartner prevendo que 40% dos aplicativos corporativos terão agentes de IA especializados. A evolução é a IA agente: sistemas criados para agir, não apenas responder. Um agente pode, por exemplo, enviar e-mails por você ou executar tarefas complexas inteiramente sozinho.

O potencial é claro. Segundo Kong INC, 90% das empresas já estão adotando a IA agente, com 79% esperando escala total em até três anos. Imagine uma IA gerenciando etapas logísticas, processando e pagando faturas, ou atualizando CRM’s automaticamente conforme novas informações chegam. Sem painéis de controle, sem processos manuais — apenas resultados automáticos.

No entanto, há desafios por trás desse entusiasmo. O “cérebro” dos agentes, modelos como GPT-5 ou Claude, tornam-se poderosos, mas o “combustível” — os dados — geralmente é instável. De acordo com Rubrik, 80% dos dados empresariais ainda são não estruturados: e-mails, PDFs, digitalizações e anexos sem consistência. Quando agentes precisam agir a partir desse caos, erros rapidamente se tornam críticos.

Por isso, muitos projetos de IA agente não avançam. Não falta capacidade de raciocínio, mas sim confiança nas informações de entrada.

Para a IA agente ser de fato uma infraestrutura confiável, é indispensável uma camada dedicada de confiabilidade de dados, transformando informações legíveis apenas por humanos em dados estruturados e prontos para ação autônoma.

O que é IA Agente?

IA agente consiste em sistemas capazes de operar de forma autônoma rumo a objetivos. Ao contrário dos chatbots, que simplesmente respondem a comandos, agentes são projetados para perceber informações, raciocinar e agir sem necessidade de supervisão constante.

Ou seja, agentes não apenas respondem a “O que devo fazer agora?”, mas tomam a decisão e executam a ação por conta própria.

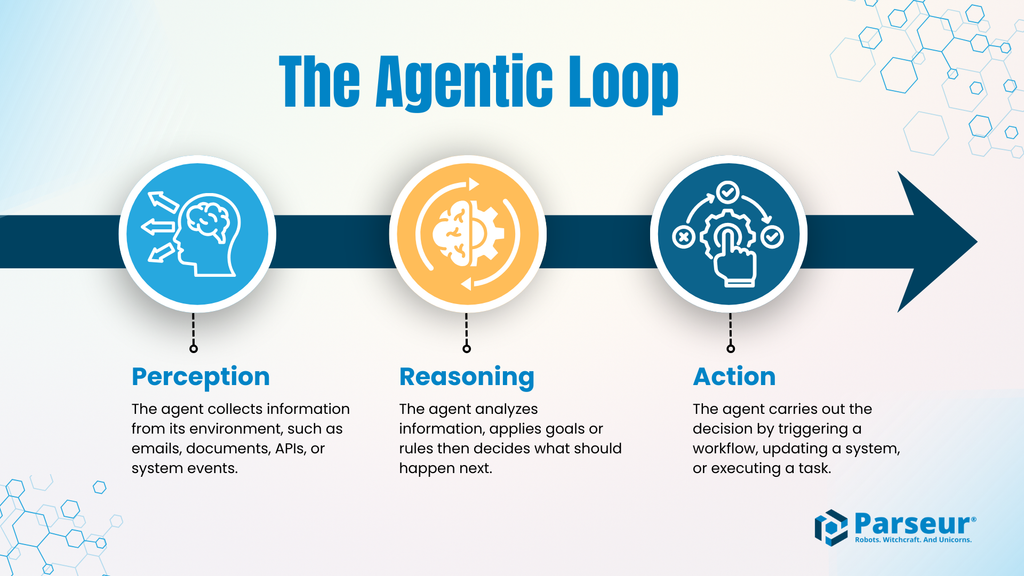

O Ciclo de um Agente: Percepção → Raciocínio → Ação

A maioria dos sistemas de IA agente segue um ciclo fundamental:

- Percepção: Recebe dados do ambiente, como e-mails, documentos, APIs ou eventos.

- Raciocínio: Interpreta as informações, aplica regras/objetivos e decide o próximo passo.

- Ação: Realiza uma tarefa, como atualizar registros, iniciar fluxos de trabalho, pagar faturas ou acionar sistemas.

Esse ciclo se repete, mantendo o agente ativo com mínima supervisão, pronto para responder a novas informações e tomar ações contínuas.

Por que os riscos aumentam?

A mudança da geração de respostas para a execução de ações reais eleva drasticamente o custo de eventuais falhas. Um erro de digitação em um chatbot é inofensivo; um agente autônomo lendo um dado incorreto, categorizando errado um cliente ou processando informações incompletas pode gerar grandes impactos operacionais.

Exemplos:

- Pagamento incorreto de faturas

- Pedido de estoque em volume errado

- Atualização de informações erradas de clientes

- Disparo de processos com base em informações equivocadas

Nestes cenários, erros não são apenas inconvenientes — eles comprometem processos inteiros.

IA Generativa vs. IA Agente

| Aspecto | IA Generativa | IA Agente |

|---|---|---|

| Propósito | Geração de textos, imagens, resumos | Execução autônoma de tarefas para alcançar metas |

| Interação | Responde comandos sob demanda | Atua de modo autônomo, mínima intervenção humana |

| Resultados | Rascunhos, explicações, sugestões | Ações no sistema, operações, transações, notificações |

| Decisão | Priorização de respostas coerentes | Priorização da escolha e execução de ações |

| Tolerância ao erro | Relativamente alta; erros são simples de corrigir | Baixa; erros impactam operações e finanças |

| Dados necessários | Pode usar informações incompletas/ambíguas | É vital que sejam dados válidos e estruturados |

| Risco | Erros são cosméticos ou informativos | Erros podem disparar falhas sistêmicas e financeiras |

O Desafio do Ground Truth

Sistemas de IA agente exigem dados estruturados, como JSON ou XML, com campos e padrões bem definidos. Já as empresas recebem informações nos formatos mais diversos: e-mails, PDFs, planilhas, digitalizações e anexos gerados por pessoas.

Essa desconexão é o principal obstáculo para agentes autônomos atuarem com confiança.

Antes de um agente decidir e agir, ele precisa de uma “base de verdade”, com dados claros, auditáveis e prontos para uso. Sem essa base, até agentes sofisticados ficam sujeitos a decisões erradas.

Por Que LLMs Não São Suficientes?

Apostar que grandes modelos de linguagem (LLMs) decifram qualquer documento automatiza, na prática, apenas o risco. Veja os principais limites.

Alucinações

Os LLMs operam por probabilidade. Quando faltam dados, são confusos ou mal-formatados, acabam “imaginando” respostas. Em chats, isso tem pouco impacto. Para agentes, suposições geram ações. Estudos demonstram que taxas de alucinação aumentam quando se tenta extrair dados estruturados de entradas desordenadas ou longas.

Custo e latência

Analisar PDFs completos ou cadeias longas de e-mails demanda muito processamento e consumo de tokens. Isso gera tempos imprevisíveis, custos elevados e compromete a automação em cenários de alto volume ou tempo real.

Inconsistência

Automação depende de confiabilidade. Um agente precisa receber estruturas idênticas e tipos de dado previsíveis a cada execução. LLMs podem apresentar variações significativas entre extrações até de documentos similares, quebrando rotinas automatizadas.

Como as falhas aparecem

Quando agentes baseiam suas ações em extrações incertas, os erros se manifestam rápido e de forma crítica.

Por exemplo: se um agente extrai incorretamente o nome do fornecedor de uma fatura, pode realizar pagamento para a pessoa ou conta errada. Se erra na quantidade num pedido, gera falta de estoque. Se interpreta mal uma cláusula em contrato, aplica condições equivocadas a diversos clientes.

Essas falhas não isolam. Em ambientes automatizados, erros “nascem” em um ponto e se propagam rapidamente a outros sistemas, desencadeando novas ações problemáticas.

O desafio do ground truth: agentes prontos para agir, mas, sem dados estruturados confiáveis, atuam “às cegas”.

A Camada Ausente: Processamento Inteligente de Documentos (IDP)

O entrave da IA agente, na prática, não reside na falta de raciocínio — mas na ausência de métodos confiáveis de interpretação das informações recebidas. É aqui que entra o Processamento Inteligente de Documentos (IDP).

O IDP funciona como uma camada de parsing posicionada entre os documentos, muitas vezes caóticos, produzidos por humanos e os agentes autônomos de IA. Em vez de delegar a interpretação de entradas brutas ao agente ou ao LLM, essa camada pré-processa os dados, tornando-os estruturados e confiáveis.

Dentro de uma arquitetura de IA agente, essa camada é o estabilizador do sistema, assegurando ações sempre fundamentadas em fatos validados.

Como funciona o parsing de documentos?

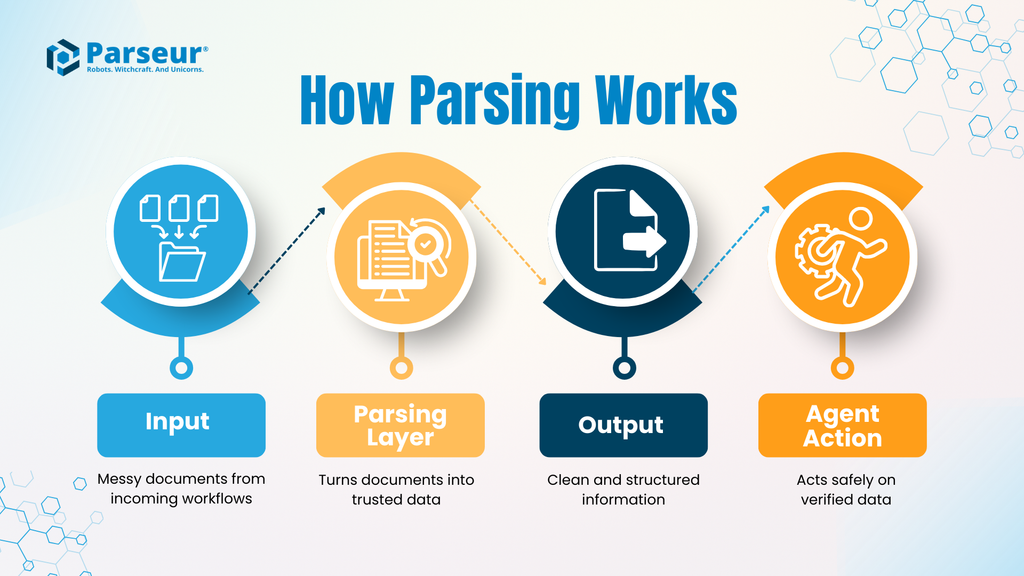

O fluxo IDP típico é:

- Entrada: Documentos como notas fiscais, manifestos de transporte, contratos ou e-mails, com formatos e estruturas variáveis.

- Parsing: Uma solução de IDP extrai campos relevantes, padroniza formatos (datas, moedas, identificadores) e valida os dados com base em regras do negócio. O foco é garantir precisão e replicabilidade, e não interpretação subjetiva.

- Saída: Dados estruturados e limpos, usualmente em JSON e seguindo um padrão previsível.

- Ação do Agente: O agente consome esses dados com confiança, garantindo que os insumos estão corretos e completos antes da automação.

Separar a análise dos documentos da ação em si reduz riscos e amplia a clareza sobre o processo. O agente, assim, atua sempre com base em entradas validadas.

Por que essa camada muda o perfil de risco?

Sem parsing dedicado, agentes ficam vulneráveis a ambiguidades e falhas presentes nos dados do dia a dia. Cada exceção é um risco. O IDP absorve essa incerteza antes de os dados entrarem na automação.

Esse ajuste é fundamental quando escalamos. Por exemplo:

Segundo a pesquisa Parseur de 2026, 88% das empresas reportam erros em extração de dados de documentos. Um agente autônomo com esse índice de erro transforma-se em risco e não em valor.

O papel do IDP não é deixar sistemas mais “inteligentes” e sim mais confiáveis. Reduz as chances de falhas, amplia a transparência e viabiliza a automação sem supervisão manual constante.

A inteligência faz do agente uma ferramenta poderosa — mas é a confiabilidade dos dados que permite a autonomia. A camada de parsing é o elo que converte agentes experimentais em soluções corporativas robustas.

Casos Práticos: Onde Agentes Dependem do Parseur

A IA agente só entrega valor verdadeiro quando integrada a fluxos reais de negócios. Nesse contexto, o sucesso depende da entrega de dados corretos, no momento certo, ao agente autônomo. Veja dois exemplos onde a camada de parsing marca a diferença.

Caso A: Fluxo de cadeia de suprimentos autônoma

Cenário:

Uma notificação de atraso de entrega chega por e-mail do fornecedor. A mensagem traz informações como data de chegada, ID do contêiner e atualização do agendamento portuário, seja no corpo do texto ou em anexo PDF.

Sem camada de parsing:

O agente tenta ler direto do e-mail, porém, formatos variados, textos ambíguos e dados fora do padrão causam erros de extração ou perda de informações. O resultado: sistemas internos desatualizados, decisões operacionais defasadas e impactos relevantes na cadeia de suprimentos.

Com Parseur:

O e-mail e anexos passam primeiro pela camada de parsing. Parseur utiliza IA para extrair dados essenciais, como IDs e datas, reorganizando-os em uma atualização estruturada. O agente age em tempo real, redireciona pedidos, atualiza sistemas e ajusta cronogramas preventivamente.

Caso B: Contas a pagar autônomas

Cenário:

Automatização da conferência de faturas: as faturas precisam ser conferidas, conciliadas e aprovadas sem intervenção manual.

Desafio:

Agentes podem executar esse fluxo — mas só se detalhes como itens, quantidades, preços, impostos e totais forem extraídos corretamente. Imprecisões rompem a lógica ou levam a pagamentos indevidos.

Sem extração confiável:

Se o agente lê errado um valor, pareamentos falham, faturas são rejeitadas ou aprovadas com valores incorretos, exigindo reprocessamento manual e prejudicando a confiança na automação.

Com Parseur:

A extração é precisa, itens são capturados de forma uniforme, valores validados previamente. O agente pode executar pareamentos, aprovar pagamentos, e só casos realmente excepcionais exigem atuação humana.

Por Que Human-in-the-Loop (HITL) É a Rede de Segurança

Um dos maiores desafios para adoção da IA agente é a confiança. Empresas têm receio de delegar decisões financeiras e operacionais críticas a sistemas totalmente autônomos, sabendo que erros de origem nos dados podem se espalhar rapidamente.

É nesse contexto que o design human-in-the-loop (HITL) se torna indispensável.

O HITL não impede nem atrasa a automação — ele a torna viável e segura.

Como o HITL integra-se à arquitetura de IA agente

Em projetos bem planejados, humanos só revisam o que realmente exige atenção. O Parseur cumpre o papel de checkpoint, identificando incerteza antes dos dados chegarem ao agente.

Quando a extração é clara e o documento cumpre padrões conhecidos, o dado segue para automação. Quando há dúvida, falta de campo ou valores inesperados, o Parseur sinaliza para um analista validar. Só depois a informação segue para ação autônoma.

Com isso:

- Agentes se concentram em tarefas repetitivas e confiáveis

- Humanos avaliam exceções e casos ambíguos

Assim, empresas escalam automação sem abrir mão da segurança.

Por que HITL gera mais confiança

Há quem pense que a necessidade de revisão humana é sinal de automação incompleta. Na prática, o HITL é o que permite usar agentes autônomos de forma segura.

Sem HITL, resta escolher entre automação total (mas arriscada) ou validação manual completa (com perda de eficiência). O HITL representa o equilíbrio: automação com critérios claros de intervenção.

Do ponto de vista empresarial, isso é fundamental. Compliance, auditoria e liderança precisam saber:

- O que ocorre com dados duvidosos?

- Quem aprova exceções?

- Como se evita a propagação de erros?

Uma camada de parsing robusta com HITL responde a esses pontos e amplia a confiança.

Conclusão

Human-in-the-loop é a salvaguarda indispensável para IA agente em escala. Ao filtrar dúvidas antes da automação acontecer, o HITL garante sistemas confiáveis — protegendo sua empresa das consequências de erros e tornando possível adotar IA agente em processos essenciais.

Preparando a Infraestrutura para 2026

Estamos diante da era dos Cofrentes Digitais: agentes autônomos que não apenas sugerem, mas executam, tornando fluxos essenciais cada vez mais automáticos. O potencial é imenso — mais agilidade, menos falhas, pessoas focadas em decisões estratégicas.

Mas há uma condição: agentes autônomos só entregam valor com dados confiáveis. Implantar IA agente para ações sem uma base sólida e estruturada é aumentar riscos e comprometer operações.

É neste ponto que o Parseur faz a diferença. Como a força propulsora da IA agente, o Parseur transforma e-mails, PDFs e documentos em dados precisos, estruturados e auditáveis. Com entradas validadas e fluxos com revisão human-in-the-loop, sua empresa pode confiar na automação e transformar possibilidades em resultados escaláveis e sustentáveis.

Última atualização em