求人投稿はただの一覧ではありません。それは採用意欲・会社の成長・予算のシグナルです。受信箱にやって来るフォーマットもバラバラな求人アラートメールを手作業で整理する代わりに、自動で構造化データとしてCRMやトラッキングシステムに転送できます。これにより、手作業だった「情報収集」を自動化し、チャンスを体系的にキャッチできます。

ポイントまとめ

- 求人情報は成長や予算・採用の意思表示ですが、手作業での追跡では規模を拡大できません

- Webスクレイピングは脆弱で保守が大変ですが、公式メールからの抽出はずっと安定したアプローチです

- Parseurは求人アラートメールから構造化データを自動抽出し、CRM・データベース・各種ツールに即時転送。採用シグナルを行動可能なパイプライン化します

採用ビジネスにおける求人投稿

採用エージェンシーやB2B営業チームにとって、新たな求人投稿は「案件」ではなく「シグナル」です。

たとえば**VP of Sales(営業トップ)**の募集、マーケティング組織の拡大、エンジニア複数名の採用... それはほぼ確実に成長期であり、予算が動きます。新しいツール・新しいベンダー・新しいパートナー。つまり「購買意欲」が高いタイミングです。

**ヘッドハンター・人材紹介会社・B2B SDR(インサイドセールス)**にとって求人投稿は見過ごされたリードです。

ところが多くのチームは今もLinkedInやIndeed、Googleの求人アラートを手動でチェックしています。メールを1通ごとに読んで会社情報をスプレッドシートにコピーし、CRMを手打ちで更新... この作業は反復的でバラつきがあり、規模拡大に適しません。

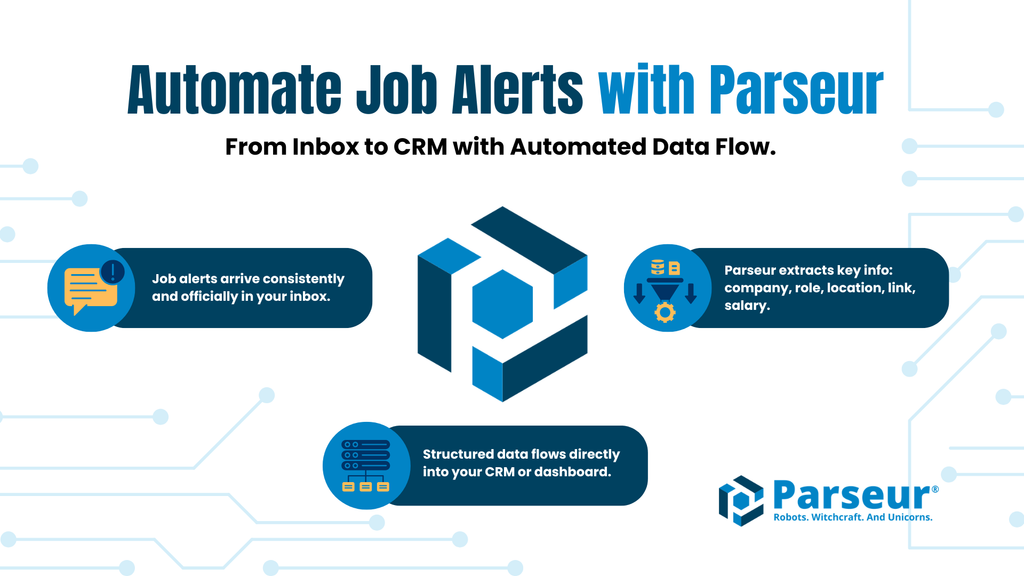

Parseurがこのワークフローを変えます。アラートメールを手動チェックする代わりに、自動転送でParseurに届ければOK。Parseurが会社名・求人タイトル・勤務地・部署・掲載日などをリアルタイムに構造化データとして抽出し、案件データベースに即変換。コピー&ペースト不要。チャンスの見落としもありません。アウトリーチのための「きれいなデータ」が即時に整います。

求人アラートメールの自動解析

求人ボードを目視で追いかけるには限界があります。よりスマートなのは、求人アラートで自動収集し、Parseurで自動データ化するアプローチです。

Parseurは大手求人アラートメールの構造を最初から理解しています。最初から複雑なルール作成やテンプレート構築不要でスタートできます。

実際の使い方

Google JobsやIndeedなどで、自分のターゲティング戦略に合致したキーワードで求人アラートを設定します。例:

- "Hiring CTO"

- "VP of Sales"

- "Head of Marketing"

- "Series A startup hiring"

そのアラートメールが自動でParseurメールボックスに届くよう、転送ルールを設定するだけです。

得られるデータ

メール受信と同時に、Parseurが自動的に次の主な項目を抽出します:

- Company_Name(会社名)

- Job_Title(求人タイトル)

- Location(勤務地)

- Posting_URL(投稿URL)

その結果、受信箱やスプレッドシートでアラートを一件ずつ確認する必要なし。構造化され、検索も可能な「積極採用企業リスト」が即時に生成されます。ヘッドハンター・人材エージェンシー・SDRなどの方にとって、これがシームレスで自動なリード獲得チャネルに変わります。

戦略的ユースケース:求人アラートを収益機会に

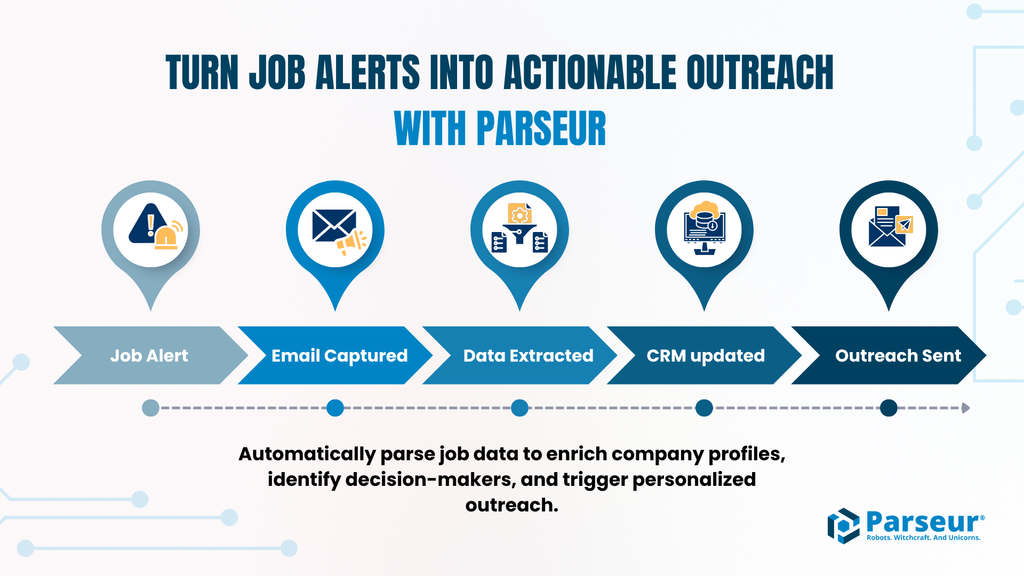

求人メール解析の自動化は単なる時間短縮ではありません。採用意欲(=見込み顧客)を「営業チャンス」に変えるための仕組みづくりです。

求人投稿は偶発的なイベントではありません。「人と予算・方向性の必要性」を公然と宣言しています。これを構造化・ルーティングすれば、売上発火点になるのです。

人材エージェンシーのリード獲得

人材紹介会社にとって求人投稿は「温度の高いリード」です。"Senior Backend Engineer" や "VP of Sales" の求人が出たとき、それが即座に「採用ニーズの表明」だと分かります。アクセスが早ければ早いほど、案件獲得率が上がります。

Parseurなら:

- 求人アラートメールが自動で解析され

- 会社名が即座に抽出

- データがApollo.ioやClearbitなどのエンリッチメントツールに連携

- 役員や採用担当の連絡先データが即付与

つまりリサーチに時間をかけずにエージェントはすぐに候補者提案を始められます。人材領域では「スピード」が命。自動化で「求人投稿→商談アプローチ」のタイムラグが消えます。

競合インテリジェンスにも

求人情報は「戦略の鏡」です。たとえば、同業他社が新たに5人のアカウントマネージャーを某地域で募れば「事業拡大」のサイン。AIエンジニア募集は「製品戦略の転換」かもしれません。

Parseurでは:

- 特定の競合会社名でアラートを設定

- 役職名や勤務地を自動抽出

- Slackチャンネルや社内ダッシュボードに即連携

経営陣は求人ボードを監視せずとも競合の人員増減を継続的に把握できます。情報収集というより、「業界知見ストリーム」に早変わりします。

B2Bソフトウェア営業でのターゲティング

B2Bセールスでは採用トレンドが購買意欲そのものです。HR向けソフトを売るなら"HR Director"や"People Ops Manager"の求人はインフラ投資の合図。営業支援ソフト対象ならSDR複数名募集=予算拡大の兆候です。

Parseurなら:

- 関連職種で採用する会社だけを抽出

- それらのリードをHubSpotやCRMに自動投入

- 優先順位の高いアウトリーチシーケンスに組み込み

勘でコールドアプローチするのではなく、「ターゲット部門を積極拡大している企業群」だけに集中することができます。つまり構造化データで「意欲ベース営業」が可能です。

パース解析がWebスクレイピングに勝る理由

求人データ自動収集を検討すると、多くのチームはまず「Webスクレイピング」を連想します。表面上は合理的に見えますが、実際には持続可能な方法ではありません。

Webスクレイピングの限界

主要な求人サイトをスクレイピングする場合、現実には以下の課題があります:

- サイトの利用規約違反となる場合が多い

- IPアドレスブロック回避のためプロキシが必要

- 少しのレイアウト修正でも即座に処理が停止

- CAPTCHAやbot検知で容易に停止

- 保守にはエンジニア常駐が必要

HTMLのclass名やdiv位置が少し変わっただけで、スクリプト全体が止まる… 人材チームやSDR、コンサル会社がクローラ保守に手間と費用をかける意味はありません。本来アウトリーチや案件に集中したいのに、コードの修正で時間を奪われてしまいます。

Parseur流:公式アラートメールをパース

主要な求人ボードはどこも「構造化済み求人アラートメール」を送っています。それは公式で、安定したフォーマットで、信頼性のために設計され、直接受信箱に届きます。Webサイトをスクレイピングするより、メールパースのほうが法的にも技術的にも安全確実です。

Parseurを使えば:

- 求人アラートメールが自動でParseurメールボックスに到達

- 会社名・役職名・勤務地・URL・給与など主要項目を抽出

- 構造化データとしてCRMや業務ツール・ダッシュボードに即連携

プロキシ不要・CAPTCHAなし・スクリプト保守も不要・ブロックリスクゼロ。公式通知のパイプラインをそのまま利用するので構造的に安定しています。

サステナブルな自動化戦略へ

Webスクレイピングはプラットフォームの表面構造を逆解析する手法ですが、メール解析は最初から組織に届けられる構造化データをそのまま活かす手法です。

長期信頼性・低保守・規約準拠を重視するチームには、求人アラートメールの解析こそ持続的で堅牢な「シグナル自動収集基盤」となります。複雑さを減らす、それが自動化本来の目的です。

採用スタックとの統合

求人アラートを自動化する本当の力は、データが営業や採用の全スタックへ即時流れるときに本領発揮されます。ParseurはCRMや社内DBの「置き換え」ではなく「データ供給レイヤー」です。

求人メールがパース解析されて構造化データとなれば、そのまま現行ツール群へインテークできます。これで受動的な通知を「自動で流れ込む案件パイプライン」に変えられます。

Airtable: 業界全体の「採用動向DB」に

受信トレイで埋もれる求人メールも、ParseurならそのままAirtableへ自動送信可能。これにより:

- 業界に特化した「採用企業データベース」がリアルタイム・検索可能に

- 職種・部署・エリアでフィルタ

- 採用速度の経年比較

- ICP基準で会社にタグ付け

- 拡大の兆しを監視・可視化

シンプルな表計算以上の価値。「成長企業DB」として自社独自のインテリジェンス資産となります。

SalesforceやBullhorn: 求人情報から即アカウント作成

多くのB2Bチームでは、求人アラート自体が眠れるパイプラインです。ParseurをSalesforceやBullhornに連携すると:

- 条件を満たす求人投稿があれば「新規アカウント」を自動作成

- 営業担当を自動アサイン

- 求人タイトル・投稿URLをレコードに紐付け

- タスク・アクションの自動生成

案件登録を手作業でせずとも、「採用意向が表れた瞬間」にCRMが自動で反応します。

エンリッチメント・アウトリーチツール連携

Parseurは Apollo.io、Clearbit、HubSpot、Outreach、Salesloftとも連携できます。これにより経営者や意思決定層を即特定、パーソナライズしたアウトバウンド施策展開、採用動向でアカウントの優先度付けなどが自動化できます。

「求人投稿→メール受信→解析→CRM自動反映→営業自動トリガ」がシームレスにつながります。

アラートから商談パイプラインへ

連携のない求人通知は「ノイズ」。連携できれば検索可能な構造データとなり、営業・リクルーティング全体の「意思決定信号」に。Parseurはそのインテークレイヤーとして、非構造なメールをきれいなデータに変換し、全体パイプラインを動かします。ただ自動化するだけでなく、案件化スピード最大化がゴールです。

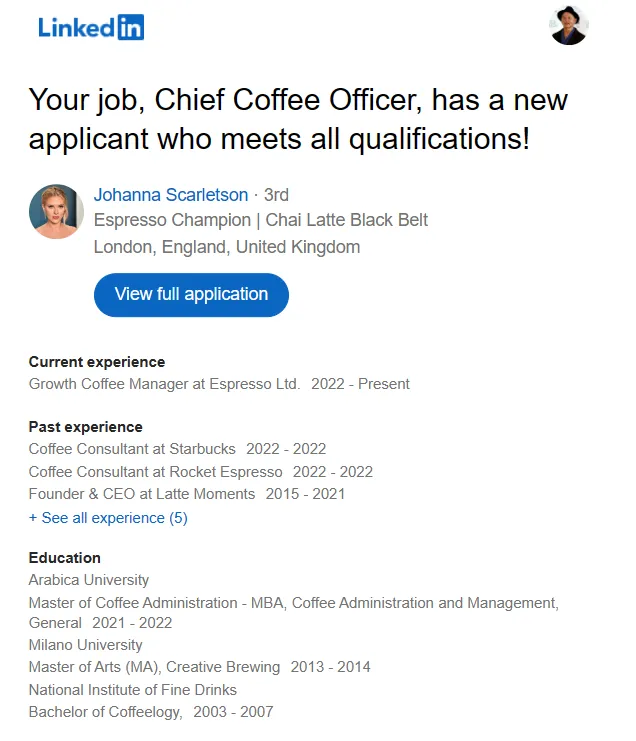

求人アラートの受信箱に埋もれる前に:求職メールも自動で整理

求職者の方も、Indeed、Glassdoor、LinkedIn Jobsなど複数の求人サイトに登録したり、Google検索の求人通知を受け取ったりしていませんか?

しばらくすると受信箱がこういった求人メールで溢れます。その中から応募先を選び、必要な情報を毎回転記するのは非常に手間がかかります。

Parseurはメールパーサーとして、こうした手作業をすべて自動化。わずか数秒で求人メールから応募に必要な情報だけを抽出できます。

Parseurを使う理由は?

求職活動はそもそも集中力とエネルギー、継続が不可欠です。そこに毎日メール整理や転記作業が加わると負担が跳ね上がります。Parseurなら反復作業を丸ごと排除できます。

求職ユーザーが選ぶ理由:

- ノーコード式。 専門知識一切不要。完全ビジュアルな設定画面ですぐ使えます。

- メール自動化特化。 Parseurはメール(求人アラート含む)内の構造化データ抽出のための設計です。

- 完全自動処理。 Parseurメールボックスに転送された瞬間、わずか数秒でデータ抽出が完了します。

- 柔軟な書き出し。 抽出データをExcelまたはGoogleスプレッドシート、その他ツールにそのままエクスポートできます。

- リアルタイム連携。 Zapier、Make、API経由でAirtableやNotion・CRMなどすべてのアプリへ自動連携。

受信メールを1件ずつ吟味して転記する作業から卒業し、「自動更新の応募管理表」ができあがります。

ステップ1: Parseurに登録し、専用メールボックスを作成

毎月のメール上限内で、すべての機能を無料プランのまま利用できます。

ステップ2: 求人アラートメールをParseur宛に転送

求人アラートとして受信しているメールをParseurメールボックスアドレスへ転送しましょう。

Parseurには主要な求人メールのテンプレートが初めから組み込まれているため、多くの場合自動で処理されます。もし未知の求人プラットフォームであっても、自分でテンプレートを簡単に作成して対応フィールドを教えることができます。

Parseurが簡単に抜き出せる情報例:

- 求人タイトル・役職名

- 勤務地

- 採用企業名

- 開始日

- 求人掲載元(Google Jobs, Indeedなど)

より確実かつ安定した運用のためには自動転送ルールの設定をおすすめします。

ステップ3: 求人検索データをエクスポート

解析完了後は、すぐにデータを書き出せます。「エクスポート」タブから抽出データの送信先を選ぶだけ:

- Microsoft ExcelまたはCSVとしてダウンロード

- Googleスプレッドシートに自動転送

- Zapier、Power Automate、Webhookで他ツールに自動連携

複数の求人アラート購読で応募先選びが煩雑になりがちですが、Parseurを使った自動フローで、応募先特定にかかる手間を劇的に削減。その分、本質的な活動に時間が割けるようになります。

最終更新日