Einzelmodell-KI bei der Dokumentenverarbeitung stößt bei komplexen Dokumenten an ihre Grenzen, während strukturierte Parsing-Pipelines Genauigkeit, Konsistenz und Skalierbarkeit ermöglichen. So profitieren Unternehmen von einer Automatisierung, die zuverlässig über kontrollierte Demos hinaus funktioniert.

Wichtigste Erkenntnisse:

- Einzelmodell-KI versagt häufig bei komplexen, variablen Dokumenten – das führt zu Fehlern und Streuung im Workflow.

- Synthetische Parsing-Pipelines sorgen durch die separate Verarbeitung einzelner Dokumentenelemente für mehr Genauigkeit, Geschwindigkeit und Konsistenz.

- Parseur setzt bereits seit 2016 auf Multi-Modell-Synthetik-Pipelines für zuverlässige, skalierbare Dokumentenautomatisierung.

Die Dokumentenautomatisierung entwickelt sich weiter. Die Annahme, ein einzelnes KI-Modell könne die gesamte KI-Dokumentenverarbeitung abdecken, erweist sich zunehmend als Fehleinschätzung – besonders für Unternehmen, die mit Rechnungen, Verträgen und vielen operativen Dokumenten arbeiten.

Für Teams, die sich auf Zonale OCR und KI-gestützte Dokumentenverarbeitung verlassen, zeigt sich dabei eine wesentliche Realität: Genauigkeit und Skalierbarkeit hängen davon ab, dass Dokumente konsequent in strukturierte Daten umgewandelt werden. Ohne diese Grundlage tun sich auch modernste Modelle schwer, in produktiven Workflows verlässliche Ergebnisse bereitzustellen.

Das Problem mit Einzelmodell-Dokumentenverarbeitung

Jahrelang folgte die Dokumentenverarbeitung einem einfachen Prinzip: Ein einzelnes KI- oder OCR-Modell extrahiert alle Inhalte eines Dokuments. In der Theorie klingt das praktisch, in der Realität zeigt es schnell seine Schwächen.

Das Hauptproblem ist klar: Dokumente sind vielfältig. Eine einzige Rechnung kann gedruckten Text (z. B. Lieferant, Rechnungsnummer), Tabellen (Positionen, Mengen, Preise, Summen), handschriftliche Anmerkungen (Lieferhinweise), Logos und Stempel (Firmenbranding, Freigabesignaturen) sowie Barcodes (Sendungsnummern) enthalten.

Jedes dieser Elemente verhält sich unterschiedlich. Manche sind strukturiert und vorhersehbar, andere extrem variabel. Werden sie alle gleich behandelt, entstehen Lücken bei der Datenerfassung.

Hier geraten Einzelmodell-Ansätze an ihre Grenzen. Sie müssen das gesamte Dokument einheitlich interpretieren, obwohl die einzelnen Bereiche eigentlich eine spezialisierte Behandlung erfordern. Das Resultat ist nicht nur geringere Genauigkeit – es ist Inkonstanz. Felder werden übersehen, Formate ändern sich unerwartet, und die Ergebnisse schwanken von Dokument zu Dokument.

Eine globale Umfrage von Yahoo Finance ergab, dass 62,8 % der Unternehmen häufig oder gelegentlich Qualitätsprobleme mit Dokumenten haben. Datenqualität bleibt das größte Hindernis bei der Skalierung von KI. Was auf den ersten Blick wie ein isolierter Extraktionsfehler erscheint, kann sich rasch zu einem kritischen Workflow-Problem auswachsen, wenn diese Daten in Buchhaltungs-, CRM- oder operative Systeme eingespeist werden.

Bei geringem Volumen lassen sich solche Probleme oftmals noch manuell beheben. Doch bei wachsender Dokumentenflut, gerade in Spitzenzeiten, lassen sich die Lücken nicht mehr auffangen. Ausnahmen summieren sich, Nacharbeit steigt – und die Automatisierung muss ständig überwacht werden, damit sie überhaupt läuft.

Deshalb scheitern viele Projekte zur Dokumentenautomatisierung: Nicht, weil die Technologie zu schwach wäre, sondern weil sie sich unter realen Bedingungen als nicht verlässlich genug erweist. Forrester berichtet, dass mehr als 60 % der KI-Piloten wegen Datenqualitäts- und Integrationsproblemen nie den produktiven Betrieb erreichen.

Teams, die für ihre täglichen Abläufe auf Dokumente angewiesen sind, geht es nicht nur um Auslese. Sie brauchen Konsistenz, Vorhersagbarkeit und die Gewissheit, dass Workflows auch bei Formatänderungen und Wachstum weiterhin funktionieren.

Was ist synthetisches Parsen?

Synthetisches Parsen ist ein Ansatz für die Dokumentenverarbeitung, bei dem ein Dokument in kleinere Komponenten zerlegt und jede separat verarbeitet wird, anstatt das Dokument als Ganzes zu behandeln.

Traditionelle Systeme versuchen, alle Inhalte auf einmal zu extrahieren. Synthetisches Parsen geht einen anderen Weg: Es identifiziert Einzelelemente wie Textfelder, Tabellen oder visuelle Komponenten und verarbeitet jedes davon mit der jeweils besten Methode.

Konkret bedeutet das, dass zentrale Datenpunkte wie Rechnungsnummern, Daten oder Summen isoliert, tabellarische Bereiche abgetrennt und variable oder komplexe Elemente unabhängig behandelt werden.

Das Ziel ist mehr als nur bessere Extraktion – es ist eine verlässlichere Struktur. Die Verarbeitung von Dokumenten in Teilen führt zu saubereren, vorhersehbareren Ausgaben, die sich einfacher in nachgelagerte Systeme einbinden lassen. Teams müssen keine inkonsistenten Ergebnisse mehr bereinigen, sondern bekommen strukturierte Daten, die direkt in ihre Workflows passen.

Dieser Ansatz sorgt zugleich für mehr Zukunftssicherheit: Ändern sich Layouts oder kommen neue Formate ins Spiel, lassen sich Anpassungen gezielt auf Komponentenebene vornehmen, ohne das Gesamtsystem neu zu bauen. Synthetisches Parsen verwandelt Dokumentenautomatisierung so von einem „Best Guess“-Prozess in eine kontrollierte und verlässliche Datenpipeline.

Die Entstehung von synthetischen Parsing-Pipelines

Der AI Trends Report 2026 von IBM verweist auf einen praxisorientierten Ansatz bei der Dokumentenautomatisierung. Anstatt ein einziges Modell auf das gesamte Dokument anzuwenden, empfiehlt IBM, dieses in Komponenten zu zerlegen und jeweils gezielt zu verarbeiten:

- Textblöcke werden für die Extraktion an ein speziell für Zonale OCR optimiertes Modell geleitet

- Tabellen werden separat verarbeitet, um Zeilen, Spalten und Summen zu erhalten

- Bilder und Logos werden von Computer-Vision-Modellen für Stempel und Unterschriften analysiert

- Handschrift wird von spezialisierten Erkennungsmodellen verarbeitet

Jedes Element wird entsprechend seiner Besonderheiten verarbeitet, anstatt alles per Einheitsmodell zu interpretieren.

Dieser Wandel ist nicht nur eine Frage von Modellgüte, sondern Ausdruck eines breiten Trends hin zu verlässlicheren Workflows. Werden verschiedene Datentypen separat behandelt, gibt es konsistentere Ausgaben, weniger übersehene Felder und weniger Variabilität zwischen den Dokumenten.

Das reduziert auch Verarbeitungsoverhead: Anstatt jedes Dokument komplett durchs gleiche aufwändige Modell zu schicken, wird jedes Teil effizient behandelt – das verbessert Geschwindigkeit und Skalierbarkeit, je mehr Dokumente anfallen. Das Ergebnis: bessere Genauigkeit, vorhersehbare Daten und Workflows, die auch bei variablen Formaten und im echten Betrieb stabil funktionieren.

Warum das für Unternehmen 2026 wichtig ist

Für Teams, die moderne Dokumentenautomatisierung evaluieren, bedeutet dieser Wandel einen neuen Standard für "gute" Produktionsergebnisse.

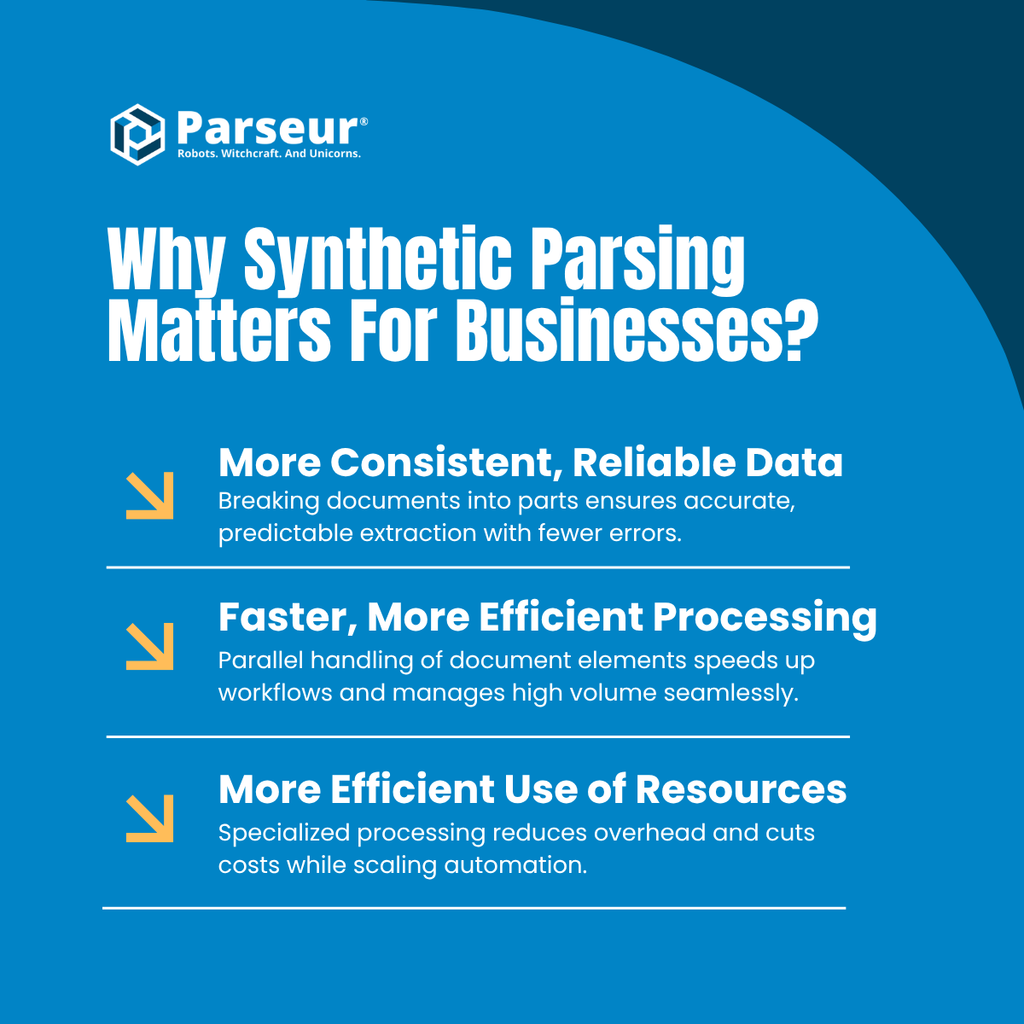

1. Konsistentere, verlässlichere Daten

Einzelmodell-Ansätze erzeugen besonders bei komplexen oder sich verändernden Formaten oftmals variierende Ergebnisse. Die Zerlegung in Einzelelemente sorgt für konsistentere Extraktion über Felder wie Summen, Positionen und Schlüsselinformationen hinweg. Praktisch heißt das: weniger übersehene Felder, weniger Ausnahmen und weniger manuelle Nacharbeit, bevor die Daten weiterverwendet werden.

Einzelmodell-Ansätze stoßen an ihre Grenzen, weil kein einzelnes Modell alles perfekt abdecken kann. Synthetische Parsing-Pipelines setzen spezialisierte Modelle jeweils dort ein, wo sie am effektivsten sind.

2. Schnellere, effizientere Verarbeitung

Die separate Bearbeitung verschiedener Dokumententeile erhöht auch die Workflow-Geschwindigkeit. Anstatt alles in einem einzigen Durchlauf zu verarbeiten, können Aufgaben nach Komplexität effizienter bearbeitet werden. Für Teams mit hohem Volumen bedeutet das schnellere Durchlaufzeiten und die Fähigkeit, Spitzen abzufedern, ohne dass die Workflows ins Stocken geraten oder abbrechen.

Beispiel-Workflow:

- Früher (Einzelmodell): Ganze 10-seitige Rechnung verarbeiten → 30 Sekunden

- Jetzt (synthetische Pipeline): Text, Tabellen, Bilder parallel verarbeiten → 6 Sekunden

3. Effizienterer Ressourceneinsatz

Nicht jeder Teil eines Dokuments benötigt denselben Verarbeitungsaufwand. Ein strukturierter Ansatz stellt sicher, dass einfache Elemente effizient behandelt werden, während komplexe Teile besondere Aufmerksamkeit erhalten. Das spart Verarbeitungsaufwand und ermöglicht es Teams, Automatisierung skalierbar zu nutzen, ohne dass Kosten unvorhersehbar ansteigen. Parallele Pipelines reduzieren die End-to-End-Kosten für Dokumente mit mehreren Elementen um 60–70 %, so Zen van Riel von GitHub.

Der größere Wandel

Das ist mehr als ein technisches Upgrade – es ist ein Schritt hin zu verlässlichen, dauerhaft nutzbaren Dokumentenworkflows. Für Unternehmen ist das Ziel nicht die maximale Genauigkeit in isolierten Fällen, sondern konsistente, nutzbare und zuverlässige Daten, die reale Arbeitsprozesse stützen – von Buchhaltung und Finanzen bis Supply Chain und Kundenservice.

Mehr zu den Themen Genauigkeit, Geschwindigkeit und Wirtschaftlichkeit in der KI-Dokumentenverarbeitung: AI Invoice Processing Benchmarks 2026.

Der Parseur-Ansatz – Zuverlässige Dokumentenautomatisierung ab Tag eins

Bei Parseur ist das kein neues Konzept. Wir setzen von Anfang an auf einen hybriden Multi-Modell-Ansatz. Anstatt ein Modell alles verarbeiten zu lassen, leiten wir jedes Element gezielt zu dem Werkzeug, das am besten damit umgehen kann.

Unsere synthetische Pipeline:

- KI-gestützte Extraktion für strukturierte, vorhersehbare Felder wie Rechnungsnummern, Daten und Summen

- Zonale OCR-Modelle für gescannte Dokumente und Bilder

- KI-basiertes Parsen für variable Layouts und komplexere Dokumente

- Tabellenerkennung, um Zeilen, Spalten und mehrzeilige Einzelposten zuverlässig zu erhalten

Warum das funktioniert:

- Vorlagen bieten bei festen Feldern nahezu perfekte Genauigkeit zu minimalen Kosten

- Zonale OCR verarbeitet gescannte Dokumente konsistent

- KI-Modelle bewältigen variable Inhalte ohne Unterbrechungen im Workflow

- Tabellenerkennung sorgt dafür, dass kritische Einzelposten-Daten erhalten bleiben

Wie Sie 2026 Dokumentenverarbeitungs-Tools bewerten sollten

Wenn IBM recht behält (und alles deutet darauf hin), sollten Sie bei Dokumentenautomatisierungslösungen auf Folgendes achten:

Warnzeichen für Einzelmodell-Ansätze

- „Unser KI-Modell übernimmt alles.“

- „Einfach Dokumente hochladen, unser Modell lernt von allein.“

- Kein Hinweis auf Zonale OCR, KI-Parsen oder spezielle Behandlung für Tabellen und Handschrift

- Blackbox-Preise ohne Transparenz bei der Komplexität von Dokumenten

Empfehlenswert: Synthetische Pipeline-Ansätze

- Mehrere Extraktionsmethoden: KI, Zonale OCR, Tabellenerkennung und mehr

- Klare Logik, um jedes Element zum optimalen Modell zu routen

- Transparente Preisgestaltung je nach Dokumententyp oder Komplexität

- Entwickelt für Zuverlässigkeit und Konsistenz im produktiven Alltag – nicht nur in Demos

Was passiert als nächstes?

IBMs Prognose ist keine Spekulation. Der Markt steuert längst darauf zu.

Q2 2026 – Marktkonsolidierung: Einzelmodell-Anbieter werden entweder synthetische Pipelines bauen (das ist teuer und langwierig), von Plattformen mit multimodaler Infrastruktur aufgekauft – oder verschwinden, wenn sie sich nicht anpassen können.

Q3-Q4 2026 – Migration im Unternehmen: Unternehmen mit Einzelmodell-Verträgen werden Proof-of-Concepts mit Anbietern synthetischer Pipelines durchführen, Genauigkeit, Geschwindigkeit und Zuverlässigkeit vergleichen und entweder Anbieter wechseln oder Upgrades zu robusteren Workflows verlangen.

2027 – Branchenstandard: Synthetische Parsing-Pipelines werden der Standard für Unternehmensdokumentenautomatisierung. Einzelmodell-Verarbeitung gilt dann als überholt – ähnlich wie Faxgeräte.

Fazit

Wenn Ihr Anbieter für Dokumentenautomatisierung immer noch auf ein einziges KI-Modell für alles setzt, zahlen Sie voraussichtlich mehr für Rechenaufwand, akzeptieren inkonsistente oder geringere Genauigkeit und bremsen Ihre Dokumentenworkflows gegenüber der Konkurrenz aus.

Der Wechsel zu synthetischen Parsing-Pipelines ist keine Option, sondern zwangsläufig. Die eigentliche Frage ist, ob Ihr Team früh dabei ist und verlässliche, skalierbare Automatisierung nutzt – oder ob Sie später nur noch aufholen.

Zuletzt aktualisiert am