La inteligencia artificial basada en un solo modelo para el procesamiento de documentos tiene dificultades con documentos complejos, mientras que los flujos estructurados de análisis sintético impulsan mejoras en precisión, consistencia y escalabilidad. Así, las empresas pueden confiar en automatizaciones que realmente funcionan más allá de las demostraciones controladas.

Puntos clave:

- La IA de un solo modelo no responde bien ante documentos diversos o complejos, provocando errores y bloqueos en los procesos.

- Los flujos de análisis sintético aumentan precisión, velocidad y regularidad procesando por separado cada elemento del documento.

- Parseur utiliza desde 2016 flujos sintéticos multi-modelo para ofrecer automatización de documentos escalable y robusta.

La automatización de documentos está evolucionando. La idea de que un único modelo de IA pueda encargarse de todo el procesamiento de documentos con IA de principio a fin está demostrando ser poco fiable, especialmente en equipos que gestionan facturas, contratos y documentos operativos con gran volumen.

Para equipos que apoyan su operativa en OCR e IA para procesar documentos, este cambio remarca una realidad clave: la automatización precisa y escalable depende de convertir sistemáticamente los documentos en datos estructurados. Sin esa base, incluso los modelos más avanzados tienen dificultades para ofrecer resultados fiables en los flujos de trabajo reales.

El problema del procesamiento de documentos con un solo modelo

Durante años, el procesamiento documental ha seguido un enfoque sencillo: usar un solo modelo de IA u OCR para extraer todo posible de un documento. En teoría podría funcionar. En la práctica, rápidamente aparecen sus carencias.

El problema central es claro: los documentos no son uniformes. Una sola factura puede contener texto impreso (nombre del proveedor, número de factura), tablas (líneas con cantidades, precios, totales), notas manuscritas (instrucciones de entrega), logotipos y sellos (branding, firmas de aprobación) y códigos de barras (números de seguimiento).

Cada uno de estos elementos se comporta de manera diferente. Algunos son estructurados y predecibles, mientras que otros son muy variables. Tratar todos igual genera vacíos en la captura de datos.

Aquí es donde los enfoques de modelo único empiezan a fallar. Se ven obligados a interpretar todo igual, incluso cuando diferentes partes requieren distintos tratamientos. El resultado no es solo menor precisión, sino inconsistencias: se omiten campos, los formatos cambian inesperadamente y los resultados varían de un documento a otro.

Una encuesta global de Yahoo Finance halló que el 62,8% de las organizaciones encuentran problemas de calidad documental frecuentemente o de vez en cuando, y la calidad de los datos es una de las principales barreras para escalar la IA. Lo que parece un error de extracción menor pronto se convierte en un problema de flujo cuando esos datos alimentan contabilidad, CRMs u otras herramientas operativas.

Con bajo volumen, los equipos pueden detectar y corregir manualmente los problemas. Pero al crecer el volumen de documentos, especialmente en picos, esas brechas se vuelven imposibles de controlar. Las excepciones se acumulan, el retrabajo aumenta y la automatización requiere una supervisión continua solo para que las cosas funcionen.

Por eso muchos proyectos de automatización documental se estancan. No porque la tecnología no sea lo suficientemente potente, sino porque no es lo bastante fiable en condiciones reales. Forrester informa que más del 60% de los pilotos de IA no escalan debido a problemas de calidad de datos e integración.

Para equipos cuya operativa depende de los documentos en el día a día, el objetivo no es solo extraer datos. Es lograr consistencia, previsibilidad y confianza en que los procesos seguirán funcionando cuando cambien los formatos o crezca la operación.

¿Qué es el análisis sintético?

El análisis sintético es un enfoque de procesamiento de documentos que divide un documento en componentes pequeños y procesa cada parte por separado, en vez de tratar el documento como un único bloque.

Los sistemas tradicionales intentan extraer “todo” de una sola vez. El análisis sintético toma otro camino: identifica elementos diferentes dentro de un documento (como campos de texto, tablas o secciones visuales) y maneja cada uno con el método más adecuado.

En la práctica, esto significa aislar datos clave como números de factura, fechas o totales; separar secciones estructuradas como tablas de líneas; y tratar de forma diferenciada los elementos más variables o complejos.

El objetivo ya no es solo extraer mejor: es ofrecer una estructura mucho más fiable. Procesando los documentos por partes, el análisis sintético genera salidas más limpias, predecibles y fáciles de mapear en los sistemas posteriores. En vez de resultados inconsistentes que requieren limpieza, los equipos obtienen datos estructurados listos para automatizar.

Este enfoque también hace la automatización más resiliente. Cuando el diseño cambia o aparece un nuevo formato, se pueden hacer ajustes solo en el componente afectado sin rehacer todo el sistema. Es decir, el análisis sintético transforma la automatización documental de un proceso “a tientas” a una tubería de datos mucho más controlada y consistente.

Aquí llegan los flujos sintéticos

El informe de tendencias en IA 2026 de IBM apunta a un enfoque más práctico de la automatización documental. En vez de depender de un solo modelo para procesar todo un documento, la tendencia es dividirlo en partes y procesar cada componente de manera más estructurada:

- Bloques de texto dirigidos a un modelo de extracción optimizado para OCR

- Tablas procesadas por separado, preservando filas, columnas y totales

- Imágenes y logotipos tratados por modelos de visión computadorizada para sellos y firmas

- Escritura a mano enviada a modelos especializados de reconocimiento

Cada elemento se procesa según su naturaleza, evitando forzar a un solo modelo a interpretarlo todo igual.

Este cambio no es solo cuestión de rendimiento de modelos: refleja un movimiento más amplio hacia flujos documentales más confiables. Al separar cómo se procesan los diversos tipos de datos, los equipos logran resultados más consistentes, menos campos omitidos y menos variaciones entre documentos.

También se reduce el procesamiento innecesario. En vez de pasar cada documento por un modelo pesado, cada elemento se maneja de manera eficiente, mejorando la velocidad y la escalabilidad cuando el volumen crece. El resultado no es solo mejor precisión, sino datos y flujos más predecibles bajo condiciones reales, donde los formatos cambian, los documentos varían y la consistencia es más importante que resultados puntuales de laboratorio.

¿Por qué esto es importante para las empresas en 2026?

Para quienes evalúan la automatización documental moderna, este cambio refleja el nuevo estándar de lo que significa “bueno” en producción.

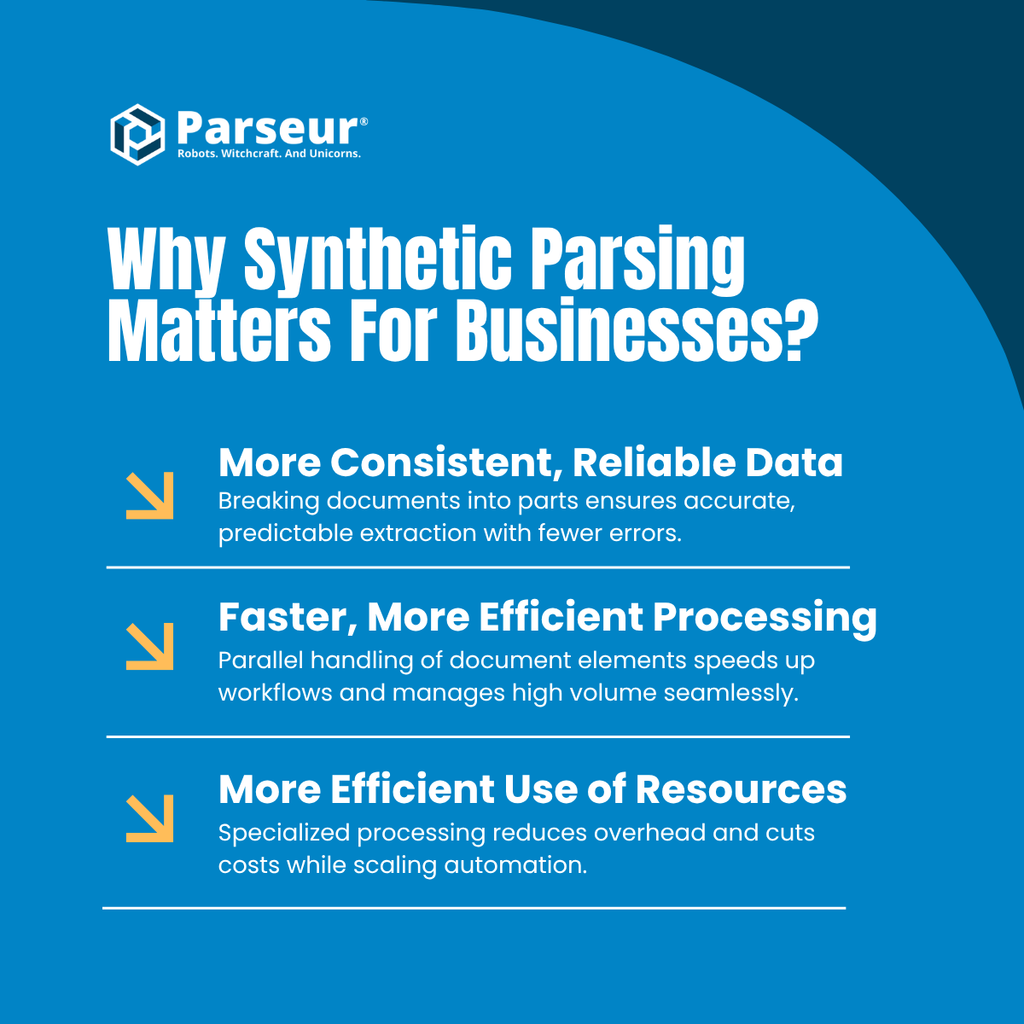

1. Datos más fiables y coherentes

Los enfoques de modelo único tienden a ofrecer resultados variables, especialmente con documentos complejos o formatos cambiantes. Dividir los documentos en componentes logra extracciones más consistentes en campos como totales, líneas y datos claves. En la práctica, esto equivale a menos campos omitidos, menos excepciones y menos corrección manual antes de que los datos fluyan al siguiente sistema.

Los modelos únicos siempre tocan techo porque ningún modelo puede ser óptimo en todo. Los flujos sintéticos emplean modelos especializados, cada uno optimizado para su tarea concreta.

2. Procesos más ágiles y eficientes

Procesar las distintas partes de un documento por separado mejora el rendimiento. En vez de tratar todo en un solo paso, cada tarea se ajusta a su complejidad. En equipos con gran volumen, esto significa plazos de procesamiento más cortos y la capacidad de afrontar picos sin que los flujos se ralenticen o fallen.

Ejemplo de flujo:

- Antes (modelo único): Procesar una factura de 10 páginas → 30 segundos

- Ahora (flujo sintético): Procesar texto, tablas e imágenes en paralelo → 6 segundos

3. Uso más eficiente de recursos

No todas las partes de un documento requieren el mismo procesamiento. Un enfoque estructurado garantiza que los elementos sencillos se manejan eficientemente, y los complejos reciben la atención necesaria. Así, se evita el sobreprocesamiento y las empresas pueden escalar sin que los costes se descontrolen. Los flujos paralelos reducen el coste global de procesamiento un 60–70% en documentos con varios elementos, según Zen van Riel de GitHub.

El gran cambio

Esto no es solo una mejora técnica. Es un paso hacia flujos documentales mucho más confiables. Para los negocios, el objetivo no es subir la métrica de precisión en sí misma, sino asegurar que los datos extraídos sean consistentes, útiles y tan fiables como para impulsar operaciones reales: de la contabilidad y finanzas a la cadena de suministro y la atención al cliente.

Descubre más sobre precisión, velocidad y ahorro en procesamiento documental con IA: Benchmarks de Procesamiento de Facturas con IA 2026.

El enfoque de Parseur - Automatización documental fiable desde el primer día

En Parseur, este concepto no es nuevo. Usamos este enfoque híbrido y multi-modelo desde el principio. En vez de forzar un solo modelo, direccionamos cada elemento a la herramienta que mejor lo gestiona.

Nuestro flujo sintético:

- Extracción avanzada por IA para campos estructurados y predecibles como números de factura, fechas y totales

- Modelos de OCR para documentos escaneados e imágenes

- Análisis IA para layouts variables y documentos complejos

- Reconocimiento de tablas para que filas, columnas y líneas agrupadas se conserven

Por qué funciona:

- Las plantillas ofrecen precisión casi perfecta en campos fijos a bajo coste

- El OCR aborda los escaneados de forma regular

- Los modelos IA se ocupan de contenido variable sin romper los procesos

- El reconocimiento de tablas garantiza la integridad de los datos de línea

Cómo evaluar herramientas de procesamiento documental en 2026

Si la predicción de IBM se cumple (y todo apunta a ello), esto es lo que debes buscar al elegir una solución de automatización documental:

Señales de alarma: enfoque de modelo único

- “Nuestro modelo de IA gestiona todo.”

- “Solo tienes que cargar documentos y aprenderá solo.”

- Ni una mención a OCR, análisis IA, ni tratamiento especializado para tablas o manuscritos

- Precios opacos sin explicación sobre la complejidad del documento

Buena señal: enfoque de flujo sintético

- Varios métodos de extracción: IA, OCR, reconocimiento de tablas y más

- Lógica clara para enviar cada elemento al modelo que mejor lo gestiona

- Precios transparentes según el tipo o la complejidad documental

- Pensado para fluidez y fiabilidad en escenarios reales, y no solo en demos

¿Qué viene después?

La predicción de IBM no es especulación; el mercado ya se está moviendo en esa dirección.

2º trimestre de 2026 – Consolidación de proveedores: Los de modelo único tendrán que desarrollar flujos sintéticos (un salto lento y costoso), ser adquiridos por plataformas con infraestructura multimodal, o quedarse irrelevantes si no pueden adaptarse.

3º-4º trimestre de 2026 – Migraciones empresariales: Las organizaciones atadas a contratos de modelo único experimentarán con proveedores de flujos sintéticos, compararán resultados en precisión, velocidad y fiabilidad, y migrarán o exigirán mejoras en los flujos.

2027 – Nuevo estándar de la industria: Los flujos sintéticos se convertirán en el estándar por defecto para la automatización documental empresarial. El procesamiento de un solo modelo se verá como obsoleto, igual que depender del fax.

En resumen

Si tu proveedor de automatización documental aún depende de un modelo de IA único para todo, probablemente estás pagando de más, aceptando precisión inconsistente —o menor— y ralentizando tus flujos documentales frente a la competencia.

El cambio a flujos sintéticos no es opcional. Es inevitable. La verdadera pregunta es si tu equipo lo adoptará temprano para ganar automatización fiable y escalable, o esperará hasta quedarse atrás.

Última actualización el