L’elaborazione documentale tramite IA a modello singolo arranca con i documenti complessi, mentre le pipeline di parsing strutturato migliorano accuratezza, coerenza e scalabilità. Grazie a queste soluzioni, le aziende beneficiano di un’automazione davvero solida, non solo nelle demo in laboratorio.

Punti chiave:

- L’IA a modello singolo fatica con documenti complessi e variabili, causando errori e interruzioni nei flussi operativi.

- Le pipeline di parsing sintetico migliorano accuratezza, velocità e coerenza gestendo separatamente ogni elemento del documento.

- Parseur utilizza pipeline sintetiche multi-modello sin dal 2016, garantendo automazione documentale scalabile e affidabile.

L’automazione documentale sta cambiando. L’idea che un solo modello AI possa gestire “end-to-end” l’elaborazione documentale AI si dimostra sempre più inadeguata, specie per chi gestisce fatture, contratti e alti volumi di documenti operativi.

Per i team che usano OCR e AI nell’elaborazione dei documenti, questa trasformazione mette in evidenza un presupposto chiave: per ottenere automazione scalabile e precisa, è indispensabile trasformare i documenti in dati strutturati. Senza questa base, anche i modelli AI più avanzati rischiano di produrre risultati poco affidabili nelle attività quotidiane.

Il problema dell’elaborazione documentale a modello singolo

Per anni, l’elaborazione documentale ha seguito un approccio semplice: utilizzare un unico modello IA o OCR per estrarre ogni elemento dal documento. In teoria, funziona. In pratica, si rivela rapidamente insostenibile.

Il punto critico è che i documenti reali non sono mai uniformi. Una fattura può contenere testo stampato (es. nome fornitore, numero fattura), tabelle (righe con quantità, prezzi e totali), note manoscritte (istruzioni di consegna), loghi e timbri (branding aziendale, firme di approvazione), oppure codici a barre (numeri di tracciamento).

Ciascun elemento si comporta in modo differente. Alcuni sono costanti e facilmente interpretabili, altri molto variabili. Trattarli tutti allo stesso modo crea inevitabilmente lacune nell’acquisizione dei dati.

Qui i sistemi a modello singolo cominciano a traballare: sono costretti a interpretare ogni sezione come se fosse uguale alle altre, anche quando le esigenze sono diverse. Il risultato non è solo bassa accuratezza, ma anche incoerenza: campi assenti, errori frequenti, risultati mutevoli da un documento all’altro.

Secondo una recente indagine di Yahoo Finance, il 62,8% delle aziende incontra spesso o occasionalmente problemi nella qualità dei documenti, con la qualità dei dati come principale ostacolo per la scalabilità dell’IA. Quello che sembra un piccolo errore di estrazione può diventare un grosso problema quando i dati passano a sistemi di contabilità, CRM o altri strumenti operativi.

Se i volumi sono contenuti, i team possono ancora permettersi il controllo manuale. Ma quando crescono (specie durante i picchi), queste incombenze diventano insostenibili. Le eccezioni si moltiplicano, il rework aumenta, l’automazione va monitorata per evitare rotture.

Molti progetti di automazione si bloccano proprio per questo. Non perché la tecnologia sia “debole”, ma perché non garantisce affidabilità negli scenari reali. Forrester indica che oltre il 60% dei progetti pilota IA non riesce a scalare a causa di problemi di qualità e integrazione dei dati.

Per i team che operano tutti i giorni con documenti, l’obiettivo non è solo estrarre dati: è garantirne la coerenza, la prevedibilità e la certezza che i workflow continuino a funzionare anche quando i formati cambiano o l’azienda cresce.

Cos’è il parsing sintetico?

Il parsing sintetico è un approccio all’elaborazione documentale che suddivide i file in componenti più piccoli, processando ogni parte separatamente invece di trattare il documento come un unico blocco di contenuto.

Nei sistemi classici, tutto viene estratto in un’unica fase. Il parsing sintetico si muove diversamente: individua e isola elementi distinti (campi di testo, tabelle, o elementi visivi) e li processa ciascuno con lo strumento più adeguato.

In pratica, permette di isolare dati chiave come numeri di fattura, date e totali, separare sezioni strutturate come le tabelle degli articoli e trattare in modo indipendente le parti più variabili o complesse.

L’obiettivo non è solo aumentare la precisione: si tratta di creare una struttura affidabile. Elaborando i documenti in parti, il parsing sintetico produce output più puliti, prevedibili e uniformi, subito integrabili nei sistemi downstream senza laboriose ripuliture manuali.

Questo metodo rende anche l’automazione più resistente ai cambiamenti. Se il layout o il formato cambiano o compaiono nuovi formati, si interviene solo sulla singola componente interessata, non sull’intero flusso. In sostanza, il parsing sintetico trasforma l’automazione documentale in un processo più controllato e affidabile, non più soggetto all’imprevedibilità.

Nascono le pipeline di parsing sintetico

Il rapporto sulle tendenze IA 2026 di IBM suggerisce un approccio più pragmatico all’automazione documentale. Invece di affidarsi a un unico modello per processare tutto il documento, la soluzione sta nel suddividere i documenti in parti e gestire ogni componente in modo più strutturato:

- Blocchi di testo: instradati verso un modello di estrazione ottimizzato per l’OCR

- Tabelle: processate separatamente per preservare righe, colonne e totali

- Immagini e loghi: gestiti tramite modelli di visione artificiale per timbri e firme

- Scrittura a mano: affidata a modelli di riconoscimento specializzati

Ogni tipo di elemento viene processato in base al suo comportamento, invece di forzare un unico modello ad “interpretare” tutto allo stesso modo.

Questa evoluzione non riguarda solo le prestazioni dei modelli: riflette un cambiamento più ampio nel costruire workflow documentali affidabili. Separando la gestione dei diversi tipi di dato, si ottengono risultati più uniformi, meno campi persi e minore variabilità nei risultati tra un documento e l’altro.

Si riduce anche il carico computazionale inutile. Invece di sottoporre ogni documento a un unico modello pesante, ogni componente viene gestito in modo più efficiente, migliorando la velocità e la scalabilità all’aumentare dei volumi. Il risultato è non solo una precisione migliore, ma anche dati più prevedibili e workflow che tengono anche in condizioni reali, dove i formati cambiano, i documenti variano e la coerenza conta più del risultato occasionale.

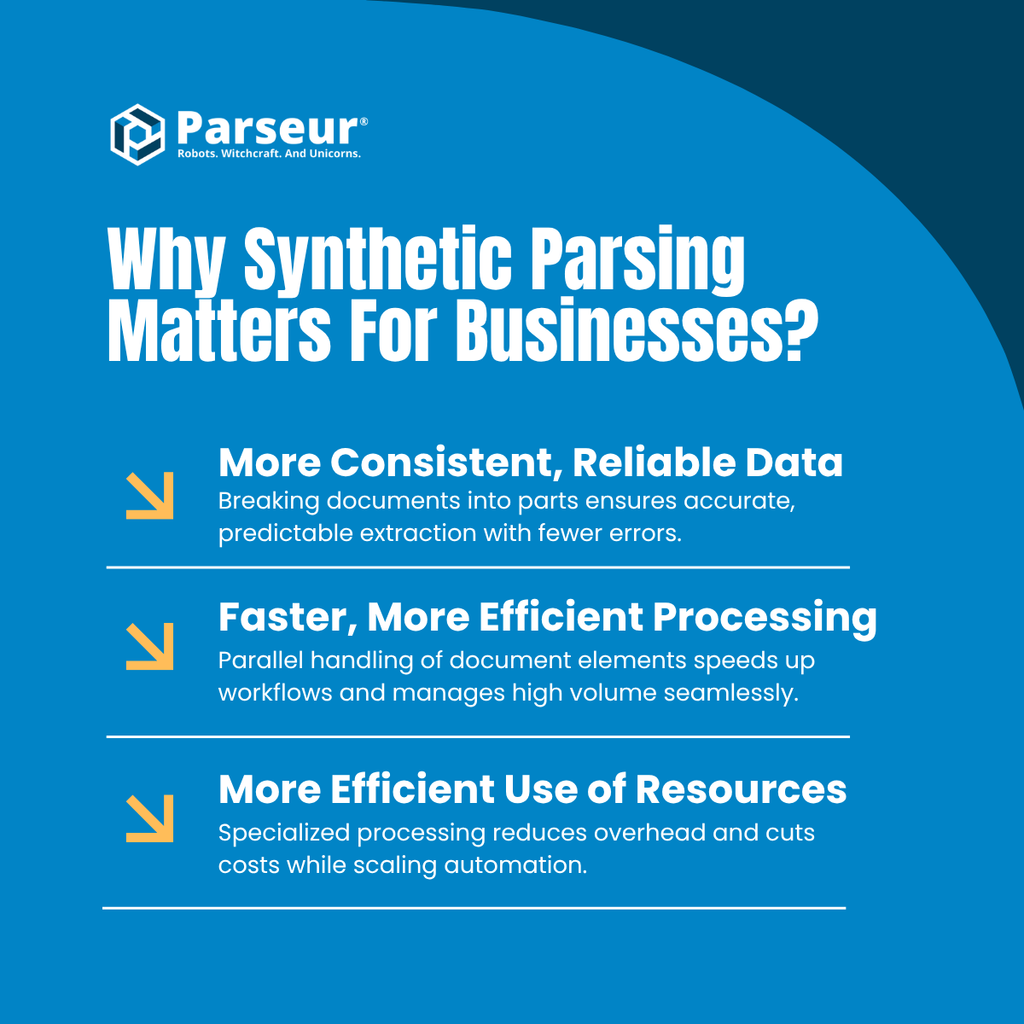

Perché questo è importante per le aziende nel 2026

Per chi oggi valuta strumenti di automazione documentale, questo cambiamento riflette un allargamento delle aspettative su cosa significhi “funzionare bene” davvero in produzione.

1. Dati più affidabili e consistenti

Le soluzioni a modello singolo generano risultati variabili specialmente con documenti complessi o formati in movimento. Scomporre ogni file in componenti distinti assicura un’estrazione uniforme di campi chiave come totali, righe e identificativi. In pratica, significa meno errori, meno eccezioni e meno correzioni manuali prima di poter impiegare i dati downstream.

Gli approcci a modello singolo raggiungono rapidamente un limite, perché nessun modello può essere perfetto per tutto. Le pipeline di parsing sintetico utilizzano modelli specializzati, ciascuno ottimizzato per specifici compiti.

2. Elaborazione più veloce ed efficiente

Elaborare separatamente le varie parti del documento migliora anche le prestazioni complessive. Invece di gestire tutto in un’unica fase, i compiti vengono affrontati in modo più efficiente a seconda della loro complessità. Per i grandi volumi, significa maggiore rapidità e la possibilità di gestire picchi senza blocchi o rallentamenti nei workflow.

Esempio workflow:

- Vecchio metodo (modello singolo): elaborazione fattura di 10 pagine → 30 secondi

- Nuovo metodo (pipeline sintetica): elaborazione parallela di testo, tabelle, immagini → 6 secondi

3. Migliore utilizzo delle risorse

Non tutte le sezioni di un documento richiedono lo stesso livello di elaborazione. Un approccio strutturato garantisce che gli elementi semplici siano gestiti facilmente, mentre le sezioni più complesse ricevano l’attenzione necessaria. Così si evitano sprechi e si permette alla scalabilità di reggere senza aumenti inspiegabili dei costi. Le pipeline parallele riducono il costo end-to-end del 60-70% nei documenti multi-elemento, secondo Zen van Riel di GitHub.

Il vero cambiamento

Non è solo un miglioramento tecnico: è la strada per workflow documentali più affidabili. L’obiettivo aziendale non è spingere solo i numeri di accuratezza. Bisogna garantire che i dati estratti siano consistenti, utilizzabili e così affidabili da diventare la base per tutte le operazioni: da contabilità e finanza a supply chain e customer workflow.

Scopri di più su accuratezza, velocità e costi dell’automazione documentale AI: Benchmark AI elaborazione fatture 2026.

L’approccio Parseur - Automazione documentale affidabile sin dal primo giorno

Per Parseur, questa visione non è una novità. Utilizziamo da sempre un approccio ibrido e multi-modello. Invece di forzare un singolo modello per l’intero documento, ogni elemento è instradato verso lo strumento che lo gestisce meglio.

La nostra pipeline sintetica prevede:

- Estrazione tramite AI per campi strutturati e prevedibili come numero fattura, date e totali

- Modelli OCR per documenti scansionati e immagini

- Parsing AI per layout più variabili e documenti complessi

- Rilevamento tabelle per mantenere righe, colonne e dettagli multiriga

Perché funziona:

- I template garantiscono accuratezza quasi totale sui dati fissi a costi contenuti

- L’OCR tratta i documenti scansionati con coerenza

- I modelli AI gestiscono i contenuti variabili senza rompere i workflow

- Il rilevamento tabelle preserva tutti i dati critici degli articoli

Come valutare strumenti di elaborazione documentale nel 2026

Se la previsione di IBM si realizzerà (e tutti gli indizi vanno in questa direzione), ecco cosa osservare nella scelta di una soluzione di automazione documentale:

Campanelli rossi: approcci a modello singolo

- "Il nostro modello AI gestisce tutto."

- "Carica i documenti e il nostro modello impara."

- Nessun riferimento a OCR, parsing AI o gestione specializzata di tabelle e scrittura a mano

- Prezzi poco trasparenti senza chiarezza sulla complessità del documento

Campanelli verdi: approcci a pipeline sintetica

- Estrazione multipla: AI, OCR, rilevamento tabelle e altro ancora

- Logica trasparente su come viene instradato ciascun elemento verso il modello migliore

- Prezzi trasparenti basati su tipologia o complessità del documento

- Progettazione per la coerenza e l’affidabilità nei workflow reali, non solo nelle demo

Cosa succederà ora?

La previsione di IBM non è speculazione. Il mercato si sta già muovendo in questa direzione.

Q2 2026 - Consolidamento dei fornitori: I vendor a modello singolo cercheranno di costruire pipeline sintetiche (un’operazione onerosa e complessa), saranno acquisiti da chi già possiede infrastrutture multimodali o rischieranno l’irrilevanza se restano fermi.

Q3-Q4 2026 - Migrazione enterprise: Le aziende vincolate da contratti legacy testeranno proof-of-concept con vendor che usano pipeline sintetiche, confrontando accuratezza, velocità e affidabilità prima di migrare o pretendere aggiornamenti verso workflow più solidi.

2027 - Standard di settore: Le pipeline di parsing sintetico diventeranno la norma per l’automazione documentale enterprise. L’elaborazione a modello singolo passerà per datata, come il fax.

In sintesi

Se il tuo fornitore si basa ancora su un solo modello AI per tutto, probabilmente stai pagando più computazione del necessario, accetti risultati incoerenti o meno accurati e rallenti i flussi rispetto ai concorrenti.

Il passaggio alle pipeline di parsing sintetico non è opzionale. È inevitabile. La vera domanda è se il tuo team lo adotterà subito, ottenendo automazione affidabile e scalabile, o se rincorrerà il mercato domani.

Ultimo aggiornamento il