Le traitement documentaire par IA à modèle unique rencontre de grandes difficultés face aux documents complexes, là où les pipelines de parsing structuré permettent d'améliorer précision, cohérence et montée en charge. Les entreprises peuvent ainsi miser sur une automatisation fiable, au-delà de simples démos contrôlées.

À retenir :

- L’IA à modèle unique s’essouffle avec des documents complexes et variables, ce qui cause erreurs et ruptures dans les workflows.

- Les pipelines de parsing synthétique offrent une meilleure précision, rapidité et cohérence en traitant chaque élément indépendamment.

- Parseur s’appuie sur des pipelines synthétiques multi-modèles depuis 2016 pour garantir une automatisation documentaire fiable et évolutive.

L’automatisation documentaire évolue. L’idée qu’un seul modèle d’IA puisse gérer de bout en bout le traitement de documents par IA s’avère peu fiable, notamment pour les entreprises qui traitent des factures, des contrats ou des volumes opérationnels importants.

Pour les équipes qui dépendent de l’OCR et de l’IA pour le traitement documentaire, ce virage souligne une grande réalité : automatiser de façon fiable et à l’échelle nécessite d’obtenir systématiquement, pour chaque document, des données structurées. Sans cette base, même les modèles les plus avancés peinent à garantir la fiabilité en production.

Le problème du traitement documentaire à modèle unique

Pendant des années, le traitement documentaire a reposé sur une logique simple : utiliser un seul modèle d’IA ou d’OCR pour extraire la totalité des données d’un document. Sur le papier, c’est séduisant. Mais dans les faits, la méthode s’essouffle vite.

La cause principale est simple : les documents ne sont pas uniformes. Une facture peut contenir du texte imprimé (nom du fournisseur, numéro de facture), des tableaux (lignes, quantités, prix, totaux), des notes manuscrites (instructions de livraison), des logos et tampons (branding, signatures d’approbation), ou encore des codes-barres (numéros de suivi).

Chacun de ces éléments se comporte différemment. Certains sont structurés et prévisibles, d’autres extrêmement variés. Les traiter tous de la même façon crée des lacunes dans l’extraction de données.

C’est là que l’approche à modèle unique commence à faiblir : elle force une seule interprétation sur l’ensemble alors que chaque partie du document réclame un traitement spécifique. Le problème n’est pas seulement la perte de précision, c’est aussi l’incohérence : des champs sont oubliés, des formats changent sans prévenir, le résultat varie d’un document à l’autre.

Une enquête globale menée par Yahoo Finance révèle que 62,8 % des organisations rencontrent fréquemment ou occasionnellement des soucis de qualité documentaire, la qualité des données étant l’un des principaux obstacles à la montée en charge de l’IA. Un petit problème d’extraction devient vite un gros blocage de workflow, lorsque les données sont intégrées à la comptabilité, au CRM ou à d’autres outils.

À faible volume, les équipes corrigent ces lacunes manuellement. Mais dès que la cadence augmente – surtout pendant les pics d’activité – les exceptions se multiplient, les corrections aussi, et l’automatisation exige une supervision constante pour éviter la panne.

C’est pourquoi beaucoup de projets d’automatisation documentaire sont stoppés. Pas parce que la technologie est trop limitée, mais parce qu’elle manque de fiabilité dans des conditions réelles. Forrester précise que plus de 60 % des pilotes IA échouent à cause de problèmes de qualité des données et d’intégration.

Pour les équipes qui s’appuient sur les documents pour fonctionner au quotidien, le véritable enjeu n’est pas juste l’extraction, mais la cohérence, la prévisibilité, et la garantie que le workflow continuera même si les formats ou les processus évoluent.

Qu’est-ce que le parsing synthétique ?

Le parsing synthétique est une méthode de traitement documentaire qui consiste à diviser un document en composants (zones de texte, tableaux, images, manuscrits, etc.) et à traiter séparément chaque partie, plutôt que de considérer le document comme un bloc homogène à extraire en une passe.

Les systèmes traditionnels essaient d’extraire tout d’un coup. Le parsing synthétique prend la direction inverse : il identifie distinctement les éléments clés d’un document (champs texte, tableaux, éléments visuels…) et traite chacun avec la méthode la mieux adaptée.

Dans la pratique, cela veut dire isoler les informations clés comme numéros de facture, dates ou totaux, séparer les sections structurées telles que les tableaux, et traiter à part les éléments variables ou complexes.

L’objectif n’est pas seulement une meilleure extraction, mais d’obtenir des structures plus fiables. En travaillant document par document, composant par composant, le parsing synthétique livre des résultats plus propres, stables et directement exploitables dans les outils métiers. Adieu les résultats incohérents à retraiter : les équipes obtiennent des données structurées qui s’intègrent de façon immédiate à leurs workflows.

Ce type de pipeline rend aussi l’automatisation documentaire plus robuste. Dès que la mise en page change ou qu’un nouveau format apparaît, les ajustements sont ciblés sur le composant concerné, sans avoir à tout refaire. Autrement dit, le parsing synthétique fait passer l’automatisation documentaire du « meilleur essai » à une chaîne de données réellement fiable et contrôlable.

Place aux pipelines de parsing synthétique

Le rapport IBM sur les tendances AI 2026 va dans ce sens pratique. Au lieu de s’en remettre à un modèle unique pour traiter l’ensemble du document, l’avenir consiste à découper le document et à gérer chaque composant de façon beaucoup plus structurée :

- Blocs de texte orientés vers un modèle d’extraction optimisé pour l’OCR

- Tableaux traités à part pour préserver les lignes, colonnes et totaux

- Images et logos traités par des modèles de vision par ordinateur pour les tampons et signatures

- Manuscrits traités par des modèles spécialisés de reconnaissance d’écriture

Chaque segment est ainsi traité en fonction de son comportement, et non plus via un modèle unique qui impose une lecture universelle à tout.

Ce changement ne vise pas seulement la performance technique. Il incarne un mouvement de fond vers des workflows plus fiables. En isolant les stratégies pour chaque type de donnée, les équipes obtiennent des résultats plus réguliers, moins de champs oubliés et une bien meilleure constance d’un fichier à l’autre.

C’est aussi une source de gain d’efficacité. Plutôt que d’alourdir chaque document avec un modèle monolithique, chaque composant suit le traitement le plus performant pour lui, ce qui accélère le workflow et améliore l’évolutivité à mesure que le volume grandit. Résultat : plus de précision, mais surtout des workflows stables et des données fiables, même dans des environnements réels où les formats changent, les documents varient et la cohérence compte plus qu’un pic ponctuel de performance.

Pourquoi c’est capital pour les entreprises en 2026

Pour ceux qui évaluent les solutions modernes d’automatisation documentaire, ce changement reflète une redéfinition du « bon » workflow en production.

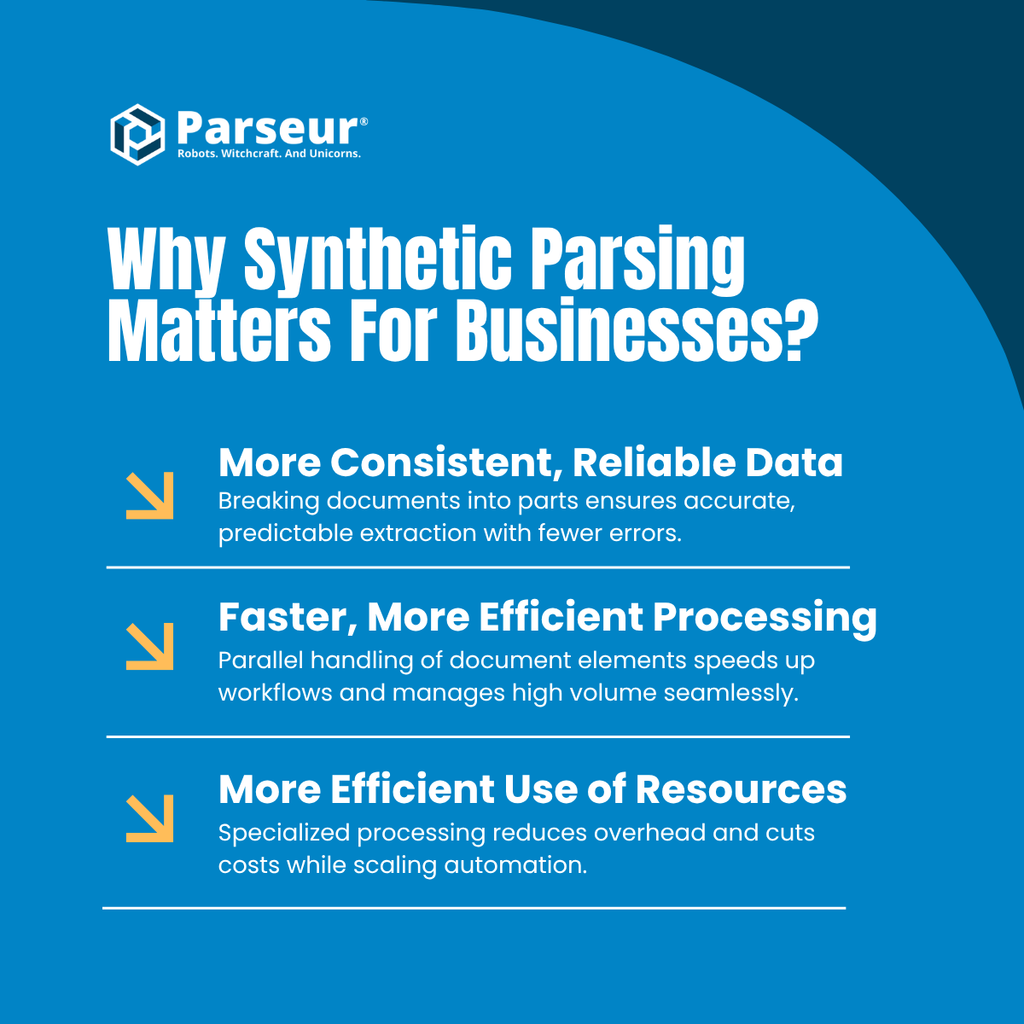

1. Des données plus cohérentes et fiables

Les approches à modèle unique produisent des résultats variables, surtout face à la complexité ou à la mutation rapide des documents. Découper les documents en composants offre une extraction plus stable pour les totaux, les lignes et les champs clés. En pratique, cela signifie moins de champs oubliés, moins d’exceptions et moins de corrections manuelles avant que la donnée puisse être exploitée.

L’approche modèle unique finit par plafonner, car aucun modèle ne peut exceller sur tous les fronts. Les pipelines synthétiques choisissent le modèle le plus spécialisé pour chaque tâche.

2. Des traitements plus rapides et plus efficaces

Traiter les différentes parties d’un document séparément améliore bigrement les performances du workflow. Plutôt que de tout faire passer dans un unique pipeline, chaque tâche est optimisée selon sa complexité. Pour ceux qui gèrent de gros volumes, cela se traduit par des temps de traitement réduits et une capacité à absorber les pics sans ralentissement ni panne.

Exemple de workflow :

- Ancienne méthode (modèle unique) : traitement entier d’une facture de 10 pages → 30 secondes

- Nouvelle méthode (pipeline synthétique) : traitement parallèle du texte, des tableaux et des images → 6 secondes

3. Une utilisation plus rationnelle des ressources

Chaque élément du document n’a pas besoin du même effort de traitement. Une approche structurée garantit que les zones simples sont traitées efficacement, tandis que les parties complexes bénéficient d’une attention spécifique. Cela diminue la charge inutile, optimise les coûts et aide à scaler sans dépasser le budget. Les pipelines parallèles permettent de réduire de 60 à 70 % le coût de traitement de bout en bout pour les documents multi-éléments, selon Zen van Riel (GitHub).

Le changement profond

Il ne s’agit pas juste d’un bond technique. C’est une évolution vers des workflows vraiment fiables. Pour les entreprises, il ne suffit plus d’augmenter le taux de bonne extraction sur le papier. L’objectif, c’est d’obtenir des données cohérentes, exploitables et suffisamment fiables pour alimenter les vraies opérations : de la finance à la logistique, en passant par le service client.

À lire : Références IA Factures 2026 : précision, rapidité et économies en automatisation documentaire IA.

L’approche Parseur : automatisation documentaire fiable dès le premier jour

Chez Parseur, ce modèle n’est pas nouveau. Nous nous appuyons sur un pipeline hybride, multi-modèles depuis nos débuts. Plutôt que de faire tout passer dans le même modèle, chaque élément est orienté vers la technologie la plus efficace pour lui.

Notre pipeline synthétique :

- Extraction assistée par IA pour les champs structurés et prévisibles comme les numéros de factures, dates, totaux

- Modèles OCR pour les documents et images scannés

- Parsing IA pour les mises en page variables ou documents complexes

- Détection de tableaux pour garantir l’intégrité des lignes, colonnes et éléments multi-lignes

Pourquoi ça fonctionne :

- Les templates fournissent une précision quasi-parfaite sur les champs fixes à coût minimal

- L’OCR gère les documents scannés de façon constante

- Les modèles IA absorbent la variabilité sans casser les workflows

- La détection des tableaux assure que les données multi-lignes restent intactes

Comment évaluer les outils de traitement documentaire en 2026

Si la prévision d’IBM se réalise (et tout l’indique), voici les points essentiels à vérifier lors du choix d’une solution d’automatisation documentaire :

Signaux d’alerte : approches à modèle unique

- « Notre modèle d’IA gère tout. »

- « Chargez vos documents, notre modèle apprend ».

- Aucune mention de l’OCR, du parsing IA, ou d’un traitement spécialisé pour tableaux et manuscrits

- Tarification opaque, sans clarté sur la complexité documentaire

Points à privilégier : pipelines synthétiques

- Extraction multi-méthodes : IA, OCR, détection de tableaux, etc.

- Logique claire pour orienter chaque élément vers le meilleur modèle

- Tarifs transparents selon le type de document ou sa complexité

- Solution conçue pour l’homogénéité et la fiabilité en workflows réels, pas juste en démo

Et ensuite ?

La prédiction d’IBM n’est pas un simple pronostic : le marché évolue déjà dans cette direction.

T2 2026 – Consolidation secteur : Les éditeurs modèle unique vont construire des pipelines synthétiques (refonte lourde…), être rachetés par des plateformes multi-modèles, ou devenir obsolètes s’ils ne suivent pas le mouvement.

T3-T4 2026 – Migration entreprise : Les entreprises liées à des contrats “modèle unique” feront des POC chez les fournisseurs de pipelines synthétiques, compareront la rapidité, la fiabilité et la précision, puis changeront de prestataire ou exigeront la modernisation de leurs workflows.

2027 – Nouveau standard : Les pipelines de parsing synthétique deviennent la norme dans l’automatisation documentaire professionnelle. Le modèle unique relèvera désormais du passé, comme la dépendance au fax.

En résumé

Si votre fournisseur d’automatisation documentaire fonctionne encore sur un seul modèle IA, vous payez certainement trop pour les ressources de calcul, vous acceptez une précision limitée, et vos workflows sont en retard comparés à ceux de vos concurrents.

La transition vers le parsing synthétique n’est pas une option, c’est une nécessité. La véritable question : votre équipe va-t-elle adopter cette évolution dès maintenant et gagner en fiabilité et scalabilité, ou attendre et se retrouver à la traîne ?

Dernière mise à jour le