重要なポイント

- ヒューマン・イン・ザ・ループAI(HITL)は、AIに人間の監督を組み合わせて精度と公平性を向上させます。

- データラベリング、予測、人間の修正、モデルの改良というフィードバックループに従います。

- HITLは、ドキュメント処理、カスタマーサポート、医療診断、不正検出などに使用されます。

- 自動化と比較し、HITLはコントロール性に優れる一方、速度やスケーラビリティに課題がある場合もあります。

ヒューマン・イン・ザ・ループAIとは?

**ヒューマン・イン・ザ・ループAI(HITL:human in the loop ai)**は、AIシステムの運用において要所要所で人間のフィードバックや監督を取り入れ、システム全体の精度・公平性・結果の品質を高めるアプローチです。つまり、AIだけでは完結できない判断や修正を人間が担うことで、より優れたパフォーマンスを実現します。

McKinseyの調査によると、多くの組織がAI導入を急速に進めており、AI成熟化とともにガバナンスやリスク管理への注目が高まっています。現在、組織の71%が生成AIを使用しており、human in the loop ai の役割はこれまで以上に重要となっています。

AIにすべてを任せるのではなく、HITLは特に意思決定や倫理、品質管理の観点から人間の役割を堅持します。

この手法は、機械学習のトレーニング、アウトプットの検証、継続的なフィードバックによるシステム改善などで頻繁に用いられます。特に医療、金融、法務、大規模なドキュメント処理のように実社会で重大な影響を及ぼす分野で非常に価値があります。

また、ヒトとAIの協働を実現するための要となっており、AIツールが効率的に業務を自動化しつつ、その成果が人間の価値観、ビジネス目標、コンプライアンス基準に合致することを保証します。

Clanxの調査でも、81%のビジネスリーダーがヒューマン・イン・ザ・ループAIを自社戦略にとって重要と捉えています。

HITLの基礎やメリット、実装方法、今後のトレンドについては、ヒューマン・イン・ザ・ループAI:定義・メリット・2026年のトレンドで詳しく解説しています。

ヒューマン・イン・ザ・ループAIはどう機能するのか?

human in the loop aiは、AI開発と意思決定プロセスに人間の関与を組み込むことで、様々な段階で人がAIの出力を導き、レビュー・修正します。これにより精度・公平性・文脈的な理解が高まります。AIモデルを一度作って終わりではなく、人間が継続的なフィードバックを提供しながらシステムを進化させる反復的なプロセスが特徴です。

ヒューマン・イン・ザ・ループAI(HITL)は、人間とAIの間で継続的かつ反復的なフィードバックループを形成します。人間がAIの重要な段階で導き、完全自動化と比べて最大40%精度が向上することが確認されています(Eyt)。

一般的なHITLの流れは以下の4工程です:

- データアノテーション: 専門家が生データにラベルや分類を施し、AIが適切に学習できるようにします。例:ドキュメントパースシステムで請求書の日付・金額・取引先名などをタグ付けし、AIにこれらの要素を正しく認識させる。

- モデルによる予測: 訓練後のAIが、これまで学んだデータに基づいて予測や判断を行います。例:取引パターンの特定や、メール・スキャン文書からの情報抽出。

- 人間のフィードバック: 人間がAIの出力を評価し、不正確な点を指摘・修正または改善案を提示します。AIだけでは捉えきれない文脈や現場感も追加されます。

- モデルの改善: 得られたフィードバックをもとにAIが再訓練され、行動をアップデート。これを継続することで、特に複雑・微妙なタスク領域で精度と信頼性が向上します。

さらに高度なHITLシステムでは、アクティブ・ラーニングを採用し、AIが不確かなケースを自動的に人間に判断を依頼します。これにより、人手は本当に重要な判断のみに集中し、効率が大幅アップします。

高リスク分野(医療・金融・法務等)では、AIシステムの稼働後も人間の監督が続きます。人間がアウトプットを監視し、重大な誤りやルール逸脱を防止することで、AIのスピードとスケーラビリティを維持しつつ、本当に重要な局面では人間のコントロールを確保できます。

ヒューマン・イン・ザ・ループAIの実用例

human in the loop aiは、多くの業界で精度・公平性・安全性を担保しつつ自動化の恩恵を最大化するため活躍しています。責任あるAI運用には不可欠な役割です。

Expert Beaconによると、画像分類タスクで人間のフィードバックを導入した場合、精度が91.2%から97.7%に向上したことが確認されています。

主な現場での活用ケースは以下のとおりです:

HITLによるドキュメント処理の精度向上

AIが請求書や領収書、契約書、各種フォームなどの非構造化ドキュメントから情報抽出を自動化しますが、人間が日付や金額、取引先名などの主要項目を検証&修正することでデータ品質を確保し、高コストなエラーを防ぎます。HITLはコンプライアンスや帳票自動化が不可欠なバックオフィスで重宝されます。

ヒューマンAI協働によるカスタマーサポート効率化

多くの企業ではAIチャットボットがよくある問い合わせを自動応答し、複雑・感情的・個別性の高い案件だけを人間オペレーターへ転送します。このハイブリッド型により、カスタマー体験のスムーズさと共感の両立が実現されます。

医療分野での診断精度向上

医療現場ではAIがレントゲンや検査値を解析し腫瘍や異常を検出しますが、最終的な診断確定や精査は医師が担います。これにより偽陽性の削減や患者安全の担保といった、命に関わる重大判断にもHITLが不可欠です。

HITLによる不正検出強化

AIは大量の金融取引を監視し異常や不審を検知しますが、全てが本当の不正行為とは限りません。最終判断・承認は人間のコンプライアンス担当者が行い、誤検出による正規ユーザーへの影響を最小限に抑えます。この重層的な仕組みでスピードと正確性を両立します。

自動運転車の安全確保と人間介入

半自動運転などではAIがナビゲーションや認識を行いますが、不確定・リスク状況下では人間ドライバーも介入可能な設計とすることで、HITLが予期せぬ事態への柔軟な反応を可能にします。

ヒューマンAI協働によるコンテンツモデレーション

AIがSNSやプラットフォーム投稿からヘイトスピーチやスパム、誤情報を自動検出しますが、文脈や境界事例は人間が確認し、不適切な削除や検閲を防止します。これによりプラットフォームの健全性と表現の自由を両立できます。

これらの実例が示すように、HITLシステムは効率と責任を両立できる最適解です。重要ポイントで人間の判断を保つことで、企業のAI活用は信頼性・適応性・現実的なゴール整合が強化されます。

データ解析、コンプライアンス監査、カスタマーサービスのような分野では、このハイブリッドアプローチが真に実用的かつ不可欠です。

ヒューマン・イン・ザ・ループAIのメリットとデメリット

human in the loop aiは多くの利点を持つ一方、運用上で意識すべきトレードオフも存在します。どのような状況にどれだけ人間の介在を組み込むべきか理解しておきましょう。

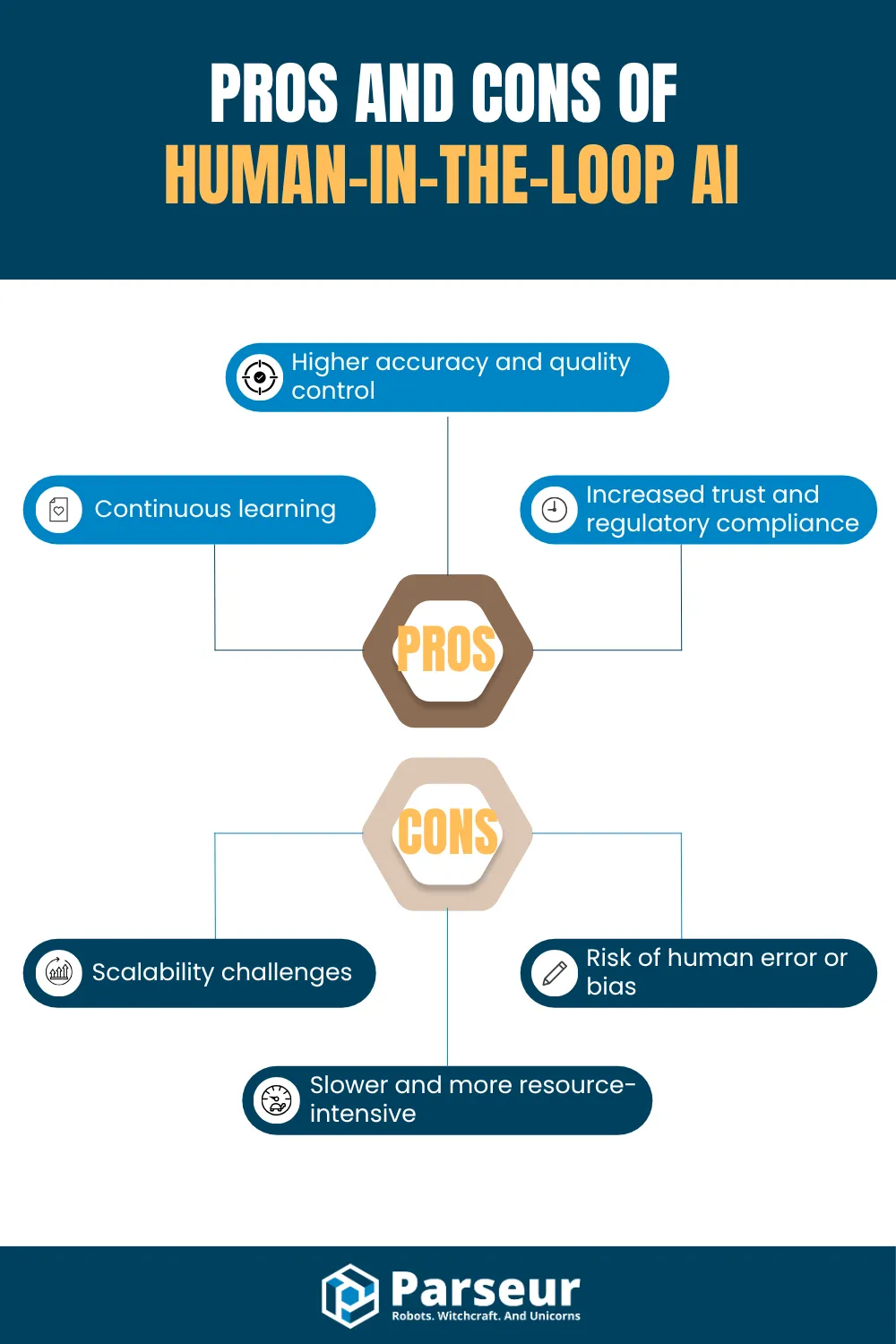

メリット:

- 高い精度と監督機能:複雑・曖昧なケースでも人間がミス検出や確認を行えるため品質が保たれます。

- 信頼性と法規制適合:人間の介入が透明性や説明可能性を高め、関係者や規制機関、顧客の信頼も得やすくなります。

- 継続的なAI学習:人間フィードバックによる再学習でモデルが常に進化し続けます。

デメリット:

- 処理速度とコスト負担:人間が介在する分、自動化に比べて遅くなり労務コストも上がります。

- スケーラビリティの壁:十分な計画がなければ、人手作業が増大し大量の処理には限界が出やすくなります。

- 新たなバイアスや人為ミス:人間の判断が新たな偏りや誤りの原因となるリスクも考慮が必要です。

2024年のMcKinsey調査では、生成AIを導入している組織の27%がAI出力をすべて事前レビューしていることが明らかになっています。自動化が普及する今なお、人間のチェック体制が品質保証に不可欠であることが示されています。

ヒューマン・イン・ザ・ループAIと完全自動AI:使い分けガイド

human in the loop aiと完全自動AIのどちらを導入するかは、タスクの複雑さやミス発生時のリスク、監督・判断の必要性などで決まります。以下の表をご参照ください:

| 要素 | ヒューマン・イン・ザ・ループAI | 完全自動AI |

|---|---|---|

| 適したケース | 判断・倫理・規制遵守が不可欠な意思決定 | 定型的・大量処理でリスクの小さい業務 |

| 導入例 | 医療診断、銀行融資審査、採用判断、法務レビュー | スパム判定、画像自動分類、商品レビューの仕分け |

| 人間の役割 | 出力結果の確認・修正やガイド | 最小限、または介在不要 |

| エラーの影響 | 大:命や公正さ、法順守等に直結するリスク | 小:修正可能あるいは軽微な影響 |

| 柔軟性要求 | 高:状況ごとにきめ細やかな判断が必要 | 低:予測可能でルールベースな業務 |

| 傾向データ | 米大手企業の74%が採用等の重要判断でHITLを採用 | 2027年までに73%の企業が反復タスクをAI自動化計画 |

ケースによって最適バランスを選びましょう

- コストや倫理的責任が大きい場合、human in the loop aiによる人間の監督が不可欠です。

- 単純反復・大量自動処理が求められる場合は完全自動AIで効率化を実現できます。

まとめ

human in the loop aiは、AIの自動化パワーと人間の質的判断を融合し、AIの出力品質や信頼性、説明性・順守性を高める統合運用アプローチです。人間によるレビューとフィードバックを前提にすることで、AI導入による効率アップと同時に、リスク管理や倫理・法規制にも確実に対応できます。

今後AIの導入が広がる中で、「どこで」「どのように」human in the loop aiを活用するかの理解と設計が不可欠です。HITLは進歩を遅らせるものではなく、AIをより賢く安全に、現実のニーズに合致させるための核となります。

具体的なHITL運用戦略や最新トレンドは、ヒューマン・イン・ザ・ループAI:定義・メリット・2026年のトレンドにてさらに詳しく解説しています。導入ノウハウや今後の潮流、ビジネスゴールに合った運用戦略を確認しましょう。

最終更新日