Key Takeaways:

- HITL AIは人間の判断力と機械知能を組み合わせ、高度なワークフローで正確性、公平性、信頼性を確保します。

- 医療、金融、カスタマーサービスなど多くの業界が、HITLを活用してエラーを最小化し、規制遵守やパフォーマンス向上を実現しています。

- AI導入が進む中、人間による監督を戦略的に組み込むことで、リスク管理・コンプライアンス・倫理課題をクリアできます。

- HITLワークフローを活用する組織は、重要なAI活用領域で高精度・顧客満足度・リスク低減を実現しています。

なぜ2026年にヒューマンインザループAIが重要なのか

AI活用は多様な業界で急速に進んでおり、文書処理からカスタマーサポートまで自動化が広がっています。しかし、AI利用を拡大する企業が直面するのは、「どのようにして現実の意思決定にAIを活用しつつ、正確性や法令遵守、信頼性を維持するか?」という課題です。

ここで必要となるのが、ヒューマンインザループ(HITL)AIです。HITLは単なる技術ではなく、機械の効率性と人間の判断力を組み合わせてパフォーマンスを最大化し、リスクを低減し、透明性や説明責任も備えた戦略的AI活用アプローチです。

さらに、現在65%の組織が日常的にジェネレーティブAIを活用しており、この数値は前年の約2倍に増加しています。Netsol Techも報告しているように、HITLは拡大する複雑性やガバナンス、信頼性の課題を管理するうえで不可欠となっています。

本ガイドでご案内するのは下記のポイントです。

- HITL AIとは何か?(その特徴と範囲)

- 文書処理・医療・カスタマーサポートなど現場での実践例

- なぜ高精度・法令遵守・信頼性のためにHITLが必要か

- 2026年およびその先のHITL AI導入準備

金融の自動化やAIの規制対応を担当されている方もご安心ください。HITL戦略は安全かつ賢いAI活用のカギとなることが、本記事でご理解いただけます。

ヒューマンインザループ(HITL)AIとは?

ヒューマンインザループ(HITL)AIとは、AIシステムの学習や運用プロセスの要所要所で人間が積極的に介入する仕組みです。完全自動化型AIとは異なり、HITL AIは人間のフィードバックループを取り入れ、AIの出力を人間が検証・修正し、精度・信頼性・倫理面を強化することができます。

VentureBeatによれば、AI/機械学習実務者の96%が「人間によるラベリングは重要」と考え、86%が「不可欠」と答えています。専門家による監督は奢侈品ではなく今や必須要件です。

つまり、HITLはAIと人間の協業です。AIが定型的かつ大規模な作業を担い、判断や専門知識が不可欠なシーンでは人間が介入します。

正式な定義:

HITL AIは、トレーニング・検証・意思決定など重要ポイントで人間のフィードバックを組み込み、AIモデルの精度を高めてエラーを減らす機械学習手法です。

特に文書処理や医療診断、金融リスク管理、コンプライアンス分野など、ミスが重大な損害をもたらす業種でHITLは不可欠です。

関連用語の説明:

- Human-on-the-loop: 人間がAIを監督し、必要時のみ介入

- Human-out-of-the-loop: AIが完全自律稼働し、人間は一切介入しない

人間の強みと機械の強みを組み合わせることで、HITLはビジネスにとって信頼性・柔軟性の高い自動化戦略となります。

ヒューマンインザループAIはどう機能する?

ヒューマンインザループ(HITL)AIは、AI開発から運用までの各段階で人だけができる判断を組み込む協働型フィードバックループにより動きます。このハイブリッドな仕組みが、精度・公平性・信頼性を担保し、AIシステムの性能も継続的に改善させます。

HITLワークフローの多くは、主に3つのステージで展開されます。

1. データアノテーション

人間がAIモデルの訓練用データに**ラベル付けや注釈付け**を行います。例:文書処理なら請求書番号や金額、支払期日などの項目をマーキングすることで、高品質な学習データを生み出します。

2. モデルトレーニング

アノテーション済みデータでAIモデルを学習させます。データサイエンティストやエンジニアがパラメータやパフォーマンスの最適化、バイアス回避などを人力で調整します。

3. テスト&フィードバック

運用中も、AIが苦手な曖昧なケースや自身の低い予測は人間がレビュー担当。修正や検証の内容はフィードバックとしてモデル学習に活用されます。これによりAIの継続的な強化学習が実現します。

事例:文書処理

インテリジェント文書処理(IDP)のHITLワークフロー:

- AIがスキャン済み帳票からデータを抽出

- 高い信頼度の項目は自動で承認

- 低信頼度や複雑なレイアウト、手書き項目などは人間が確認・修正

- 人手修正の内容をAIが再学習し、今後精度が向上

この双方向プロセスにより、AI自動化でも継続的な品質担保が可能です。

Tely.aiは、HITLワークフロー導入により文書抽出精度99.9%も可能だと報告しています。AIのスピードと人の精度の融合です。

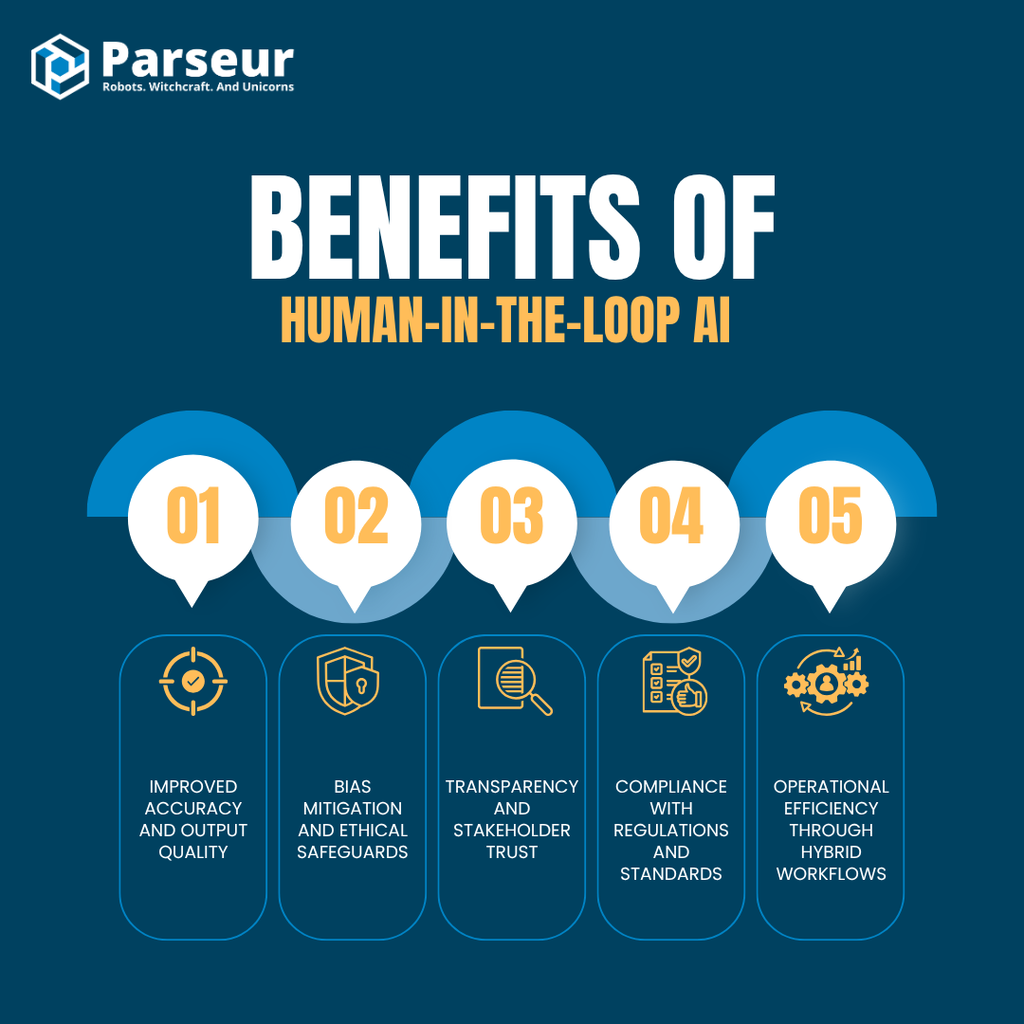

ヒューマンインザループAIのメリット

AI導入が進む企業の多くは「完全自動化だけでは限界がある」と認識し始めています。HITL AIは、AIのスケールや効率性と、人間しかできない判断力を両立。特に文書処理やカスタマーサービス、法務、医療などミスが大きな影響を与える分野で不可欠です。「人×AI」のハイブリッド導入により、信頼できるワークフロー構築が加速しています。

History Toolsによると、複雑な問い合わせでは72%の顧客がチャットボットより人間を希望。HITLカスタマーサービス導入企業は、平均対応時間20〜40%短縮の効果も出ています。

主なメリットは下記の通りです。

精度・品質の向上

AIは大量データの高速処理が得意ですが、曖昧なケースには弱点があります。HITLによって人間が出力を検証・修正し、全体の精度や品質が格段にアップします(例:請求書や契約情報の重要項目検証)。

バイアス低減・倫理リスクの制御

AIは訓練データのバイアスを引き継ぐリスクがあります。HITLなら人間がバイアスを認知し修正できるため、人材採用や融資、保険等の公平性検証にも最適です。

透明性と説明責任の担保

人がAI出力を確認し承認する流れで、意思決定の説明責任や透明性も確保。ユーザーや規制当局、社内からの信頼性アップに直結します。

規制・標準への適合

EU AI法など最新規制で「高リスクAIへの人間監督」が義務化されています。HITLならリーガル、ヘルスケア、金融などでも安心してAI活用できます。

業務効率化にも寄与するハイブリッド型

HITLは遅いどころか効率的な自動化実現へ。AIが定型を自動処理、人は例外やイレギュラーのみ集中。労力削減と精度維持の両立が可能です(例:高信頼データは自動転送、例外は人確認)。

Gartnerも、「2025年にはリーガルテック自動化の30%に人間監督機能搭載」と予測。企業が信頼できるAIのためHITLにシフト中です。

要するにHITLはAIの限界克服ツールではなく、信頼性・実用性・業績を最大化する進化形。人間+AI=安心して成長できる自動化の基盤です。

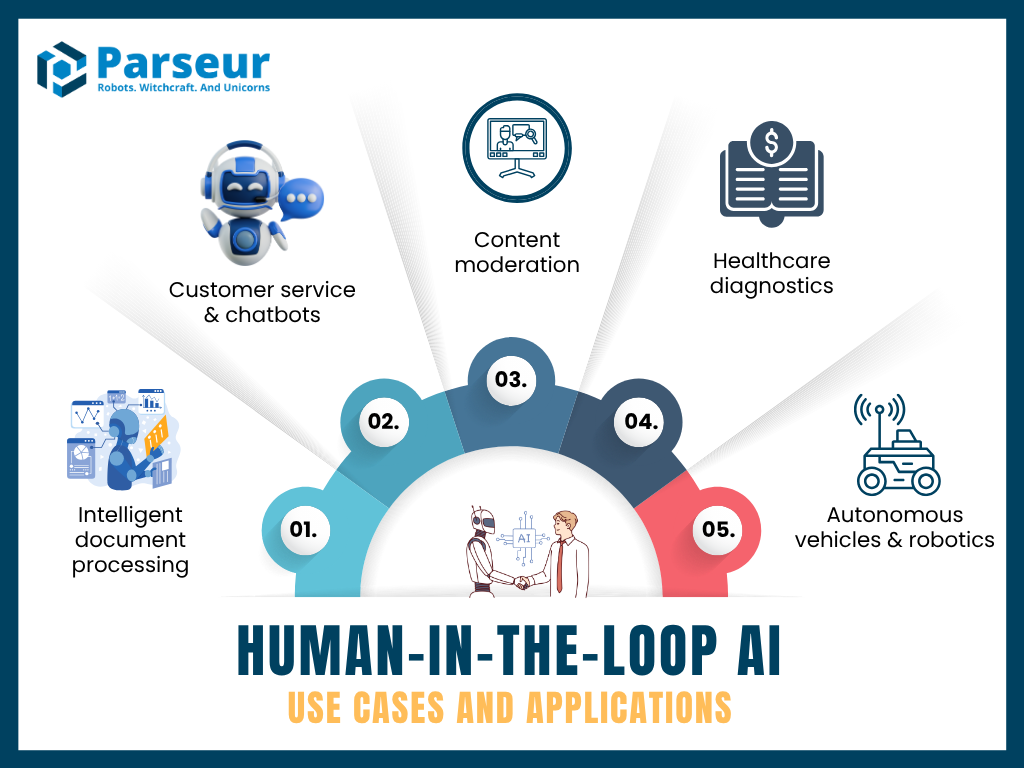

ヒューマンインザループAI(HITL)の実用例

HITL AIはすでに幅広い業界で導入効果を発揮しています。代表的な用途をご紹介します。

インテリジェント文書処理(IDP)

大量の請求書や保険金請求、申込書など、大量文書処理業務でAIがデータ抽出の大部分を担い、人間が低信頼度項目のみ補完。財務・法務データの高精度抽出やコンプライアンス維持が可能です。Parseurもこの領域で強みをもちます。

Tely.aiによれば、HITL検証により正確率99.9%に到達する事例も。

カスタマーサービス・チャットボット

AIチャットボットは大量の問い合わせを一次対応とし、複雑な応対や微妙なニュアンスは人間担当へ。AI一般対応→例外のみ人に自動エスカレーションを実現します。

Sekagoによると、HITLによる"人間ハンドオフ"で顧客満足度35%向上・離脱率20%減も報告されています。

コンテンツモデレーション

AIが大量のヘイトスピーチや不適切情報を自動検知、グレーゾーンは最終的に人間が判断します。スピード×人間の文脈力で安全性強化。

SEO Sandwichによれば、AIの自動モデレーションで88%の有害コンテンツは検出可能ですが、5〜10%は人間による精査が必須です。

医療診断サポート

医用画像や検査データ解析はAIが高速対応、自信度低い異常は医師判断。HITLにより患者安全や誤診防止に大きく寄与します。

Nexus Frontierによると、HITL型医療診断でAI単独92%、人単独96%、HITLで99.5%精度という報告も。

自動運転・ロボティクス

自動運転やロボティクス領域ではhuman-on-the-loop型の人間監督で異常時介入が必須。路上のイレギュラーや障害時は人間による判断で安全性を担保します。

Finance Buzzによると、2024年の自動運転車事故件数は前年比約2倍の544件となり、「実運用での人間監督の重要性」が増していることを示しています。

そのほかのHITL活用分野

- サイバーセキュリティ: AIがアラート→人間が詳細分析

- 金融: アルゴ取引の異常検知→人間が最終判断

- リーガルテック: AI文書選別→弁護士が確認

- 営業: AIがリード抽出→重要案件のみ営業担当フォロー

各業界のHITL事例や専門家の見解は本記事の引用やボックス参照を。

HITLがすべての業種で重要な理由

各種研究により、HITLは金融・医療など「ひとつのミスが致命傷となる領域」で説明責任・信頼性確保に不可欠と証明されています。例えば医療では誤診防止、金融では不正取引の防止に人間レビューが重要です。

Jorieによれば、医療現場のヒューマンエラーの約86%が手作業・過去の作業慣習に起因しており、HITL AIが精度とコンプライアンス強化に貢献しています。

自動化×人間=現代型信頼性の標準が浸透しつつあります。

課題とベストプラクティス

HITL AIには大きな利点がある一方、最大活用にはいくつかの課題も。ここでは主な課題と推奨される対応策をまとめました。

Big Data Wireも指摘する通り、**生成AI導入の最大障壁は「人材不足」(55%)と「コスト増」(48%)**です。

スケーラビリティ・コスト課題

HITLは人間関与箇所が増えるほどコストや処理時間が増加します。

対応策: 人手を必要なケース(例外値・曖昧予測・監査のみ)に集中。アクティブラーニングなどで「人の価値最大化ゾーン」を選定。

人的な誤りやバイアス

人間レビューにもヒューマンエラーや主観バイアスが起きるリスク。

対応策: 役割・基準の明確化、定期的トレーニング。重要工程は2名以上でレビュー。AI・人双方の精度管理と継続改善で質向上。

どの判断をループ化すべきか

全判断を人で確認すると非効率になりやすい。

対応策: 高リスクや重大ケースのみHITL導入、定型や低リスク作業は完全自動化。 運用基準明確化でメリハリあるプロセスへ。

システム統合設計の工夫

人手監督と自動化ワークフローが分断されると逆に混乱を招く可能性。

対応策: Parseurのようなヒューマン監督対応AI基盤を利用し、スムーズな人間レビュー・迅速なフィードバックができる設計を。

Premier Marketing GroupのRob Gundermann氏も、HITL設計や教育不足が現場混乱のリスク要因と指摘しています。

プライバシー・法令遵守リスク

ヒューマンレビュー担当者による「機密データ」取り扱いリスク。

対応策: 外部委託時は厳格なアクセス制御・NDA・安全環境の確保とともにGDPRやHIPAAなど規制順守も徹底。

HITL最大化には「介入ポイント明確化」「最適人材選定」「適切なツール提供・教育支援」が鍵。効果測定(精度や削減率等)の継続も重要です。

**NIST AIリスクマネジメントフレームワーク**等に沿った「高リスクAIへの人間監督」設計構築がベストプラクティスです。

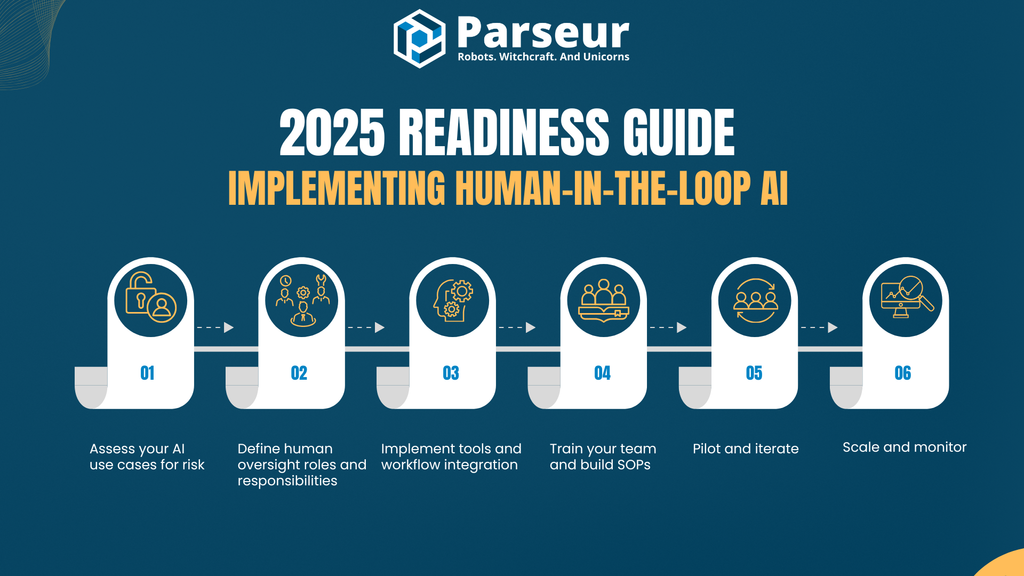

2026年最新版:ヒューマンインザループAI導入ガイド

2026年、各業界でAI活用が進むなか、ヒューマンインザループ(HITL)型体制の準備は必須です。コンプライアンス・信頼性・精度の3つを叶えられるのがHITLの強み。以下の流れがHITL AI導入成功のカギです。

ステップ1:AI活用領域のリスク評価

自社のAI利用箇所を整理し、**重大判断・コンプライアンス領域(法務・財務・顧客対応等)**を特定。ここにHITL監督を組み込みましょう。

ステップ2:人間監督範囲と責任の明確化

「誰がHITL担当なのか(データアナリスト、法務、現場など)」「AI決定をどこまで上書きできるか」などの役割・権限も明示化。混乱防止に役立ちます。

ステップ3:ツール・ワークフロー統合

HITL対応ツール(Parseur等)を利用し、人間によるレビューや承認を自動トリガーで管理。適切なタイミングで人間が介入できる設計を。

ステップ4:トレーニング・SOP整備

HITL担当への教育(AI出力の見方・介入基準・作業マニュアル化)を実施し、継続的教育も。

ステップ5:パイロット運用&改善

小規模から運用を始め、精度・リードタイム・負荷等の効果測定を行い、柔軟に基準調整。

ステップ6:拡大展開&継続モニタリング

成功例を展開しつつ、モニタリング・フィードバック・法令遵守で運用改善を繰り返しましょう。

2026年なぜHITLが必要か

AIガバナンスやEU AI法など規制強化の潮流のなか、HITLは責任あるAI・高精度AIの根幹となります。

法令順守だけでなく、高精度・信頼・拡張性あるAI構築こそHITLの本質です。

過去2年で大規模言語モデルがAIワークフローを劇的に刷新しました。Parseurの顧客は既にAIによるすべてのデータ抽出作業を自動化し、前例のないスピードとスケールを実現しています。ただ、AIも万能ではなく例外処理やイレギュラーは人間の判断と監督が不可欠です。ここでヒューマンインザループ(HITL)の真価が発揮されます。定型の95%はAIに、重要な5%は専門家レビューへ。双方の強みを活かせるからこそ、「信頼できるエンドツーエンド自動化」が成立します。

まとめ

ヒューマンインザループAIは、完全自動化と人手作業の間にある強力な中間解です。AIライフサイクルの重要な局面に人間の判断を取り入れることで、精度・コンプライアンス・信頼性の高い自動ワークフローが構築できます。2026年以降、HITLは高リスク業界での必須要件です。

文書フロー管理、AIモデルの訓練、顧客対応の品質向上など、あらゆる局面でHITLを活用すれば、よりスマートで安全・倫理的な自動化が実現可能です。Parseurの検証型ワークフローのようなツールを活用し、「自信を持ってスケールできる」HITL体制を構築しましょう。

ヒューマン×AI協働を自社に取り入れたい方は、Parseurのインテリジェント文書処理と内蔵ヒューマン監督機能が「いいとこ取り」の答えです。

最終更新日