Vad är datakvalitet?

Datakvalitet handlar om hur noggrann, fullständig, konsekvent och tillförlitlig information är för det syfte den används till. I automatiserade miljöer är detta ännu viktigare eftersom maskiner agerar direkt utifrån den data de tar emot, utan att ifrågasätta dess riktighet.

Viktiga slutsatser

- Verktyg som Parseur gör det möjligt att skala automation med ren, compliant och handlingsbar data.

- Ramverk som VACUUM och ECCMA (Electronic Commerce Code Management Association) ger struktur för att säkra tillförlitlig data.

- AI, validering och rengöringstekniker stärker noggrannheten och tilliten i automation.

Dålig datakvalitet är kostsamt. Studier pekar på att bristfällig eller ofullständig data kostar företag miljontals dollar varje år på grund av ineffektivitet, risker för bristande efterlevnad och felaktiga affärsbeslut. I takt med att automation ökar blir kostnaderna och riskerna än större. Principen garbage in, garbage out (GIGO) gäller även här: matas systemen med felaktig data kommer resultaten att bli därefter.

Enligt Resolve resulterar manuell databehandling i fel på 3–5 %, men automation kan sänka denna siffra till 0,5–1,5 %, vilket innebär en 60–80 % minskning av dyra misstag inom bara sex månader efter införande. Det visar tydligt sambandet mellan datakvalitet och effektivitet inom automation. Samtidigt understryker det kravet på noggrann datakvalitet – eftersom även små fel, när de upprepas i automatiserade flöden, kan bli mycket kostsamma. Faktum är att dålig datakvalitet står för upp till 20–30 % av årliga intäktsförluster och kostar USA:s ekonomi 3,1 biljoner dollar per år, enligt Techment.

Därför har datakvalitet i automation blivit ett fokusområde för företag som investerar i AI-driven dokumenthantering och intelligenta processer. Datakvalitet handlar om noggrannhet, men också om konsekvens, tillförlitlighet och förtroende. Brister här innebär att automationen aldrig kan leverera sitt fulla värde.

I denna artikel går vi igenom grunderna för att upprätthålla hög datakvalitet i automatiserade system. Vi tittar på ramverk som VACUUM och ECCMA, typiska utmaningar som GIGO, samt praktiska lösningar – från AI-baserad tolkning och automatiserad validering till mänskliga granskningar som säkerhetsnät. Målet: hjälpa ditt företag att automatisera på en bas av ren, tillförlitlig och handlingsbar data.

Vad är datakvalitet?

God datakvalitet kännetecknas av:

- Noggrannhet – värden är korrekta (t.ex. att beloppet på en faktura stämmer med verkligheten).

- Fullständighet – alla nödvändiga fält är ifyllda (t.ex. både start- och slutdatum i ett kontrakt).

- Konsekvens – samma information presenteras enhetligt mellan olika system (t.ex. ett kund-ID matchar i både CRM och ERP).

- Tillförlitlighet – datan är aktuell och hämtad från trovärdiga källor.

När automationssystem behandlar data av hög kvalitet fungerar arbetsflöden smidigt, beslut fattas snabbare och antalet fel minskar. Bristfällig datakvalitet medför risk för dubbletter, missad efterlevnad och felaktiga affärsinsikter – problem som kan eskalera snabbt i automatiserade flöden.

Sammanfattningsvis säkerställer datakvalitet i automation att varje automatiserad process bygger på pålitlig information. Utan detta kan varken avancerad AI eller maskininlärning leverera optimala resultat.

Varför datakvalitet är avgörande i dokumentautomatisering

Datakvalitet är mer än en teknisk fråga – det är affärskritiskt. Automatiserade arbetsflöden som drivs av data av låg kvalitet ger problem som snabbt kan spridas i hela organisationen.

Effektivitet

- Felaktig data saktar ner automation, kräver manuella kontroller och ger flaskhalsar.

- Omjobb och manuella rättningar blir dyra och tar tid.

Kostnad

- MIT Sloan beräknar att dålig datakvalitet kostar företag 15–25 % av omsättningen i form av bortkastade resurser, ineffektiva processer och förlorade affärsmöjligheter.

- Fel förstoras snabbt i automatiserade miljöer.

Efterlevnad

- Felaktig data i avtal, fakturor eller vårdformulär riskerar att bryta lagar eller föreskrifter, vilket kan leda till böter och juridiska problem.

Kundförtroende

- Felaktiga fakturor, dåligt hanterade ärenden eller bristfälliga leveranser minskar tilliten och skadar varumärket.

Automation förstärker dessa risker: dålig data sprids snabbt och leder till större och mer omfattande problem än manuella processer. Det påminner oss om den gamla sanningen – garbage in, garbage out.

VACUUM-modellen: Ramverk för datakvalitet

VACUUM-modellen är ett av de ledande ramverken för att mäta och utvärdera datakvalitet. Den identifierar sex kärndimensioner för att avgöra om data är tillförlitlig och användbar i automatisering.

- Giltig (Valid): Data följer rätt format eller regler (t.ex. att ett datum har det korrekta formatet på en faktura).

- Noggrann (Accurate): Uppgifterna överensstämmer med verkligheten (ex. patient-ID stämmer med journalen).

- Konsekvent (Consistent): Samma data ser likadan ut mellan system (leverantörsnamn stavas lika på fakturor och i avtal).

- Enhetlig (Uniform): Dubbletter undviks, så att exempelvis samma order inte behandlas flera gånger.

- Enad (Unified): Mått, valutor och format är standardiserade (använder alltid samma valuta).

- Meningsfull (Model): Datan är relevant och användbar för sitt ändamål, inte bara giltig men även betydelsefull.

Att tillämpa denna modell i automatiserad datautvinning – oavsett om det gäller fakturor, vårddokument eller fraktsedlar – gör att dina automatiserade processer bygger på pålitlig och användbar data.

Utmaningar med datakvalitet i automatiserade arbetsflöden

Att upprätthålla hög datakvalitet är en av de största utmaningarna i automation, även med avancerade verktyg. En global undersökning från Precisely 2025 visar att 64 % av organisationerna ser just datakvalitet som sitt största hinder för att dra nytta av automatisering – och 67 % medger att de inte litar fullt ut på sin data vid viktiga beslut.

Detta medför reella risker. Monte Carlos rapport visar hur en shipping-plattform led av återförda, felaktiga automationsdata, vilket gav missvisande maskininlärning, felaktiga budprognoser och allvarliga systemavbrott. Under ett år blev det 400 dataincidenter, 2 400 timmar dataavbrott och €2,7 miljoner i effektivitetstapp – med konkurs som slutresultat.

Vanliga utmaningar

- Ostrukturerad data: Fakturor, avtal och formulär inkommer i olika format och språk, vilket försvårar tolkning och extraktion.

- Mänskliga fel: Stavfel, saknade fält eller inkonsekvent datafältning orsakar fel som snabbt eskalerar genom automatisering.

- Skalningsutmaningar: Vad som fungerar för 100 dokument kan bli ohanterligt vid 100 000, då små fel ger stora följdeffekter.

- Otillräcklig validering: Brist på automatiska kontroller släpper igenom felaktiga ID, datum eller belopp.

Garbage In, Garbage Out (GIGO)

GIGO är grundprincipen som beskriver att bristfällig input ofrånkomligt leder till dålig output, även i automatisering. Exempel på GIGO-problem i automation:

- Röriga eller ostrukturerade format: Skannade PDF:er, handskrivna dokument eller tvetydiga fakturor kan feltolkas av automatiska system.

- Mänskliga inmatningsfel ända från början: Ett felaktigt kund-ID kan ge fel transaktioner eller förlorade leveranser.

- Inkonsekvent data: Olika format på datum, valutor och mått försvårar alla automatiseringsflöden och orsakar feltolkningar.

- Skalningsproblem: Manuella fel på enstaka poster kan kanske rättas — i stor volym multipliceras misstagen och ökar risken för större affärsförluster.

Exempel:

- Fakturahantering: En OCR tolkar “$1,249.99” som “$12,499.9”. Utan validering blir resultatet feltolkad bokföring.

- Vårdformulär: Ett felaktigt patient-ID kan ge fel i journaler och skapa efterlevnadsproblem.

- Fraktdokument: En otydlig streckkod ger fel leveransadress, vilket leder till förseningar och missnöje.

Slutsats: utan starka och automatiserade kvalitetskontroller, validering, datarengöring och mänsklig granskning kan automation fördubbla felaktigheterna i organisationens dataflöden.

ECCMA-standarder och ISO 8000 för global datakvalitet

Förutom ramverk behövs standarder som gör att data kan tolkas och användas lika säkert oavsett organisation och bransch. ECCMA (Electronic Commerce Code Management Association) tar fram globala datakvalitetsstandarder, som garanterar konsekvens, interoperabilitet och compliance.

ECCMA har bland annat utvecklat ISO 8000, världens ledande standard för datakvalitet. Standarderna beskriver hur masterdata ska utformas, hanteras och utbytas för att säkerställa global tillförlitlighet. Genom att följa ECCMA kan automatiserade processer alltid leverera data som är maskinläsbar, semantiskt korrekt och interoperabel med andra system.

Därför är ECCMA-standarder avgörande:

- Konsekvens mellan system: Data från fakturor och avtal kan röra sig problemfritt mellan t.ex. ERP, CRM och bokföring utan konflikter.

- Noggrannhet och tillförlitlighet: Standardiserade format kräver tydliga regler kring struktur, vilket minskar risken för tolkningsfel.

- Revisionsbarhet: Internationella standarder säkrar revisionsspår och efterlevnadskrav — särskilt i reglerade sektorer.

Ett praktiskt exempel: en faktura som hanteras i ett ECCMA-anpassat system får automatiskt rätt struktur och metadata så att bokföringssystem och andra automatiserade verktyg tolkar datan korrekt.

Hos Parseur kombineras AI-driven extraktion med validering och ECCMA-standarder, vilket innebär att data som extraheras direkt är kompatibel, ren och redo att användas.

VACUUM vs ECCMA: Två sidor av datakvalitet

| Faktor | VACUUM-modellen | ECCMA-standarder |

|---|---|---|

| Fokus | Begreppsligt ramverk för att bedöma datakvalitet. | Internationella standarder för att skapa, hantera och utbyta högkvalitativ data (ISO 8000). |

| Omfång | Bedömer om utvunnen data är lämplig för användning. | Ger globalt erkända regler för interoperabilitet och efterlevnad. |

| Styrka | Flexibel, lätt att applicera mellan branscher och arbetsflöden. | Säkerställer standardisering mellan system och över nationsgränser. |

| Tillämpning i automation | Mäter om utvunnen data från fakturor, formulär eller avtal når kvalitetskraven. | Säkerställer att utvunnen data är strukturerad i ett universellt format som kan tolkas av eftersystem. |

AI i datakvalitetsautomation: Smartare validering & felhantering

Artificiell intelligens har revolutionerat arbetet med datakvalitet i automation. Där manuella kontroller och statiska regler tidigare räckte, gör AI det möjligt att arbeta skalbart, flexibelt och smart.

Så förbättrar AI datakvalitet:

- Kontextuell validering: AI förstår sammanhang och upptäcker subtila fel som felaktiga datum, avvikande valutakoder eller ologiska värden.

- Entitetsigenkänning: Maskininlärning identifierar automatiskt viktiga fält ur ostrukturerade dokument, t.ex. totalsummor, patient-ID eller leveransuppgifter.

- Feldetekt & korrigering: AI upptäcker avvikelser och föreslår automatiska rättningar, t.ex. när momsen inte stämmer mot totalsumman.

- Lärande över tid: Med feedback-loopar blir AI-system mer träffsäkra för varje dokument.

- Flerspråksstöd: AI kan hantera data på olika språk och format, vilket ger global datakvalitet även vid automatisering.

AI gör alltså mer än att bara extrahera data – den höjer noggrannhet, konsekvens och tillförlitlighet. Detta gör AI till ett självklart val för företag som vill kunna skala automation utan att kompromissa med datakvalitet.

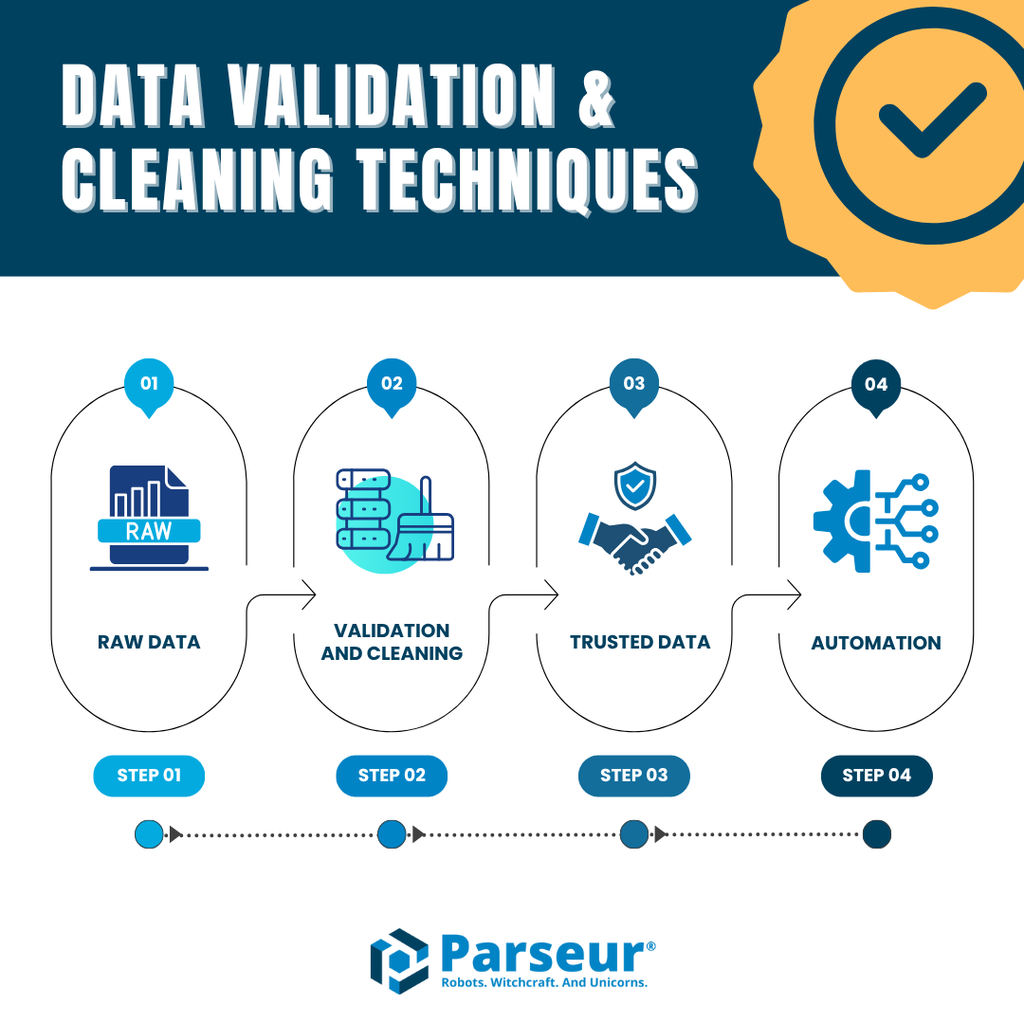

Datavalidering och rengöringstekniker

För att uppnå och bevara hög datakvalitet i automation räcker det inte med att hämta ut data – den måste även valideras och rengöras innan den används vidare.

Effektiva metoder inkluderar:

- Automatiska fältkontroller: Validerar att extraherade värden har rätt format, t.ex. att fakturasummor är numeriska, datum är giltiga och ID matchar rätt struktur.

- Dubblettdetektion: Upptäcker och eliminerar dubbla poster innan de sprids i systemen.

- Normalisering: Standardiserar värden som datum, valutor och adresser så att jämförelser fungerar mellan plattformar (t.ex. olika datumformat blir ett enhetligt).

- Felflaggning & undantagshantering: Identifierar avvikelser så som feltolkade belopp eller saknade fält innan datan skickas vidare.

- Människa-i-loopen (HITL): Vid gränsfall eller tvetydiga dokument kan snabb mänsklig granskning ge ökad precision, utan att stoppa automationen.

Moderna verktyg som Parseur förenklar dessa steg genom mallfri extraktion, inbyggd validering och integrationer mot t.ex. ERP- eller CRM-system. På så sätt blir datan automatiskt redo för vidare automatisering och beslutstagande.

Läs mer i våra guider om datavalidering och datarengöringstekniker och se hur dessa metoder stärker dina automatiserade arbetsflöden.

Så säkerställer Parseur datakvalitet

Parseur säkerställer datakvalitet i automation genom ett affärsnära, flexibelt tillvägagångssätt. Genom att inte vara beroende av mallar eller enbart OCR kombinerar Parseur AI-baserad dataextraktion med automatiserad validering, datarengöring och integration mot dina befintliga system. Utdata från Parseurs AI matchar precis de önskade fälten – och kan anpassas ytterligare med instruktioner, så att datan alltid passar verksamhetens behov.

Viktiga funktioner för optimal datakvalitet:

- Mallfri och flexibel extraktion: Läser fakturor, kvitton, avtal och leveranssedlar – utan att du behöver skapa separata regler.

- Hög noggrannhet: Parseur uppnår normalt 90–99 % fältnoggrannhet även med varierande layouter och ostrukturerad data.

- Inbyggd validering och rengöring: Identifierar dubbletter, formateringsfel och avvikande värden innan datan skickas vidare.

- Breda integrationer: Skickar klara och strukturerade data direkt till Google Sheets, SQL, ERP, CRM, bokföring med mera – utan extra middleware.

Kundexempel

- Finans: Parseur hjälper till att extrahera fakturabelopp, moms-ID och betalningsuppgifter med nära 100 % precision, och minskar behovet av manuell datainmatning med upp till 80 %.

- Logistik: Företag använder Parseur för att tolka fraktsedlar och leveransdokument så att korrekta ID och adresser automatiskt hamnar i spårningssystemen.

Genom att följa ramverk som VACUUM och ECCMA:s datakvalitetsstandarder ser Parseur till att företag inte bara automatiserar dokumentflöden – utan gör det med högsta möjliga noggrannhet, tillförlitlighet och compliance.

Slutsats

Automatisering kan ge ökad snabbhet, skalbarhet och effektivitet – men bara om den bygger på ren, konsekvent och tillförlitlig data. Bristfällig datakvalitet hotar både effektiviteten och företagets trovärdighet, medan metoder som VACUUM, ECCMA, AI-validering och mänsklig granskning kan göra automationen till en verklig konkurrensfördel.

Slutligen: varje automatiserat beslut är beroende av datans kvalitet. Att investera i bra datakvalitet är därför avgörande för att garantera att automationen blir korrekt, compliant och pålitlig.

Med Parseur får du automation där datakvalitet är högsta prioritet – alltid noggrann, tillförlitlig och redo för globala krav. Oavsett om du hanterar fakturor, patientformulär eller fraktdokument ger Parseur din automation rätt data från början.

Senast uppdaterad