Viktiga Slutsatser

- Dataextraktion kan ge röriga resultat som kräver validering och efterbearbetning om de inte designas noggrant.

- En tillförlitlig pipeline bör inkludera schemavalidering, normalisering, textstädning, tabellfixar, deduplicering och kontinuerliga kvalitetskontroller.

- Verktyg som JSON Schema, Pydantic, Pandas och Great Expectations stärker och automatiserar efterbearbetningen.

- Parseur API hjälper till att snabbt fånga och strukturera data så att teamen kan fokusera på kvalitet och analys.

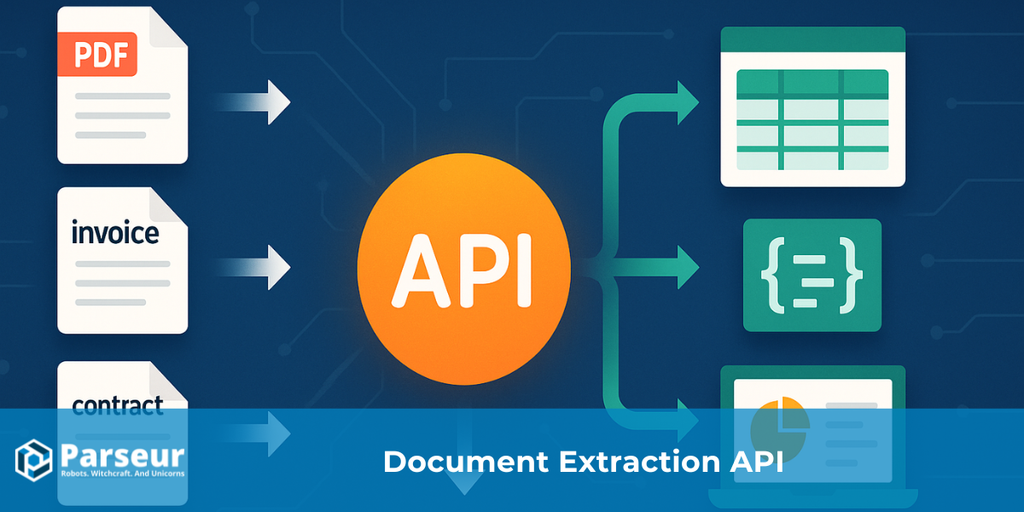

Datastädningstekniker handlar om att korrigera, standardisera och validera den rådata som returneras av API:er. Även om extraktionsverktyg omvandlar ostrukturerade filer som PDF, bilder eller e-post till strukturerade format såsom JSON eller CSV, innehåller resultaten ofta inkonsekvenser, nullvärden, felaktiga datatyper, dubbletter eller formateringsfel. Städarbetet säkerställer att datasetet matchar det avsedda schemat och kan användas för rapportering, analys och vidare arbetsflöden.

En aktuell fallstudie från DataXcel visade att 14,45% av de extraherade telefonuppgifterna var ogiltiga eller inaktiva. Det understryker vikten av robusta datastädningsmetoder för att minimera fel och skydda kvaliteten på extraherade data.

API:er som extraherar data från exempelvis PDF, bilder eller e-post returnerar ofta strukturerad information i JSON- eller CSV-format. Detta underlättar vidare bearbetning, men datan är sällan felfri. Det är vanligt att team möter saknade värden, inkonsekventa rubriker, blandade datatyper, dubbletter eller fel i datumformat. Om dessa brister inte hanteras hotar de rapporternas tillförlitlighet och påverkar ekonomiska beslut.

Den här guiden beskriver en praktisk arbetsgång för att förvandla röriga extraktioner till tillförlitliga dataset: validera, standardisera, berika, testa och logga. För team som hanterar data från e-postbilagor och PDF-filer förenklar Parseur insamlingen, så att ni kan fokusera på städning och kvalitetssäkring.

Vill du veta mer om hur ett dataextraktions-API fungerar från början till slut, se vår kompletta guide: Vad är ett dataextraktions-API för dokument?

Olika typer av datastädningstekniker

När du har extraherat data via ett dataextraktions-API innehåller originalresultaten ofta inkonsekvenser, saknade värden, formateringsproblem eller dubbletter. Även om API:er förvandlar ostrukturerade filer till strukturerade format som JSON eller CSV, krävs noggrann städning för att göra datan pålitlig.

Enligt Harvard Business Review uppfyller bara 3% av företagsdata grundläggande kvalitetskrav och 47% av nyproducerad data innehåller minst ett kritiskt fel. Sådana kvalitetsbrister innebär verkliga konsekvenser – Gartner uppskattar att bristande datakvalitet kostar företag i snitt 15 miljoner dollar om året.

Effektiva datastädningstekniker är centrala för att säkerställa att informationen är korrekt, konsekvent och klar för analys. Några centrala tekniker inkluderar:

Validering och felkontroll

Säkerställ att extraherad data följer förväntade format, som rätt datum, siffror eller e-postadresser. Detta förebygger felaktigheter i analys och rapportering, och säkerställer att dataextraktions-API:et levererar pålitliga resultat.

Standardisering

Gör data konsekvent genom att normalisera format, till exempel telefonnummer, adresser eller datum. Det underlättar sammansättning och analys av olika databaser.

Hantering av saknade värden

Beroende på datas syfte kan null- eller saknade värden hanteras genom att fylla, interpolera eller radera poster.

Deduplicering

Ta bort dubbletter som kan dyka upp vid upprepade API-anrop eller överlappande datakällor. Deduplicering förbättrar precision och trovärdighet.

Dataförbättring (Data Enrichment)

Berika data genom att lägga till kontext – till exempel geografiska uppgifter eller kategoriseringar – för ökad användbarhet.

Format- och typkorrigering

Åtgärda inkonsekventa eller felaktigt formaterade fält, konvertera till rätt datatyper, rätta stavfel och standardisera valutor för att stärka datakvaliteten.

Loggning och granskning

Följ upp alla städinsatser för att övervaka kvalitén på API-extraktionerna och säkra dataintegritet över tid.

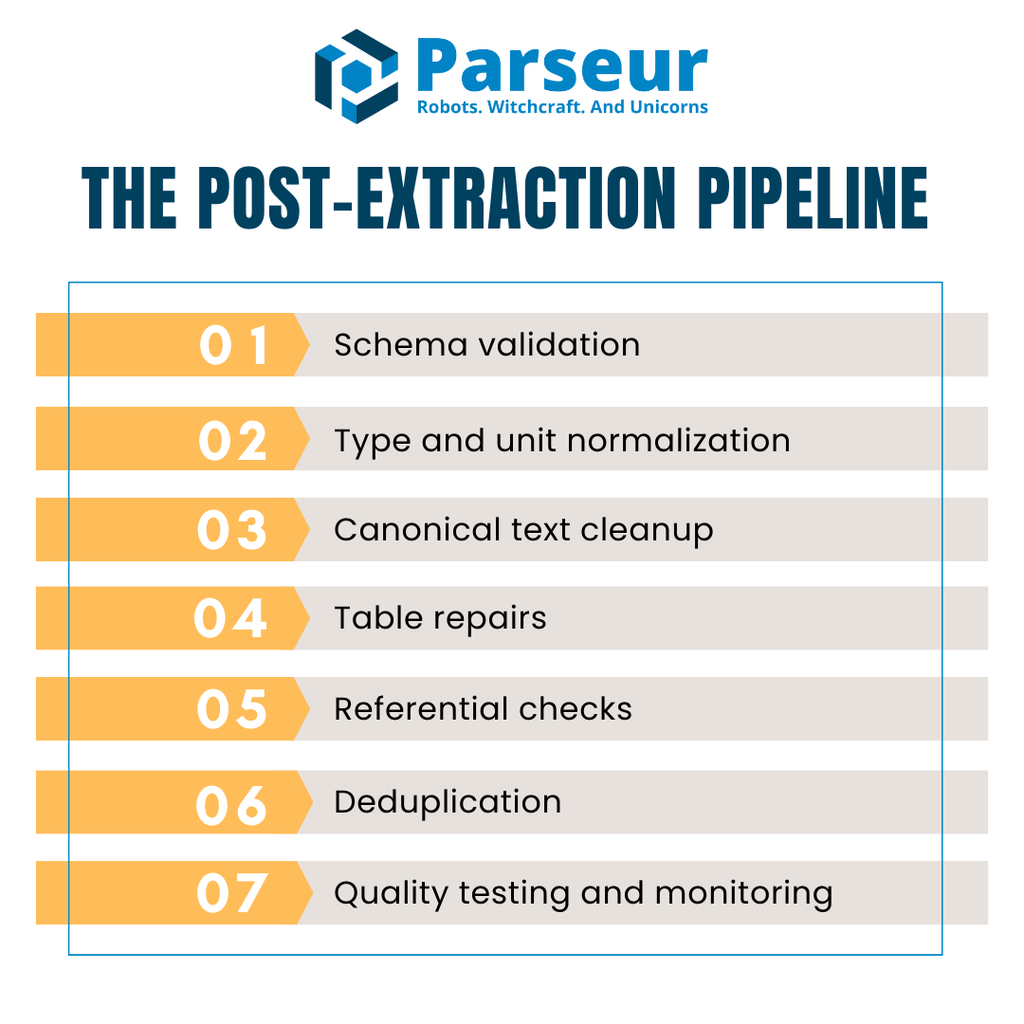

Översikt: Efterbearbetningspipeline

Data som hämtats via API är sällan redo för att användas direkt i analys eller rapporter. Rådata innehåller ofta saknade fält, felaktiga typer, inkonsekventa tabeller eller dubbletter. För att inte skicka problemen vidare krävs en upprepbar och strukturerad pipeline för varje datapart.

En robust pipeline efter extraktion inkluderar vanligtvis dessa steg:

- Schemavalidering – Kontrollera att inkommande JSON eller CSV har rätt struktur innan bearbetning.

- Normalisering av typ och enhet – Korrigera datatyper, hantera saknade värden och standardisera enheter eller format.

- Standardisering av text – Normalisera strängar, hantera versaler/gemener och rätta Unicode-avvikelser.

- Tabellkorrigeringar – Sammanställ rubriker, justera rader och avstäm totalsummor, exempelvis i flerlinjiga fakturor.

- Referenskontroller – Validera relationer mellan datasets, som leverantörer eller valutor.

- Deduplicering – Ta bort dubbletter utan att rensa bort äkta unika poster.

- Kvalitetstest och övervakning – Automatisera tester så fel snabbt upptäcks och inte förorenar produktionsdata.

För högkapacitetsbearbetning används ofta kolumnära format som Apache Arrow eller Parquet under städningen. Det ger bättre minneshantering och snabbare bearbetning av stora datasamlingar.

För hög datakvalitet och konsistens – bygg pipelinen som en kedja: API → Validering → Städning → QA → Datalager. På så sätt kan organisationer undvika kostnader och framtida kvalitetsproblem.

Steg 1: Validera mot schema (Ta bort skräp tidigt)

Det initiala steget vid datastädning är schemavalidering. Här säkerställs att data är maskinläsbar och strukturellt korrekt. Utan detta riskerar du att fel slinker igenom och ställer till problem längre fram.

JSON Schema (Draft 2020-12) är en standard som stöds av många bibliotek och verktyg. Med den kan du definiera allt från datatyper till obligatoriska fält och formatregler. Exempel: invoiceDate måste följa ISO 8601, total ska vara ett icke-negativt tal.

I Python kan Pydantic v2 användas för effektiv runtime-validering och generering av JSON Schema. Modellering av exempelvis fakturor tvingar fram rätt fältstruktur och ger fel direkt vid avvikelse – såsom att vendorName är en sträng, invoiceNumber matchar regex och currency finns bland godkända koder.

Valideringsregler bör inkludera mer än format. Specificera constraints som uppräknade värden, regex för specialfält (ex. skatte-ID) och numeriska intervall som skyddar mot dolt slarv som annars riskerar att spridas.

Planera även för ogiltiga poster – vissa organisationer avvisar dem direkt, andra skickar dem till särskilda granskningsflöden. Oavsett metod ger det tidig upptäckt och endast pålitlig data förs vidare.

Steg 2: Rätta datatyper, nullvärden och enheter

När datan validerats enligt schema, är det dags att säkerställa rätt typning, hantering av saknade värden och normalisering av enheter. Även strukturerade extrakt från API kan innehålla strängar som borde vara siffror, felaktiga datum, null-fält eller blandade enheter. Om detta ignoreras påverkas kvalitén och rapporternas säkerhet.

Med Parseur API kan du automatiskt extrahera data från fakturor, kvitton och e-post direkt till JSON med minimalt manuellt arbete. Realtidswebhooks skickar datan till ERP, CRM eller databaser vilket snabbar upp processen innan ytterligare valideringsregler tas i bruk. Därmed sänks mängden fel redan i starten av pipelinen.

Börja med att konvertera alla fält till rätt datatyp. Quantity eller unitPrice blir numeriska, datumfält ISO-standardiseras, och booleanfält sätts till true/false. Hantera sedan saknade värden genom att antingen ta bort rader, fylla med lämpliga default-värden eller flagga poster för granskning. Dokumentera alltid valda regler för återanvändbarhet och transparens.

Med Pandas kan du använda olika inbyggda funktioner som to_numeric(errors="coerce"), to_datetime(), fillna() och dropna() för dessa steg. Dessa säkerställer rätt typ och entydig hantering av nullvärden.

Att typa, rätta och normalisera skapar en stabil grund för vidare textstädning, tabellfixar och referensgranskningar.

Steg 3: Standardisera text (Namn, versaler/gemener, Unicode)

När numeriska och datumfält är åtgärdade flyttas fokus till textdata – ofta den rörigaste komponenten. Variationer i stavning, versaler/gemener och teckenkodning kan fragmentera viktig information som leverantörsnamn.

Först rensar du whitespace och extra skiljetecken. Ta bort inledande/avslutande mellanslag, slå ihop flera mellanslag, rätta onödig interpunktion. Tillämpa därefter konsekventa skrivregler: företagsnamn i title case, statusfält i versaler för entydig jämförelse.

Unicode-normalisering är särskilt viktig för globala data. Identiska tecken kan lagras olika, så standardisera med exempelvis NFKC-normalisering. Vid namnmatchning kan diakritiska tecken tas bort för konsistens ("Café" och "Cafe").

Bygg gärna en lista för standardisering av centrala fält såsom leverantörsnamn – exempelvis "AB" till "Aktiebolag" – eller utnyttja maskininlärda modeller för att lösa mer avancerad entitetsupplösning.

Standardisering av text säkrar jämförbarhet mellan datakällor och minskar risk för dubbletter och splittrade poster.

Steg 4: Reparera tabeller (säkerställ tydlighet och summering)

Efter API-extraktion kräver radbaserade tabeller ofta särskild insats. Rubriker kan vara splittrade, värden roterade från skannade PDF:er eller kolumner hopslagna vilket försvårar analys. Säkra först att varje tabell har en tydlig rubrikrad och rätt antal kolumner utifrån ditt schema.

Justera därpå enheter, särskilt i ekonomiska dataset – omvandla till exempel kg och lbs till samma mått eller samordna valutakoder innan summering. Summera radbelopp (quantity × unit price), och validera summan mot totalbeloppet inom inställd toleransnivå. Flagga eventuella avvikelser.

Vid export till CSV hanteras ytterligare utmaningar såsom dolda avgränsare, felaktiga citattecken och kodningsfel. Använd flexibla verktyg som DuckDB för att läsa in, diagnosticera och casta kolumner korrekt – perfekt för knepiga importer där all_varchar kan skydda mot oläsliga rader innan typkonvertering.

Resultatet är att även röriga tabeller blir tydliga, jämförbara och användbara för ekonomi- och analysteam – så att inga fel eller luckor smyger sig in i rapporterna.

Steg 5: Referenskontroller & affärsregler

Problem vid datastädning visar sig ofta först vid kopplingar mellan tabeller – även när enskilda rader verkar korrekta. Referenskontroller garanterar att värden och affärsregler följs innan datan går vidare till lagret.

Exempel: varje vendorId i fakturatabellen måste finnas i leverantörsregistret. Valutakoder ska vara företagets tillåtna och skattesatser måste matcha aktuella regler. Det förhindrar tunga fel i rapporter och analyser.

Ofta kodifieras affärsreglerna direkt i transformationsverktyg – DBT testers gör det enkelt att lägga in constraints som:

- unique (unika fakturanummer)

- not_null (inga tomma vendorId)

- accepted_values (valutor såsom USD, EUR)

- relationships (främmande nycklar mot leverantörstabellen)

Automatiserad referensintegritet gör att fel upptäcks direkt, vilket sparar tid och stärker rapportkvaliteten.

Steg 6: Deduplicering och identifiering av poster

Dubbletter urholkar snabbt tilliten till data, ger upphov till dubbla summor och risk för t.ex. dublettbetalningar. Efter API-extraktion är det viktigt med en tydlig strategi för att ta bort dubbletter men skydda äkta unika poster.

Definiera deterministiska nycklar (supplierName, invoiceNumber, invoiceDate, amount, currency) för att säkert identifiera exakta dubbletter. För att fånga närapå-identiska poster, applicera fuzzy-matching – till exempel, fakturor från samma leverantör inom sju dagar och mindre än 1% skillnad i belopp kan flaggas för granskning. Bucket-metoden minskar risken för felborttagning men upptäcker suspekta rader.

Skillnaden mellan syntaktisk och semantisk matchning är viktig. Enklare regler matchar textsträngar direkt, medan mer avancerad semantisk logik (t.ex. "Acme AB" och "Acme Bolaget") kan hanteras med verktyg som OpenRefine för klustring av snarlika poster.

Balansera hårda och mjuka regler för att maximera noggrannhet och minimera fel vid deduplicering.

Steg 7: Automatisera kvalitetskontroller

Datakvalitet kräver kontinuerlig uppföljning. Nya extrakt kan när som helst föra in fel. Automatiserade tester ser till att avvikelser flaggas innan produktionsdata påverkas.

Great Expectations (GX) hjälper team att deklarera förväntningar på datamängder – t.ex. fakturanummer ska matcha ett visst mönster, kvantitet inom intervall, rimliga summeringar. Kvalitetstester i CI/CD ger omedelbar återkoppling om extrakterna håller måttet.

Pandera erbjuder en smidig väg till regler för datatyper, intervall och nullbarhet direkt på Pandas dataframes. Ett par kodrader räcker för att validera data automatiskt.

Viktigast är att synliggöra testresultaten. Skicka rapporter till dashboards eller varningssystem, så att andelen ogiltiga rader och fel snabbt kan följas upp och åtgärdas.

Med fortlöpande kvalitetskontroller håller du dina städade dataset i toppskick – redo för analys och produktion.

Prestanda- och lagringstips (så blir datastädningen ingen flaskhals)

Datastädning efter extraktion är avgörande – men den får inte bli en flaskhals. Med stora volymer fakturor, kvitton eller transaktioner kan ineffektiv städning ge långa väntetider och höga kostnader som sinkar verksamheten. Nyckeln är hög kvalitet utan att tappa fart.

Forskning från MDPI visar att datastädning kan kräva upp till 80% av en dataproffs arbetstid – ett tydligt tecken på vikten av effektivisering.

Några beprövade tips för god prestanda:

- Använd kolumnära format – Format som Apache Arrow och Parquet ger snabbt städning och låg minnesanvändning. De är kompatibla med vanliga analysramverk.

- Batcha och parallellisera – Kör bearbetningen i batchar eller som asynkrona processer för bättre resurseffektivitet.

- Flytta tunga operationer till datalagret – För riktigt stora CSV:er eller komplexa joins: låt DuckDB eller ditt datalager göra grovjobbet.

- Cacha mellanresultat – Spara delresultat där upprepade kontroller används, så slipper du onödig dubbelprocessering.

- Övervaka resurser – Följ CPU, minne och I/O för att tidigt upptäcka svaga punkter innan de påverkar servicenivån.

En välbalanserad städpipeline främjar både kvalitet och tempo – så undviker ni flaskhalsar och håller pipelinen redo för realtidsrapportering.

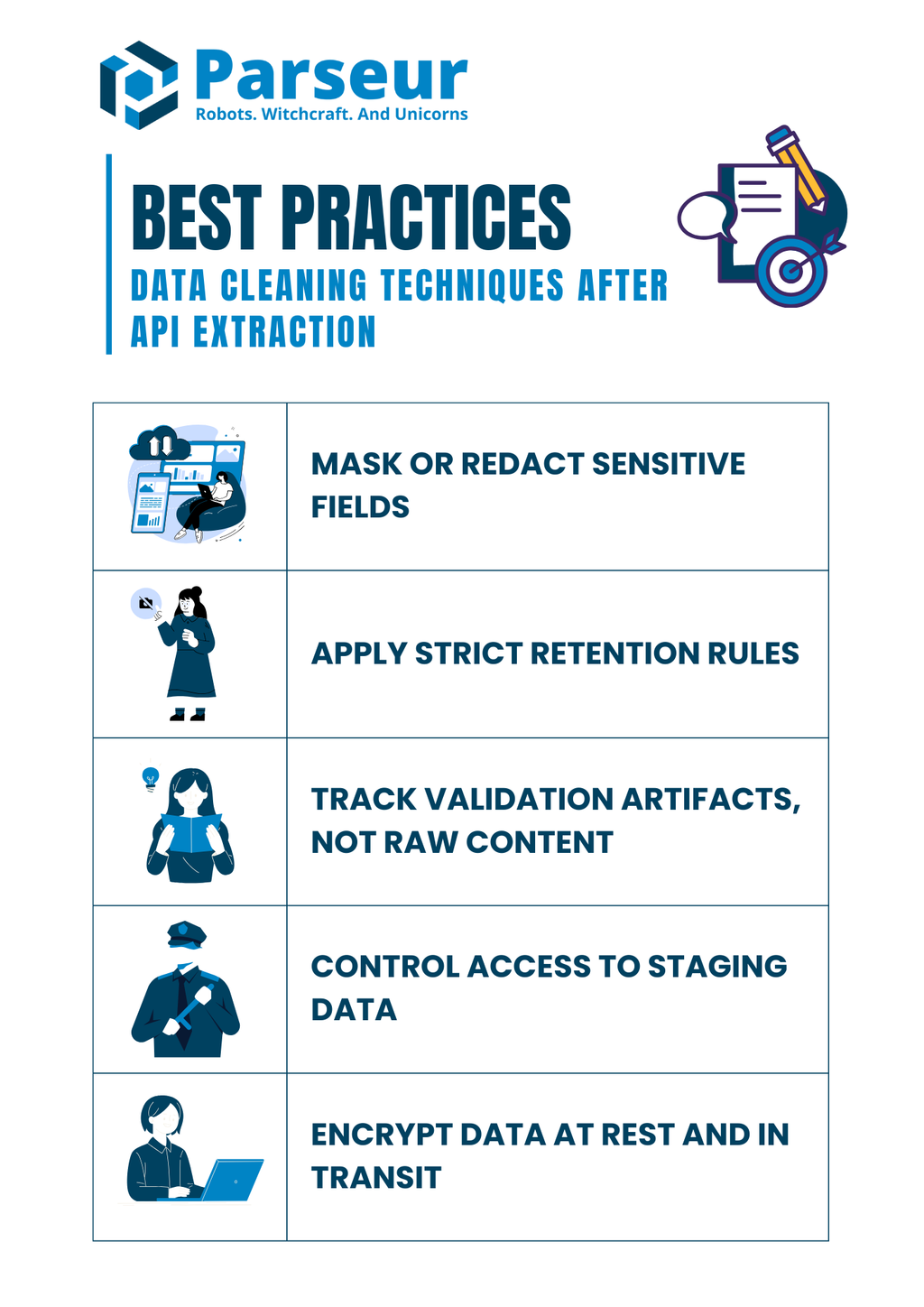

Säkerhet och regelefterlevnad (stryk inga skyddskontroller)

Datastädning handlar inte bara om korrekthet – den är också avgörande för regelefterlevnad. Extraherade dokument kan innehålla känsliga data såsom bankuppgifter, skatteinformation och personnummer. Felhantering i städningen kan skapa risker redan innan data ens lagras.

Mitratech visar att 61% av organisationer råkar ut för dataläckor, ineffektivitet och regelefterlevnadsproblem kopplade till bristande datastyrning. Därför behöver regelefterlevnad integreras i varje steg av datastädningen.

Viktiga åtgärder:

- Maskera känsliga fält – Logga aldrig exempelvis personnummer, kontonummer eller kortuppgifter som klartext. Maskera eller hasha dessa i loggar.

- Sätt strikt lagringstid – Lagra inte råextraktad data längre än nödvändigt – anpassa retention till regler och praxis.

- Bevara valideringsresultat, inte rådata – Documentera varför poster fallerar (exempelvis saknade fält, fel datumformat) men lagra aldrig känsliga originalvärden i loggar.

- Begränsa åtkomst till mellanlagrad data – Använd rollstyrd åtkomst så att endast behöriga hanterar data i staging.

- Kryptera data i vila och under överföring – All temporär och beständig lagring, samt loggning, ska vara krypterad för att skydda mot obehörig åtkomst.

Teknisk städning och compliance-bestämmelser måste gå hand i hand – detta ger skydd mot sanktionsavgifter och inger förtroende hos kunder och tillsyn.

Arbetsflödesexempel (så knyts allt ihop)

För att visa i praktiken hur stegen fungerar går vi igenom ett enkelt exempel där validering, normalisering, avstämning och testning integreras direkt i arbetsflödet. Tänk dig att du använder Parseur API för att extrahera fakturor från PDF eller e-post – Parseur levererar en färdigstrukturerad JSON för smidig start.

Exempel på extraherad JSON (input):

{

"invoiceNumber": "INV-001",

"invoiceDate": "2025/08/15",

"vendorName": "Acme, Inc.",

"lineItems": [

{ "description": "Widget A", "quantity": "10", "unitPrice": "5.00" },

{ "description": "Widget B", "quantity": "3", "unitPrice": "12.50" }

],

"total": "87.50"

}

Steg 1: Validera schema med Pydantic:

from pydantic import BaseModel, Field

from datetime import date

from typing import List

import pandas as pd

# Definiera modell för radpost

class LineItem(BaseModel):

description: str

quantity: int

unitPrice: float

# Definiera modell för faktura

class Invoice(BaseModel):

invoiceNumber: str

invoiceDate: date

vendorName: str

lineItems: List[LineItem]

total: float

# Exempel på rå JSON-sträng

raw_json = """

{

"invoiceNumber": "INV-001",

"invoiceDate": "2025-08-15",

"vendorName": "Acme, Inc.",

"lineItems": [

{ "description": "Widget A", "quantity": 10, "unitPrice": 5.00 },

{ "description": "Widget B", "quantity": 3, "unitPrice": 12.50 }

],

"total": 87.50

}

"""

# Parsar JSON till Invoice-modell

invoice = Invoice.model_validate_json(raw_json)

# Normalisera radposter till Pandas DataFrame

df = pd.DataFrame([item.model_dump() for item in invoice.lineItems])

df["amount"] = df["quantity"] * df["unitPrice"]

# Kontrollera totalsumma

if round(df["amount"].sum(), 2) != invoice.total:

print("Matchningsfel: radposter summerar inte till fakturans total")

else:

print("Summor stämmer ✅")

print(df)

Steg 3: Kör kvalitetstester med Great Expectations:

import great_expectations as gx

# Initiera Great Expectations-kontext

context = gx.get_context()

# Ladda Pandas DataFrame till batch

batch = context.sources.pandas_default.read_dataframe(df)

# Hämta validator för att köra expectations

validator = batch.get_validator()

# Sätt regler

validator.expect_column_values_to_be_between("quantity", min_value=1, max_value=1000)

validator.expect_column_values_to_be_between("unitPrice", min_value=0, max_value=10000)

validator.expect_column_sum_to_be_between("amount", min_value=0, max_value=100000)

# Kör validering och få resultat

results = validator.validate()

print(results)

Utdata (städad):

- Fakturadata är schemavaliderad.

- Datum och siffror har rätt datatyper.

- Summor är avstämda mot toleransgräns.

- Kvalitetstester bekräftar intervall och struktur.

Exemplet visar hur du snabbt går från rörig API-data till tillförlitlig, validerad och kvalitetstestad information redo för produktion och analys.

Datastädningstekniker är bara en del i din datapipeline – första steget är korrekt extrahering och strukturerad datahantering. Där är Parseur ovärderligt. Med Parseurs användarvänliga plattform och flexibla API kan du samla in data från PDF, e-post, kalkylblad och bilagor – och minska behovet av manuellt städarbete. När datan är insamlad applicerar du städteknikerna från denna guide för att skapa en pålitlig grund för analys.

Framöver spår Gartner att 70% av nya molnplattformar 2026 kommer baseras på sammanhållna clouddatamiljöer, inte manuella integrationer. Detta ökar kraven på ren, standardiserad data och smarta API-drivna arbetsflöden.

Vill du ha helhetsbilden? Läs vår guide om hur API:er förändrar dokumenthantering – från verktygsval till optimering av hela processflödet. Ta del av vår fulla guide om Data Extraction APIs for Documents och gå säkert från rådata till kvalitetssäkrat analysunderlag.

Senast uppdaterad