Vad är GIGO?

GIGO (Garbage In, Garbage Out) är en grundläggande princip inom datoranvändning, automatisering och artificiell intelligens som betyder att kvaliteten på utdata helt beror på kvaliteten på indata.

Viktiga slutsatser:

- GIGO (Garbage In, Garbage Out) betyder att dåliga data alltid ger dåliga resultat, oavsett system.

- Dåliga data dränerar automatiseringens avkastning på investering genom förluster, risker och skadat anseende.

- Parseur levererar tillförlitlig automatisering med exakt parsning och HITL-kontroller.

Enligt Shelf förlorar företag i genomsnitt 12–15 miljoner dollar årligen på grund av dålig datakvalitet, och vissa stora företag rapporterar förluster på upp till 406 miljoner dollar varje år. Men bakom de glansiga ROI-prognoserna finns en tyst bov i dramat: dåliga data. I genomsnitt urholkar dåliga data 12 % av företagets intäkter och kan göra att organisationer missar 45 % av potentiella leads på grund av problem som dubbletter, ogiltig formatering eller föråldrad kontaktinformation. När felaktiga indata kommer in i automatiserade arbetsflöden stannar de inte bara där; de multipliceras och skapar större och dyrare problem längre ned i kedjan.

När automatiseringssystem förlitar sig på data av dålig kvalitet når upp till 87 % aldrig produktion på grund av olösta datakvalitetsutmaningar, enligt VentureBeat. Detta hinder stoppar inte bara projekt; det undergräver förtroendet för AI i sig. Dessutom säger Huble att 69 % av företagen rapporterar att dåliga data hindrar tillförlitliga AI-beslut och insikter. Det är här principen Garbage In, Garbage Out (GIGO) kommer in. Enkelt uttryckt betyder GIGO att om automatisering börjar med data av dålig kvalitet kommer utdata oundvikligen att vara opålitliga, oavsett hur avancerad AI:n eller systemet är.

I världen av automatisering och AI (GIGO i AI) är denna princip mer än bara ett varnande ord; det är en hård verklighet. Utan skydd för datakvalitet riskerar automatisering att bli en förstärkare av fel snarare än ett verktyg för effektivisering. Därför har organisationer som inte prioriterar tillförlitliga data ofta svårt att se en meningsfull avkastning på investering från sina automatiseringsprojekt.

Vad är Garbage In, Garbage Out (GIGO)?

Begreppet Garbage In, Garbage Out (GIGO) kommer från tidig datavetenskap. Det betyder att om ett system matas med felaktiga, ofullständiga eller inexakta data, kommer resultatet oundvikligen att vara felaktigt. Bara en felmarginal på 15 % i träningsdata kan allvarligt försämra modellprestanda och potentiellt ge farliga resultat inom vissa områden, enligt Sama. Med andra ord: dålig indata = dålig utdata.

Varför är GIGO viktigt nu?

I AI:s och automatiseringens tidsålder är insatserna mycket högre. Traditionella datorfel kan förstöra en enstaka rapport eller beräkning. Men i moderna automatiseringssystem förblir ett litet misstag inte litet; det skalar. Till exempel:

- Ett felavläst fakturadatum kan leda till tusentals försenade betalningar.

- Partiska träningsdata i en AI-modell ger partiska prognoser i stor skala.

- Ett inkonsekvent kund-ID sprider fel över ERP-, CRM- och supportplattformar.

GIGO då vs. GIGO nu

- Traditionell datoranvändning: Att mata in dåliga data i en kalkylator eller ett program gav ett felaktigt men isolerat svar.

- Modern automatisering/AI: Dåliga data i ett system replikeras över arbetsflöden, datamängder och beslutsprocesser. Fel multipliceras, efterlevnadsrisker ökar och avkastningen på investering försämras.

Kostnaden för dåliga data i automatisering

Dåliga data är inte bara en olägenhet; de hotar direkt automatiseringens avkastning på investering. Gartner visar att dålig datakvalitet kostar organisationer i genomsnitt 12,9 miljoner dollar per år. När dessa felaktiga indata matar automatiserade arbetsflöden utan mänskliga kontrollpunkter, försvinner inte felen bara; de multipliceras, vilket dramatiskt ökar risk och kostnad.

Viktiga risker för företag

Felaktiga fakturor → ekonomiska förluster

En enda felavläst eller duplicerad faktura kan leda till överbetalningar, försenade betalningsindrivningar eller bokföringsavvikelser.

Felaktiga logistikdata → förseningar i leveranser

Fel adresser, inkonsekventa landskoder eller saknade fält stoppar leveranser och urholkar kundernas förtroende.

Fel patientdata → efterlevnads- och säkerhetsrisker

Inom sjukvården riskerar felaktiga patientidentifierare eller felmatchade journaler överträdelser av HIPAA och, ännu viktigare, patientsäkerheten.

Hur dåliga data dränerar automatiseringens avkastning på investering

- Slösade pengar → Investeringar i AI-, RPA- och automatiseringsverktyg misslyckas med att leverera värde eftersom de underliggande indata inte går att lita på.

- Dubbelarbete → Team lägger 70–80 % av projekttiden på att rensa data i stället för att bygga hållbar automatisering.

- Efterlevnadssanktioner → I reglerade branscher kan ett enda fel utlösa böter, rättsprocesser eller misslyckade revisioner.

- Förlorat förtroende → Kunder, tillsynsmyndigheter och anställda tappar förtroendet för system som upprepade gånger gör misstag.

Viktigt att komma ihåg: Utan att hantera datakvalitet accelererar automatisering inte effektiviteten; den accelererar risk och kostnad.

Vanliga källor till skräpdata

Dåliga data är inte bara en olägenhet; de hotar direkt automatiseringens avkastning på investering. Även om man kanske tror att de flesta datafel är sällsynta, målar Zipdo upp en annan bild: nästan 70 % av företagsdata är “smutsiga eller opålitliga.” För automatisering räcker det för att spåra ur hela processer.

De vanligaste källorna till skräpdata i automatisering:

Manuella inmatningsfel

Stavfel, saknade fält eller felplacerade decimaltecken kan göra att ekonomi, efterlevnadskontroller eller leveransspårning blir felaktiga.

Dålig OCR-noggrannhet

Suddiga skanningar, handstil eller PDF-filer med låg upplösning leder till felavlästa tecken (t.ex. blir “5” till “8”), vilket resulterar i felaktiga fakturor eller bristfälliga medicinska journaler.

Dubbletter och inkonsekventa format

En kund som listas som “Acme Corp” i ett system och “Acme Inc.” i ett annat → dubblettprofiler, dubbelfakturering eller trasig rapportering.

Brist på valideringskontroller vid inläsning

Utan regler som upprätthåller format (som datum = YYYY-MM-DD eller giltiga landskoder) slinker ogiltiga poster igenom obemärkt och bryter nedströms arbetsflöden.

Utforska vår detaljerade guide om Datakvalitet i automatisering.

Varför automatisering inte fixar dåliga data (den multiplicerar dem)

En av de största missuppfattningarna i digital transformation är att automatisering ska “städa upp” röriga data. I verkligheten är automatisering inte ett filter; den är en accelerator. Vad du än matar in i den bearbetas snabbare, inte nödvändigtvis bättre. År 2026 identifierar 64 % av organisationerna datakvalitet som sin största integritetsutmaning, och 77 % bedömer sin datakvalitet som genomsnittlig eller sämre, vilket betyder att de flesta automatiseringar multiplicerar fel snarare än rättar till dem, enligt Precisely.

- Exempel inom finans: Om ett fakturabelopp är fel på grund av dålig OCR-avläsning ifrågasätter inte automatiseringen det; den betalar helt enkelt fel leverantör snabbare och i stor skala.

- Exempel inom logistik: En enda felaktig adress kan få konsekvenser i tusentals automatiserade leveranser, vilket leder till förseningar, kostnader för omleveranser och arga kunder.

- Exempel inom AI: Stora språkmodeller (LLM:er) “vet” inte sanningen i sig; de genererar resultat baserat på de data de tränats på. Om dessa data är partiska, ofullständiga eller felaktiga kommer utdata att återspegla och förstärka dessa brister.

Detta är kärnan i Garbage-in, Garbage-out-automatisering: ett litet fel i inmatningssteget blir ett enormt problem när det multipliceras över automatiserade arbetsflöden.

GIGO i AI: Moderna utmaningar

“Garbage in, garbage out” får en ny nivå av risk i AI-driven automatisering. Till skillnad från traditionella regelbaserade system fungerar AI-modeller som svart låda; de producerar utdata utan att alltid visa hur besluten fattades. Det gör kvaliteten på tränings- och indata helt avgörande.

Varför GIGO i AI är särskilt farligt:

- Opacitet i svart låda → När resultaten är fel är det svårt att spåra felet tillbaka till felaktiga data.

- Datapartiskhet → Partiska eller ofullständiga datamängder skapar systemproblem, från orättvisa lånebeslut till snedvridna rekryteringsrekommendationer.

- Efterlevnadsrisker → Känsliga branscher som vård och finans kan drabbas hårt om AI-system misstolkar reglerade data, vilket leder till GDPR-böter, HIPAA-brott eller misslyckade revisioner.

- Skadat anseende → Kunder tappar snabbt förtroendet när AI-system ger partiska, missvisande eller osäkra resultat.

Skyddet: Human-in-the-Loop (HITL)

HITL-granskning lägger till ett viktigt lager av övervakning i AI-arbetsflöden. Organisationer kan fånga upp misstag innan de skalar genom att låta människor bekräfta otydliga extraktioner, granska känsliga data eller korrigera kontextuella fel.

Denna hybrida modell med automatisering plus HITL säkerställer att AI förblir tillförlitlig, transparent och förenlig med regelverk, och förvandlar en högrisk-svart låda till ett system som företag kan lita på.

Hur man förebygger GIGO: Bästa praxis

Det goda nyheten är att Garbage In, Garbage Out (GIGO) i automatisering kan förebyggas. Genom att tillämpa strukturerade ramverk, standarder och skyddsåtgärder kan organisationer säkerställa att deras automatisering körs på rena, tillförlitliga och förenliga data.

1. Tillämpa VACUU-modellen

VACUU-modellen (Valid, Accurate, Consistent, Uniform, Unify, Model) erbjuder en praktisk checklista för att bygga datamängder av hög kvalitet. Varje del stärker direkt automatiseringen genom att göra indata mer tillförlitliga.

2. Anamma ECCMA-standarder

Electronic Commerce Code Management Association (ECCMA) tillhandahåller globala standarder för datakvalitet som hjälper organisationer att upprätthålla interoperabilitet, konsekvens i metadata och efterlevnad. Att följa ECCMA:s bästa praxis säkerställer att data är strukturerade för både mänsklig och maskinell användning.

3. Använd automatiserad validering + hantering av avvikelser

Ställ in automatiska valideringsregler vid inläsningspunkten (t.ex. kontroll av fakturabelopp mot inköpsorder, validering av datumformat). Kombinera detta med hantering av avvikelser, så att fel flaggas i stället för att tyst passera vidare till nedströms arbetsflöden.

4. Integrera Human-in-the-Loop (HITL)-övervakning

Automatisering är kraftfull, men processer med höga insatser som finansiella transaktioner, medicinska journaler eller regulatoriska inlämningar kräver HITL-granskning. Detta säkerställer att kantfall, tvetydiga data eller efterlevnadskänsliga fält verifieras innan fel multipliceras.

Hur Parseur hjälper företag att undvika GIGO

Även om principen garbage-in, garbage-out (GIGO) belyser riskerna med dåliga data, är den verkliga frågan hur företag kan förhindra det i praktiken. Det är här Parseur kommer in.

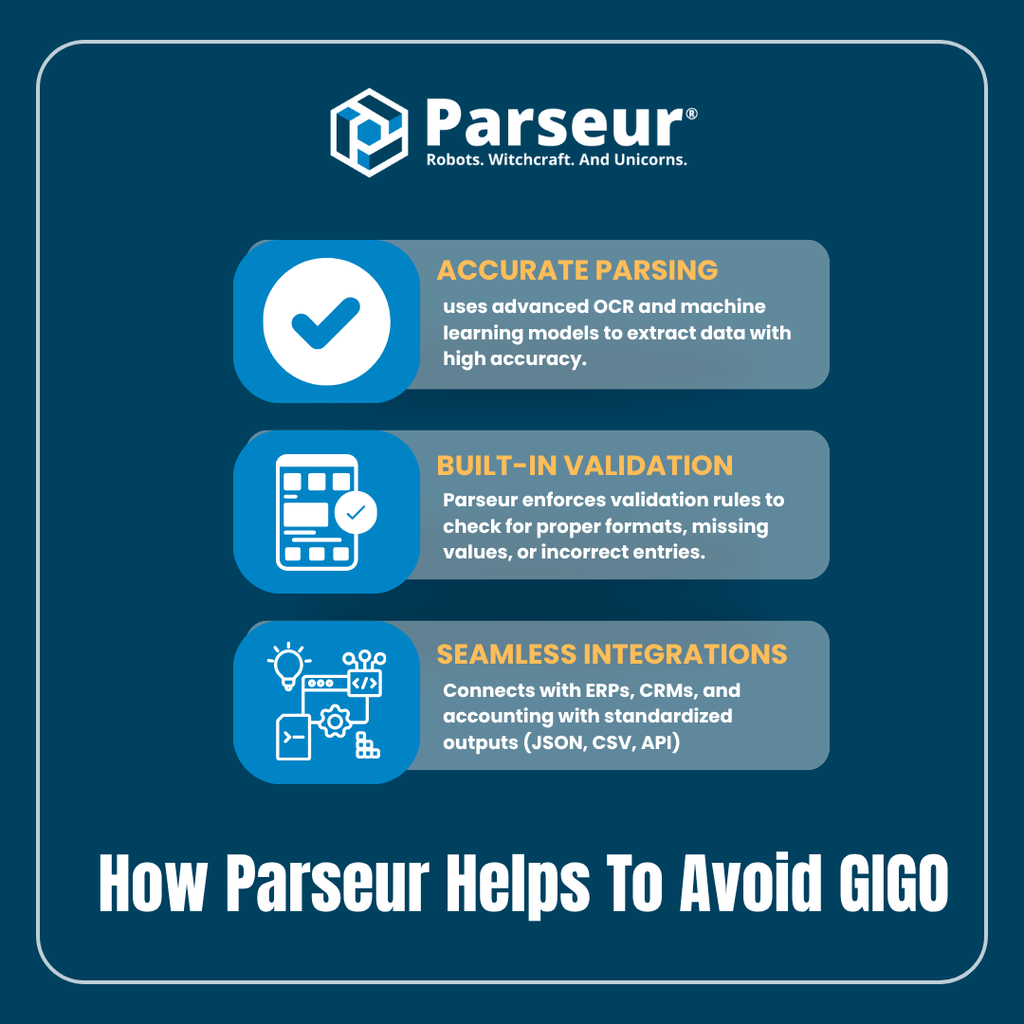

1. Exakt parsning med AI OCR + maskininlärning

Parseur använder avancerade OCR- och maskininlärningsmodeller för att extrahera data från fakturor, e-post, kvitton, fraktdokument och medicinska formulär med hög noggrannhet. Genom att träna modeller på domänspecifika data minimerar Parseur vanliga fel som felavlästa tecken eller felplacerade fält.

2. Inbyggd validering och formatering

Utöver extrahering tillämpar Parseur valideringsregler för att kontrollera korrekta format, saknade värden eller felaktiga poster. Till exempel:

- Säkerställa att datum följer ISO-format (YYYY-MM-DD).

- Normalisera valutor till en enda standard (t.ex. “USD” i stället för “$”, “US Dollars”).

- Flagga totalbelopp som inte stämmer överens med radartiklar.

Detta garanterar konsekvens och enhetlighet i arbetsflöden.

3. Sömlösa integrationer mellan system

Parseur ansluter direkt till ERP-system, CRM-system och bokföringsplattformar och standardiserar utdata automatiskt till format som CSV, Excel, JSON eller API-slutpunkter. Detta säkerställer att data inte bara flödar in i automatiseringspipelines; de förblir konsekventa i alla nedströms system.

Bygga automatisering som företag kan lita på

Garbage In, Garbage Out (GIGO) är inte bara en teknisk kliché; det är den avgörande faktorn mellan framgång och misslyckande i automatisering. Oavsett hur avancerad AI, RPA eller arbetsflödessystemet är, är automatisering bara så stark som de data som matar den. Dåliga indata stannar inte kvar i det fördolda; de sprider sig genom hela processer och leder till bortkastade investeringar, efterlevnadsrisker och förlorat förtroende.

Företag som ignorerar datakvalitet ökar felen i stället för att lösa dem. Omvänt låser organisationer som prioriterar rena, verifierade och meningsfulla data upp automatiseringens verkliga löfte: snabbhet, noggrannhet och skala utan kompromisser.

Med Parseur behöver företag inte välja mellan effektivitet och tillförlitlighet. Dess intelligenta parsningmotor, inbyggda valideringsregler och valfri övervakning med mänsklig inblandning säkerställer att varje automatiserat arbetsflöde körs på tillförlitliga data. Resultatet: automatisering som ger avkastning på investering, driver tillväxt och bygger förtroende mellan team, kunder och tillsynsmyndigheter.

Senast uppdaterad