Datakvalitet inom masterdatahantering (MDM) handlar om de processer och regler—rensning, matchning och berikning—som förvandlar rådata till korrekta och enhetliga masterposter, redo för användning i hela organisationens system.

Masterdatahantering kräver data av hög kvalitet för att fungera effektivt. Oavsett om du förbereder data för rapportering, analys eller maskininlärning innehåller rådata ofta inkonsekvenser, dubbletter och ofullständiga uppgifter.

Viktigaste insikterna:

- Högkvalitativ data är grunden för pålitlig masterdatahantering, exakta analyser och effektiv maskininlärning.

- Rensning, matchning och berikning omvandlar systematiskt rådata till konsekventa och tillförlitliga masterposter.

- Verktyg som Parseur förenklar datautvinning, normalisering och integration, vilket effektiviserar MDM-processerna och minskar det manuella arbetet.

Tillförlitlig masterdatahantering och träffsäkra maskininlärningsresultat bygger på kvalitetsdata. Rådata tenderar dock att innehålla skrivfel, inkonsekvenser, dubbleringar eller saknade värden—problem som kan underminera analys, rapportering och affärsbeslut. Hög datakvalitet är inte bara tekniskt viktig, utan ett affärskritiskt krav. När företag förlitar sig på inkonsekvent, ofullständig eller dubblerad data påverkas allt från ekonomi till kundupplevelse och verksamhetsanalys.

Enligt KeyMakr kostar dålig datakvalitet företag i genomsnitt 12,9 miljoner dollar årligen på grund av ineffektivitet och fel, vilket tydligt visar den ekonomiska effekten av bristfällig datahantering. I USA uppgår förlusterna till hela 3,1 biljoner dollar—ungefär 20% av det totala affärsvärdet—enligt 180 OPS. Det understryker hur datautmaningar påverkar verksamheter på bred front. Därför är systematiska satsningar inom datakvalitetshantering och masterdatahantering numera nödvändiga. Investeringar i rensning, matchning och berikningsprocesser minskar inte bara förluster utan skapar en robust grund för analys, rapportering och maskininlärningsinitiativ.

Dessutom visar Graphite note att endast 10–20% av datasets i AI-projekt når den datakvalitet som krävs för säkra maskininlärningsresultat, och att så mycket som 80% av tiden kan gå åt till att rensa och förbereda data innan analys och modellkörning.

Varje avsnitt nedan beskriver enkla “rå → regel → rensad”-arbetsflöden som kan tillämpas direkt på dina datamängder, samt checklistor som hjälper ditt team att systematiskt lyfta datakvaliteten—allt för att säkerställa effektiv masterdatahantering och lyckade ML-projekt, med en inblick i hur verktyg som Parseur kan automatisera hela processen.

Varför är datakvalitet viktigt för MDM och ML?

Hög datakvalitet är avgörande för tillförlitlig masterdatahantering och exakta maskininlärningsresultat. Bristande kvalitet får effekter genom system, arbetsflöden och beslutsstöd. Centrala konsekvenser:

- Modellnoggrannhet: Felaktig data kan leda ML-modeller fel och skapa oriktiga beslut eller prognoser.

- Rapporteringsförtroende: Dubbletter eller felposter minskar tilltron till BI-rapporter och operativ statistik.

- Automationssäkerhet: Automatiserade processer, som fakturering eller kundaviseringar, kräver korrekt data för att fungera som tänkt.

- Lägre driftkostnader: Lågkvalitativ data kan orsaka manuellt återställande av felaktiga poster, såsom dubbla kundkonton, vilket blir dyrt och tidskrävande.

Investeringar i datakvalitet gör system, rapporter och modeller tillförlitliga, hållbara och effektiva, samtidigt som risk och manuell arbetsbörda minskar.

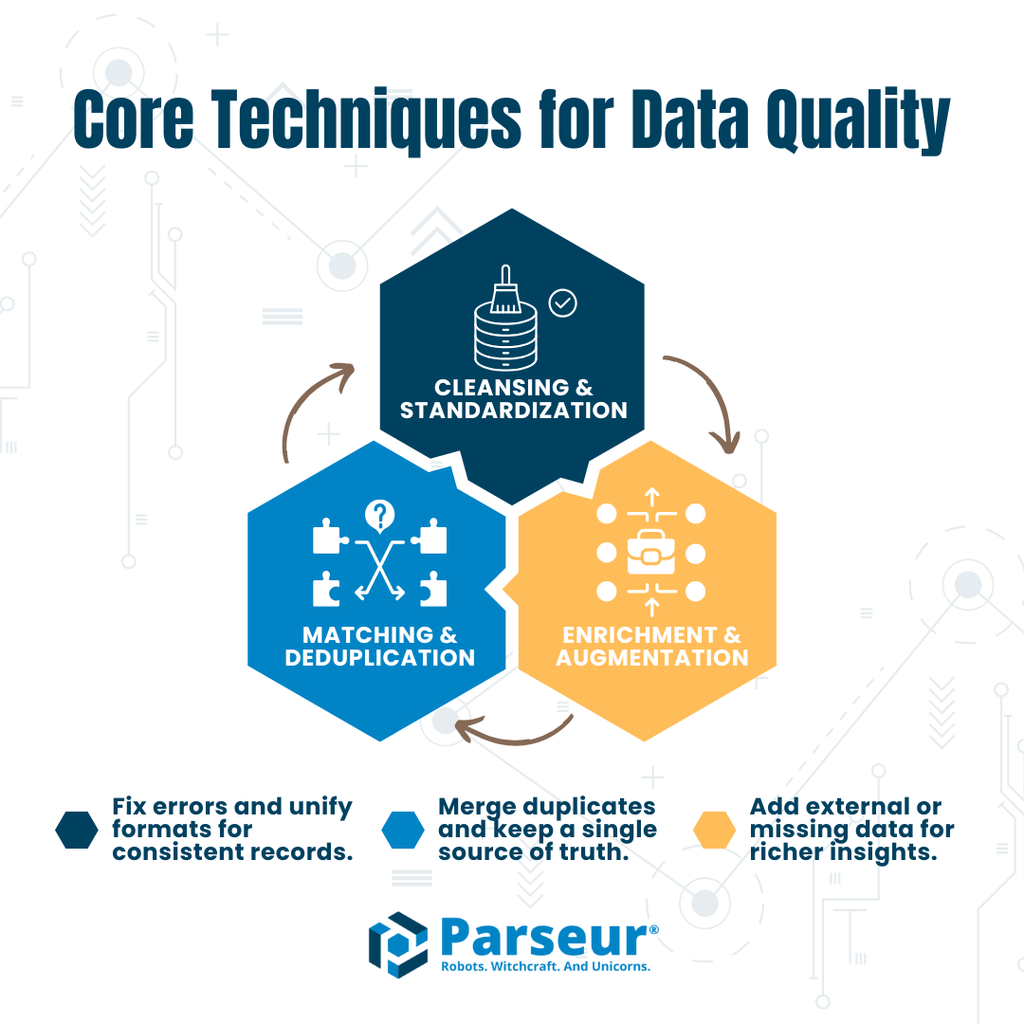

Grundläggande tekniker för datakvalitet

Datakvaliteten inom masterdatahantering förbättras med tre centrala tekniker. Dessa adresserar olika utmaningar vid transformationen av rådata till pålitliga masterposter.

Översikten nedan summerar pelarna, med länkar till användbara exempel och praktiska regler:

- Rensning och standardisering – Korrigera fel, enhetliggör format och struktur för att skapa en solid bas.

- Matchning och deduplicering – Hitta och slå ihop dubbletter eller likvärdiga poster för att producera en enda sanningskälla.

- Berikning och augmentering – Lägg till saknad information och extern data för att maximera fullständighet och värde.

Tillsammans utgör dessa tekniker ett arbetsflöde som säkerställer hög datakvalitet i MDM, analys och ML-initiativ.

Rensning och standardisering

Rensning och standardisering ser till att data är enhetlig, maskinläsbar och direkt användbar i masterdatahantering och ML. Vanliga processer:

- Normalisering: Gör data konsekvent, t.ex. versaler/gemener, skiljetecken och förkortningar.

- Parsing: Delar upp uppgifter som namn eller adresser i strukturerade fält.

- Fältstandardisering: Omvandlar datum, telefonnummer m.m. till gemensamma format.

Exempel 1 – Adress:

- Rå: ACME Ltd., 1st Ave, NYC

- Regel: Expandera förkortningar och dela upp fälten

- Rensad: ACME Ltd. | 1 First Avenue | New York, NY 10001

Exempel 2 – Telefonnummer:

- Rå: +44 20 7946 0958

- Regel: Normalisera till E.164-format

- Rensad: +442079460958

Med systematiska regler minskas fel, sök- och matchningsnoggrannheten förbättras och organisationen får ett robust underlag för MDM och analys.

Matchning och deduplicering

Matchning och deduplicering säkerställer att MDM-systemet håller en korrekt post per enhet, och eliminerar dubbletter och inkonsekvenser. Två huvudsakliga arbetsmetoder:

- Deterministisk matchning: Exakt träff på nyckelfält, t.ex. skattenummer, e-post, kontonummer. Ger säker match men kan missa små variationer.

- Fuzzy matchning: Poängsätter likheter på namn, adresser, telefonnummer och annat, för att upptäcka nära dubbletter och möjliggör manuell granskning vid osäkerhet.

Exempel 1 – Deterministisk:

- Rå: Skattenummer 123-45-6789 i flera rader

- Regel: Exakt match på normaliserat skattenummer → sammanslagning

- Rensad: Ett masterpost

Exempel 2 – Fuzzy:

- Rå: Jon Smith vs John S., samma e-post, liknande adress

- Regel: Fuzzy score >0.9 slås ihop, 0.7–0.9 till manuell granskning

- Rensad: En unik post efter genomgång

Beslutstabell för fuzzy matchning:

| Fuzzy-poäng | Åtgärd |

|---|---|

| > 0.95 | Sammanslag |

| 0.80–0.95 | Manuell granskning |

| < 0.80 | Ingen match |

Kombinera deterministiska och fuzzy-regler med "human-in-the-loop"-granskning för att identifiera dubbletter och säkerställa trovärdig och komplett masterdata för vidare analys, rapportering och automatisering.

Berikning och augmentering

Berikning förädlar rådata genom att tillägga extern information, skapa nya fält eller beräkna affärsnyttiga mått, för att göra datamängder mer omfattande och användbara. Typiska tekniker:

- Tredjepartsdata: Lägg till organisationsegenskaper, geografier eller demografi.

- Härledda fält: Skapa attribut som kundlivstidsvärde eller riskindikationer.

- Affärsregel-baserad berikning: Exempelvis, härled land utifrån landskod på telefonnummer.

Exempel – Adressberikning:

- Rå: 123 Main Street, Springfield

- Regel: Lägg till geokoordinater och regionkod

- Berikad: 123 Main Street | Springfield | IL | 62701 | Latitud: 39.7817 | Longitud: -89.6501

Berikning hjälper MDM-poster att bli mer informativa och användningsklara för analys, maskininlärning och daglig verksamhet.

Automation och arbetsflödesmönster

Effektiv datakvalitetshantering kombinerar automation med mänsklig kvalitetssäkring för att skapa och bevara högkvalitativa masterposter i stor skala. Vanliga arbetssätt:

- Batchrensning: Schemalagda processer—dagligen eller veckovis—som massbearbetar och standardiserar data samt tar bort dubbletter systematiskt.

- Streaming / realtidsvalidering: Validera data kontinuerligt så fort den matas in, stoppa fel redan innan datan lagras.

- Manuell steward-kö: Poster som misslyckas med regler eller ligger nära fuzzy-trösklar skickas för mänsklig kvalitetssäkring.

Automatiska regler löser det repetitiva arbetet, såsom normalisering och fuzzy matchning, medan människor fokuserar på undantag och högriskposter. Det här hybrida tillvägagångssättet möjliggör tillförlitlig och effektiv masterdatahantering och säkrar datakvaliteten för analys- och ML-ändamål.

Mätetal och uppföljning (DQ KPI:er)

För att långsiktigt styra datakvaliteten krävs tydliga och mätbara indikatorer. Centrala KPI:er för MDM och ML-förberedelse är:

- Fullständighet: Andel obligatoriska fält som är korrekt ifyllda; mål >95% för nyckeldata.

- Unikhet: Mängd dubbletter per 10 000 poster; sträva efter så lågt antal som möjligt.

- Konformitet: Överensstämmelse med standardformat för fält som datum, telefonnummer och adress.

- Noggrannhet: Kontroll med stickprov verifierade mot pålitliga källor.

- Aktualitet: Hur aktuell är datan; mäts i tid sedan senaste uppdatering och andel inaktuella poster.

Exempel på dashboard-widgets: trender för fullständighet över tid, värmekartor för dubbletter, larm för formatbrott, resultat av stickprov och indikatorer för dataaktualitet.

Genom aktiv övervakning av dessa KPI:er kan organisationen snabbt upptäcka, åtgärda och förebygga kvalitetsproblem och därigenom alltid säkerställa pålitliga masterposter för analys, rapportering och ML.

Praktiska före/efter-exempel

Nedan tre korta exempel illustrerar hur rådata transformeras med rensning, matchning och berikningsregler, i formatet rå → regel → rensad, redo att införas i automation:

- Rå: jon.smith@acme → Regel: domänvalidering & gemener → Rensad: [email protected]

- Rå: ACME Inc., 12-34 Baker St., LDN → Regel: expandera & geokoda → Rensad: ACME Inc. | 12-34 Baker Street | London, UK | 51.5074,-0.1278

- Rå: CUST#123 / John S. → Regel: splitta id+n namn, normalisera namn → Rensad: {customer_id: 123, name: "John Smith"}

Dessa exempel visar praktiska datatransformationer som höjer kvaliteten, tar bort dubbletter och skapar fullständiga och standardiserade masterposter. Genom liknande “rå → regel → rensad”-arbetsflöden kan team snabbt lyfta masterdatahanteringen och säkerställa databereddhet för analys och ML.

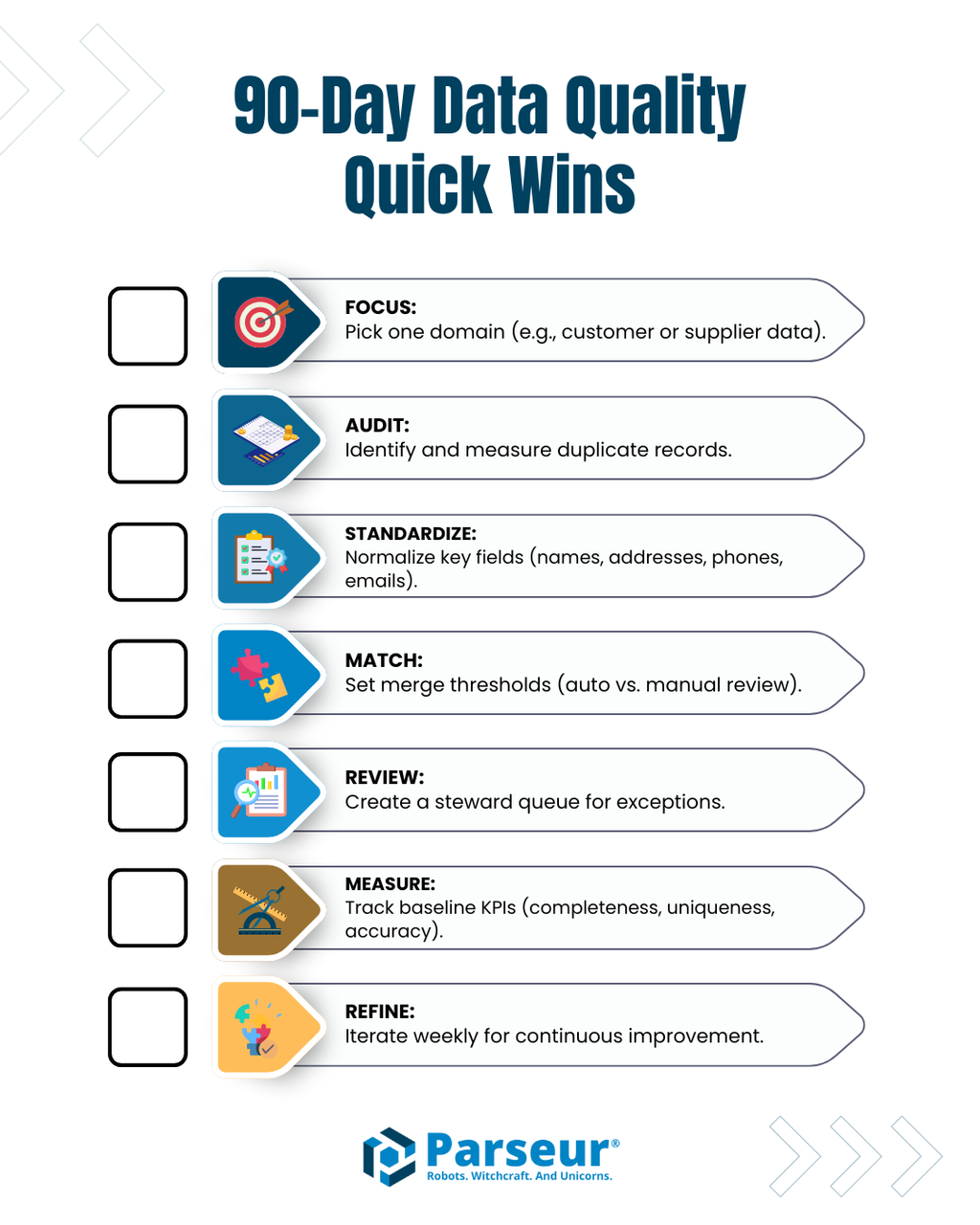

Checklista för systemaktivering och 90-dagars snabba vinster

För att starta förbättring av datakvaliteten, prioritera snabba, mätbara åtgärder de första 90 dagarna:

- Välj ett prioriterat domän eller dataset – till exempel kundregister eller leverantörsdata.

- Genomför dubblettkontroll för att kartlägga aktuell redundans och identifiera mönster.

- Säkerställ enhetliga format för nyckelfält som namn, adresser, telefonnummer och e-post.

- Sätt deterministiska och fuzzy-matchningströsklar för automatisk sammanslagning med hög tillförlitlighet.

- Skapa steward-kö för fall med medelhög förtroendenivå eller som kräver manuell bedömning.

- Mät startvärden för KPI:er (fullständighet, unikhet, konformitet, noggrannhet, aktualitet) och följ utvecklingen.

- Uppdatera och förbättra regler veckovis utifrån realisationsdata och observerade problem.

Med denna checklista kan teamet snabbt höja datakvaliteten, minska fel och skapa en stabil bas för tillförlitlig masterdatahantering, analys och maskininlärning.

Hur datatextraktionsverktyg passar in

Verktyg för dokument- och dataextraktion—som Parseur—har stor betydelse i att minska manuellt arbete och snabbt mata in data i MDM-flöden. De kan automatiskt utvinna strukturerade fält ur e-post, PDF, kalkylblad och dokumentskanningar, göra initial normalisering och leverera färdiga rensade poster för vidare bearbetning. Automatiserad extraktion frigör teamets tid till validering, berikning och hantering av undantag.

Genom att använda extraktion tidigt säkerställs att masterposter tillförs systemet i strukturerat och enhetligt skick, och blir redo för påföljande rensnings-, matchnings- och berikningssteg.

Så bibehålls hållbar datakvalitet

Framgångsrik masterdatahantering och maskininlärning bygger på att data är ren, fullständig och konsekvent. Med metoder som rensning och standardisering, matchning och deduplicering, samt berikning och augmentering kan organisationer minimera fel, undanröja dubbletter och lyfta kvaliteten på varje masterpost.

Genom kombinationen av automatiska regler, manuell granskning och extraktionsverktyg kan företag bygga robusta, tillförlitliga arbetsflöden. Med en genomtänkt checklista, aktiv KPI-övervakning och tydliga transformationsregler kan datateamet säkerställa löpande hög datakvalitet, förbättrad operationell effektivitet och maximalt värde från alla initiativ inom MDM och analys.

Senast uppdaterad