Que signifie « aucune formation sur vos données » ?

Fondamentalement, la mention « aucune formation sur vos données » traduit l’engagement d’un fournisseur d’IA à ne jamais réutiliser les informations que vous partagez avec sa plateforme pour améliorer ou entraîner ses modèles de machine learning.

Points clés à retenir

- « Aucune formation sur vos données » garantit que l'information est traitée, mais jamais réutilisée à des fins d'entraînement de l’IA.

- Cette politique protège la confiance, la conformité réglementaire et la propriété intellectuelle des entreprises.

- Parseur propose par défaut chiffrement, contrôles de rétention des données, conformité et une stricte politique de non-utilisation de vos données pour l'entraînement des modèles.

Quand les entreprises intègrent des outils d’IA, elles cherchent l’assurance que leurs données sensibles ne seront jamais réemployées, exposées ou réutilisées sans leur accord.

Le manque de confiance dans la gestion des données touche également les consommateurs : près de 70 % des adultes se méfient des entreprises utilisant l’IA, et plus de 80 % s’attendent à une utilisation abusive de leurs données, selon Protecto, ce qui fait d’une mauvaise gestion des données un risque de réputation plus dommageable encore que les amendes réglementaires.

Les grands fournisseurs d’IA tels qu’OpenAI, Anthropic et Microsoft ont récemment été soumis à un examen croissant sur leur utilisation des données. La question de fond : vos données servent-elles uniquement à l’exécution d’une tâche ou sont-elles aussi exploitées pour entraîner leurs modèles ?

D’où l’émergence rapide de la politique « IA sans formation sur vos données », aujourd’hui nouveau standard en matière de confiance dans l’IA. Il s’agit d’un engagement explicite : les données clients ne sont utilisées que pour leur traitement demandé, jamais pour renforcer ou entraîner des systèmes d’IA. Pour les entreprises, cette garantie est la condition essentielle pour adopter l’IA en toute confiance et sécurité.

Dans cet article, découvrez ce que recouvre exactement la mention « aucune formation sur vos données », pourquoi c’est essentiel à la conformité et à la gouvernance des entreprises, comment les principaux fournisseurs se positionnent et en quoi l’approche de Parseur renforce sécurité et confiance autour de l’IA.

Que signifie « aucune formation sur vos données » ?

Vos données sont utilisées uniquement selon votre demande, par exemple pour résumer un document, extraire des informations, générer un texte ou analyser des tendances. Ensuite, elles sont supprimées ou conservées de façon sécurisée suivant des règles de protection établies.

La distinction essentielle :

- Traitement : Vos données servent en temps réel à réaliser une tâche précise (génération de rapport, extraction de champ, etc.). Une fois cette opération accomplie, elles ne sont pas réinjectées dans les systèmes pour apprentissage.

- Entraînement : Vos données sont stockées afin d’améliorer les performances des modèles d’IA. Ce faisant, vos informations risquent d’entrer dans la base de connaissances du modèle et, à terme, des fragments d’informations sensibles pourraient réapparaître.

Nombre de grands systèmes d’IA ont longtemps effacé la frontière entre traitement et formation, exploitant les saisies client pour les deux usages. Si cela a contribué à l’avancée technologique, ce flou expose à plusieurs risques majeurs :

- Risque pour la confidentialité : Données métiers sensibles, financières ou clients pourraient être exposées ou reconstituées à l’insu de l’entreprise.

- Questions de propriété des données : Si vos données servent à entraîner un modèle, que deviennent vos droits de propriété intellectuelle ?

- Enjeux de conformité : En santé, finance ou juridique, aucune donnée client ne doit être réutilisée sans consentement explicite.

Une politique de non-formation clarifie la situation : vos données ne sont utilisées que pour la tâche spécifiée, jamais pour l’entraînement ni partagées, ni détournées. Cette approche renforce la sécurité, facilite la conformité et instaure un climat de confiance entre entreprises et fournisseurs d’IA.

En résumé, « aucune formation sur vos données » signifie que vos informations restent confidentielles, protégées et sous votre contrôle total.

Pourquoi les politiques de formation des données sont cruciales pour les entreprises

Une politique de non-utilisation des données à des fins d’entraînement n’est pas optionnelle. Pour les entreprises, elle s’apparente à une couche de protection fondamentale, décisive dans la sécurisation de leurs données sensibles. Faute de cadre clair, vos données peuvent être compromises, exposant à une perte de contrôle, à des sanctions réglementaires, un préjudice réputationnel ou un désavantage concurrentiel.

Risques du recours aux données pour l'entraînement

- Perte de propriété intellectuelle : Procédés métier, contrats ou recherches confidentiels risquent d’être intégrés dans la base d’un modèle, compromettant leur exclusivité.

- Non-conformité réglementaire : Des réglementations comme le RGPD ou le CCPA imposent de fortes restrictions sur la manipulation des données sensibles. Une réutilisation à des fins de formation sans consentement expose à de sévères sanctions.

- Risques pour l’intelligence concurrentielle : Si vos données propriétaires servent à enrichir un modèle, vos concurrents pourraient indirectement en profiter, affaiblissant votre position.

Ce qui incite les acheteurs entreprise à y prêter attention

Désormais, le choix d’un outil d’IA s’appuie autant sur la politique de gestion des données que sur ses performances. Une étude du Futurum Group menée en 2025 indique que 52 % des organisations mettent l’expertise technique du fournisseur au premier plan, suivie de près par la gestion et la confidentialité des données : preuve que des politiques solides sont des critères de sélection incontournables. Un fournisseur qui applique une politique stricte de non-formation montre :

- Respect de la propriété des données : Il assure au client la maîtrise absolue de sa propriété intellectuelle.

- Alignement avec la conformité : Cette approche facilite les audits et réduit le risque juridique dans les secteurs sensibles.

- Transparence et confiance : Des processus clairs, sans ambiguïtés, sont le socle d’un partenariat de long terme.

Une politique claire de non-utilisation des données pour la formation conditionne donc l’adoption de l’IA en entreprise. En optant pour un fournisseur qui s’engage fermement sur ce point, les entreprises innovent tout en gardant contrôle et sérénité sur la sécurité de leurs données.

La perspective conformité et gouvernance

Pour beaucoup, déployer l’IA ne se limite pas au gain d’efficacité : cela implique aussi d’être conforme à des réglementations strictes et à une gouvernance rigoureuse des données. Des normes comme ISO 27001, le RGPD ou des directives sectorielles exigent une gestion irréprochable des données. Selon le 2025 Investment Management Compliance Testing Survey, 57 % des responsables conformité voient l’utilisation de l’IA comme leur principal défi réglementaire, preuve que l’alignement sur des standards tels que l’ISO 27001 et le RGPD est désormais incontournable.

Une politique de non-formation des données permet de répondre à ces exigences grâce à :

- Minimisation des données : Seules les informations strictement nécessaires sont exploitées, limitant ainsi tout risque d’exposition.

- Consentement et contrôle : Aucune donnée n’est réutilisée sans l'accord explicite du client.

- Limitation de la finalité : Les données servent uniquement à la tâche pour laquelle elles ont été collectées, jamais pour la formation du modèle.

Respecter ces principes facilite la preuve de conformité lors des audits et diminue le risque de sanctions.

Au-delà de la réglementation, la gouvernance des données, c’est instaurer un socle de confiance via des pratiques normales et standardisées. Des organismes comme l’Electronic Commerce Code Management Association (ECCMA) promeuvent la qualité et la confiance dans la gestion des données : la non-formation des modèles s’inscrit dans cette culture de transparence et de fiabilité.

En privilégiant des partenaires IA qui respectent une gouvernance exigeante, les entreprises garantissent leur conformité tout en sécurisant l’adoption responsable de l’IA.

Exemples du secteur : comment les géants gèrent la formation des données

Les adaptations opérées par les grandes sociétés technologiques illustrent l’évolution des attentes autour de l’utilisation des données. Les leaders de l’IA ajustent désormais leurs pratiques aux exigences de confidentialité et de maîtrise des entreprises :

- OpenAI : Pour ChatGPT, les données issues des versions gratuites ou publiques sont susceptibles d'améliorer les modèles, tandis que les utilisateurs professionnels peuvent choisir de refuser, ou bénéficier d’une garantie de séparation de leurs données pour toute formation. Cela marque la distinction nette entre IA grand public et IA professionnelle.

- Microsoft : Pour Copilot et Azure OpenAI Service, Microsoft applique une stricte isolation des données clients entreprise, qui ne servent jamais à entraîner les modèles de base. Vos documents et communications restent strictement privés.

- Anthropic : Avec Claude, l’engagement est public : jamais les données des clients professionnels ne servent à la formation. Cette ligne de conduite assoit leur réputation d’IA transparente, sûre et centrée sur le client.

Ces exemples illustrent une tendance générale : le marché professionnel exige et obtient désormais des garanties explicites sur la politique de gestion et de confidentialité des données. Les fournisseurs qui ne s’alignent pas sur cette logique risquent une perte de compétitivité massive face à ceux qui placent la transparence au premier plan.

Pourquoi « aucune formation sur vos données » renforce la confiance dans l’IA

L’adoption réussie de l’IA repose d’abord sur la confiance. Les entreprises n’automatiseront à grande échelle que si la sécurité et la gestion fiable de leurs données sont garanties. D’ailleurs, l’enquête PwC sur les agents IA – 2025 révèle que 28 % des décideurs considèrent que le manque de confiance freine l’adoption généralisée de l’IA. Sans règles comme la politique de non-formation, le doute subsiste et bloque l’innovation. À l’inverse, une politique stricte de non-formation pose des limites saines entre valorisation des données client et développement du modèle IA.

- Réassure les clients : Les entreprises ont besoin de certitudes : leurs données ne seront jamais utilisées à l’entraînement de modèles profitant à d’autres. Cet engagement est un rempart pour tout actif ou stratégie sensible.

- Garantie de transparence : La transparence est la base de la confiance envers une IA professionnelle. Des politiques claires et publiques, qui séparent traitement et formation des données, donnent aux clients contrôle et visibilité.

- Facilite l’adoption : Là où la confiance est explicite, l’adoption de l’IA dans les processus critiques (finance, santé, juridique, etc.) progresse nettement, tout comme la fidélité aux solutions d’automatisation fiables.

« Aucune formation sur vos données » est donc bien plus qu’une simple promesse : c’est un atout concurrentiel majeur. Les fournisseurs qui s’y engagent prouvent qu’ils privilégient la confiance client et accélèrent l’adoption des solutions d’IA par leurs clients.

Comment Parseur applique cette politique

Chez Parseur, confidentialité et conformité sont au cœur de la plateforme. Nous savons l’importance pour nos clients d’avoir la garantie que leurs données ne seront jamais exploitées pour l’entraînement de modèles d’IA. Nous prenons un engagement clair : vos données restent les vôtres, protégées de bout en bout.

Concrètement, cela se traduit par :

- Zéro entraînement sur vos données : Parseur ne réutilise jamais vos contenus (documents, e-mails, factures, etc.) pour entraîner quelque intelligence artificielle que ce soit. Chaque extraction s’effectue dans un espace clos et sécurisé.

- Traitement dédié seulement : Les données servent exclusivement à l’extraction et à l’automatisation de workflow, et ne sont jamais stockées ou exploitées pour la formation.

- Sécurité de niveau entreprise : Chiffrement bout-en-bout, contrôles stricts de rétention, possibilité de suppression et conformité réglementaire garantissent aux entreprises une gouvernance totale.

Notre politique stricte de non-formation est une protection précieuse pour nos clients et pose les bases d’une relation de confiance solide avec l’IA. Les entreprises peuvent ainsi automatiser sans peur de perdre le contrôle de leurs données ou de s’exposer à des risques sur la propriété intellectuelle et la conformité.

En privilégiant la transparence et la protection, Parseur place la confidentialité au cœur de votre transformation automatisée.

Bonnes pratiques pour évaluer les fournisseurs

Évaluer un fournisseur d’IA ou d’automatisation va bien au-delà de la comparaison fonctionnelle. L’enjeu n°1 : s’assurer que ses pratiques de gestion de données s’alignent sur vos standards de sécurité, conformité et gouvernance. Sans ce cadre, vos données sont exposées à des risques majeurs ou à des lacunes réglementaires.

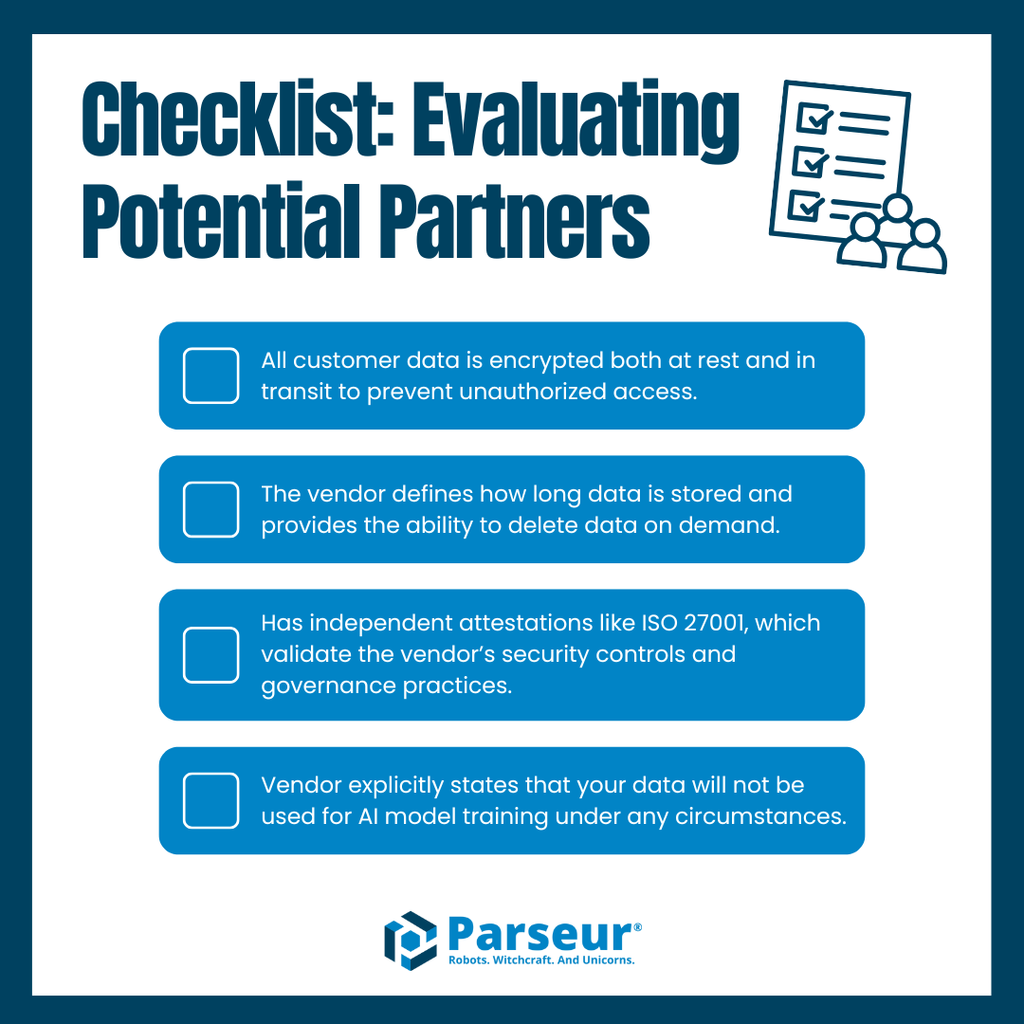

En qualifiant un partenaire, vérifiez les points suivants :

- Chiffrement des données : Toutes les informations transitent-elles de façon chiffrée et sont-elles stockées sous forme sécurisée ?

- Politique de rétention : Le fournisseur précise-t-il la durée de conservation et permet-il la suppression rapide de vos données ?

- Certifications de conformité : Recherche-t-il des accréditations reconnues comme ISO 27001, gage de gouvernance avancée ?

- Engagement écrit de non-formation : L’entreprise s’engage-t-elle noir sur blanc à ne jamais utiliser vos données pour entraîner des modèles d’IA, en toutes circonstances ?

Les fournisseurs imprécis ou ambigus sur ces points représentent un risque, tandis que ceux offrant des garanties claires constituent un partenariat fiable et pérenne.

C’est là que Parseur excelle : chiffrement par défaut, gestion transparente de la rétention, conformité certifiée et politique claire de non-formation. Nos clients savent à tout moment comment leurs données sont protégées, ce qui fait de Parseur une solution automatisée de confiance.

Pourquoi la confiance façonne l’avenir de l’automatisation

La confiance s’impose désormais comme le critère décisif dans le choix d’une solution d’automatisation ou de gestion des données. À mesure que la manipulation de données sensibles se généralise, la capacité des fournisseurs à garantir sécurité et transparence devient capitale, et le principe d’« aucune formation sur vos données » est au cœur de cette exigence.

La responsabilité et la transparence seront bientôt incontournables. Experts et régulateurs prévoient que, dans les prochaines années, la plupart des entreprises exigeront des garanties sur la rétention des données, le chiffrement natif, les certifications de conformité et des engagements écrits concernant la non-utilisation des données à des fins d’entraînement. Les fournisseurs qui ne répondront pas à ces attentes perdront leur crédibilité sur un marché où gouvernance et sécurité ne souffrent aucun compromis.

Parseur a été pensé pour cet avenir. Grâce à un chiffrement de niveau entreprise, des contrôles stricts et transparents de rétention, des certifications et une politique intransigeante de non-formation, Parseur permet à votre organisation d’automatiser à grande échelle, sans jamais sacrifier la sécurité ou la confidentialité.

Découvrez comment Parseur protège vos données grâce à une sécurité avancée et une stricte politique de non-formation, apportant à votre organisation toute la confiance nécessaire pour automatiser vos workflows à grande échelle, en toute transparence et conformité.

Dernière mise à jour le