Agentisk AI utlovar system som inte bara genererar svar, utan faktiskt vidtar åtgärder åt verksamheten. Problemet är att de flesta autonoma agenter bygger på ostrukturerad data, såsom e-post, PDF-filer och inskannade dokument, vilket hindrar dem från att agera tillförlitligt. I denna artikel utforskar vi varför strukturerad data är det saknade lagret inom agentisk AI – och hur ett separat parseringslager förvandlar lovande AI-agenter till pålitliga system.

Viktiga insikter:

- Agentisk AI skiftar från innehållsgenerering till utförande av riktiga affärsåtgärder, vilket gör konsekvenserna av datafel mycket större.

- Autonoma agenter behöver ren och validerad strukturerad indata för att arbeta säkert och i stor skala – stora språkmodeller räcker inte själva.

- Parseur tillhandahåller det avgörande parseringslagret som förvandlar råa dokument till tillförlitlig, strukturerad data och gör det möjligt för agenter att agera tryggt istället för att behöva gissa.

Skiftet från “chatt” till “handling”

AI har utvecklats snabbt de senaste åren. Under 2023 och 2024 låg fokus på generativ AI: lösningar som kan skriva e-post, sammanfatta dokument och svara på frågor med imponerande flyt. Dessa verktyg förändrade hur människor interagerar med mjukvara, men stannade ofta vid konversationer.

År 2026 har diskussionen flyttat sig. Gartner förutspår att 40 % av alla affärsapplikationer snart kommer att integrera uppgiftsspecifika AI-agenter. Nästa våg av innovation är agentisk AI: system som inte bara svarar, utan agerar. Istället för att bara skriva ett mejl skickar en AI-agent det åt dig. Istället för att föreslå nästa steg utför den automatiskt ett helt arbetsflöde från början till slut.

Löftet är lockande. Kong INC rapporterar att 90 % av företagen adopterar AI-agenter, och 79 % förväntar sig fullskalig drift inom tre år. Föreställ dig en AI som hanterar din leverantörskedja, behandlar och betalar fakturor eller uppdaterar CRM-system automatiskt när nya uppgifter kommer in. Slut på instrumentpaneler och manuella överlämningar – bara resultat.

Men verkligheten är inte lika glamorös som hypen. Medan “hjärnan” bakom dessa lösningar – stora språkmodeller som GPT-5 eller Claude – blir allt bättre, är “bränslet” de får ofta bristfälligt. Rubrik visar att 80 % av all företagsdata är ostrukturerad, exempelvis e-post, PDF-filer, inskannade dokument och löst formaterade bilagor. När agenter tvingas agera på sådan rörig data exploderar felen snabbt och påverkar verksamheten.

Det är därför agentiska AI-initiativ ofta fastnar eller förblir på testnivå. Det är inte resonemangs- eller planeringsförmågan som brister – det är förtroendet för indata.

För att agentisk AI ska gå från demo till tillförlitlig företagslösning krävs ett separat lager som fokuserar på datatillförlitlighet – ett lager som omvandlar människoläsbar information till strukturerade fakta innan autonoma handlingar utförs.

Vad är agentisk AI?

Agentisk AI består av system som arbetar självständigt för att uppnå mål. Till skillnad från klassiska chattbottar som väntar på frågor och svarar med text, är agentisk AI utformad för att uppfatta information, resonera kring den och agera utan kontinuerlig mänsklig inblandning.

I praktiken nöjer sig inte en agent med att besvara en fråga som “Vad ska jag göra nu?”. Den avgör själv vad som bör göras – och utför det direkt.

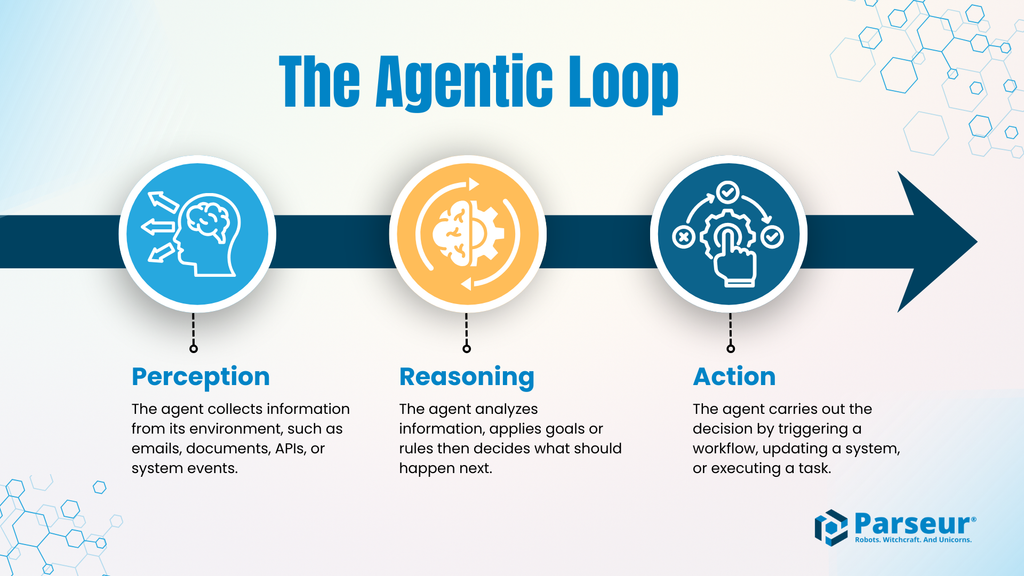

Den agentiska loopen: Perception → Resonemang → Handling

De flesta agentiska AI-system följer ett enkelt och kraftfullt cykliskt arbetsflöde:

- Perception: Agenten tar in information från omvärlden, exempelvis e-post, dokument, API-svar eller systemnotiser.

- Resonemang: Agenten tolkar och bearbetar informationen, tillämpar regler och mål och fattar ett beslut om nästa steg.

- Handling: Agenten utför en uppgift — t.ex. uppdaterar poster, startar ett arbetsflöde, utför en betalning eller meddelar ett annat system.

Den här loopen återupprepas och gör att agenten kan arbeta fortlöpande med minimal övervakning, så länge den får ny information.

Varför blir insatserna högre?

När AI går från att skapa innehåll till att utföra verkliga åtgärder ökar risken för varje fel dramatiskt. Ett stavfel av en chatbot är harmlöst. Men om en autonom agent misstolkar ett belopp, förväxlar en kund eller agerar på ofullständig data kan det leda till allvarliga driftstörningar.

Exempel:

- Betala fel fakturabelopp

- Beställa fel volymer till lagret

- Uppdatera felaktiga kunduppgifter

- Trigga arbetsflöden på felaktiga grunder

I agentiska system är misstag inte bara störande – de kan förstöra hela processer.

Generativ AI vs. Agentisk AI

| Aspekt | Generativ AI | Agentisk AI |

|---|---|---|

| Huvudsyfte | Genererar innehåll, t.ex. text, bilder eller sammanfattningar | Utför uppgifter och arbetsflöden för att nå mål |

| Interaktionsmodell | Svarar på användarens uppmaningar vid behov | Opererar självständigt med minimal mänsklig input |

| Typiska utdata | Utkast, förklaringar, förslag | Systemuppdateringar, transaktioner, åtgärder |

| Beslutsfattande | Fokus på att ge sammahängande svar | Fokus på att välja och utföra nästa handling |

| Fel-tolerans | Relativt hög; fel är synliga och lätta att rätta | Mycket låg; fel kan påverka drift eller ekonomi |

| Datakrav | Kan hantera tvetydig eller ofullständig information | Kräver exakt, strukturerad och validerad data |

| Riskprofil | Fel är oftast kosmetiska eller informationsmässiga | Fel kan orsaka driftstopp eller ekonomiska förluster |

Problemet med “ground truth”

Agentiska AI-system verkar i en värld där logik, API:er och scheman råder. De behöver indata i strukturerade format som JSON eller XML med tydliga och konsekventa fält. Verkligheten ser dock annorlunda ut – kritisk information anländer via e-post, PDF:er, kalkylark, inskannade dokument och olika bilagor.

Denna motsägelse utgör en av de största flaskhalsarna för autonoma agenter.

Innan en agent kan resonera eller fatta beslut behöver den “ground truth”: tillförlitliga, maskinläsbara fakta. Saknas detta måste agenter improvisera och riskera logiska fel.

Varför räcker inte LLM:er på egen hand?

Det är lätt att tänka att stora språkmodeller (LLMs) kan hantera alla dokument och extrahera data själva. Men det skapar flera risker, särskilt när automationen ska skalas.

Hallucinationer

LLMs bygger på sannolikheter. Om informationen är oklar eller saknas gissar de – istället för att stanna upp. I dialoger är det ofta ofarligt, men i agentiska arbetsflöden blir gissningar faktiska åtgärder. Studier visar att hallucinationer ökar när modeller får i uppdrag att strukturera data från röriga dokument – särskilt långa eller komplicerade filer.

Kostnad och latenstid

Att processa kompletta PDF:er, långa e-posttrådar eller inskannade dokument med LLM:er är resurskrävande. Varje dokument tar tokens och ökar svarstiderna. För agenter som kräver realtid eller hanterar stora volymer blir detta snabbt ohållbart.

Inkonsekvens

Autonoma arbetsflöden kräver konsekventa strukturer. Agenten behöver samma fältnamn, datatyper och format varje gång för att trigga nästa steg. LLM:er kan ge subtilt olika svar på liknande dokument. Små variationer räcker för att stoppa automatiserade flöden.

Så ser misslyckanden ut i praktiken

När agenter agerar på opålitlig dokumentdata blir felen snabbt märkbara.

En fakturaagent kan tolka ett leverantörsnamn fel i en PDF och skicka betalningen till fel konto. En inköpsagent kan rapportera fel kvantitet på ett inköp och orsaka lagerbrist. En avtalshanterande agent kan misstolka en förnyelseklausul och sätta fel pris på flera kundavtal.

Detta är inte undantag. I agentiska system sprids fel snabbt – en felaktig detalj kan påverka andra system och utlösa ytterligare åtgärder på fel grunder. Resultatet blir en kedja av fel som kräver manuella insatser och minskat förtroende för automationen.

Det kallas “ground-truth-problemet”: Agenter är redo att agera – men utan strukturerad, tillförlitlig data arbetar de med dimsyn.

Det saknade lagret: Intelligent Document Processing (IDP)

Att agentisk AI har svårt i verkliga verksamheter handlar inte om bristande resonemang – utan om avsaknad av tillförlitlig tolkning av de indata företag faktiskt hanterar. Det är här Intelligent Document Processing (IDP) spelar en nyckelroll.

IDP utgör ett dedikerat parseringslager mellan ostrukturerade, ofta otydliga dokument och autonoma AI-agenter. Istället för att agenten eller språkmodellen tolkar dokumenten i realtid, omvandlar detta lager dokumenten till strukturerad, pålitlig data innan någon åtgärd vidtas.

I den agentiska arkitekturen utgör detta lager en stabil grund och försäkrar att agenter agerar på fakta – inte gissningar.

Hur fungerar dokumentparseringen?

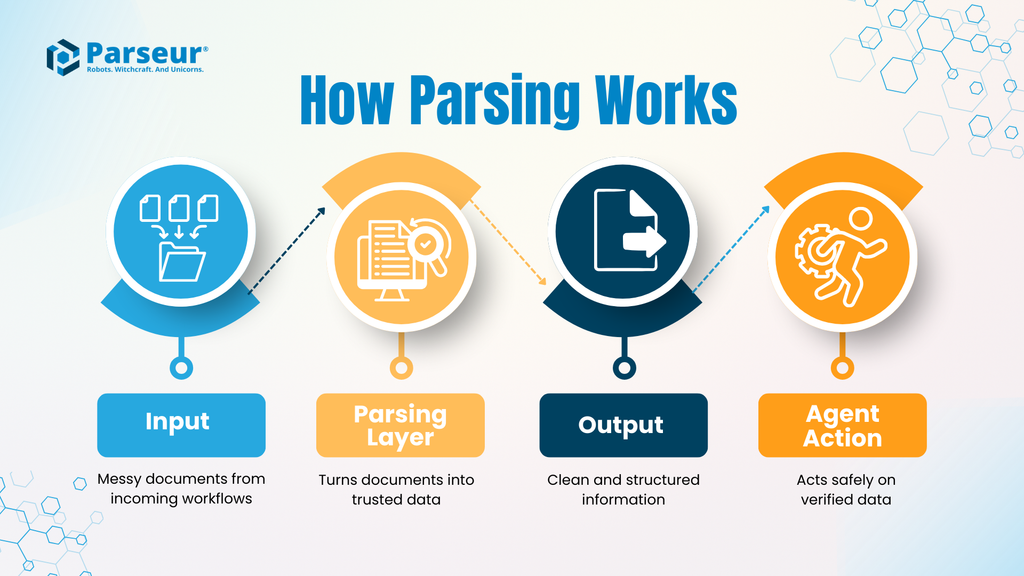

Ett typiskt IDP-arbetsflöde:

- Input: Ett verkligt dokument, t.ex. en faktura, fraktsedel, avtal eller e-post — format, layout och struktur kan variera kraftigt.

- Parseringslager: Ett IDP-verktyg extraherar specificerade fält, standardiserar format (t.ex. datum, valutor) och validerar mot kända regler. Fokus ligger på noggrannhet och konsistens, inte tolkning.

- Output: Ren, strukturerad data — oftast i JSON — enligt ett förutsägbart schema.

- Agentinsats: Agenten får denna strukturerade output och utför sin åtgärd med trygghet i datans kvalitet.

Genom att separera dokumentförståelse från beslut minskas risker och ökas spårbarhet. Agenten själv behöver aldrig “läsa” dokumenten – den agerar när validerad data finns.

Hur minskar riskerna?

Utan parseringslager exponeras agenter direkt för all osäkerhet i dokumenten — varje avvikelse riskerar fel. Med IDP hanteras osäkerheten innan automatiseringen tar vid.

I praktiken är skillnaden enorm:

Enligt Parseurs undersökning 2026 rapporterar 88 % av företag fel i dokumentdata. En agent med 88 % felfrekvens är ingen tillgång – utan en betydande risk.

IDP gör inte agenterna smartare – det gör dem pålitliga. Det minimerar hallucinationer, ökar arbetsflödets tillförlitlighet och möjliggör automation utan ständig manuell övervakning.

I agentiska miljöer handlar det inte bara om intelligens. Det är datans tillförlitlighet som möjliggör autonomi. Parseringslagret är den avgörande länken som omvandlar experimentella agenter till verkliga verksamhetsverktyg.

Verkliga användningsområden: När agenter behöver Parseur

Agentisk AI får verklig betydelse i vardagens affärsflöden. Där gäller det mindre om abstrakt intelligens, mer om att få korrekt, strukturerad data vid precis rätt tillfälle. Två vanliga exempel visar skillnaden mellan automation som fungerar – och automation som misslyckas.

Användningsfall A: Den autonoma leverantörskedjan

Scenario:

En leveransförsening meddelas via e-post från en transportpartner. Meddelandet innehåller ett nytt ankomstdatum, container-ID och en uppdaterad ankomsttid, ibland i löpande text eller som PDF-bilaga.

Utan parseringslager:

Agenten skannar mejlet och försöker tolka datumen. Formatet skiljer sig från tidigare och container-ID finns på oväntad plats. Uppdateringen missas eller feltolkas. Som följd uppdateras inte ERP-systemet, produktionen förbereds på varor som inte kommer i tid och problemet upptäcks först när det redan lett till produktionsstopp.

Med Parseur:

E-post och bilagor parsas först. Parseur extraherar container-ID, ankomstdatum och plats med AI och levererar strukturerad, validerad data. Agenten får informationen direkt, uppdaterar logistik- och ERP-system, omdirigerar leveranser och säkerställer att tillverkningen planeras om. Vad som kunnat bli ett driftstopp avstyr agenten proaktivt och automatiserat tack vare en tydlig datakälla.

Användningsfall B: Den “självkörande” ekonomiavdelningen

Scenario:

Företaget vill automatisera fakturavstämningar. Inkommande fakturor ska matchas mot inköpsordrar och godkännas utan manuell handpåläggning.

Utmaningen:

Ekonomiagenter kan utföra arbetsflödet – men bara om varje artikelrad, kvantitet, belopp, moms och totalsumma extraheras exakt. Små datafel kan stoppa avstämningen eller orsaka felaktiga utbetalningar.

Utan säker dataextraktion:

Agenten misstolkar radbelopp eller blandar ihop snarlika produktnamn. PO-matchningen misslyckas, fakturor flaggas felaktigt eller, än värre, betalas ut med fel belopp. Manuella kontroller ökar, automationens förtroende minskar.

Med Parseur:

Fakturorna parsas pixelperfekt. Artikelrader och summor extraheras och valideras automatiskt före agentens analys. Ekonomiavdelningen kan med full tillförlitlighet automatisera både avstämning och betalning, och endast undantag kräver manuell hantering.

Varför Human-in-the-Loop (HITL) är systemets skyddsnät

Den största utmaningen för agentisk AI idag handlar inte bara om teknik – utan om tillit. Företag vill ogärna låta autonoma system fatta kritiska beslut om pengar, drift eller kunder utan skydd. Rädslan att agenter “går bananas” på grund av fel data är fullt berättigad, särskilt i distribuerade processer.

Här blir rollfördelningen human-in-the-loop (HITL) avgörande.

HITL bromsar inte automation – det gör den möjlig i praktiken.

Så fungerar HITL i agentisk arkitektur

I ett bra system granskar människor bara undantagssituationer. Parseur fungerar som kontrollpunkt före agenten.

Om ett dokument är tydligt och motsvarar förväntad struktur går data direkt till agentens flöde. Är texten oklar, saknas fält eller är layouten oväntad kan Parseur flagga dokumentet för manuell granskning. En människa kvalitetssäkrar eller korrigerar data – därefter får agenten agera.

Detta möjliggör:

- Agenter hanterar repeterbara uppgifter högt tillförlitligt

- Mänsklig insats behövs bara vid verklig osäkerhet

Resultatet är en process som verkligen kan skala – utan varken tappa kvalitet eller spårbarhet.

Varför bygger HITL förtroende i automationen?

Många tror att behov av manuell granskning innebär misslyckad automation. Men i praktiken gör HITL agentisk AI användbar även i de mest komplexa organisationerna.

Utan HITL tvingas företag välja mellan farlig totalautomation eller ineffektiv manuell process. HITL blir den trygga mellanvägen – automation med skyddsräcken.

Verksamheter, revisorer och ledning vill ha svar på:

- Vad händer när data är svårtolkad?

- Vem bestämmer vid avvikelser?

- Hur stängs felvägar innan de når IT-systemen?

Med parseringslager + HITL finns dessa svar.

Sammanfattning

Human-in-the-loop är inget nödvändigt ont, utan nödvändig trygghet. Det är säkerhetsnätet som gör agentisk AI hållbar och skalbar. Genom att fånga tvetydighet innan autonoma åtgärder utförs, förvandlar HITL agentisk AI från experiment till pålitlig grund för digitala affärer.

Att bygga grunden för 2026

Vi står inför en ny typ av digitala kollegor – autonoma agenter som inte bara svarar, utan utför affärskritiska arbetsflöden i stor skala. Möjligheterna är enorma: snabbare processer, färre fel, och mer mänsklig tid för verkligt värdeskapande beslut snarare än repetitiva uppgifter.

Det finns dock en avgörande förutsättning: agenter är bara så pålitliga som den data de får. Om AI får agera direkt på ostrukturerad eller osäker input väntar risk, felkedjor och minskat förtroende. Bästa väg framåt är först säkra att dataflödena är strukturerade, korrekta och spårbara.

Det är här Parseur är avgörande. Som “motorn” i agentisk AI omvandlar Parseur e-post och affärsdokument till exakt, maskinläsbar data. Med validerad input, human-in-the-loop och strukturerad output kan agenter agera med självklar trygghet – och förvandla ambitiösa AI-arbetsflöden till stabil och skalbar verksamhet.

Senast uppdaterad