Wichtige Erkenntnisse

- Bis 2030 wird Human-in-the-Loop ein zentrales Designelement für vertrauenswürdige und erklärbare KI sein.

- Vorschriften werden menschliche Überwachung bei sensiblen KI-Entscheidungen verlangen.

- Mensch-KI-Synergie treibt ethische und skalierbare Automatisierung voran.

Eine hybride Zukunft für KI und Menschen

Mit Blick auf das Jahr 2030 wird eines immer deutlicher: Die erfolgreichsten KI-Systeme sind nicht die schnellsten oder am stärksten automatisierten, sondern die vertrauenswürdigsten. Dieses Vertrauen entsteht durch ein Gleichgewicht von Automatisierungsgeschwindigkeit und menschlicher Expertise.

Die frühen Phasen der KI-Einführung haben gezeigt, dass autonome Systeme zwar leistungsstark sein können, jedoch oftmals Risiken wie Bias, mangelnde Transparenz und unvorhersehbares Verhalten bergen. Diese Herausforderungen haben das Interesse an HITL-Systemen und menschenzentrierter KI neu entfacht – nicht als Rückschritt, sondern als zukunftsweisende Designstrategie.

Schätzungen zufolge werden bis 2026 über 90 % aller Online-Inhalte von KI statt von Menschen erzeugt werden. Diese Entwicklung unterstreicht, wie wichtig Vertrauen und Aufsicht in automatisierten Systemen werden, wie Oodaloop berichtet.

Die Konzepte dazu erläutert unser Leitfaden Human-in-the-Loop KI: Definition und Nutzen – ein praxisnaher Einstieg in aktuelle Anwendungen und Business-Mehrwerte von HITL.

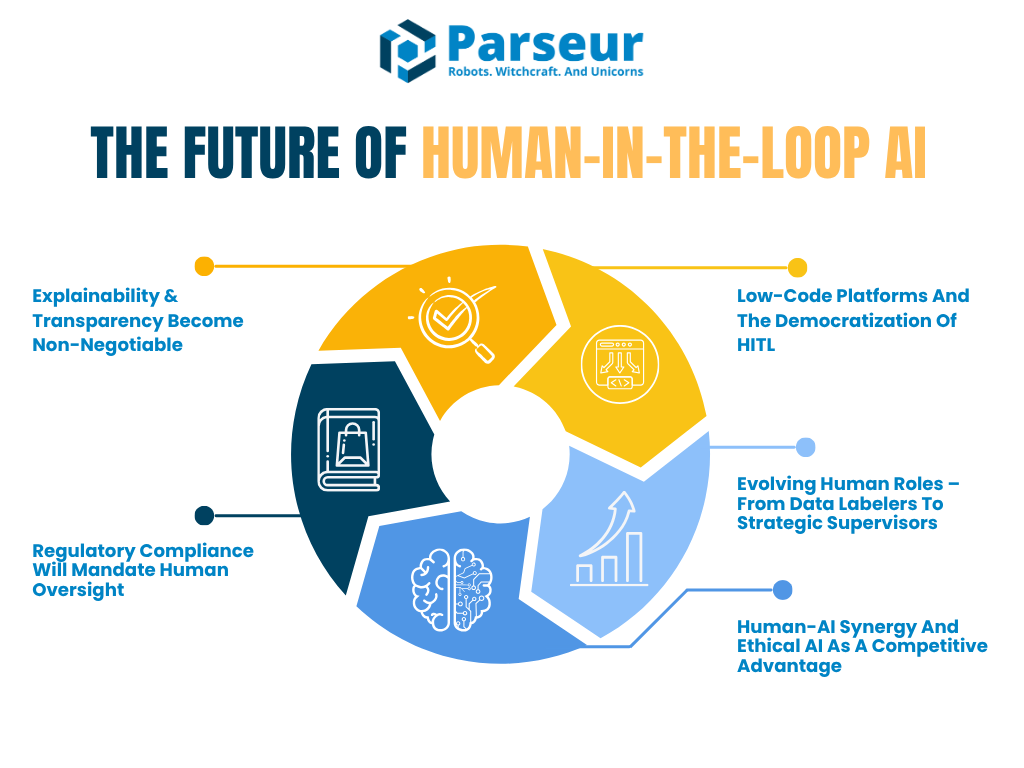

In diesem Artikel beleuchten wir, wie sich HITL bis 2030 weiterentwickelt – mit Fokus auf fünf Schlüsseltrends für die Zukunft der menschlich unterstützten KI:

- Die Nachfrage nach erklärbarer und prüfbarer KI

- Neue regulatorische Vorgaben, die menschliche Aufsicht erfordern

- Das Wachstum von Low-Code-Plattformen für eine vereinfachte HITL-Implementierung

- Die Wandlung menschlicher Aufgaben vom Datenlabeling hin zu KI-Supervising

- Wie Mensch-KI-Synergie zum Wettbewerbsvorteil wird

Laut Venture Beat prognostiziert auch Tech-Vordenker Reid Hoffman eine Zukunft, in der AI Superagency prägend wird, und sagt: „Menschen, die keine KI einsetzen, werden ersetzt von denen, die KI nutzen“ – KI als Produktivitätsmultiplikator statt Bedrohung.

Passend dazu zeigt das PwC’s 2026 Global AI Jobs Barometer, dass seit der Verbreitung von generativer KI ab 2022 das Produktivitätswachstum in KI-betroffenen Branchen von 7 % (2018–2022) auf 27 % (2018–2024) sprang – und so eindrucksvoll belegt, wie KI die menschliche Produktivität in Bereichen wie Finanzdienstleistungen und Softwareentwicklung beflügelt.

Organisationen müssen sich nicht mehr zwischen Automatisierung und Kontrolle entscheiden. Die Zukunft gehört hybriden KI-Architekturen, die menschliches Urteilsvermögen an entscheidenden Stellen einbinden – im In-the-Loop- oder On-the-Loop-Modell.

Trend 1: Erklärbarkeit & Transparenz werden unverzichtbar

Je stärker KI-Systeme reale Entscheidungen beeinflussen, ist nicht mehr entscheidend, ob KI Aufgaben exakt löst. Die wahre Frage ist: Können Menschen diese Entscheidungen nachvollziehen und erklären? Hier setzen erklärbare KI (XAI) und Transparenz an.

In den kommenden Jahren wird Erklärbarkeit von einer Best Practice zur zwingenden Anforderung, insbesondere in Hochrisikobereichen wie Finanzen, Gesundheitswesen, Versicherungen und Recht. Human-in-the-Loop-Workflows unterstützen nicht nur die Aufsicht. Sie ermöglichen es Unternehmen, regulatorische und ethische Vorgaben zu erfüllen, weil Menschen die Rolle einnehmen, KI-Antworten zu interpretieren, zu validieren und erklärbar zu machen.

Laut Gartner werden bis 2026 mehr als 80 % der Unternehmen generative KI-APIs genutzt oder entsprechende Anwendungen eingeführt haben. Das zeigt die dringende Notwendigkeit für Erklärbarkeit und menschliche Kontrolle quer durch alle Industrien wie Gesundheit, Recht und Finanzdienstleistungen.

Ein gutes Beispiel ist der EU AI Act, der bereits bei Hochrisiko-KI menschliche Überwachung und Erklärbarkeit der Resultate vorschreibt. Gleichzeitig warnt das NIST AI Risk Management Framework, dass unklare HITL-Rollen und undurchsichtige Entscheidungen weiterhin ernsthafte Risiken darstellen. Zukünftig werden Frameworks wie das von NIST formal festlegen, wie menschliche Kontrollmechanismen gestaltet und dokumentiert werden.

Ausblick: Human-in-the-Loop mit Erklärungsschnittstellen

Bis 2030 werden KI-Tools voraussichtlich mit integrierten „Erklärungsschnittstellen“ ausgeliefert, die Prüfer:innen helfen, KI-Entscheidungen zu verstehen. Beispielsweise könnte ein System für Kreditvergabe den Score plus die drei Hauptgründe der KI für diese Bewertung anzeigen. Prüfer erhalten so den Kontext, um Fairness und Korrektheit zu beurteilen.

HITL wird sich von manueller Einzelprüfung zur strategischen Validierung an Schlüsselpunkten wandeln. Es geht künftig weniger darum, jede Ausgabe einzeln freizugeben, sondern darum sicherzustellen, dass die Logik hinter KI-Entscheidungen mit Unternehmenswerten, Compliance und Fairness im Einklang steht.

Branchen, in denen das bereits Praxis ist

Die Gesundheits- und Finanzbranche sind Vorreiter – hier ist Erklärbarkeit oft gesetzlich vorgeschrieben. Im Deloitte Tech Trends Report 2026 heißt es: „Je komplexer die Systeme, desto wichtiger werden menschliche Fachkräfte.“ Das zeigt ein zentrales KI-Paradox: Je mächtiger Automatisierung wird, desto wichtiger wird qualifizierte menschliche Kontrolle – nicht unwichtiger.

Das zeigt sich auch in den aufkommenden „Human-on-the-Loop“-Modellen. In diesen Systemen müssen Menschen nicht bei jedem Vorgang eingreifen, sondern überwachen ständig und behalten jederzeit die Kontrolle – vergleichbar mit Piloten beim Autopiloten.

Warum das relevant ist

Die Entwicklung zu mehr Erklärbarkeit bestätigt eine zentrale Wahrheit: Unternehmen können KI nicht skalieren ohne Vertrauen – und Vertrauen entsteht durch Transparenz. In Zukunft kann es sogar Pflicht werden, „Erklärungsprotokolle“ bzw. Berichte mit der Zusammenfassung der Entscheidungswege zu führen – und Menschen zur Prüfung oder Freigabe dieser Erklärungen zu bestimmen.

Diese menschlichen Rollen sind nicht nur reaktiv. Sie werden die Weiterentwicklung der KI-Systeme aktiv prägen – indem sie Fehler aufdecken, Kontext liefern und die ethische Verwurzelung sicherstellen, die KI selbst fehlt.

Trend 2: Regulierung verlangt menschliche Aufsicht

Mit zunehmender KI-Leistung wächst auch die rechtliche und ethische Verantwortung. Globale Regulierungsbehörden setzen verstärkt auf Verantwortlichkeit und menschliche Kontrolle in automatisierten Systemen. Zwischen 2026 und 2030 erwartet uns eine Regulierungswelle, die Human-in-the-Loop-Prozesse bei vielen Hochrisiko-KI-Anwendungen verbindlich vorschreibt.

Behörden und Standardorganisationen wie die EU, die USA und NIST sind sich in einem zentralen Punkt einig: KI darf keine Black Box sein. Betroffene müssen Entscheidungen nachvollziehen, anfechten, und vielfach eine menschliche Überprüfung verlangen können.

Tatsächlich wurden schon 2024 allein in den USA mehr als 700 KI-Gesetze eingebracht, Anfang 2026 kamen über 40 neue Vorstöße hinzu – dies belegt laut Naaia den rapiden Wandel hin zu Transparenz und menschlicher Kontrolle.

Nach GDPR Artikel 22 dürfen Personen bei automatisierten Entscheidungen menschliche Interventionen verlangen. Der kommende EU AI Act verpflichtet dazu, dass Menschen eine maßgebliche Rolle bei Kontrolle und Steuerung spezieller Hochrisiko-Systeme übernehmen. Dies ist nicht mehr bloßer Trend, sondern wird zum rechtlichen Standard.

Ausblick: Compliance-getriebene HITL-Systeme

Bis 2030 werden viele Unternehmen eigene „Compliance-HITL“-Ansätze verfolgen: Governance-Workflows, die gezielt regulatorische Vorgaben erfüllen. Zum Beispiel:

- Menschliche Prüfer protokollieren und kontrollieren KI-Entscheidungen nach festen Zeitplänen.

- Manche Organisationen etablieren AI Oversight Teams, die Live-Systeme überwachen – ähnlich wie Kontrollzentralen in der Luftfahrt oder Cybersecurity.

- Menschliche Kontrollpunkte werden in Entscheidungs-Pipelines integriert, wo Risiko oder Fairness kritisch ist.

Tools und Plattformen passen sich an, um das zu erleichtern. Unternehmen nutzen Dashboards, auf denen Modell-Genauigkeit und die Häufigkeit menschlicher Eingriffe in KI-Entscheidungen sichtbar werden. Diese Nachverfolgbarkeit wird selbst zum Compliance-Kriterium.

Expertensicht: Der Aufstieg hybrider KI-Governance

Branchenführer setzen bereits heute auf hybride Frameworks, die Automatisierung mit menschlicher Kontrolle vereinen. Laut Gartner haben **67 % der etablierten Unternehmen spezielle KI-Teams gegründet und neue Rollen wie KI-Ethiker, Modellmanager und Knowledge Engineers eingeführt, um den verantwortungsvollen KI-Einsatz sicherzustellen.

Gerade in Daten- und Analyseabteilungen werden diese neuen Rollen zum Standard, denn technische wie ethische Kontrolle sind zentral für KI-Erfolg. Bis 2030 dürften Jobtitel wie „AI Auditor“, „AI Risk Manager“ oder „Human-in-the-Loop Supervisor“ verbreitet sein – das markiert eine strategische Verlagerung hin zur festen Einbindung menschlicher Aufsicht im KI-Governance.

Erklärbarkeit wird regulatorisch verbindlich

Regulierer verlangen nicht nur menschliche Beteiligung. Sie erwarten, dass diese Menschen erläutern können, warum Entscheidungen gefällt wurden. Hier schließt sich der Kreis zum ersten Trend. Dokumentation und Audit Trails gehören zum Standardprozess. Das NIST AI RMF empfiehlt bereits, Menschen zu ermächtigen, KI zu überstimmen und Ausgaben regelmäßig zu prüfen. Wer das künftig nicht umsetzt, riskiert regulatorische Sanktionen oder Zertifikatsverlust.

Manche Organisationen werden gezielt „KI-Vertrauenszertifizierungen“ anstreben, um nachzuweisen, dass ihre Systeme von Anfang an mit menschlicher Kontrolle konzipiert wurden.

Trend 3: Low-Code-Plattformen und Demokratisierung

Früher erforderten HITL-Workflows Entwicklerressourcen, Integrationen und tiefe KI-Expertise – für kleine Teams praktisch unzugänglich. Doch diese Hürden fallen rasant. Ab 2026 und darüber hinaus werden Low-Code- und No-Code-Plattformen HITL für deutlich breitere Anwenderkreise öffnen.

Solche Plattformen erlauben es, menschliche Kontrollpunkte in KI-Workflows einzubauen, ohne eine Zeile Code zu schreiben. Bereits heute bieten Tools wie UiPath, Microsoft Power Automate oder Amazon A2I Drag-and-drop-Features mit eingebauter menschlicher Prüfung.

Ausblick: KI-Workflows gebaut von Fachanwendern

KI-Plattformen mit HITL werden schon in wenigen Jahren zum Standard gehören. Bis 2026 planen 70 % der CX-Verantwortlichen, generative KI an Kontaktpunkten auszurollen – oft über Tools, die HITL-Features zur Qualitätssicherung und Kontrolle bieten, wie AmplifAI berichtet.

Das demokratisiert das Thema – Operations, Recht oder Finance können nun eigene Governance-Layer umsetzen. Mit mehr Menschen, die KI-Überwachung bauen und betreiben, steigt Skalierbarkeit und Sicherheit.

In Zukunft könnten sogar LLMs Vorschläge machen, wo im Workflow ein Human-in-the-Loop Schritt eingefügt werden sollte, beispielsweise abhängig vom Modell-Vertrauen oder Datenrisiko. Plattformen bieten Monitoring-Dashboards, auf denen Menschen Entscheidungssummen einsehen, Probleme kennzeichnen und mittels Feedback künftiges KI-Verhalten verbessern.

Crowd-basierte menschliche Überprüfung

Ein weiterer Teil des Trends ist Crowd-basierte oder On-Demand-HITL-Validierung. Services wie Amazon Mechanical Turk oder BPO-Partner lassen sich nahtlos in KI-Pipelines einbinden und liefern skalierbares HITL zu geringen Kosten. So können Unternehmen Automatisierung und Qualitätssicherung effizient ausbalancieren, ohne große interne Teams aufzubauen.

Denken Sie zum Beispiel an einen E-Commerce-Anbieter: KI verarbeitet Produktbewertungen, leitet fragliche Fälle aber in eine menschliche Validierungsschleife, die von einem externen HITL-Team bearbeitet wird – effizient, schnell und akkurat.

Branchendynamik für zugängliches HITL

Plattformen sollten Automatisierung via Low-Code ermöglichen, aber auch tiefe Anpassungen erlauben. Dieser Trend zeigt: HITL wird künftig so einfach umsetzbar sein wie eine E-Mail-Kampagne oder Website.

Das spiegelt auch die Entwicklung von Parseur wider. Während Parseur Flexibilität für eigene Vorlagen ermöglicht, falls Sie nicht der KI-Engine vertrauen möchten, werden HITL-Workflows zum Branchenstandard für verantwortungsvolle, menschlich geprüfte Automatisierung – und Parseur ist der Schlüssel zur Skalierung solcher Prozesse über viele Branchen hinweg.

Trend 4: Wandel der menschlichen Rolle – Vom Data Labeler zum strategischen Supervisor

Mit zunehmender Reife der KI-Systeme wandelt sich die menschliche Beteiligung. In der Anfangsphase hatte HITL oft monotone Aufgaben wie Datenlabeling oder Prüfung einfacher Ergebnisse zur Folge. Doch künftig übernehmen KI oder Crowdworker diese Routinetätigkeiten. Der Mensch wird dafür immer strategischer, spezialisierter und wertschöpfender eingesetzt.

Laut Statistica’s Report 2026 erledigten 2026 Menschen 47 % der Arbeit, Maschinen 22 % und 30 % verteilten sich auf beide. Bis 2030 erwarten Unternehmen eine noch stärkere Maschinenbeteiligung.

Ausblick: HITL 2.0 als Supervisoren und Risikomanager

Wir betreten das Zeitalter von „Human-in-the-Loop 2.0“. Hier sind Menschen nicht nur Prüfer, sondern Supervisoren, Coaches und KI-Risikomanager.

Beispiel: Eine Ärztin greift bei einer Medizin-KI nur dann ein, wenn das System Unsicherheit zeigt oder eine Anomalie meldet. Dieser menschliche Input dient nicht nur der Einzelfalllösung, sondern wird genutzt, um das KI-Modell weiter zu trainieren und künftige Prognosen zu verbessern. Dies ist Augmented Intelligence in Aktion: Mensch und KI lernen gemeinsam dazu.

Das World Economic Forum berichtet: Bis 2030 erwarten 60 % der Arbeitgeber, dass Digitalisierung den Bedarf an analytischen und Führungsfähigkeiten steigert, während manuelle Tätigkeiten abnehmen.

Ebenfalls relevant: „Human-on-the-Loop“ meint, dass Menschen automatisierte KI-Systeme kontinuierlich überwachen und nur bei Bedarf eingreifen – wie Fluglotsen für automatisierte Prozesse.

Menschen durch KI gestärkt

KI ist nicht nur Teil der Regelprozesse, sondern wird in Zukunft auch diejenigen unterstützen, die die Kontrolle ausüben. Beispielsweise kann ein KI-Tool Compliance-Verantwortliche proaktiv warnen: „Diese Entscheidung ist nicht konsistent mit früheren Fällen. Bitte prüfen.“ Menschen sind also nicht nur im Loop, sondern KI unterstützt sie beim intelligenten Steuern des Loops.

Neue Rollen und Verantwortlichkeiten

Bis 2030 könnten Jobtitel wie diese verbreitet sein:

- AI Feedback Specialist

- Algorithm Ethics Officer

- Model Behavior Coach

- Human-in-the-Loop Supervisor

Diese Aufgaben stehen für Qualitätssicherung und steuern die Weiterentwicklung von KI-Systemen – ein Wandel von der reinen Ausführung hin zur Systemverantwortung.

Das Deloitte Global Human Capital Trends 2026 berichtet, dass 57 % der Führungskräfte ihren Mitarbeitenden beibringen wollen, wie man mit Maschinen denkt, statt sie nur zu bedienen. Die menschliche Rolle verlagert sich also von der Ausführung zur strategischen Kontrolle.

Trend 5: Mensch-KI-Synergie und ethische KI als Wettbewerbsvorteil

Die Zukunft der KI wird nicht im Gegensatz Mensch versus Maschine gesehen – sondern im Zusammenspiel für effizientere, ethische und intelligentere Lösungen. Im Blick auf 2030 dominieren jene Unternehmen, die Automatisierung und menschliches Urteil am besten ausbalancieren.

Das ist Augmented Intelligence: Die Stärken der KI (Geschwindigkeit, Skalierung, Mustererkennung) verbinden sich mit den Stärken des Menschen (Ethik, Empathie, Fachexpertise). Das Resultat: intelligentere Entscheidungen auf allen Ebenen.

55 % der Unternehmen haben laut Gartner ein AI Board oder Gremium für ethisches KI-Management installiert. Das zeigt, wie zentral menschliche Aufsicht und Governance für den KI-Einsatz werden.

Warum Synergie gewinnt

Ab 2026 wird „Human-in-the-Loop“ nicht mehr optionales Sicherheitsnetz sein, sondern ein Kernelement vertrauenswürdiger KI-Systeme. Ob Kreditvergabe, Bewerberauswahl oder medizinische Empfehlungen: Menschliche Validierung sorgt für Genauigkeit und Vertrauen.

Unternehmen werden ihre HITL-Methoden gezielt als Unterscheidungsmerkmal vermarkten. Wie es bei „nachhaltig produziert“ oder „bio-zertifiziert“ üblich ist, könnten Labels wie „Human-Verified AI“ oder „KI mit menschlicher Kontrolle“ in der Produktkommunikation auftauchen, vor allem in sensiblen Branchen wie Gesundheit, Finanzen oder Bildung.

Wer sagen kann „Unsere KI wird von Menschen geprüft“, gewinnt mehr Nutzervertrauen – vor allem in Zeiten, in denen KI-Fehler schnell viral gehen und den Ruf gefährden können.

Ethische KI wird Business-Strategie

Prominente KI-Pannen zeigen, wie schnell ungeprüfte Automatisierung fatale Folgen haben kann: ein falsch klassifizierter Lebenslauf, ein voreingenommener Risikoscore oder eine fehlerhafte medizinische Diagnose verursachen Klagen, Shitstorms und Vertrauensverlust.

Wer menschliche Kontrolle fest in Hochrisiko-KI-Entscheidungen integriert, erfüllt nicht nur regulatorische Anforderungen, sondern signalisierte Verantwortung gegenüber Kunden. Ethische KI ist damit keine moralische Frage mehr, sondern Business-Notwendigkeit.

Zertifizierungen und auditierbare Systeme

Bald könnten KI-Systeme speziell für HITL-Compliance zertifiziert werden. Wie ISO-Standards für Sicherheit und Qualität werden künftige KI-Plattformen vielleicht Labels tragen, die belegen, dass Entscheidungen von Menschen geprüft, erläutert und revidiert werden können.

Das eröffnet einen klaren Wettbewerbsvorteil. Unternehmen mit transparenter, auditierbarer und menschlich geführter KI gewinnen das Vertrauen von Kundschaft, Investoren und Regulatoren.

Das NIST AI Risk Management Framework fordert, KI mit eingebauter Kontrolle zu designen. Dabei werden Human-in-the-Loop und Human-on-the-Loop als Schlüsselelemente gesehen, um systemische Risiken zu senken. In Zukunft könnten diese Kontrollfunktionen für Hochrisiko-KI sogar gesetzlich vorgeschrieben sein.

Human-in-the-loop by Design

Das Prinzip „HITL by Design“ gewinnt an Dynamik. Anstatt menschliche Kontrolle nachträglich einzubauen, wird KI künftig von Anfang an mit HITL als Grundprinzip konstruiert. Das steht für den Wandel zu verantwortungsvoller KI, bei der Fairness, Transparenz und Kontrolle von Beginn an in den Produktlebenszyklus eingebettet sind.

Führende Unternehmen leben diesen Ansatz bereits.

Am Ende geht es nicht um Mensch gegen Maschine, sondern um Mensch mit Maschinen. — Satya Nadella, CEO von Microsoft

Diese Perspektive prägt die Produktentwicklung über Branchen hinweg – von Unternehmenssoftware bis zu Consumer-Tech.

Bis 2030: Mensch und KI Hand in Hand

Mit fortschreitender KI wird eines offensichtlich: Die Zukunft gehört Unternehmen, die Automatisierung mit menschlicher Expertise verbinden.

KI kann laut PwC bis 2030 bis zu 15,7 Billionen Dollar zur Weltwirtschaft beitragen.

HITL verschwindet mit dem Fortschritt der KI nicht, sondern wird sich weiterentwickeln und zur strategischen Notwendigkeit – als natürlicher Bestandteil ethischer, erklärbarer und vertrauenswürdiger KI-Systeme.

Bis 2030 wird menschliche Kontrolle ein fundamentales Designprinzip sein, kein provisorischer Schutzmechanismus mehr. HITL wird in Regulatorien und Plattformfähigkeiten erwartet – Unternehmen, die früh einsteigen, sichern sich nachhaltigen Erfolg.

Man kann es so sehen: Wie der Sicherheitsgurt zum Standard in jedem Auto wurde, werden HITL-Mechanismen Standard in jeder ernsthaften KI-Anwendung – zum Schutz der Nutzer, zur Fehlervermeidung und für verantwortungsvolle Innovation.

Jetzt ist die Zeit, sich darauf vorzubereiten. Amazon schätzt, dass Europa bis 2030 nahezu flächendeckende KI-Adoption erlebt.

Führungskräfte und Strategen sollten jetzt:

- In erklärbare KI-Tools und Schnittstellen investieren

- Menschliche Aufsichtsrollen in ihren Teams aufbauen

- Plattformen wählen, die einfache menschliche Validierungen zulassen

- Prozesse so gestalten, dass Menschen und KI standardmäßig zusammenarbeiten

Mit zunehmender Regulierung und steigendem Bedarf an Vertrauen legen diese Praktiken das Fundament für Widerstandsfähigkeit, Agilität und ethische Führung.

Zuletzt aktualisiert am