Stora språkmodeller (LLM:er) erbjuder en oslagbar flexibilitet för att förstå ostrukturerad text, vilket gör dem idealiska för resonemang, sammanfattningar och dokumentuppgifter med låg volym. Deras sannolikhetsbaserade karaktär, latens och brist på deterministisk precision gör dem dock otillräckliga som fristående lösning vid automatisering av stora mängder eller reglerade dokument.

Viktiga Insikter:

- Strategisk Flexibilitet: LLM:er utmärker sig vid tolkning av ostrukturerade, nya eller mycket varierande dokument, vilket möjliggör snabbare onboarding och uppgifter med stort inslag av resonemang.

- Operationella Begränsningar: För strukturerade arbetsflöden med hög volym kan LLM:er leda till fel, långsam bearbetning och bristande regelefterlevnad. Deterministiska system är fortsatt nödvändiga.

- Hybridfördel: De mest effektiva strategierna för dokumentautomatisering kombinerar LLM:er med specialiserade plattformar som Parseur, där AI ger kontextuell förståelse medan deterministisk extraktion säkerställer noggrannhet, skalbarhet och regelefterlevnad.

Automatiseringsparadoxen

Stora språkmodeller (LLM:er) har i grunden förändrat vår förmåga att förstå naturligt språk. Deras förmåga att förklara ostrukturerad text, tolka innebörd och generalisera mellan domäner har breddat det tekniskt möjliga inom dokumentautomation. Uppgifter som tidigare krävde rigida regler eller omfattande manuell konfiguration kan nu hanteras med betydligt större flexibilitet.

LLM:ers Begränsningar

Denna flexibilitet skapar dock en paradox för företagsautomation. Även om LLM:er presterar bra i resonemangsorienterade eller lågvolymsscenarier, visar standarder från Hyperscience att de ofta bara når 66–77 % exakt matchningsnoggrannhet på kritiska dokumentuppgifter som fakturor och fraktsedlar – jämfört med över 93–98 % för specialiserade IDP-system.

Men denna flexibilitet skapar också ett dilemma: LLM:er är inte byggda för att fungera som officiella registersystem, där deterministisk exakthet, fasta scheman och förutsägbar prestanda är ett krav.

Icke-deterministiska utdata, variabel latens (API-begränsningar) och ökade inferenskostnader på grund av tokenvolym och GPU-efterfrågan gör det svårt att driftsätta rena LLM-baserade system i produktionsmiljöer där snabbhet, konsekvens och förutsägbarhet krävs.

Hybrid IDP på Frammarsch

Företagsdokumentautomation kräver därför i allt högre grad en hybrid strategi. Hybridarkitekturer för Intelligent Document Processing (IDP) kombinerar LLM:ers anpassningsförmåga med precisionen hos specialiserade extraktionsmotorer och deterministisk logik – och möjliggör därmed högsta effektivitet och kvalitet.

Detta speglar en växande insikt: Ingen enskild teknologi kan samtidigt optimera flexibilitet, noggrannhet, kostnad och styrning. Företag prioriterar därför arkitekturer som tydligt separerar resonemang från exekvering, så att varje lager kan optimeras för sin operativa roll – istället för att överbelasta LLM:er med deterministiska uppgifter de inte är skapade för.

Enligt Fortune Business Insights förväntas den globala IDP-marknaden växa från 14,16 miljarder dollar år 2026 till 91,02 miljarder dollar år 2034, med en CAGR på 26,20 % – vilket visar den ökande efterfrågan på dessa tillförlitliga system bland stora företag med stor dokumentvolym. I denna modell används LLM:er selektivt när kontextuell förståelse tillför värde, medan högvolymsextraktion, validering och efterföljande automatisering hanteras av system byggda för pålitlighet, kostnadskontroll och regelefterlevnad.

Den strategiska implikationen är tydlig: LLM:er är en stark komponent i modern dokumentautomation, men de ersätter inte specialiserade processmotorer. Organisationer som matchar varje teknik med dess rätta styrka är bäst positionerade att skala automation utan att kompromissa med noggrannhet, styrning eller prestanda.

Vad är Stora Språkmodeller (LLM:er)?

Stora språkmodeller (LLM:er) är en klass av maskininlärningsmodeller designade för att förstå, generera och resonera kring naturligt språk i stor skala. De tränas på stora textkorpusar med hjälp av djupa neurala nätverk, ofta transformer-arkitekturer som lär sig statistiska samband mellan ord, fraser och begrepp.

Förenklat arbetar LLM:er genom att förutsäga den mest sannolika nästa token (ord eller symbol) givet en sekvens av tidigare tokens. Tillgången till massiva och varierande datamängder möjliggör komplexa beteenden såsom sammanfattning, klassificering, frågebesvarande, översättning och kontextuellt resonemang. Vid dokumenthantering innebär detta att LLM:er kan förklara fritext, tolka innebörd mellan stycken och anpassa sig flexibelt till varierande layouter och språkstilar.

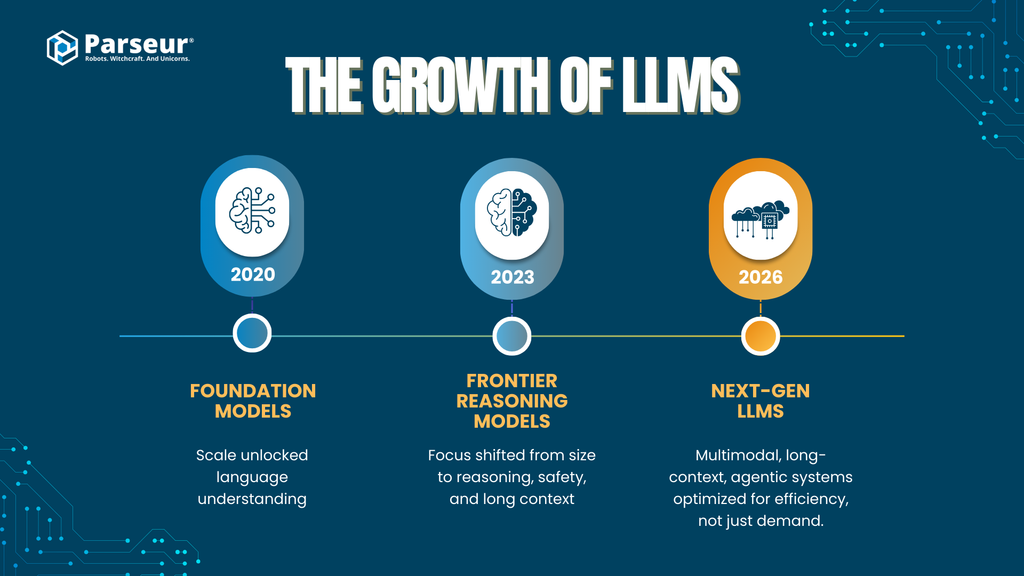

Skala och Utveckling av LLM:er

Kapaciteten hos stora språkmodeller har vuxit snabbt i takt med ökad modellskala och förbättrade träningsmetoder hos ledande AI-leverantörer:

- Tidiga grundmodeller (2020–2021)

Modeller som GPT-3 introducerade storskaliga transformer-arkitekturer (~175 miljarder parametrar) och visade att skalan i sig kan låsa upp stark generell språkförståelse.

- Andra generationens spetsmodeller (2023–2024)

Modeller som GPT-4, Claude 2/3 (Anthropic), Gemini 1.x (Google) och DeepSeek-LLM fokuserade då mer på förbättrat resonemang, säkerhetstuning och längre kontextfönster snarare än parametermängd. Majoriteten anger inte längre exakt antal parametrar, men modellerna tros arbeta på eller över biljonersnivå tack vare mixture-of-experts och arkitekturoptimeringar.

- Söknings- och återhämtningsförstärkta modeller

Plattformar som Perplexity AI betonar retrieval-augmented generation (RAG), där LLM-resonemang kombineras med realtidssökning och citeringsmekanismer för bättre faktakontroll och minskad hallucinering vid kunskapsintensiva uppgifter.

- Nästa generations LLM:er (2025–2026)

Branschens fokus skiftar mot:

- Multimodalitet (text, bilder, tabeller, dokument, ljud)

- Långkontextanalys (hundratusentals till miljontals tokens)

- Agentiska kapabiliteter (verktygsanvändning, flerstegsresonemang, orkestrering)

- Effektivisering och specialisering snarare än linjär storleksökning

Denna utveckling vittnar om en bredare industririktning: Förbättringar drivs alltmer av arkitektur, verktyg och systemdesign snarare än ren parametermängd – vilket är centralt för dokumentautomatisering i företag.

Trender för Företagsanvändning

- LLM:er går från pilot till produktion

- 78 % av företag rapporterar att generativ AI används i minst en affärsfunktion – inklusive drift, analys och automation.

- Införandet i produktion accelererar kraftigt

- Över 80 % av företagen väntas, enligt Gartner, använda generativa API:er eller ha produktionssatta GenAI-applikationer 2026 – jämfört med under 5 % år 2023.

- Dokumentautomatisering är ett toppanvändningsområde

- Dokumentautomation och dataextraktion hör till de ledande GenAI-applikationerna, motiverat av behovet att minska manuellt arbete, korta ledtider och öka driftseffektivitet (McKinsey, Gartner).

Relevans för Dokumentautomatisering

I dokumentflöden används LLM:er huvudsakligen för att:

- Hantera ostrukturerad eller semistrukturerad text

- Klassificera dokument efter typ eller syfte

- Extrahera fritt definierade fält där strikta regler inte räcker till

- Hantera språkvariation mellan leverantörer, regioner och format

LLM:er briljerar vid tolkning och resonemang men är i grunden sannolikhetssystem. Utdata genereras baserat på sannolikhet, inte deterministiska regler. Denna egenskap har stor påverkan på noggrannhet, repeterbarhet, kostnad och styrning i storskalig automatisering.

Denna skillnad skapar den centrala frågan för företag: var ger LLM:er strategiskt värde, och när krävs specialiserade dokumentsystem?

Kärnkapaciteter: Där LLM:er Briljerar (Den Strategiska Nivån)

Stora Språkmodeller kommer bäst till sin rätt i dokumentautomationens strategiska lager, där flexibilitet, semantisk förståelse och resonemang väger tyngre än absolut precision. Deras styrkor är kvalitativa – inte mekaniska – vilket gör dem särskilt effektiva i tidig automation, undantagsfall och kunskapsintensiva arbetsflöden.

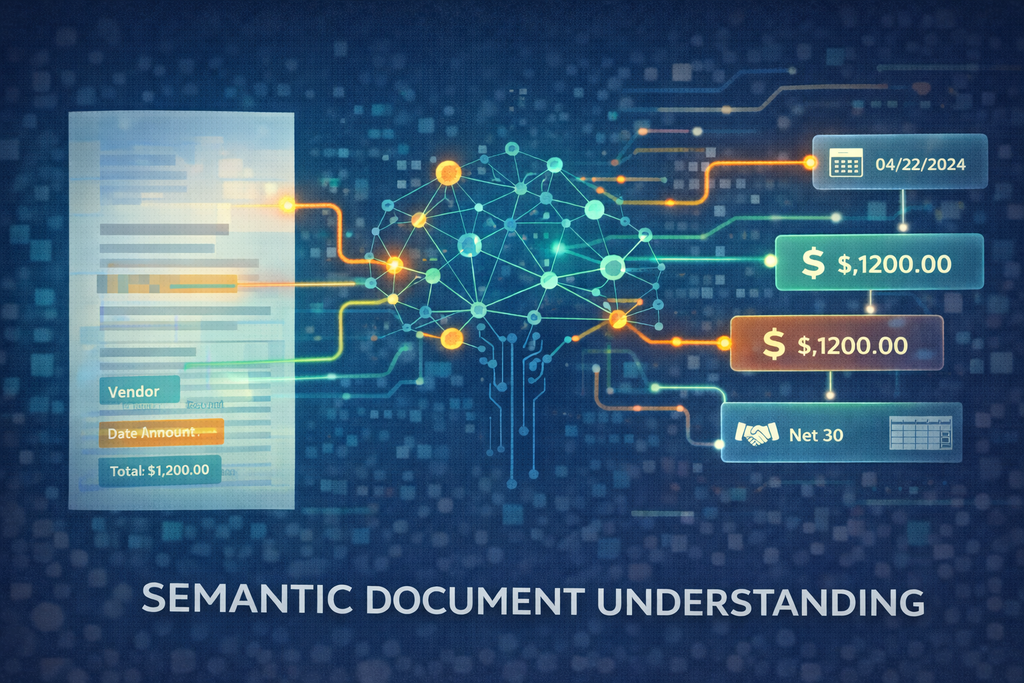

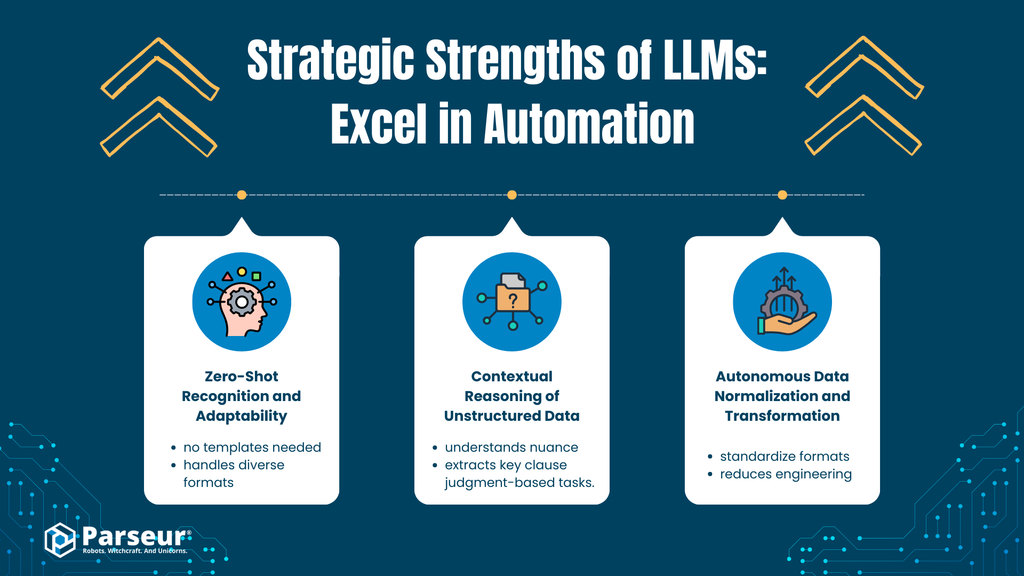

A. Zero-Shot-kännedoms och Anpassningsbarhet

Analys

LLM:er har stark semantisk förståelse och kan hitta samt extrahera relevant data ur dokumenttyper och layouter de aldrig sett förut. Till exempel kan en LLM lokalisera ett fakturanummer, förfallodatum eller totalbelopp från en ovanlig faktura från en ny leverantör, även om etiketter, placering och format skiljer sig från tidigare exempel.

Denna förmåga bygger på generell språkmodellering, inte dokumentspecifik träning. Modellen utläser helheten ur kontext, inte regler eller färdiga mallar.

Affärsnytta

- Snabbar upp värdeskapandet genom att minska konfigurationsbehovet

- Minskar beroendet av stora mängder märkta träningsdata

- Möjliggör snabbare onboarding av nya leverantörer, format och dokumenttyper

För organisationer med dynamiska eller heterogena miljöer minskar denna anpassningsbarhet automatiseringsfriktionen vid införande.

B. Kontextuellt Resonemang i Ostrukturerade Data

Analys

Till skillnad från regelbaserade system (t.ex. reguljära uttryck eller positionsbunden logik) kan LLM:er analysera nyanser, intention och underliggande innebörd i ostrukturerad eller semistrukturerad text – även i långa texter såsom e-post, avtalsklausuler, policydokument och kundmeddelanden.

De extraherar betydelse ur berättande språk, förstår relationer mellan begrepp och kan resonera mellan stycken – något som är fundamentalt svårt att koda med deterministiska regler.

Affärsnytta

- Möjliggör automation av arbetsflöden som kräver bedömningsbaserat resonemang

- Stödjer t.ex.:

- Klassificering av kundintention

- Klausulidentifiering i juridiska texter

- Extrahering av datum, skyldigheter eller risker ur berättande dokument

- Minskar behovet av manuell granskning i kunskapskrävande processer

Där strukturens och kontextens variation är central, tillför LLM:er ett tydligt värde.

C. Självständig Datastandardisering och Transformation

Analys

LLM:er kan standardisera extraherad data redan vid generering. De kan till exempel:

- Omvandla olika datumformat till normaliserad form (t.ex. ISO 8601)

- Standardisera valutor och talformat

- Harmonisera fältnamn mellan inkonsekventa källor

Detta minskar behovet av efterföljande transformeringslogik, skräddarsydd kod eller bräckliga efterbehandlingsflöden.

Affärsnytta

- Förenklar integration med efterföljande system (ERP, CRM, analysplattformar)

- Minskar tidsåtgång för datapreparering och formatjustering

- Ökar hastigheten för bevis på koncept och pilotprojekt

Strategiska styrkor hos LLM:er inom automation

Övergripande bidrar LLM:er med flera avgörande fördelar till företags automatiseringsinitiativ:

Naturlig Språkförståelse i stor skala

Extrahera, summera och kategorisera ostrukturerad text även vid stora datamängder.

Semantisk Flexibilitet

Identifiera innebörd trots variationer i formulering, layout eller intention.

Generaliserat, Icke-regelbundet Resonemang

Klassificera, analysera och känna igen mönster utan komplexa regelträd.

Snabb Domänöverförbarhet

Applicerbart inom kundservice, juridik, kunskapshantering och interna verktyg.

Grund för agentiska arbetsflöden

Möjliggör promptkedjor, uppdelning av uppgift och beslutsorkestrering i AI-drivna system.

Ett exempel: En av våra SaaS-klienter hanterar cirka 4 000 fakturor årligen och startade ett projekt för att automatisera sitt fakturaflöde. Med hjälp av LLM:er kunde kunden uppnå en 40-procentig minskning av det manuella arbete som annars krävdes för standardfakturor. Men vid försök att hantera fakturor från äldre leverantörer med avvikande format och skannade PDF:er misslyckades LLM:erna med att extrahera totalbelopp och datum korrekt. Lösningen blev att kombinera LLM:er med regelbaserad kontroll och OCR-verifiering. Det är viktigt att förstå att LLM:er bäst används som ett stödjande verktyg, snarare än den primära motorn, i dokumentautomatisering. - Nick Mikhalenkov, SEO Manager, Nine Peaks Media

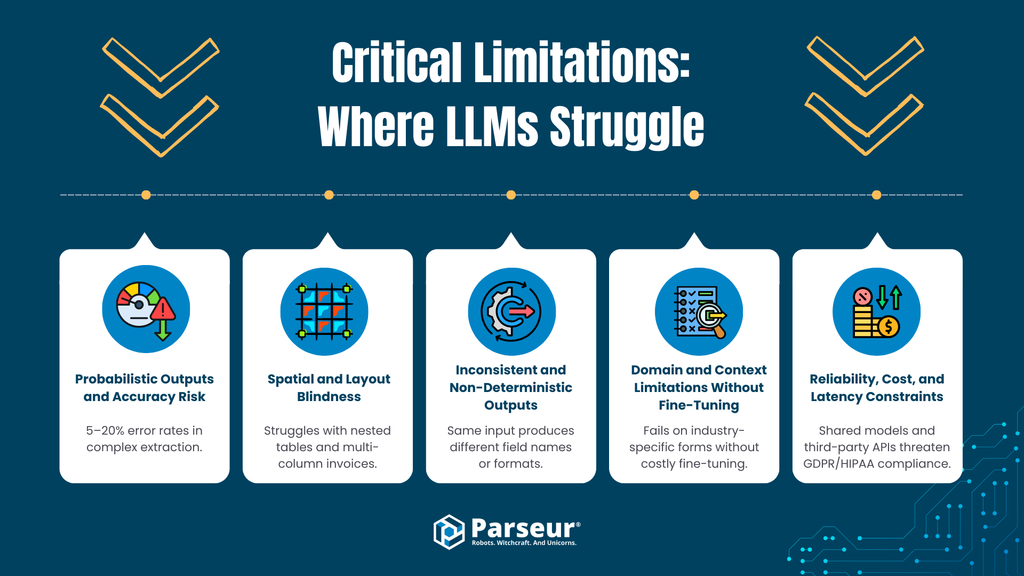

Kritiska Begränsningar: Där LLM:er Brister (Den Operativa Nivån)

Trots de strategiska vinsterna blir LLM:ers begränsningar tydliga vid högvolyms- och produktionsklar dokumentautomation. På operativ nivå, där noggrannhet, konsekvens, snabbhet och kostnadskontroll är icke-förhandlingsbara, innebär strategier som enbart bygger på LLM:er mätbar risk.

A. Sannolikhetsbaserad Output och Risk för Fel

Begränsning

LLM:er är sannolikhetssystem; de genererar utdata utifrån statistisk sannolikhet och inte deterministiska regler. Även avancerade modeller ger mätbara nivåer av inkorrekta eller påhittade svar. Enligt branschstandard har ledande modeller som GPT-4o och liknande fortfarande betydande hallucination/fel – med Master of code som rapporterar 5–20 % fel/hallucinationer vid komplexa resonemangs- och extraktionsuppgifter.

Operationell risk

Vid ekonomiska och verksamhetskritiska flöden som leverantörsfakturor, kundreskontra, inköp eller rapportering är slumpmässiga fel oacceptabla. Ramps data visar att manuell fakturahantering redan ger fel i 1–3 % av fallen, vilket blir 10–30 problemfyllda transaktioner per 1 000 fakturor. Fel leder till missade rabatter, försenade betalningar och dyr uppföljning. Till skillnad från regelbaserade system kan LLM:er inte garantera identiskt resultat vid identisk input utan omfattande valideringslager och manuell granskning – vilket motverkar effektivitetsvinster från automation.

B. Omedvetenhet om Sidlayout och Spatiala Relationer

Begränsning

De flesta LLM:er bearbetar text sekventiellt och saknar inbyggd förståelse för spatiala relationer. Även om de läser extraherad text, har de svårt att tolka ut layoutberoende innebörd, t.ex.:

- Fakturor med flera kolumner

- Inbäddade/komplexa tabeller

- Huvudrubriker som sträcker sig över flera kolumner

- Värden vars betydelse avgörs av deras placering, inte etiketter

Dock utvecklas detta område när nya modeller lanseras.

Operationell risk

I strukturerade dokument är layouten regeln. Felläsning av rad- eller kolumnförbindelser leder till:

- Rader blandas ihop med fel pris/antal

- Totalbelopp hamnar i fel fält

- Rubrikvärden feltolkas över rader och kolumner

Dessa fel är svårupptäckta och mycket skadliga i automatiserade arbetsflöden.

C. Inkonsekvent och Icke-deterministisk Output

Begränsning

LLM:er upprätthåller inte fasta scheman per automatik. Vilka fält som finns, deras namn, format och ordning kan variera mellan körningar – särskilt vid ändrade prompts eller marginella dokumentskillnader.

Operationell risk

Företagssystem kräver schema-stabila resultat (t.ex. fasta JSON-strukturer, enhetliga fältnamn och datatyper). Variansen tvingar team att:

- Bygga komplex validerings- och korrigeringslogik

- Hantera många oförutsedda specialfall

- Säkerställa manuell granskning

Detta undergräver den driftsäkerhet som krävs vid helautomatiska flöden.

D. Domän- och Kontextgränser utan Finjustering

Begränsning

Trots bred allmänkunskap kämpar LLM:er med att hantera domänspecifika dokument (t.ex. logistikdokument, skattedeklarationer, branschanpassade fakturor) utan finjustering eller prompt engineering.

Operationell risk

Finjustering innebär ny komplexitet:

- Kräver särskilda dataset

- Ökar utvecklingstiden

- Driver frågor kring dataskydd och lagringstid

- Kräver pågående underhåll

För många företag försvinner därmed den utlovade plug-and-play-fördelen.

E. Tillförlitlighet, Kostnad och Latens

Begränsning

LLM-inferens, särskilt agentisk eller flerstegsbearbetning, är kostnadskrävande. I praktiken tar LLM-baserade extraktionsflöden 8–40 sekunder per dokument, jämfört med millisekunder för specialiserade OCR- och extraktionsmotorer.

Operationell risk

I skala uppstår kraftiga kostnads- och prestandaproblem:

- API-kostnaden kan bli 10–100× högre per dokument än specialiserade IDP-system

- Latens blir en flaskhals i tidskritiska flöden

- Begränsad genomströmning vid batchkörning eller toppar

Om tusentals dokument per månad ska hanteras, kan kostnadseffektiviteten raseras.

F. Dataskydd och Regelefterlevnad

Begränsning

Många LLM-integrationer bygger på tredjeparts-API:er, delade modeller och otydliga datalagringsprinciper. För reglerade verksamheter väcker det frågor kring:

- GDPR och principen om ändamålsbegränsning

- Rätten till radering och revisionsspår

- HIPAA, GLBA och branschspecifik efterlevnad

Operationell risk

När dokument behandlas i modeller som kan logga, lagra eller återanvända data för träning tappar företaget kontrollen över känsliga uppgifter. Detta innebär ofta en regelefterlevnadsrisk som inte helt kan hanteras genom avtal.

Enligt min uppfattning är en av de största begränsningarna för stora språkmodeller i dokumenthantering att de brister i precision när det är som viktigast. LLM:er är skickliga på att sammanfatta och förstå textens innebörd, men brister vid strukturerad dataextraktion – där små fel (som en felplacerad decimal eller ett felaktigt datum) kan få stora konsekvenser. Dessutom framstår LLM:er ofta som mycket självsäkra även när underlaget är ofullständigt eller tvetydigt.

Inom utbildningsrelaterade användningsfall ser jag att LLM:er fungerar bra för summering eller förklaring men misslyckas konsekvent vid extraktion av standardiserad information från t.ex. betygsutdrag eller provresultat. Regelbaserade system med mänsklig kontroll slår idag fortfarande ren LLM-automation på detta område. - Joern Meissner, Grundare & Ordförande, Manhattan Review

Sammanfattning: Strategisk Intelligens vs. Operativ Tillförlitlighet

Stora språkmodeller (LLM:er) är oöverträffade vid naturlig språkförståelse och semantisk tolkning, men har klara begränsningar i precision, deterministisk extraktion, layoutförståelse, kostnadseffektivitet och regelefterlevnad. Deras sannolikhetsbaserade natur och längre bearbetningstider gör en ren LLM-strategi riskabel för volymintensiva processer som fakturahantering eller automatisering av kund- och leverantörsreskontra.

Framväxten av “Agentic AI” i Dokumentbehandling

Många försöker nu övervinna bristerna hos ren LLM-extraktion genom en ny arkitektur: Agentic AI. Här agerar LLM:er som orkestratörer, anropar externa verktyg, tillämpar flerstegsresonemang och validerar iterativt sina egna resultat.

Vad är Agentic AI?

Agentic AI innebär att en LLM:

- Delar upp uppgiften i flera steg

- Anropar externa verktyg (OCR-motorer, kalkylatorer, databaser, valideringsskript)

- Granskar och reviderar egen output

- Upprepar processen tills acceptabel säkerhet uppnås

I dokumenthantering innebär detta ofta att LLM:en extraherar data, kontrollerar totalsummor, omfrågar dokumentet och rättar avvikelser innan slutresultatet levereras.

Förväntad Fördel: Färre Hallucinationer

Genom valideringsloopar och verktygsbaserat resonemang minskar agentiska flöden vissa klassiska LLM-fel:

- Numeriska inkonsekvenser

- Saknade fält

- Uppenbara logiska fel (t.ex. totalsumma stämmer inte)

Metoden går från en enstaka gissning till ett självgranskande system, vilket ökar tillförlitligheten vid komplexa eller tvetydiga dokument.

Nackdelar: Latens, Kostnad och Systemkomplexitet

Agentisk AI höjer resonemangsrobustheten men introducerar betydande driftmässiga nackdelar:

Latens

Varje resonemangs- och verktygssteg tar tid. Praktiskt kan agentisk dokumentextraktion ta 8–40 sekunder per dokument, vilket är långsamt för realtid eller massbearbetning.

Kostnad

Flera LLM-anrop per dokument exploderar tokenkostnader och API-pris. I skala kan det bli betydligt dyrare än deterministiska extraktionsflöden.

Ingenjörskomplexitet

Agentiska system kräver:

- Orkestreringsramverk

- Felhantering över flera verktyg

- Övervakning och loggning

- Kontinuerlig justering av prompts och logik

Detta ökar integrationsarbete och underhåll på längre sikt.

Operativ verklighet: Inte för massautomation

Där tusentals dokument hanteras varje månad är dessa kompromisser svåra att motivera. Högvolymautomation kräver:

- Förutsägbar latens

- Stabil kostnad

- Deterministiska utdata

- Enkla felvägar

Agentic AI höjer resonemangsdjupet, inte operationell effektivitet.

Slutsats: Kraftfullt, men Begränsat till Specialfall

Agentic AI är ett viktigt framsteg för LLM:er vid komplexa uppgifter, men dess styrkor matchar bäst:

- Lågvolyms- och högkomplexitetsuppgifter

- Undantagshantering och kantfallsanalys

- Kunskapsintensiv dokumentgranskning

Det är inte lämpat för massregistrering av data eller automatiska dokumentflöden i produktion.

Agentic AI förbättrar LLM-resonemang men eliminerar inte kärnkompromissen i sannolikhetsmodeller. För högvolymsautomation är det ett komplement – inte ett substitut – för deterministiska extraktionssystem.

Därför Behövs Fortfarande Specialiserade Verktyg (Parseur och Värdet av Syftesspecifika Motorer)

När intresset för LLM-driven automation växer antar många att generella modeller kan ersätta traditionella dokumentsystem. I praktiken sker tvärtom: Företag som når pålitlig automatisk hantering använder LLM:er och specialiserade motorer i samverkan – där varje del ger sitt unika värde.

Syftesbyggda plattformar som Parseur finns inte för att LLM:er saknar intelligens, utan för att företagsautomation ställer krav på precision, förutsägbarhet och effektivitet snarare än generell språkförståelse.

Precision i stor skala

Dokumentautomation styrs av andra krav än konversations-AI. Fakturor, beställningsblanketter och finansiella blanketter kräver fältexakthet, inte ungefärlig förståelse.

Specialiserade dokumentmotorer använder:

- Regelstärkt extraktion

- Layoutmedveten mönsterigenkänning

- Klassificeringsmodeller tränade på strukturer

Detta ger deterministisk output, så att samma dokument alltid ger exakt samma resultat.

LLM-baserad extraktion är däremot sannolikhetsstyrd. Även låga felnivåer ackumuleras snabbt i volym och leder till kostsam manuell hantering.

Konfigurerbara Regler och Målstyrd Inlärning

Moderna dokumentplattformar är inte rent regelbaserade. De kombinerar:

- Konfigurerbara mallar och valideringsregler

- Lätta klassificeringsmodeller

- AI-hjälpt fältigenkänning

Hybridmetoden levererar över 95% fältnoggrannhet även vid varierande dokumentformat.

LLM-baserade flöden har oftast högre felfrekvens på strukturerade dokument, medan IDP-system har visats reducera extraktions- och inmatningsfel med över 52 % jämfört med manuella arbetssätt.

Skillnaden är kontroll. Företag definierar uttryckligen:

- Godkända format

- Valideringslogik

- Fallback- och undantagshantering

Denna determinism är svår att uppnå med endast prompts.

Integration och Arbetsflödesmognad

Syftesbyggda plattformar är gjorda för produktion, inte experimentnivå.

Mogna verktyg ger:

- Stabila REST-API:er och webhooks

- Integrationer med ERP, ekonomi och CRM-system

- Kompatibilitet med automationsplattformar (Zapier, Make, Power Automate)

- Inbyggd övervakning, omkörningar och felhantering

Organisationer kan därmed driftsätta automation som robust systemkomponent – inte som en bräcklig samling skript och prompter.

LLM:er passar bäst i logik- och resonemangsskiktet, medan specialiserade verktyg sköter operationell drift.

Inbyggd Säkerhet och Regelefterlevnad

Säkerhet och regeluppfyllelse är centralt i företagsdokumentation.

Specialiserade plattformar som Parseur erbjuder:

- Dataisolering per kund (multi-tenancy)

- Kryptering vid lagring och överföring

- Konfigurerbar lagringstid

- GDPR-kompatibel datahantering

Eftersom dessa system inte tränar globala modeller på kunddata undviks många av de dataskyddsutmaningar som delade AI-plattformar innebär.

I reglerade branscher är detta avgörande: Efterlevnad avgörs inte bara av hur data lagras utan även om den återanvänds.

Där de Möts: LLM:er Inuti Dokumenthanteringsverktyg

När företag lämnar experimentstadiet växer en pragmatisk modell fram: LLM:er integreras inuti dokumenthanteringsverktyg, inte som självständiga extraktionsmotorer. Denna hybridstrategi sammanfogar LLM:ers flexibilitet med deterministiska systems robusthet.

LLM:er används alltså alltmer som stödjande lager, för att öka flexibilitet, felhantering och intelligens, medan primär extraktion sker styrt och kontrollerat.

Det återspeglar det bredare arkitekturprincipen: LLM:er fungerar bäst när de omsluts av system med krav på noggrannhet, prestanda och regelefterlevnad.

Promptstyrd Korrigering och Berikning

En av de mest effektiva tillämpningarna av LLM-integration är berikning efter extraktion.

Så här:

- En deterministisk eller layoutmedveten motor extraherar kärnfält (t.ex. fakturanummer, totalbelopp, förfallodatum).

- En LLM används för att:

- Normalisera beskrivningar

- Lösa tvetydiga etiketter

- Lägga till kontextuell metadata (t.ex. leverantörsklassning, identifiering av betalningsvillkor)

LLM:en används efter primär extraktion, så dess sannolikhetsbaserade natur påverkar inte kärnresultaten. Fel går att fånga upp, verifiera eller ignorera utan att äventyra arbetsflödet.

Det ger flexibilitet utan systemrisk.

Human-in-the-Loop Validering med LLM-sammanfattning

Ytterligare ett mönster är att LLM:er assisterar mänskliga granskare.

Exempel:

- Sammanfattar långa dokument med utvalda nyckelfält eller avvikelser

- Förklarar varför ett fält fallerat validering

- Skapar naturliga granskningsanteckningar för revisionsspår

I dokumentplattformar minskar detta den kognitiva belastningen vid undantag, samtidigt som slutkontroll förblir mänsklig.

Detta leder till högre genomströmning och mindre beroende av LLM:er för kritisk datainmatning.

Agentic AI-Flöden: LLM Orkestrerar Deterministiska System

Avancerade plattformar testar även agentiska AI-flöden där LLM:er koordinerar flera verktyg i extraktionskedjan.

Här fungerar:

- LLM:en som orkestreringslager

- Deterministiska system för OCR, klassificering och extraktion

- Valideringsregler upprätthåller krav

- Mänsklig inblandning sker bara vid avvikelser

Men det kräver avgränsning: agentiska flöden ger latens, högre kostnad och större komplexitet och passar bäst för:

- Lågvolyms- och variansrika dokument

- Systemövergripande avstämning

- Undantagsdrivna arbetsflöden

Vid masshantering kompletterar detta, snarare än ersätter, specialiserade motorer.

Därför Blir Hybridarkitektur Standard

Den ökande LLM-integrationen i dokumentextraktionsverktyg speglar en mognad förståelse för AI:ns styrkor och begränsningar.

Hybrida system ger:

- Deterministisk precision för strukturerad data

- Semantisk flexibilitet för undantag

- Förutsägbar kostnad och prestanda i volym

- Starkare regelefterlevnad och spårbarhet

Strategisk Slutsats

Framtidens dokumentautomation är inte LLM-first, den är LLM-aware.

Företag som lyckas 2026 och framåt är de som:

- Använder LLM:er för förbättrat beslutsstöd och flexibilitet

- Förlitar sig på syftesbyggda motorer för den operativa driften

- Designar system där intelligens kombineras med pålitlighet

När ska LLM:er användas jämfört med specialiserade dokumenthanteringsverktyg?

| Beslutsparameter | Använd stora språkmodeller (LLM:er) | Använd specialiserade verktyg (t.ex. Parseur) |

|---|---|---|

| Dokumentvariation | Mycket varierande, nya, ostrukturerade dokument (e-post, fritext, avtal) | Enhetliga eller semistrukturerade dokument (fakturor, kvitton, formulär) |

| Noggrannhetskrav | Rådgivande eller assisterande resultat, där manuell granskning är acceptabel | Automatisering av grunddata (system-of-record) som kräver deterministisk precision |

| Feltröskel | Tillfälliga fel är acceptabla | Nästan nolltolerans för fel |

| Regulatorisk risk | Icke-känslig eller oreglerad data | Reglerad data (GDPR, CCPA, finans, sjukvård) |

| Datasekretess & Suveränitet | Data för resonemang/berikning, med kort lagringstid | Strikt dataisolering, spårbarhet, rätt till radering |

| Volymbearbetning | Låg till måttlig volym | Hög volym (tusentals–miljontals dokument/månad) |

| Latenskrav | Sekunder per dokument acceptabelt | Millisekundsnivå eller nästintill realtid |

| Kostnadseffektivitet | OK i låg volym; snabbt stigande kostnad i skala | Stabil, låg styckkostnad i hög volym |

| Integrationskomplexitet | Flexibla utdata, löst kopplade flöden | Fasta scheman, ERP/RPA/ekonomiintegrationer |

| Lämpliga användningsfall | Klassificering, sammanfattning, avsiktsigenkänning, berikning | Fakturahantering, AP/AR, formulärextraktion, compliance-flöden |

Framtidsutsikter: LLM:er, Agentiska System och Automation

Landskapet för AI-driven dokumentautomatisering förändras snabbt. Företag bör inte bara förstå nuvarande LLM-möjligheter utan också framtidens trender som kommer forma automation de närmaste åren.

1. Nästa Generations LLM-arkitekturer

- Multimodala modeller: LLM:er bearbetar i allt högre grad text, bilder, tabeller och dokument parallellt – vilket öppnar nya möjligheter för faktura-, formulär- och PDF-automation.

- RAG-modeller: Genom integrering med externa kunskapskällor förbättras träffsäkerhet och kontexttolkning utan reträning på känslig kunddata.

- Agentic AI-flöden: Flerstegsslingor och verktygsintegration gör det möjligt för LLM:er att självständigt lösa t.ex. validering av summor över flera fält, komplexa kontrakt eller avvikelsehantering.

2. Företagsadoption

- Framtidsprognoser: AI antas bli universellt i stora bolag till 2027, där generativ AI blir kärna i automation, innehållsbearbetning och kunskapsflöden. Hybrida automationsstackar blir troligen norm.

- Fokus för adoption ligger på minskat manuellt arbete, snabbare drift och insikter ur ostrukturerad företagsdata.

3. Förklarbarhet, Trovärdighet och Kontroll

- Allteftersom LLM-användningen växer ökar kravet på förklarbar AI och mekanismer för granskning, beslutskontroll och regelefterlevnad.

- Mänsklig översyn (Human-in-the-loop) förblir kritiskt, särskilt för avtal, fakturor och finansiella dokument.

- Automationsstrategier kommer i hög grad gynna hybridarkitektur där LLM-flexibilitet kombineras med deterministisk säkerhet.

Balans mellan AI-intelligens och Operativ Kontroll

Stora språkmodeller (LLM:er) erbjuder kraftfulla kognitiva möjligheter för att förstå ostrukturerad text och resonera kring komplexa dokument – men de är inte en fristående lösning för dataextraktion i företagsskala. Organisationer bör använda LLM:er selektivt för strategiska, flexibla och kontextkrävande uppgifter, men förlita sig på specialiserade plattformar som Parseur för deterministisk precision, regelefterlevnad, skalbarhet och spårbarhet. Genom att kombinera AI-intelligens med syftesbyggda extraktionsmotorer kan företag uppnå både tillförlitlighet och strategiska insikter, och optimera dokumentautomation för snabbhet, noggrannhet och kontroll.

Senast uppdaterad