Viktigaste punkterna:

- Dokumentparsning-API:er extraherar strukturerad data från filer du äger, som PDF:er, bilder och mejl.

- Webscraping-API:er samlar information från offentliga webbsidor genom att analysera HTML eller renderat innehåll.

- Rätt val beror på din datakälla: filer du mottar kontra webbplatser du vill bevaka.

- Många team använder hybrida arbetsflöden, skrapar för att hämta dokument och parsar för att utvinna tillförlitlig JSON.

API för dokumentparsning vs API för webscraping

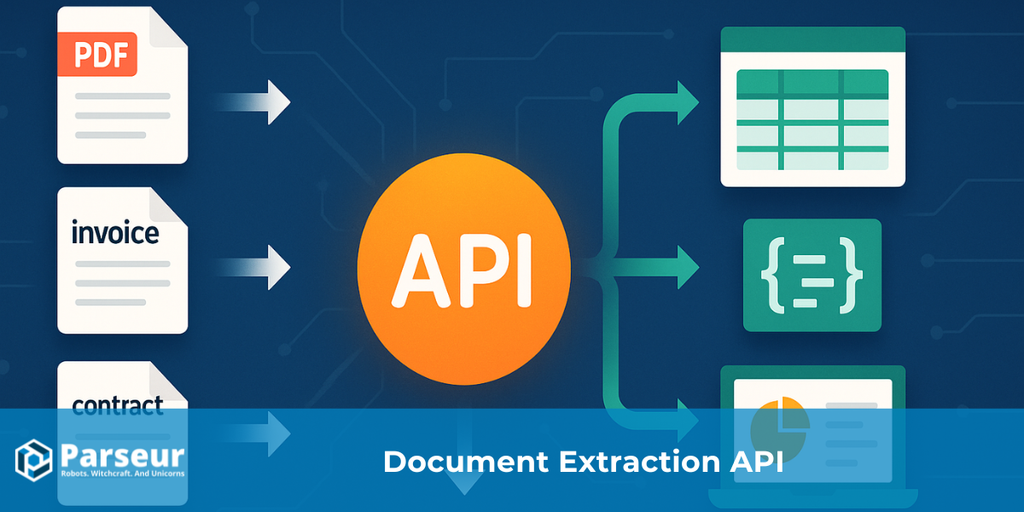

Ett API för dokumentparsning omvandlar filer som PDF:er, skannade bilder och e-post till strukturerad JSON. Den analyserar dokumentets layout och innehåll för att extrahera nyckelvärdespar och tabeller, vilket möjliggör automatisering av processer som fakturahantering, orderbevakning eller mejl-till-databas-flöden.

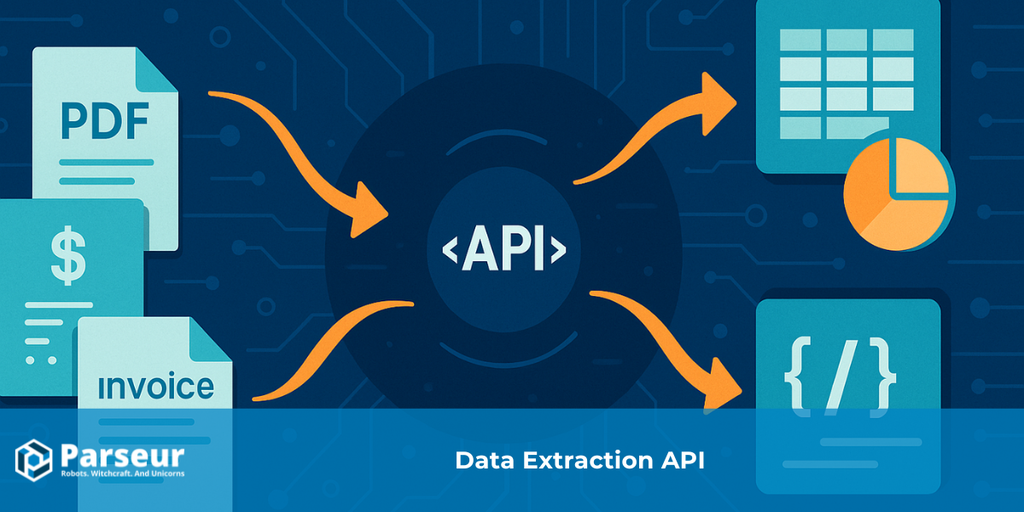

Ett webscraping-API samlar data direkt från webbplatser genom att programmatiskt hämta webbsidor och tolka HTML eller renderat DOM. När ett officiellt API saknas används webscraping ofta för att bevaka produktlistor, följa prisförändringar, samla nyheter eller bygga upp datasätt.

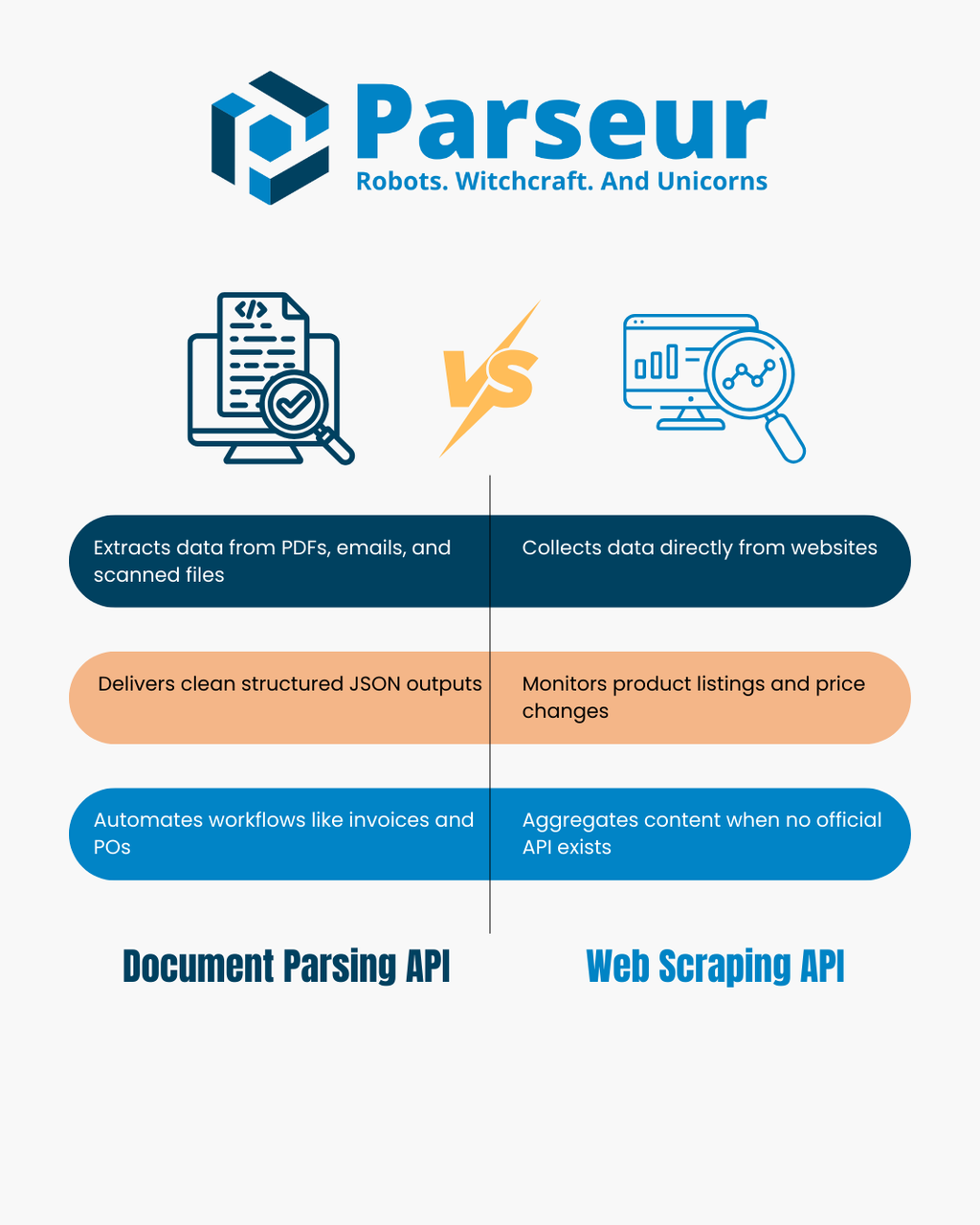

Båda metoderna extraherar data men utgår från olika källor: API:er för dokumentparsning arbetar med de filer du äger, medan webscraping-API:er fokuserar på data från webbsidor du besöker. I denna artikel jämförs styrkor och begränsningar, och du får både ett beslutsträd, en jämförelsetabell och verkliga användningsfall. För mer om automatiserad datautvinning, läs vår guide om API:er för datautvinning.

Hur fungerar dokumentparsning-API:er och webscraping-API:er?

Både dokumentparsning- och webscraping-API ingår i datautvinningskategorin, men de löser olika problem. För att välja rätt för ditt företag är det viktigt att förstå hur de fungerar i praktiken.

En studie från Scrapingdog visar att 34,8 % av utvecklarna nu använder webscraping-API:er – ett tydligt tecken på en trend där färdiga, strukturerade datautvinningsflöden föredras framför underhåll av egna scripts.

Dokumentparsning-API

Ett dokumentparsning-API extraherar strukturerad information från filer som du redan har eller lagligt mottagit. Det kan gälla PDF:er, inskannade bilder, e-post med bilagor eller Office-dokument. Istället för manuell inmatning analyserar API:et dokumentets layout och innehåll för att hitta nyckelfält.

- Input: PDF:er, skannade bilder, e-post och Office-filer.

- Output: Strukturerad JSON med nyckelvärdespar, tabeller och fält som du själv definierar.

- Så fungerar det: Med OCR och tolkningsregler känner API:et igen textblock, siffror och tabeller och mappar dem till ett enhetligt format. Detta gör datan redo för integration i system som CRM, ERP eller databaser.

- Typiska användningsfall: Automatisera faktura- och kvittohantering, extrahera rader från order, parsa finansiella rapporter eller hantera stora mängder kundformulär. Vanligt är också att förvandla mejl till strukturerad data för att trigga arbetsflöden i exempelvis Zapier, Make eller n8n.

Webscraping-API

Ett webscraping-API utvinner information direkt från öppna webben. Istället för att bearbeta filer hämtar det data från webbplatser och konverterar innehållet till ett användbart format. Ofta inbegriper processen inläsning av rå HTML, rendering med "headless browser" och användning av selektorer för att hitta specifika fält.

- Input: Webbplats-URL:er, HTML-innehåll eller JSON-endpoints.

- Output: Parsad och strukturerad data, ofta i JSON- eller CSV-format, redo för analys eller integration.

- Så fungerar det: API:et laddar webbsidan, analyserar DOM-strukturen och använder regler som CSS-selektorer eller XPath för att hämta produktnamn, priser eller rubriker. Vissa tjänster hanterar även proxies och anti-bot-skydd.

- Typiska användningsfall: Följa e-handelspriser hos konkurrenter, samla produktkataloger, aggregera nyhetsartiklar, spåra lediga jobb eller bygga stora datasätt där inget officiellt API finns.

Kort sagt: dokumentparsning-API:er är bäst för filer du äger eller mottar, medan webscraping-API:er briljerar med att samla in information från öppna webbsidor.

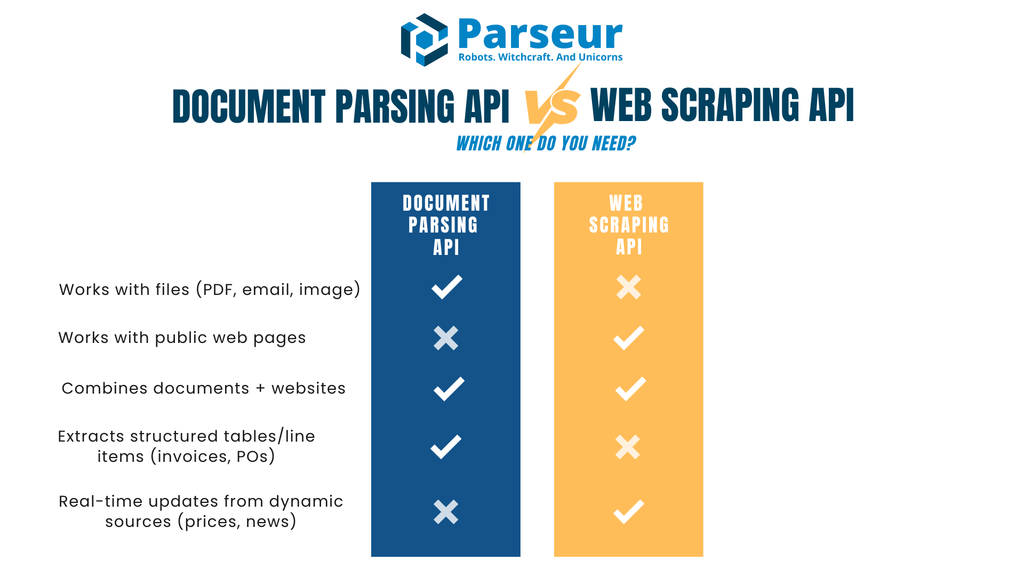

Beslutsträd: Vilken behöver du?

Ditt val mellan dokumentparsning-API och webscraping-API avgörs ofta av datakällan och slutmålet. Här är ett beslutsträd för att snabbt hamna rätt – med exempel per gren.

!

Är din källa en fil (PDF, bild eller e-postbilaga) som du lagligt äger?

→ Använd ett dokumentparsning-API. Det omvandlar filer till ren JSON, extraherar nyckelfält och klarar ofta radtabeller utan manuell inmatning.

Är din källa en offentlig webbsida eller nätbaserat datasett?

→ Använd ett webscraping-API. Det hämtar HTML eller renderade sidor och låter dig hämta ut specifika datafält – t.ex. produktlistor eller nyhetsartiklar.

Kombinerar du dokument med webbkällor?

→ Ofta är ett hybridupplägg bäst. Exempel: Skrapa en leverantörsportal för att ladda ned PDF:er och skicka dem direkt till ett dokumentparsning-API för strukturerad utvinning.

Behöver du extrahera tabeller eller rader (t.ex. fakturor, kvitton eller order)?

→ Då utmärker sig dokumentparsning-API. Det är optimerat för att hantera tabell- och finansiell data, där noggrannhet är avgörande.

Behöver du realtidsuppdateringar från dynamiska källor (prisförändringar, nyheter, lager)?

→ Då passar webscraping-API. De kan kontrollera webbsidor upprepade gånger och samla färskt innehåll när det publiceras.

Använd detta träd som vägledning – ibland är en kombination av båda lösningarna optimalt.

Jämförelsetabell: Dokumentparsning-API vs Webscraping-API

När du jämför dessa API-lösningar är deras styrkor och begränsningar tydliga. Tabellen nedan visar standardkriterier – från input till säkerhet – för att du enkelt ska hitta rätt för dina arbetsflöden.

| Kriterium | Dokumentparsning-API | Webscraping-API |

|---|---|---|

| Primär input | Filer såsom PDF:er, inskannade bilder och mejl med bilagor | Webbsidor (HTML/JSON) eller renderat DOM-innehåll |

| Typisk output | JSON med nyckelvärdespar, radtabeller och strukturerade fält | Tolkat HTML konverterat till JSON eller CSV via selektorer |

| Känslighet för ändringar | Stabil när dokumenttyper är satta – konstant parsing | Känslig: små ändringar i layout/DOM bryter ofta din scraping |

| Användningsfall | Fakturor, inköpsorder, avtal, formulär, finansiella rapporter, operationella mejl | Produktkataloger, prisuppdateringar, jobbportaler och nyhetsaggregation |

| Förvärv | Du eller dina användare tillhandahåller dokument | Data hämtas direkt från tredjeparts-webbplatser |

| Juridiskt fokus | Integritet och efterlevnad (roller, lagring, gallringsregler) | Webbplatsvillkor, robots.txt, anti-bot-skydd |

| Latens och skalbarhet | Effektivt för batchjobb och webhook-leverans | Begränsat av crawl-hastighet och anti-bot-regler |

| Underhåll | Regelbundet mall- eller schemaunderhåll | Ofta ändringar av selektorer och hantering av skydd |

| Datakvalitet | Strukturerad output, validering och normalisering | Beror på webbplats och HTML-kvalitet |

| Säkerhet | Kryptering under överföring och vila, signerade webhooks, rollstyrning | Kräver IP-rotation, säkra proxyer och nätverkshygien |

| LLM-användning | Perfekt för strukturerad JSON-insamling till AI/ML-system | Perfekt för ostrukturerad text, sammanfattningar eller klassificering |

| När välja | När du mottar dokument (t.ex. fakturor, kvitton, avtal) | När du behöver aktuellt webbinnehåll (t.ex. priser, lager, nyheter) |

När är webscraping-API rätt verktyg (och hur gör du det ansvarsfullt)?

Webscraping-API:er är det bästa valet när informationen enbart finns på webbplatser – inte skickas som filer. De möjliggör datainsamling i stor skala utan behov av manuella dokument eller väntan på partners. Skrapning är ovärderligt för marknadsanalys, prisbevakning och kunskapssamling när uppdateringar sker ofta.

Branschdata från Browsercat visar att den globala marknaden för webscraping värderades till cirka 1,01 miljarder USD 2024 och tros nå 2,49 miljarder USD 2032, med en årlig tillväxttakt (CAGR) på 11,9 %.

Exempel där webscraping lämpar sig:

- Följa pris och lagersaldo hos flera e-handelsplatser

- Samla nyhetsrubriker eller pressmeddelanden från olika källor

- Skapa datasätt över lediga jobb, katalogposter eller evenemang där inget API finns

Eftersom webscraping hämtar data från tredjepartswebbplatser, ska man alltid följa god praxis:

- Kontrollera robots.txt och användarvillkor före scraping

- Begränsa anropstakten för att inte belasta webbservrar

- Använd cache för att minimera upprepade förfrågningar

- Identifiera scrapers tydligt, maskera dem ej som legitima användare

- Om officiellt API finns – använd det istället

Webscraping kräver också vaksamhet då webbplatser ofta ändrar struktur. En mindre HTML-ändring kan sabotera datainsamlingen. Därför behövs kontinuerlig övervakning och snabba insatser vid problem.

Ofta kombineras scraping och dokumentparsning: t.ex. för att hitta och ladda ned PDF:er från leverantörsportal, därefter extrahera strukturerad data ur filerna. Denna hybridmetod ger både omfattning och precision.

Utmaningar med webscraping-API:er

Webscraping-API:er erbjuder effektiv realtidsinsamling från webben, men för också med sig tydliga utmaningar. Det är viktigt att förstå dessa – och när scraping lämpar sig, respektive inte.

En färsk analys från Octoparse visar att bara runt 50 % av webbplatser är lätta att skrapa, 30 % är måttligt svåra och 20 % mycket utmanande på grund av komplex struktur eller anti-scraping-skydd.

Frekventa ändringar av webbplatser

Webbplatser byggs för människor, inte maskiner. Även små HTML-ändringar – namnbyte på CSS-klass eller layoutjustering – kan stoppa scrapingen och kräver ständigt underhåll och övervakning.

Anti-bot-skydd

Många webbplatser använder CAPTCHA, IP-blockering, sessionsvalidering eller annan botdetektering. För att lyckas krävs ofta proxy-lösningar, anpassade user-agenter och tillfällig crawl-hastighet – detta komplicerar lösningen.

Juridiska och etiska frågor

Webscraping lever i en juridisk gråzon. Att hämta öppen data är ibland ok, men att gå emot användarvillkor, robots.txt eller ta sig förbi betalväggar skapar risker för lagbrott. Organisationer måste ha tydliga etiska riktlinjer och rådgöra juridiskt före storskalig scraping.

Datakvalitet och konsistens

Webbplatser är varierade och sällan konsekventa. Skrapad data kräver därför mycket städning och validering. Dynamiska layouter, JavaScript-baserat innehåll eller duplicerade poster kan göra datasätten röriga.

Skalbarhetsutmaningar

En större datainsamling kräver robust infrastruktur med stöd för samtidighet, felhantering och återförsök. Kostnader för proxyer, servrar och övervakningsverktyg ökar snabbt med volym.

Långsiktig hållbarhet

Webscraping är sällan stabilt för affärskritiska processer. Till skillnad från officiella API:er eller dokument måste data-pipelines kontinuerligt anpassas. Löpande underhåll krävs för att kvaliteten ska bli långsiktigt hög.

När är dokumentparsning-API ett bättre val?

När den information du behöver redan finns som dokument – PDF, bild, e-postbilaga – är dokumentparsning-API optimalt. API:et automatiserar omvandlingen av ostrukturerade filer till strukturerad JSON, redo för sömlös integration och analys.

Enligt Sphereco utgör 80 % av företagsdata ostrukturerad information i exempelvis e-post, PDF:er och skannade dokument – vilket gör dokumentparsning avgörande för informationshantering.

Typiska användningsfall:

- Faktura- och kvittohantering: extrahera leverantörsnamn, datum, totalsummor och tabeller för smidigare betalningar

- Order och kontoutdrag: hämta ordernummer, belopp och betalningsvillkor för snabb avstämning

- Formulär och avtal: samla standardfält såsom kunduppgifter eller signaturdatum

- Operationella mejl: omvandla orderbekräftelser och leveransaviseringar till strukturerad JSON för vidare integration

Ett dokumentparsning-API ger hög noggrannhet, normaliserar format, validerar fält och sänder resultat via webhooks direkt in i ert system. Strukturen är stabilare än HTML, regler återanvänds på tusentals dokument utan behov av förändringar.

Om ni främst arbetar med leverantördokument, kundutdrag eller affärsmejl är dokumentparsning-API nästan alltid både den snabbaste och mest skalbara lösningen.

Hybrida mönster: Verkliga överlappningar

I moderna arbetsflöden kompletterar dokumentparsning och webscraping ofta varandra snarare än konkurrerar. Datakällor varierar och ett upplägg som använder båda metoderna kan ge maximal effekt.

Exempel på hybridmönster:

- Skrapa för att ladda ned PDF:er – sedan parsa dem: En leverantörsportal innehåller pdf-fakturor. Scraping-API loggar in, laddar ned, och därefter parsas filerna för rader och totaler.

- Parsa dokument och berika från webben: Efter parsning av fakturor hämtar du kompletterande metadata, t.ex. branschinfo, från öppna webbplatser med scraping-API.

- E-postparsning och webbverifiering: Orderbekräftelser och leveransinfo kommer ofta via e-post. Parsa dessa, verifiera lager eller pris på leverantörens webbsida med scraping.

- Kombinera med analys eller produktmappning: Efter parsning av dokument lägger du till webskrapad information, t.ex. kategorisering eller avvikelsedetektering, och får ett komplett dataset.

Kombinerade arbetssätt utnyttjar styrkorna hos båda teknikerna för maximal automatisering med minimal manuell hantering.

Är Parseur ett dokumentparsning-API eller webscraping-API?

Parseur är ett robust dokument- och e-postparsning-API som gör om ostrukturerad information till strukturerad JSON. Till skillnad från ett webscraping-API, som hämtar data från webbsidor, fokuserar Parseur på att omvandla dokument och mejl du eller ditt företag redan äger. På så sätt kan du automatisera affärskritiska processer stabilt, snabbt och utan beroende av osäkra webbkällor.

Vad detta betyder i praktiken

- Vad Parseur gör: Tar emot mejl, PDF:er, bilder och office-filer och returnerar strukturerad JSON med nyckelvärden och radtabeller. Data levereras via webhooks eller kan hämtas direkt via API.

- Databehandlingssätt: Parseur behandlar data endast på dina instruktioner. Funktionen stödjer personuppgiftsbiträdesavtal (DPA), transparens kring underleverantörer, flexibel lagringsinställning och snabb radering. All data är krypterad under överföring och vila, och levereras med signerade webhooks.

- Bästa användning: Parseur är idealiskt för team vars dokument och affärsdata huvudsakligen kommer in via mejl – som fakturor, kvitton, inköpsorder eller finansrapporter – och som behöver enkel, pålitlig och snabb strukturering.

Varför Parseur API sticker ut

Styrkan med Parseur API är kombinationen av API och webbapplikation. Utvecklare kan integrera Parseur direkt, medan icke-tekniska användare enkelt hanterar och granskar dataflöden via webben. Där kan man bygga JSON-schema, definiera datafält, justera regler och validera utdata – ett smidigt samarbete som sparar utvecklingstid.

I motsats till sköra webscraping-flöden, arbetar Parseur med stabila dokumentformat du själv kontrollerar. Det gör det pålitligt för kritiska arbetsflöden och innebär mindre underhåll över tid.

Så hanterar Parseur data

Parseur är byggt för att behandla dokument och mejl snabbt, säkert och med högsta möjliga integritetsnivå. För team som jobbar med PDF:er, bilder eller e-post ger Parseur möjlighet att omvandla ostrukturerat till strukturerad JSON för automatiserad hantering.

Parseur har ett tydligt fokus på datasäkerhet, dataskydd och regeluppfyllelse, vilket gör det unikt. Kunder kan tryggt automatisera med Parseur, med stöd av strikta policyer och branschledande standarder.

Viktiga delar av Parseurs datahantering

Byggt för dokument och e-post

Parseur tar emot PDF:er, bilder och mejl. Den ger tillbaka strukturerad JSON via webhook eller API – en perfekt grund för automatiserad fakturahantering, inköpsorder, mejl-till-databas och mycket mer.

Du äger alltid din data

All data du skickar till Parseur tillhör dig, och du styr också lagringstiden – från omedelbar radering till längre retention. Process then Delete gör det möjligt att radera dokument direkt efter behandling.

Var data lagras

Data lagras säkert inom EU (Nederländerna) hos Google Cloud Platform (GCP), certifierat enligt ISO 27001. Se mer här.

Säkerhets- och krypteringsrutiner

All data lagras krypterad (AES-256) och överförs med TLS 1.2 eller högre – äldre, osäkra protokoll är helt blockerade. SSL-certifikat tillhandahålls av Let’s Encrypt för att säkra server, appar och webbläsare.

Infrastrukturövervakning och penetrationstester

Parseur övervakar infrastrukturen i realtid och åtgärdar snabbt potentiella sårbarheter. Oberoende företag genomför regelbundet penetrationstester och utvärderar enligt OWASP Top 10 och SANS 25. Enterprise-kunder kan få fullständiga rapporter. År 2025 erhöll Parseur även ett Astra Pentest-certifikat.

Lösenordssäkerhet och kontoskydd

Parseur lagrar aldrig lösenord i klartext. Istället används PBKDF2 med SHA-256, 512-bitars salt och 600 000 hashcykler, vilket överträffar NIST:s rekommendationer.

Drifttillgänglighet och SLA

Parseur eftersträvar 99,9 % upptid eller mer, med avancerad felhantering för att förhindra dataförlust. E-postinsamling försöker automatiskt i 24 timmar och redundanta flöden säkrar leverans. Företagskunder kan nå 99,99 % upptid. Se historiska siffror här.

GDPR och integritetsfokus

Parseur är byggt för GDPR och fungerar alltid som biträde. Du förblir ägare till din data; Parseur säljer eller delar aldrig information. Endast vid explicit support är åtkomst tillåten och all personal får löpande träningsinsatser. Läs mer om Parseur och GDPR.

Incidenthantering och säkerhetsincidenter

Vid eventuell säkerhetsincident informeras alla kunder inom 48 timmar enligt lag. Parseur har en detaljerad Säkerhets- och Integritetsöversikt.

Juridik och efterlevnad i korthet

Juridik och efterlevnad är centralt när du väljer mellan dokumentparsning och webscraping. Båda hanterar data, men ansvar och skyldigheter skiljer sig åt.

För dokumentparsning krävs oftast samtycke eller avtal med dokumentets ägare. Dessutom måste företag klargöra rollfördelning (personuppgiftsansvarig/biträde), ha biträdesavtal (DPA) och gallringsrutiner. Incidentrapportering och dataminimering är viktiga delar av rutinerna.

Webscraping innebär juridiska och etiska utmaningar. Skrapning av öppna data kan vara tillåten, men ofta förbjuds det i användarvillkor eller robots.txt. Att försöka kringgå skydd kan innebära risk för lagbrott; rådgör alltid med jurist innan scraping påbörjas i skala.

Vid hantering av personuppgifter inom eller utanför EU gäller särskilda regler om överföring och lagring – så säkra alltid att arbetsflöden följer aktuella krav inom och utanför regionen.

Avslutande tankar: Välj rätt API för din data

Både dokumentparsning-API:er och webscraping-API:er är ovärderliga verktyg för att automatisera insamling och strukturering av data. De passar dock olika sammanhang. Dokumentparsning är bäst när utgångspunkten är filer du äger – till exempel fakturor, utdrag eller mejl.

Enligt Experlogix kan dokumentautomation minska dokumenthanteringstiden med upp till 80 %, vilket visar på effektivitetsvinster med ett dokumentparsning-API.

Webscraping är rätt när viktig data endast finns på publika webbsidor – såsom produktkataloger och prislistor. I många arbetsflöden används scraping för att samla filer och parsning för att konvertera dem till strukturerat data.

Välj ditt API efter källan. Levereras din data som PDF, bild eller e-postbilaga är dokumentparsning-API oftast snabbast och säkrast. Finns informationen bara på webbsidor, välj ett webscraping-API. Med flera källor ger en kombinerad strategi störst affärsvärde.

Senast uppdaterad