Vad betyder “ingen träning på dina data”?

I grunden innebär uttrycket “ingen träning på dina data” ett åtagande från AI-leverantörer att den information du delar med deras system inte återanvänds för att förbättra eller träna deras maskininlärningsmodeller.

Viktiga slutsatser

- “Ingen träning på dina data” säkerställer att informationen behandlas, men inte återanvänds för AI-träning.

- Företag behöver denna policy för att skydda förtroende, regelefterlevnad och immateriella rättigheter.

- Parseur erbjuder kryptering, kontroll över lagring, regelefterlevnad och strikt policy om ingen träning som standard.

När företag inför AI-verktyg vill de vara säkra på att deras känsliga affärsinformation inte missbrukas, exponeras eller används på sätt de inte har godkänt.

Detta är också ett stort orosmoment för konsumenter: cirka 70 % av vuxna litar inte på att företag använder AI ansvarsfullt, och över 80 % tror att deras data kan missbrukas, enligt Protecto. Därför kan förlust av förtroende på grund av dålig datahantering bli ännu mer allvarligt än juridiska påföljder.

De senaste åren har stora AI-leverantörer som OpenAI, Anthropic och Microsoft granskats allt mer kring sin hantering av kunddata. Den centrala frågan är om data som skickas vägs in i deras modeller och används för förbättring, eller strikt endast för att leverera tjänsten.

Just därför har “AI – ingen träning på dina data” snabbt blivit ett krav för att bygga AI-förtroende. Det är en garanti att kunddata bara används till önskad bearbetning och aldrig för att träna allmänna modeller. För företag blir detta ett fundament för både förtroende, regelefterlevnad och långsiktig användning av AI-lösningar.

I den här artikeln får du en tydlig bild av vad “ingen träning på dina data” innebär i praktiken, varför det är avgörande för företags regelefterlevnad och styrning, hur ledande leverantörer hanterar detta och hur Parseur implementerar denna policy för att ge både AI-förtroende och datasäkerhet.

Vad betyder “ingen träning på dina data”?

Dina data används endast för att uppfylla det arbete du begärt – oavsett om det handlar om sammanställning av ett dokument, extrahering av fält, skapande av text eller identifiering av mönster. Därefter raderas eller lagras datan säkert enligt tydligt definierade villkor.

Här är den viktiga skillnaden:

- Bearbetning: Ditt data används enbart i realtid för att slutföra din aktuella uppgift, exempelvis generera en rapport eller extrahera fakturauppgifter. När uppgiften är klar används inte datan mer och återförs inte till systemet för framtida inlärning.

- Träning: Ditt data matas in i AI-modellen för att förbättra dess prestanda. Med tiden kan information som du lämnar bli en del av modellens kunskapsbas, vilket ökar risken att känsliga fragment återanvänds eller exponeras.

Tidigare suddades gränsen ofta ut i stora AI-system där kunddata användes för både bearbetning och träning. Det gynnade teknikutvecklingen, men skapade allvarliga risker:

- Konfidentialitetsproblem: Känsliga affärsdokument, finansiell information eller kunduppgifter kunde exponeras eller återskapas.

- Ägarskapsproblem: Om inskickad data bidrar till modellträning, vems är då informationen ur ett immaterialrättsligt perspektiv?

- Efterlevnadsrisk: Branscher med höga krav som sjukvård, finans och juridik kan inte riskera att klientdata används till något annat utan samtycke.

En policy utan dataträning eliminerar denna osäkerhet. Datan används bara till det den var ämnad för, återanvänds inte för modellträning och skickas inte vidare eller används dolt. Det stärker datasäkerhet, underlättar regelefterlevnad och bygger bättre relation mellan företag och AI-leverantörer.

Sammanfattningsvis innebär “ingen träning på dina data” att du behåller kontrollen: informationen är privat, skyddad och hålls inom dina villkor.

Varför dataträningspolicy spelar roll för företag

En AI-datasekretesspolicy är inte bara en trevlig extraförmån. För företag blir det en avgörande trygghet som avgör om känslig information förblir säker eller om den utgör dold risk. Utan tydliga policies riskerar organisationer att tappa kontrollen över sina data, drabbas av regulatoriska påföljder, förlorat förtroende och sämre konkurrenskraft.

Risker med att data används för träning

- Förlust av immateriella rättigheter: Särskilda affärsprocesser, avtal eller forskning kan av misstag bli en del av modellens träningsdata och därmed förlora sin unika fördel.

- Brist på regelefterlevnad: Regelverk som GDPR och CCPA anger tydliga gränser för hur personuppgifter och känslig data får hanteras. Om en leverantör återanvänder denna data för träning utan samtycke kan det leda till omfattande överträdelser.

- Försämrad konkurrenskraft: Om din unika data används för att förbättra en AI-modell, kan konkurrenter indirekt dra nytta av det och din fördel försvinner.

Varför företag verkligen bryr sig

Företagskunder jämför idag inte bara AI-verktygens kapacitet, utan granskar i detalj deras AI-datasekretesspolicy. En studie av The Futurum Group 2025 visar att 52 % av organisationerna sätter AI-leverantörens tekniska expertis i första rummet, där datahantering och integritet hamnar omedelbart efter på 51 %. Det visar tydligt hur integritetspolicy är avgörande vid leverantörsval. En leverantör med policy om ingen träning sänder signalen:

- Skydd av dataägande: Trygghet om att de egna tillgångarna och innovationerna inte smälts in i breda modeller.

- Stark regelefterlevnad: Minskar risk för juridiska påföljder och förenklar revisioner – särskilt i reglerade sektorer.

- Transparens och förtroende: Skapar långvariga relationer genom att undvika överraskningar i datapraxis.

Dataträningspolicy är därför inte bara viktigt för IT – de är avgörande vid AI-satsningar. Att välja en leverantör med strikt policy kring ingen träning ger företag innovation med bibehållen äganderätt och trygghet.

Regelefterlevnad och styrning: Ett företagskrav

För många organisationer är AI inte bara en fråga om effektivitet, utan också att leva upp till hårda krav för regelefterlevnad och styrning. Regulatoriska ramverk som ISO 27001, GDPR, samt branschspecifika regler inom till exempel sjukvård och finans kräver att data hanteras med största möjliga säkerhet och ansvar. Enligt 2025 Investment Management Compliance Testing Survey anger 57 % av compliance-ansvariga att AI-användning är deras största regulatoriska oro, vilket understryker behovet av att AI måste möta krav från ISO 27001, GDPR och andra standarder.

En policy om ingen träning hjälper företag att möta dessa krav genom att garantera att data endast används för sitt avsedda ändamål. Detta ligger i linje med viktiga principer för regelefterlevnad som:

- Dataminimering: Endast nödvändiga data behandlas och risken minimeras.

- Samtycke och kontroll: Återanvändning för andra syften kräver tydligt och aktivt godkännande.

- Syftesbegränsning: Data används bara för aktuell begärd uppgift och absolut inte för framtida träning.

Att följa dessa principer hjälper företag att klara revisioner och slippa böter för bristande regelefterlevnad.

Bra styrning är också att bygga förtroende genom beprövade rutiner. Organisationer som Electronic Commerce Code Management Association (ECCMA) verkar för hög datakvalitet och starkt förtroende. Policies utan dataträning speglar dessa mål om transparens och pålitlighet.

Genom att välja leverantörer som följer dessa principer säkrar företag såväl regelefterlevnad som basen för etisk och tillitsskapande AI.

Branschens exempel: Så hanterar Big Tech dataträning

Att branschjättarna ändrar sina riktlinjer för dataträning är ett tydligt tecken på att datasekretess är en topprioritet. De största AI-leverantörerna har moderniserat sina policies för att möta företagskunders tydliga krav på transparens och datakontroll.

- OpenAI: Med ChatGPT får data från gratis- och konsumenttjänster användas för att förbättra modeller, men företagskunder erbjuds opt-out-lösningar och specifika garantier om att deras prompts och resultat inte används för träning. Detta visar tydligt skillnaden på AI för konsumenter och för företag.

- Microsoft: I Copilot för Microsoft 365 och Azure OpenAI Service gäller isolerade dataflöden. Företagsdata används aldrig för träning av grundmodeller, vilket ger trygghet kring känsliga dokument och kommunikation.

- Anthropic: Claudes AI från Anthropic bygger på ett dokumenterat åtagande om ingen träning på företagsdata, vilket gör dem till en trovärdig AI-partner med fokus på säkerhet och kundägarskap.

Samtliga exempel pekar på samma trend: företag ställer högre krav på AI-datasekretesspolicy. Leverantörer som inte lever upp till detta riskerar att förlora mot konkurrenter där transparens och kundförtroende är kärnvärden.

Varför “ingen träning på dina data” bygger AI-förtroende

Hjärtat i framgångsrik AI-användning är förtroende. Företag tar i bruk AI och automation fullt ut bara om de kan känna sig trygga med att deras data skyddas och hanteras ansvarsfullt. PwC:s AI-agentundersökning 2025 visar att 28 % av affärsledarna nämner brist på AI-förtroende som ett av de största hindren för bred AI-användning. Utan tydliga ramar, som en policy om ingen träning, känner sig företag utsatta och håller tillbaka implementation. En strikt policy om ingen träning är därför ett av de säkraste sätten att bygga förtroende – den tydliggör gränsen mellan kunddata och modellutveckling.

- Sinnesro för kunder: Företag måste veta att deras värdefulla data aldrig används för modellträning som även konkurrenter kan dra nytta av. En tydlig policy är en garant för att kundlistor, strategier och känslig data förblir konfidentiella.

- Underlättar transparens: Transparens är grundläggande för AI-förtroende. När policy klart särskiljer kunddata från träning slipper man osäkerhet och företaget får kontroll – något som även förenklar interna revisioner.

- Drivkraft för adoption: Med uttalat förtroende vågar företag använda AI även i känsliga, reglerade sektorer. Säkerheten i att data aldrig återanvänds för träning ökar benägenheten att automatisera brett på lång sikt.

Ingen träning på dina data är alltså mer än en policy – det är en konkurrensfördel. Det signalerar att man tar kundens förtroende på allvar och gör det lättare att ta nästa steg mot AI-driven verksamhet.

Hur Parseur implementerar denna policy

På Parseur är datasekretess och regelefterlevnad kärnan i vår plattform. Många företag är skeptiska till AI-verktyg just för att de inte vet hur data hanteras. Parseurs policy är tydlig: din data är din och används aldrig för att träna några AI-modeller.

I praktiken innebär det:

- Ingen träning på dina data: Parseur återanvänder under inga omständigheter kundmaterial (dokument, mail, fakturor eller räkningar) för AI-träning. All dataextraktion sker i isolerade miljöer för maximal sekretess.

- Syftesbegränsad bearbetning: Datan hanteras enbart för att extrahera uppgifter och automatisera arbetsflöden – inget mer. Den lagras endast vid specifika behov och återanvänds aldrig för modellförbättring.

- Säkerhet på företagsnivå: Vi tillämpar full kryptering, har tydliga regler för datalagring och respekterar alltid din rätt att radera all data – i linje med branschens tuffaste krav på regelefterlevnad.

Med denna policy skyddas kundinformation långsiktigt vilket bygger varaktigt AI-förtroende. Företag kan tryggt skala sin automation utan att oroa sig för läckage, förlust av rättigheter eller regelefterlevnadsproblem.

Parseur kombinerar transparens, styrning och robust säkerhet – och ger organisationer möjligheten att automatisera utan kompromiss med integritet.

Bästa praxis vid utvärdering av leverantörer

Att välja AI- och automationsleverantör handlar om mer än funktioner. För företag står säkerhet, efterlevnad och styrning i centrum. Saknas tydliga rutiner riskerar organisationen att exponera känslig data eller missa regulatoriska krav.

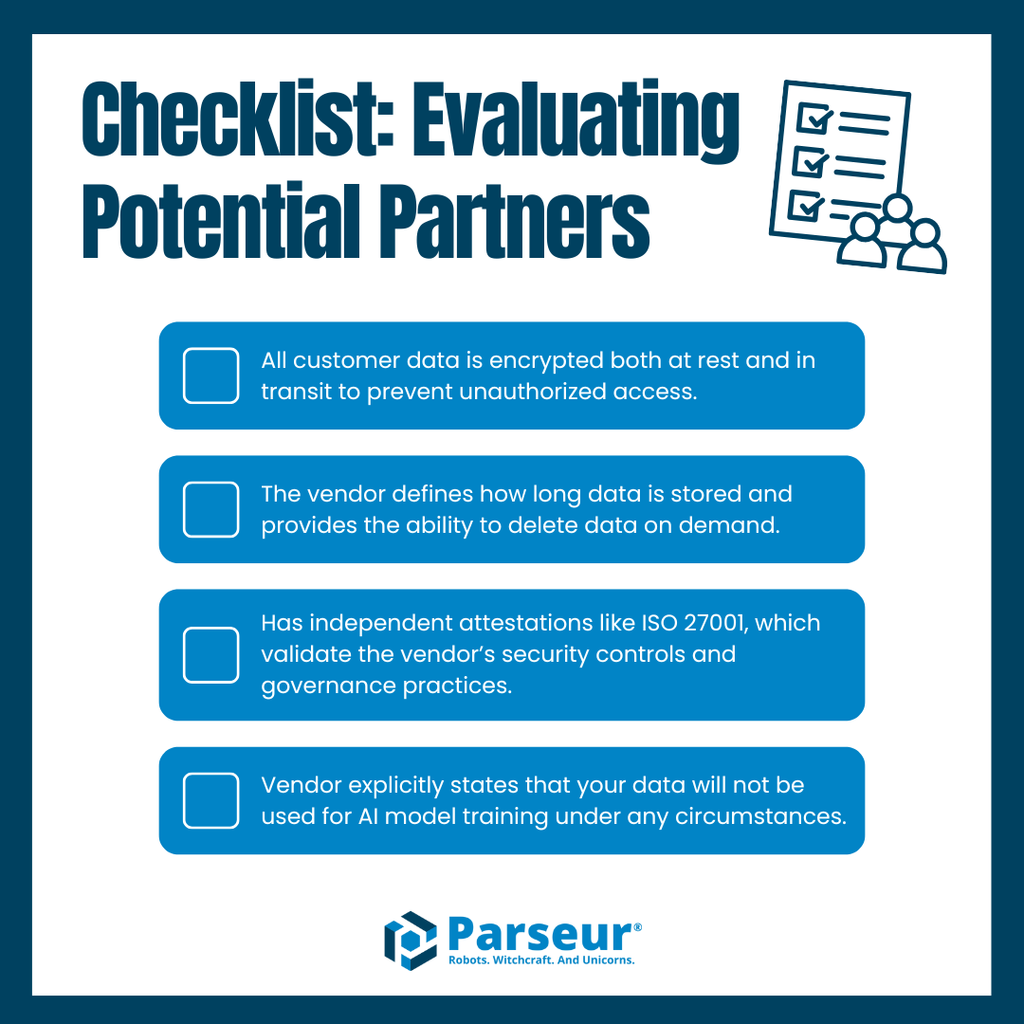

Vid utvärdering, använd denna checklista:

- Data krypteras: All kunddata ska vara krypterad vid både lagring och överföring för att skydda mot obehörig åtkomst.

- Tydliga principer för datalagring: Leverantören ska klart specificera hur länge data sparas och tillhandahålla möjlighet till radering på begäran.

- Intyg om regelefterlevnad: Sök efter certifikat som ISO 27001 som visar på god säkerhet och styrning.

- Åtagande om ingen träning: Leverantören måste skriftligen garantera att ingen kunddata används för modellträning i någon form.

Om inte dessa krav är uppfyllda kan leverantören lämna luckor i efterlevnad eller skapa onödiga risker. Men de leverantörer som möter dessa krav, skapar ett starkt fundament för tillit och långsiktig relation.

Parseur utmärker sig här. Med standardkryptering, transparent lagring, certifieringar och strikt policy om ingen träning ger Parseur företag möjlighet att växa automatiseringen tryggt. Kunderna vet exakt hur deras data hanteras – och det gör Parseur till ett självklart val.

Varför förtroende formar framtiden för automation

Förtroende avgör framtiden för data- och automationslösningar. Allt eftersom företag hanterar allt mer känslig information blir tilliten till leverantörernas dataskydd och behandling helt central. Grunden är principen om “ingen träning på dina data.”

I framtiden kommer företag att kräva ännu större öppenhet och ansvar. Experter menar att tydliga riktlinjer för lagring, standardiserad kryptering, certifieringar och uttryckliga garantier om att kunddata aldrig används i AI-utveckling blir branschkrav. De som inte möter dessa kommer tappa förtroende – och kunder.

Parseur är förberett för framtiden. Med företagsklassad kryptering, rigorösa rutiner för lagring, genomarbetad efterlevnad och strikt policy om ingen träning kan företag automatisera på bred front utan att kompromissa kring integritet och säkerhet.

Upptäck hur Parseur skyddar dina data med branschledande säkerhet och tydlig policy om ingen träning – och ger din verksamhet den tillit ni behöver för att automatisera säkert, transparent och i stor skala.

Senast uppdaterad