Viktiga insikter

- Fram till 2030 kommer HITL vara avgörande för att bygga tillförlitlig och förklarbar AI.

- Regleringar kommer kräva mänsklig översyn för AI-beslut med hög påverkan.

- Samverkan mellan människa och AI blir motorn för etisk och hållbar automation.

En hybrid framtid för AI och människor

När vi närmar oss 2030 framträder en ny sanning: de mest framgångsrika AI-systemen är inte de som är snabbast eller mest autonoma, utan de mest pålitliga. Denna pålitlighet skapas genom balans – att förena automatiseringens effektivitet med mänsklig expertis.

Erfarenheterna från tidiga AI-vågor visar att även robusta autonoma system kan leda till problem som partiskhet, bristande transparens och oväntade utfall. Detta har ökat intresset för HITL-system och människocentrerad AI, inte som nödlösning utan som en långsiktig strategi.

Det förutspås att över 90 % av allt onlineinnehåll kommer att vara AI-genererat år 2026 istället för människoskapad, enligt Oodaloop. Detta lyfter vikten av att säkerställa tillit och mänsklig översyn i automatiseringssystem.

Vill du förstå grunderna? Läs vår guide om Human-in-the-Loop AI: definition och fördelar för en introduktion till HITL:s nutida användning och affärsnytta.

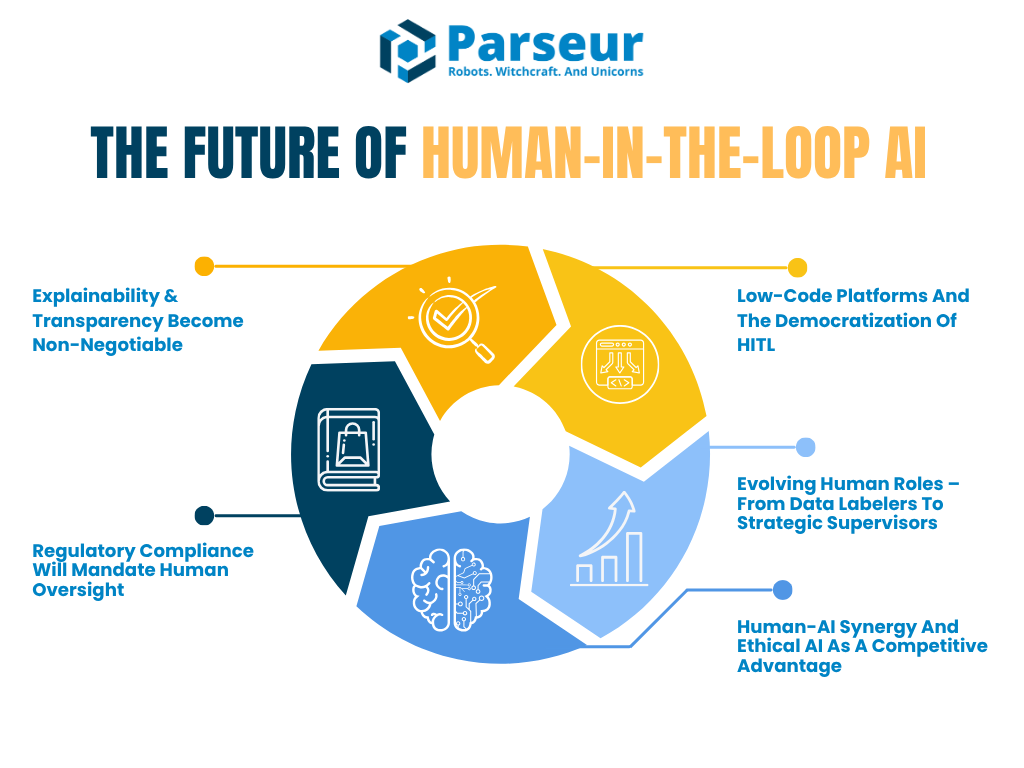

Denna artikel analyserar hur HITL utvecklas fram till 2030, med fokus på fem trender som formar framtiden för samarbete mellan människa och AI:

- Ökad efterfrågan på förklarbar och spårbar AI

- Skärpta krav på regulatorisk regelefterlevnad och mänsklig översyn

- Utvecklingen av lågtkodplattformar som gör HITL tillgängligt

- Mänsklig rollutveckling från datamärkare till övervakare och strateger

- Hur människa-AI-synergi blir en strategisk konkurrensfördel

Enligt Venture Beat förutspår teknikprofiler som Reid Hoffman en framtid där AI-superagency dominerar, med uttalandet: ”Human not using AI will be replaced by humans using AI”, och ser AI som en produktivitetsförstärkare, inte ett hot.

PwC:s AI Jobs Barometer 2026 visar att produktivitetstillväxten i AI-exponerade branscher ökat från 7 % (2018–2022) till 27 % (2018–2024), vilket visar på AI:s förstärkande roll för mänsklig produktivitet inom bland annat finans och mjukvara.

Idag behöver organisationer inte välja mellan automation och kvalitetskontroll. Framtidssäkrad AI bygger på hybrida arkitekturer med mänskliga inslag i avgörande moment – via såväl in-the-loop- som on-the-loop-modeller.

Trend 1: Förklarbarhet & transparens blir icke förhandlingsbart

När AI alltmer driver beslut i verkliga situationer är inte frågan bara om systemen fungerar – utan om människor faktiskt kan förstå och förklara AI:ns beslut. Här blir förklarbar AI (XAI) och transparens centralt.

Förklarbarhet blir inom kort inte enbart en bästa praxis utan ett krav, särskilt i sektorer som finans, vård, försäkring och juridik. Human-in-the-loop kommer möjliggöra regelefterlevnad och etik, där människor tolkar, validerar och förklarar AI-resultat.

Gartner räknar med att över 80 % av företag vid 2026 använt generativa AI-API:er eller implementerat AI-stödda applikationer, vilket ökar behovet av förklarbarhet och översyn inom kritiska sektorer.

Exempelvis kräver EU:s AI-förordning redan att högriska AI-applikationer har mänsklig översyn och förklaring av utfall. Samtidigt påpekar NIST AI Risk Management Framework att tydliga HITL-roller och transparent beslutsfattande fortfarande är utmaningar. Nya standarder kommer formaliserar hur mänsklig intervenering dokumenteras.

Framtidsspaning: HITL med förklarande gränssnitt

Till 2030 har AI-verktyg troligen inbyggda förklarande gränssnitt. Exempelvis kan kreditsystem inte bara ange en poäng, utan också förklara de viktigaste orsakerna till beslutet – så att granskare säkerställer rättvisa och noggrannhet.

HITL går från manuell kontroll i varje steg till strategisk validering vid viktiga punkter. Poängen är att kvalitetssäkra att logiken bakom AI:ns beslut är förankrad i företagets värderingar, lagar och rättvisa.

Branscher där detta redan sker

Vård och finans är först ut – och här är förklarbarhet inte bara önskvärd, utan lag. Deloittes Tech Trends 2026 konstaterar: ”Ju mer komplex automationen blir, desto viktigare är mänskliga insatser.” Det visar att mänsklig övervakning bli mer kritisk ju kraftfullare AI-systemen blir.

Vi ser ett uppsving av “human-on-the-loop”-modeller – system där människor kontinuerligt övervakar och kan styra/återta kontroll vid behov, likt piloter och autopilotsystem.

Varför det är viktigt

Transparens är en förutsättning för att skala AI, eftersom förtroende bygger på just tydlighet. Framtiden kan kräva ”förklaringsloggar” där människor ansvarar för granskning och beslut.

Dessa roller blir proaktiva och formar AI-systemen genom att identifiera problem, skapa kontext och tillföra etisk styrning.

Trend 2: Regelefterlevnad kräver mänsklig översyn

När AI-system blir kraftfullare ökar också de rättsliga och etiska kraven. Lagstiftare världen över betonar ansvar och mänsklig granskning i automatiserade system. Fram till 2030 lär många AI-användningar lagstadgat behöva Human-in-the-Loop-processer.

Reglerande organ som EU, USA och NIST är eniga: AI får inte vara en svart låda. Personer som påverkas av algoritmiska beslut måste förstå samt kunna utmana och be om manuell översyn.

Exempel: Över 700 AI-lagförslag har introducerats i USA 2024, och över 40 tillkommit i början av 2026, enligt Naaia, vilket visar hur fort regelverken utvecklas kring transparens och manuell kontroll.

GDPR Artikel 22 ger individer rätt till mänsklig inblandning vid automatiserat beslutsfattande. EU AI Act bygger vidare på detta och kräver bemannad översyn och styrning i högriskanvändning. Detta blir snabbt en lagstandard snarare än trend.

Framtidsspaning: compliance-drivna HITL-system

Till 2030 har många företag infört "compliance HITL", granskande arbetsflöden designade för att möta regler. Exempel:

- Mänskliga revisorer som regelbundet granskar och loggar AI-beslut.

- Organisationer bildar AI-övervakningsteam med liknande roll som flygledare eller cybersäkerhets-center.

- Kontrollpunkter för människor där riskerna är som störst.

Verktyg och plattformar inkluderar dashboards för att spåra modellers träffsäkerhet och handlingar från mänskliga granskare. Spårbarhet blir ett compliance-krav.

Expertinsikt: hybrid styrning av AI

Företag satsar redan på hybridramverk där automation och mänsklig kontroll kombineras. Gartner rapporterar att 67 % av mogna företag har dedikerade AI-team och skapat nya roller som AI Ethics Officers, Model Managers och Knowledge Engineers för ansvarsfull AI.

Roller som ”AI-revisor”, ”AI-riskmanager” och ”Human-in-the-Loop Supervisor” förväntas bli vanliga till 2030 – ett tydligt tecken på att mänsklig kontroll byggs in från början.

Förklarbarhet möter reglering

Regulatorer kräver numera att engagerade människor även kan motivera och förklara besluten. Det ställer krav på dokumentation och noggranna revisionsspår. NIST AI RMF rekommenderar redan möjligheten för människor att åsidosätta AI och regelbunden manuell outputgranskning.

Företag kan även etablera "AI-tillitscertifieringar" för att signalera ansvarsfull styrning med mänsklig översyn.

Trend 3: Lågtkodplattformar och demokratisering

Tidigare har HITL-flöden krävt kod, integrationer och teknikspecifika team. Det har bromsat mindre företag och icke-tekniska användare. Nu förväntas lågtkods- och no-code-verktyg demokratisera HITL mellan 2026 och 2030.

Plattformar som UiPath, Microsoft Power Automate och Amazon A2I erbjuder drag-and-drop-verktyg där manuella granskasteg enkelt infogas i automatiseringen.

Framtidsspaning: AI-flöden byggda av affärsanvändare

HITL-funktionalitet blir standard i AI-plattformar. AmplifAI lyfter att 70 % av CX-ledare till 2026 planerar att införa Generativ AI med inbyggd HITL för kvalitetssäkring.

Nu kan avdelningar som juridik, drift och ekonomi själva bygga AI-flöden och beslutsgranskning. Organisatorisk tillgång till HITL gör att tillväxt och säkerhet kan balanseras.

I framtiden kan LLM:er rekommendera HITL-steg där datakvaliteten sviktar eller risken är som störst. Dashboards visar underlag, flaggar avvikelser och möjliggör manuell återkoppling.

Crowdsourcad manuell granskning

En annan trend är skalbar, crowdsourcad manuell validering genom tjänster som Amazon Mechanical Turk. Det gör att företag kan säkerställa kvalitet och tillförlitlighet utan stora interna team.

Tänk på ett e-handelbolag som använder AI för att moderera recensioner, men låter alla tveksamma fall manuellt bedömas av externa HITL-aktörer – snabbt och flexibelt.

Branschens rörelse mot tillgänglig HITL

Det ska vara lika enkelt att sätta upp HITL-granskning som att bygga en e-postkampanj – och möjlighet till kod- eller drag-and-drop-funktionalitet finns hos modern plattformar.

Detta linjerar med Parseurs filosofi: Parseur erbjuder skräddarsydda mallar och processer där du själv avgör balansen mellan AI och mänskliga steg. När HITL integreras naturligt i automationen blir det enkelt att skala kvalitetssäkrad AI i alla branscher.

Trend 4: Nya mänskliga roller – från datamärkare till strategiska övervakare

När AI utvecklas förändras de mänskliga rollerna från repetitiva, datarelaterade uppgifter till mer strategiskt och affärskritiskt arbete. Tidigare var HITL ofta lika med datamärkning och enkel kontroll, men dessa steg automatiseras eller outsourcas framöver.

I Statisticas analys för 2026 står det att människor utför 47 % av arbetsuppgifterna, maskiner 22 %, och 30 % samverkar. Till 2030 väntas maskinernas andel öka ytterligare.

Framtidsspaning: HITL 2.0 – AI-övervakare och riskchefer

I den nya “Human-in-the-Loop 2.0”-modellen är människan övervakare, coach eller riskansvarig.

En läkare ingriper exempelvis bara när ett medicinskt AI-beslut avviker. Här används mänsklig expertis för både kvalitetssäkring i stunden och träning av modellerna för framtiden. Det handlar om symbios mellan människa och AI.

World Economic Forum estimerar att 60 % av arbetsgivarna till 2030 söker ökad analytisk och ledarskapskompetens – automatiserat rutinjobb minskar.

Detta banar väg för “human-on-the-loop”-roller, där människor övervakar AI-system och ingriper när det är nödvändigt, likt ett kontrolltorn för automatiska processer.

Människan förstärkt av AI

AI kommer inte bara stödja arbetsflöden, utan assistera övervakaren: Systemet kan exempelvis flagga avvikande beslut och föreslå granskning.

Nya jobbtitlar och ansvar

Mot 2030 styrs AI-systemen av roller som:

- AI Feedback Specialist

- Algoritmetikansvarig

- Modellbeteende-coach

- Human-in-the-Loop Supervisor

Denna utveckling ger ökat fokus på kvalitetsstyrning och ansvarsfull AI-utveckling.

Rapporten Global Human Capital Trends 2026 från Deloitte säger att 57 % av företagsledare anser att anställda måste lära sig att resonera tillsammans med maskiner – inte bara använda dem.

Trend 5: Människa-AI-synergi och etisk AI som konkurrensfördel

Framtiden för AI handlar inte om maskin mot människa utan om maskin med människa – där vi får bättre, etisk och mer träffsäker problemlösning.

Augmented intelligence innebär att AI:s styrkor (hastighet, skala, mönsterigenkänning) kombineras med mänskliga förmågor (etik, empati, expertis) – och ger bättre beslut på samtliga nivåer.

Enligt Gartner har 55 % av organisationer nu AI-styrelser eller särskilda styrgrupper för AI, vilket understryker vikten av mänsklig kontroll och etik.

Varför synergin avgör

Till 2026 är ”human-in-the-loop” inte längre ett valfritt skydd, utan en kärnegenskap i trovärdig AI. Från lånebeslut till rekrytering och vård är mänsklig granskning en kvalitetsgaranti.

Organisationer lär marknadsföra sin HITL-modell som varumärkesfördel. I framtiden kan etikmärkningar som ”Human-Verified AI” eller ”Mänskligt granskad AI” bli det nya normala – särskilt i branscher med stora konsekvenser som vård, finans och utbildning.

Mänsklig kontroll över AI ökar användarförtroendet, särskilt när felbedömningar snabbt får stora effekter.

Etisk AI som affärsstrategi

Historiska AI-misslyckanden – partiska rekryteringssystem, felaktiga domslut och bristfälliga diagnoser – visar riskerna med oövervakad automation.

Genom att integrera mänsklig översyn möter man inte bara lagkrav – man bevisar även ansvarstagande och tjänar på ökad kundförtroende.

Certifieringar och spårbara system

Vi kan få certifierade AI-lösningar för HITL som kvalitetsstämpel. Likt ISO-standarder kan AI-plattformar bära bevis på att beslut kan granskas, motiveras och omprövas av människor.

Det ger en konkurrensfördel då transparenta och mänskligt övervakade system skapar förtroende hos både kunder, investerare och tillsynsmyndigheter.

NIST AI Risk Management Framework rekommenderar HITL och human-on-the-loop som grundmekanismer för att minska AI-risk. Det förväntas bli lagkrav inom högriskanvändningar de närmaste åren.

Human-in-the-Loop som grunddesign

”HITL by design” växer. Det innebär att man bygger AI-systemen med inbyggd mänsklig kontroll från början för att säkra ansvarsfull AI – med rättvisa och transparens inneboende i varje steg.

Flera ledande företag har redan implementerat denna filosofi.

I slutändan handlar det inte om människa mot maskin. Det handlar om människa med maskin. — Satya Nadella, VD, Microsoft

Synsättet formar produktutvecklingen inom alla teknikområden.

Mot 2030: Människa och AI hand i hand

Allt eftersom AI accelererar blir budskapet tydligt: framtiden tillhör de som balanserar automatisering med mänsklig expertis.

Enligt PWC kan AI tillföra upp till 15,7 biljoner dollar till världsekonomin till 2030.

HITL försvinner inte i takt med allt smartare AI – tvärtom blir det en strategisk nödvändighet och byggs in i designen av etiska, spårbara och förklarbara system.

Mot 2030 är mänsklig översyn inte en bonus utan ett grundkrav. HITL blir del av såväl regelverk som plattformsfunktionalitet – och de som agerar tidigt får bäst konkurrenskraft.

Se det såhär: precis som säkerhetsbälten blev norm i bilar så blir HITL standard i seriösa AI-implementationer – för att skydda användare, förebygga fel och skapa inkluderande innovation.

Det är nu företag bör agera: Amazon spår nästan total AI-användning i Europa till 2030.

Företagsledare och strateger kan med fördel börja med att:

- Investera i förklarande AI-gränssnitt och verktyg

- Skapa särskilda översynsroller i teamen

- Välja plattformar med effektiva HITL-stöd

- Utforma processer där människa och AI samarbetar från start

I takt med ökad reglering och fokus på tillit blir dessa insatser avgörande för robusthet, flexibilitet och etiskt ledarskap.

Senast uppdaterad